正在加载图片...

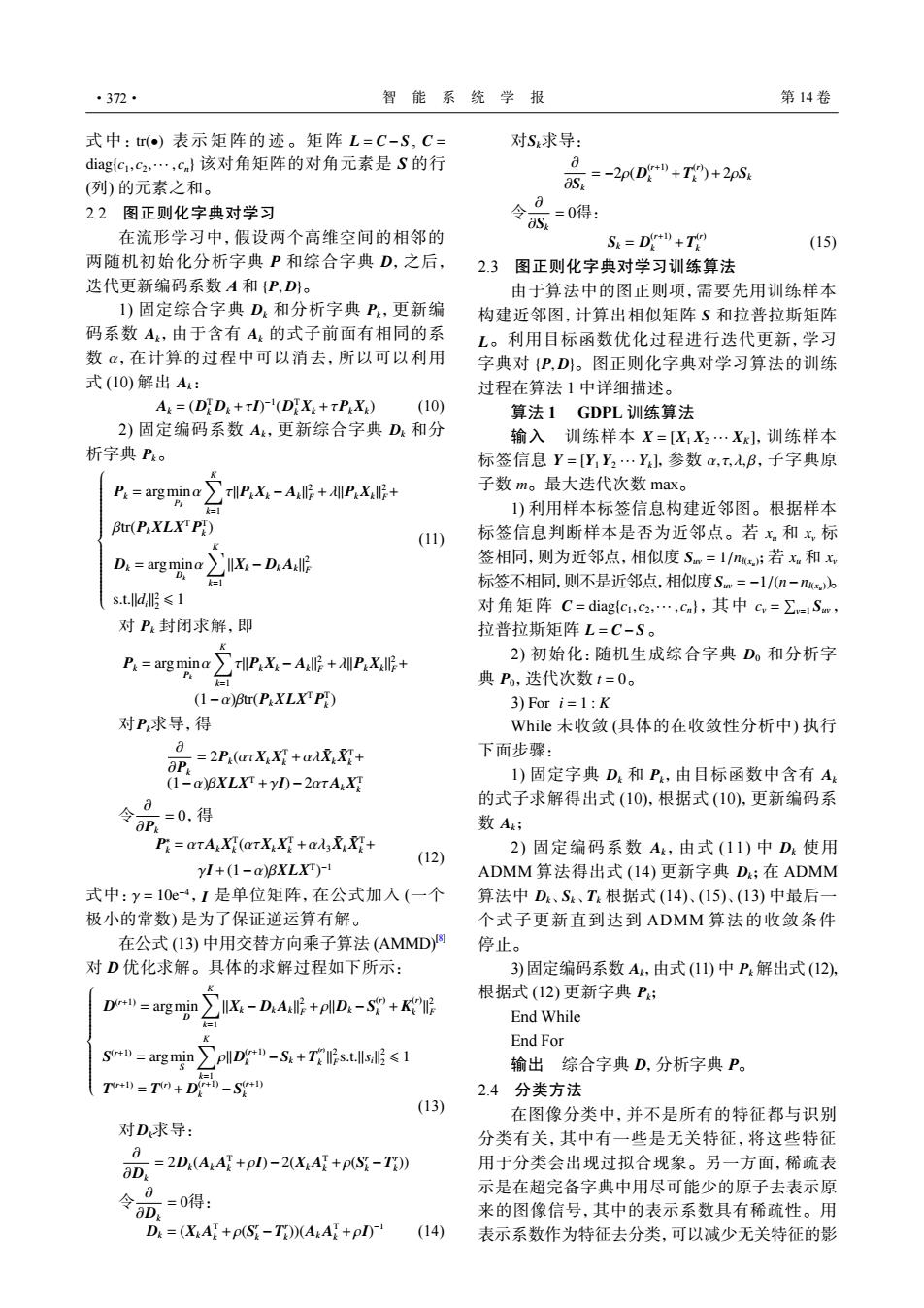

·372· 智能系统学报 第14卷 式中:r()表示矩阵的迹。矩阵L=C-S,C= 对S求导: diag{c1,c2,…,cn}该对角矩阵的对角元素是S的行 0 =-2p(D+T)+2pSe (列)的元素之和。 aSk 2.2图正则化字典对学习 o =0得: OSk 在流形学习中,假设两个高维空间的相邻的 S&=DD+T (15) 两随机初始化分析字典P和综合字典D,之后, 2.3图正则化字典对学习训练算法 迭代更新编码系数A和{P,D。 由于算法中的图正则项,需要先用训练样本 1)固定综合字典D和分析字典P,更新编 构建近邻图,计算出相似矩阵S和拉普拉斯矩阵 码系数A,由于含有A:的式子前面有相同的系 L。利用目标函数优化过程进行迭代更新,学习 数α,在计算的过程中可以消去,所以可以利用 字典对P,D。图正则化字典对学习算法的训练 式(10)解出A: 过程在算法1中详细描述。 Ak=(DID:+D(DIX:+TPX) (10) 算法1GDPL训练算法 2)固定编码系数Ak,更新综合字典D和分 输入训练样本X=[X1X2…Xx],训练样本 析字典Po 标签信息Y=[YY2…Y,参数α,x,B,子字典原 子数m。最大迭代次数max。 =agma2PX-A+P,X眼 P 1)利用样本标签信息构建近邻图。根据样本 Bu(PXLXP!) (11) 标签信息判断样本是否为近邻点。若x和x,标 D,=argmina∑IX-DAf 签相同,则为近邻点,相似度S=1/m:若x和x k=1 标签不相同,则不是近邻点,相似度S=-1/n-n s.tld服≤1 对角矩阵C=diag{c,c2,…,cn},其中c,=∑=1Sw, 对P封闭求解,即 拉普拉斯矩阵L=C-S。 P.=argmgnaP 2)初始化:随机生成综合字典D。和分析字 k=1 典Po,迭代次数t=0。 (1-a)Btr(PXLXTPE) 3)For i=1:K 对P求导,得 While未收敛(具体的在收敛性分析中)执行 -2P.(rrX.Xj+alS8+ 下面步骤: aP (1-a)BXLXT +yD-2aTAXI 1)固定字典Dk和P,由目标函数中含有A 令品0科 的式子求解得出式(10),根据式(10),更新编码系 数A; Pi=QTA XI(QTX XI+a XX+ (12) 2)固定编码系数Ak,由式(11)中Dk使用 yI+(1-a)BXLXT)-1 ADMM算法得出式(I4)更新字典Dk;在ADMM 式中:y=10e-4,1是单位矩阵,在公式加人(一个 算法中D、Sk、T根据式(14)、(15)、(13)中最后一 极小的常数)是为了保证逆运算有解。 个式子更新直到达到ADMM算法的收敛条件 在公式(13)中用交替方向乘子算法(AMMD) 停止。 对D优化求解。具体的求解过程如下所示: 3)固定编码系数Ak,由式(11)中P解出式(12), 根据式(12)更新字典P: arg minDAD? End While End For S+=argmin∑plID-Se+T2Is.s服≤1 输出综合字典D,分析字典P。 TD)T+D(D-SD 2.4、分类方法 (13) 在图像分类中,并不是所有的特征都与识别 对D求导: 分类有关,其中有一些是无关特征,将这些特征 =2D.(4A+pD-2XAI+(S-T) 用于分类会出现过拟合现象。另一方面,稀疏表 令品=附: 示是在超完备字典中用尽可能少的原子去表示原 来的图像信号,其中的表示系数具有稀疏性。用 D:=(XxA+P(S:-T)(AAI+pD- (14) 表示系数作为特征去分类,可以减少无关特征的影tr(•) L = C−S C = diag{c1, c2,··· , cn} 式中: 表示矩阵的迹。矩阵 , 该对角矩阵的对角元素是 S 的行 (列) 的元素之和。 2.2 图正则化字典对学习 {P, D} 在流形学习中,假设两个高维空间的相邻的 两随机初始化分析字典 P 和综合字典 D,之后, 迭代更新编码系数 A 和 。 Dk Pk Ak Ak α Ak 1) 固定综合字典 和分析字典 ,更新编 码系数 ,由于含有 的式子前面有相同的系 数 ,在计算的过程中可以消去,所以可以利用 式 (10) 解出 : Ak = (D T k Dk +τI) −1 (D T k Xk +τPkXk) (10) Ak Dk Pk 2) 固定编码系数 ,更新综合字典 和分 析字典 。 Pk = argmin Pk α ∑K k=1 τ||PkXk − Ak ||2 F +λ||PkXk ||2 F+ βtr(PkXLXT P T k ) Dk = argmin Dk α ∑K k=1 ||Xk − DkAk ||2 F s.t.||di ||2 2 ⩽ 1 (11) 对 Pk 封闭求解,即 Pk = argmin Pk α ∑K k=1 τ||PkXk − Ak ||2 F +λ||PkXk ||2 F+ (1−α)βtr(PkXLXT P T k ) 对 Pk求导,得 ∂ ∂Pk = 2Pk(ατXkX T k +αλX¯ kX¯ T k + (1−α)βXLXT +γI)−2ατAkX T k ∂ ∂Pk 令 = 0 ,得 P ∗ k = ατAkX T k (ατXkX T k +αλ3X¯ kX¯ T k + γI+(1−α)βXLXT ) −1 (12) γ = 10e−4 式中: ,I 是单位矩阵,在公式加入 (一个 极小的常数) 是为了保证逆运算有解。 在公式 (13) 中用交替方向乘子算法 (AMMD)[8] 对 D 优化求解。具体的求解过程如下所示: D (r+1) = argmin D ∑K k=1 ||Xk − DkAk ||2 F +ρ||Dk −S (r) k + K (r) k ||2 F S (r+1) = argmin S ∑K k=1 ρ||D (r+1) k −Sk +T (r) k ||2 F s.t.||si ||2 2 ⩽ 1 T (r+1) = T (r) + D (r+1) k −S (r+1) k (13) 对 Dk求导: ∂ ∂Dk = 2Dk(AkA T k +ρI)−2(XkA T k +ρ(S r k −T r k )) ∂ ∂Dk 令 = 0 得: Dk = (XkA T k +ρ(S r k −T r k ))(AkA T k +ρI) −1 (14) 对 Sk求导: ∂ ∂Sk = −2ρ(D (r+1) k +T (r) k )+2ρSk ∂ ∂Sk 令 = 0 得: Sk = D (r+1) k +T (r) k (15) 2.3 图正则化字典对学习训练算法 S L {P, D} 由于算法中的图正则项,需要先用训练样本 构建近邻图,计算出相似矩阵 和拉普拉斯矩阵 。利用目标函数优化过程进行迭代更新,学习 字典对 。图正则化字典对学习算法的训练 过程在算法 1 中详细描述。 算法 1 GDPL 训练算法 X = [X1 X2 ··· XK] Y = [Y1 Y2 ··· Yk] α,τ, λ, β m 输入 训练样本 ,训练样本 标签信息 ,参数 ,子字典原 子数 。最大迭代次数 max。 xu xv Suv = 1/nl(xu) xu xv Suv = −1/(n−nl(xu )) C = diag{c1, c2,··· , cn} cv = ∑ v=1 Suv L = C−S 1) 利用样本标签信息构建近邻图。根据样本 标签信息判断样本是否为近邻点。若 和 标 签相同,则为近邻点,相似度 ;若 和 标签不相同,则不是近邻点,相似度 。 对角矩阵 ,其中 , 拉普拉斯矩阵 。 D0 P0 t = 0 2) 初始化:随机生成综合字典 和分析字 典 ,迭代次数 。 3) For i = 1 : K While 未收敛 (具体的在收敛性分析中) 执行 下面步骤: Dk Pk Ak Ak 1) 固定字典 和 ,由目标函数中含有 的式子求解得出式 (10),根据式 (10),更新编码系 数 ; Ak Dk Dk Dk Sk Tk 2) 固定编码系数 ,由式 (11) 中 使用 ADMM 算法得出式 (14) 更新字典 ;在 ADMM 算法中 、 、 根据式 (14)、(15)、(13) 中最后一 个式子更新直到达到 ADMM 算法的收敛条件 停止。 Ak Pk Pk 3) 固定编码系数 ,由式 (11) 中 解出式 (12), 根据式 (12) 更新字典 ; End While End For 输出 综合字典 D,分析字典 P。 2.4 分类方法 在图像分类中,并不是所有的特征都与识别 分类有关,其中有一些是无关特征,将这些特征 用于分类会出现过拟合现象。另一方面,稀疏表 示是在超完备字典中用尽可能少的原子去表示原 来的图像信号,其中的表示系数具有稀疏性。用 表示系数作为特征去分类,可以减少无关特征的影 ·372· 智 能 系 统 学 报 第 14 卷