正在加载图片...

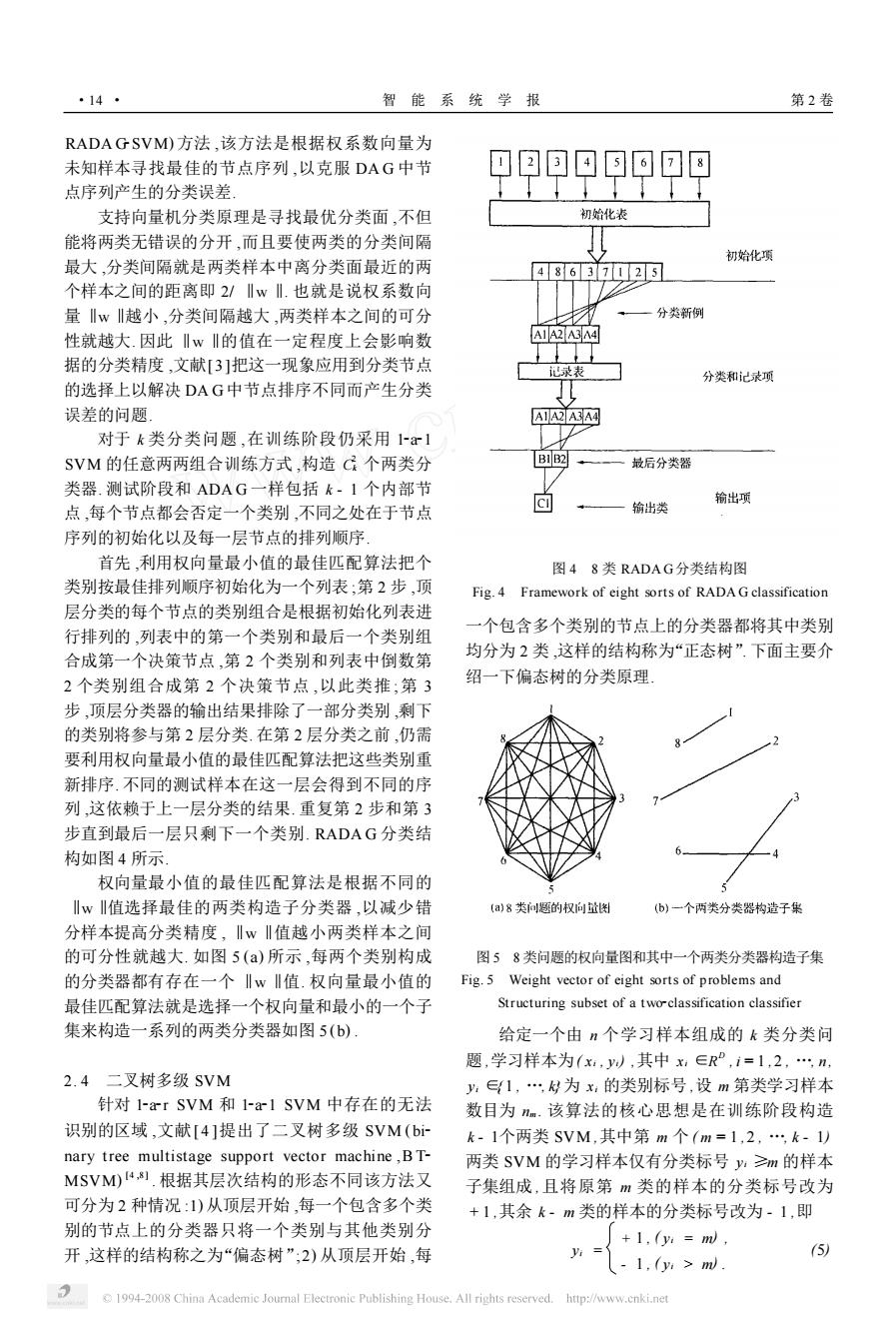

·14· 智能系统学报 第2卷 RADA GSVM)方法,该方法是根据权系数向量为 未知样本寻找最佳的节点序列,以克服DAG中节 点序列产生的分类误差, 支持向量机分类原理是寻找最优分类面,不但 初始化表 能将两类无错误的分开,而且要使两类的分类间隔 初始化项 最大,分类间隔就是两类样本中离分类面最近的两 4863725 个样本之间的距离即2/Iw‖.也就是说权系数向 量w川越小,分类间隔越大,两类样本之间的可分 分类新例 性就越大.因此川wI的值在一定程度上会影响数 A1A2A3A4 据的分类精度,文献[3]把这一现象应用到分类节点 心录表 分类和记录项 的选择上以解决DAG中节点排序不同而产生分类 T1 37 误差的问题 AIA2A3A4 对于k类分类问题,在训练阶段仍采用1x1 SVM的任意两两组合训练方式,构造C个两类分 BIB2 最后分类器 类器.测试阶段和ADAG一样包括k·1个内部节 点,每个节点都会否定一个类别,不同之处在于节点 回 输出项 输出类 序列的初始化以及每一层节点的排列顺序 首先,利用权向量最小值的最佳匹配算法把个 图48类RADAG分类结构图 类别按最佳排列顺序初始化为一个列表,第2步,顶 Fig.4 Framework of eight sorts of RADA G classification 层分类的每个节点的类别组合是根据初始化列表进 一个包含多个类别的节点上的分类器都将其中类别 行排列的,列表中的第一个类别和最后一个类别组 合成第一个决策节点,第2个类别和列表中倒数第 均分为2类,这样的结构称为“正态树”.下面主要介 2个类别组合成第2个决策节点,以此类推;第3 绍一下偏态树的分类原理」 步,顶层分类器的输出结果排除了一部分类别,剩下 的类别将参与第2层分类.在第2层分类之前,仍需 要利用权向量最小值的最佳匹配算法把这些类别重 新排序.不同的测试样本在这一层会得到不同的序 列,这依赖于上一层分类的结果.重复第2步和第3 步直到最后一层只剩下一个类别.RADAG分类结 构如图4所示 权向量最小值的最佳匹配算法是根据不同的 川w‖值选择最佳的两类构造子分类器,以减少错 (a)8类问概的权向量 (b)一个两类分类器构造子集 分样本提高分类精度,Iw‖值越小两类样本之间 的可分性就越大.如图5(a)所示,每两个类别构成 图58类问题的权向量图和其中一个两类分类器构造子集 的分类器都有存在一个‖w‖值.权向量最小值的 Fig.5 Weight vector of eight sorts of problems and 最佳匹配算法就是选择一个权向量和最小的一个子 Structuring subset of a twoclassification classifier 集来构造一系列的两类分类器如图5(b) 给定一个由n个学习样本组成的k类分类问 题,学习样本为(x,y,其中x∈RP,i=1,2,n, 2.4二叉树多级SVM y,∈{1,为x的类别标号,设m第类学习样本 针对I-rSVM和1x1SVM中存在的无法 数目为nm.该算法的核心思想是在训练阶段构造 识别的区域,文献[4]提出了二叉树多级SVM(bi k-1个两类SVM,其中第m个(m=1,2,,k-1) nary tree multistage support vector machine,BT- 两类SVM的学习样本仅有分类标号≥m的样本 MSVM)4剧.根据其层次结构的形态不同该方法又 子集组成,且将原第m类的样本的分类标号改为 可分为2种情况:1)从顶层开始,每一个包含多个类 +1,其余k-m类的样本的分类标号改为-1,即 别的节点上的分类器只将一个类别与其他类别分 +1,y:=m 开,这样的结构称之为“偏态树”;2)从顶层开始,每 (5 1.(y:>m) 1994-2008 China Academic Journal Electronic Publishing House.All rights reserved. http://www.cnki.netRADA G2SVM) 方法 ,该方法是根据权系数向量为 未知样本寻找最佳的节点序列 ,以克服 DA G 中节 点序列产生的分类误差. 支持向量机分类原理是寻找最优分类面 ,不但 能将两类无错误的分开 ,而且要使两类的分类间隔 最大 ,分类间隔就是两类样本中离分类面最近的两 个样本之间的距离即 2/ ‖w ‖. 也就是说权系数向 量 ‖w ‖越小 ,分类间隔越大 ,两类样本之间的可分 性就越大. 因此 ‖w ‖的值在一定程度上会影响数 据的分类精度 ,文献[ 3 ]把这一现象应用到分类节点 的选择上以解决 DA G中节点排序不同而产生分类 误差的问题. 对于 k 类分类问题 ,在训练阶段仍采用 12a21 SVM 的任意两两组合训练方式 ,构造 C 2 k 个两类分 类器. 测试阶段和 ADA G 一样包括 k - 1 个内部节 点 ,每个节点都会否定一个类别 ,不同之处在于节点 序列的初始化以及每一层节点的排列顺序. 首先 ,利用权向量最小值的最佳匹配算法把个 类别按最佳排列顺序初始化为一个列表 ;第 2 步 ,顶 层分类的每个节点的类别组合是根据初始化列表进 行排列的 ,列表中的第一个类别和最后一个类别组 合成第一个决策节点 ,第 2 个类别和列表中倒数第 2 个类别组合成第 2 个决策节点 ,以此类推 ;第 3 步 ,顶层分类器的输出结果排除了一部分类别 ,剩下 的类别将参与第 2 层分类. 在第 2 层分类之前 ,仍需 要利用权向量最小值的最佳匹配算法把这些类别重 新排序. 不同的测试样本在这一层会得到不同的序 列 ,这依赖于上一层分类的结果. 重复第 2 步和第 3 步直到最后一层只剩下一个类别. RADA G 分类结 构如图 4 所示. 权向量最小值的最佳匹配算法是根据不同的 ‖w ‖值选择最佳的两类构造子分类器 ,以减少错 分样本提高分类精度 , ‖w ‖值越小两类样本之间 的可分性就越大. 如图 5 (a) 所示 ,每两个类别构成 的分类器都有存在一个 ‖w ‖值. 权向量最小值的 最佳匹配算法就是选择一个权向量和最小的一个子 集来构造一系列的两类分类器如图 5 (b) . 2. 4 二叉树多级 SVM 针对 12a2r SVM 和 12a21 SVM 中存在的无法 识别的区域 ,文献[ 4 ]提出了二叉树多级 SVM ( bi2 nary tree multistage support vector machine ,B T2 MSVM) [4 ,8 ] . 根据其层次结构的形态不同该方法又 可分为 2 种情况 :1) 从顶层开始 ,每一个包含多个类 别的节点上的分类器只将一个类别与其他类别分 开 ,这样的结构称之为“偏态树”;2) 从顶层开始 ,每 图 4 8 类 RADA G分类结构图 Fig. 4 Framework of eight sorts of RADA G classification 一个包含多个类别的节点上的分类器都将其中类别 均分为 2 类 ,这样的结构称为“正态树”. 下面主要介 绍一下偏态树的分类原理. 图 5 8 类问题的权向量图和其中一个两类分类器构造子集 Fig. 5 Weight vector of eight sorts of problems and Structuring subset of a two2classification classifier 给定一个由 n 个学习样本组成的 k 类分类问 题 ,学习样本为( xi , yi) ,其中 xi ∈R D , i = 1 ,2 , …, n , yi ∈{ 1 , …, k}为 xi 的类别标号 ,设 m 第类学习样本 数目为 nm . 该算法的核心思想是在训练阶段构造 k - 1个两类 SVM ,其中第 m 个 ( m = 1 , 2 , …, k - 1) 两类 SVM 的学习样本仅有分类标号 yi ≥m 的样本 子集组成 ,且将原第 m 类的样本的分类标号改为 + 1 ,其余 k - m 类的样本的分类标号改为 - 1 ,即 yi = + 1 , ( yi = m) , - 1 , ( yi > m) . (5) · 41 · 智 能 系 统 学 报 第 2 卷