正在加载图片...

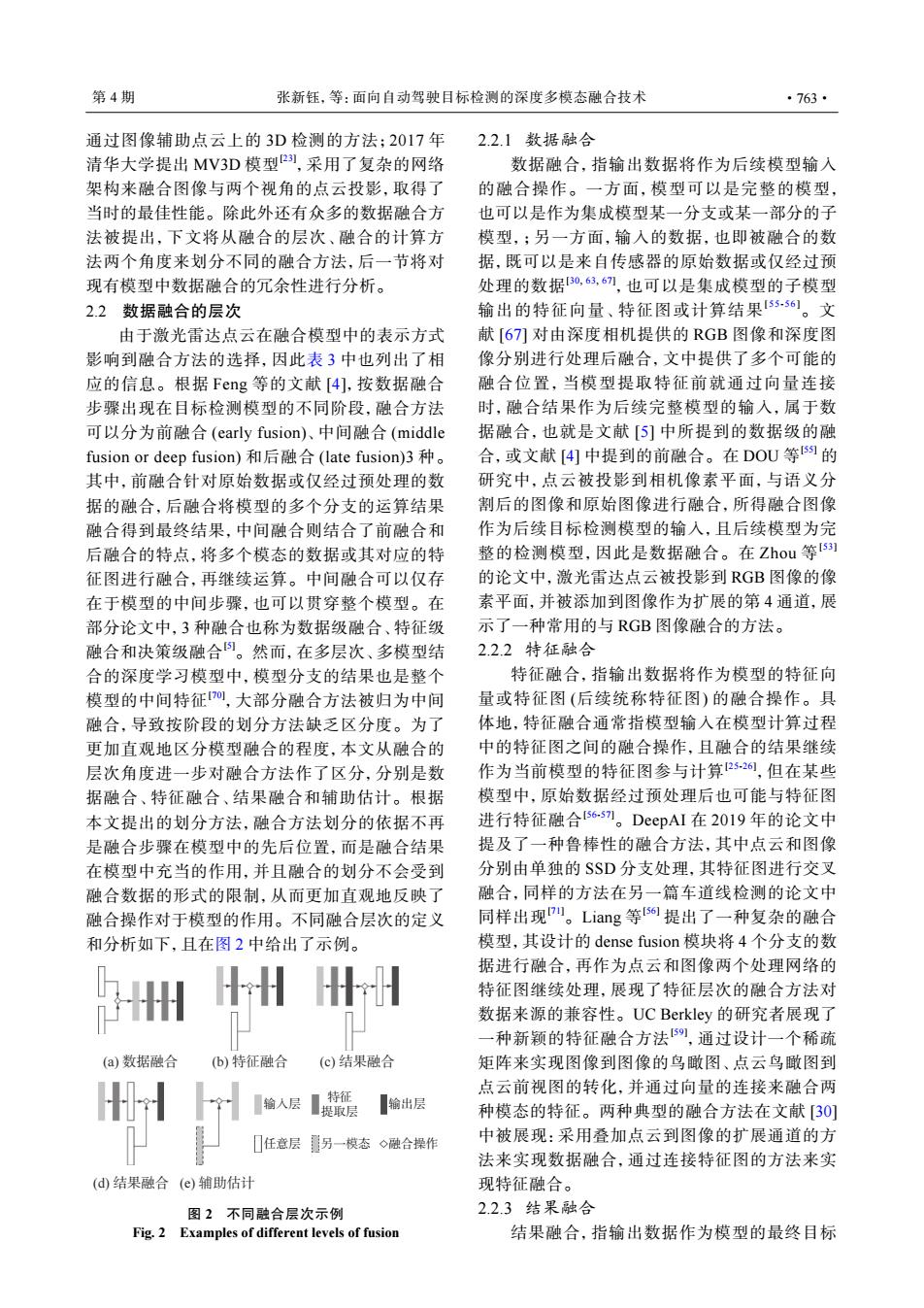

第4期 张新钰,等:面向自动驾驶目标检测的深度多模态融合技术 ·763· 通过图像辅助点云上的3D检测的方法;2017年 2.2.1数据融合 清华大学提出MV3D模型P),采用了复杂的网络 数据融合,指输出数据将作为后续模型输入 架构来融合图像与两个视角的点云投影,取得了 的融合操作。一方面,模型可以是完整的模型, 当时的最佳性能。除此外还有众多的数据融合方 也可以是作为集成模型某一分支或某一部分的子 法被提出,下文将从融合的层次、融合的计算方 模型,;另一方面,输入的数据,也即被融合的数 法两个角度来划分不同的融合方法,后一节将对 据,既可以是来自传感器的原始数据或仅经过预 现有模型中数据融合的冗余性进行分析。 处理的数据0,63,6,也可以是集成模型的子模型 2.2数据融合的层次 输出的特征向量、特征图或计算结果556。文 由于激光雷达点云在融合模型中的表示方式 献[67]对由深度相机提供的RGB图像和深度图 影响到融合方法的选择,因此表3中也列出了相 像分别进行处理后融合,文中提供了多个可能的 应的信息。根据Feng等的文献[4],按数据融合 融合位置,当模型提取特征前就通过向量连接 步骤出现在目标检测模型的不同阶段,融合方法 时,融合结果作为后续完整模型的输人,属于数 可以分为前融合(early fusion)、中间融合(middle 据融合,也就是文献[⑤]中所提到的数据级的融 fusion or deep fusion)和后融合(late fusion)3种。 合,或文献[4]中提到的前融合。在DOU等s的 其中,前融合针对原始数据或仅经过预处理的数 研究中,点云被投影到相机像素平面,与语义分 据的融合,后融合将模型的多个分支的运算结果 割后的图像和原始图像进行融合,所得融合图像 融合得到最终结果,中间融合则结合了前融合和 作为后续目标检测模型的输入,且后续模型为完 后融合的特点,将多个模态的数据或其对应的特 整的检测模型,因此是数据融合。在Zhou等s] 征图进行融合,再继续运算。中间融合可以仅存 的论文中,激光雷达点云被投影到RGB图像的像 在于模型的中间步骤,也可以贯穿整个模型。在 素平面,并被添加到图像作为扩展的第4通道,展 部分论文中,3种融合也称为数据级融合、特征级 示了一种常用的与RGB图像融合的方法。 融合和决策级融合。然而,在多层次、多模型结 2.2.2特征融合 合的深度学习模型中,模型分支的结果也是整个 特征融合,指输出数据将作为模型的特征向 模型的中间特征0,大部分融合方法被归为中间 量或特征图(后续统称特征图)的融合操作。具 融合,导致按阶段的划分方法缺乏区分度。为了 体地,特征融合通常指模型输入在模型计算过程 更加直观地区分模型融合的程度,本文从融合的 中的特征图之间的融合操作,且融合的结果继续 层次角度进一步对融合方法作了区分,分别是数 作为当前模型的特征图参与计算2s2,但在某些 据融合、特征融合、结果融合和辅助估计。根据 模型中,原始数据经过预处理后也可能与特征图 本文提出的划分方法,融合方法划分的依据不再 进行特征融合s6-sm。DeepAI在2019年的论文中 是融合步骤在模型中的先后位置,而是融合结果 提及了一种鲁棒性的融合方法,其中点云和图像 在模型中充当的作用,并且融合的划分不会受到 分别由单独的SSD分支处理,其特征图进行交叉 融合数据的形式的限制,从而更加直观地反映了 融合,同样的方法在另一篇车道线检测的论文中 融合操作对于模型的作用。不同融合层次的定义 同样出现。Liang等s提出了一种复杂的融合 和分析如下,且在图2中给出了示例。 模型,其设计的dense fusion模块将4个分支的数 据进行融合,再作为点云和图像两个处理网络的 特征图继续处理,展现了特征层次的融合方法对 数据来源的兼容性。UC Berkley的研究者展现了 种新颖的特征融合方法6,通过设计一个稀疏 (a)数据融合 (b)特征融合 (c)结果融合 矩阵来实现图像到图像的鸟瞰图、点云鸟瞰图到 点云前视图的转化,并通过向量的连接来融合两 输入层 输出层 种模态的特征。两种典型的融合方法在文献[30] 门任意层疆另一模态◇融合操作 中被展现:采用叠加点云到图像的扩展通道的方 法来实现数据融合,通过连接特征图的方法来实 (d结果融合(e)辅助估计 现特征融合。 图2不同融合层次示例 2.2.3结果融合 Fig.2 Examples of different levels of fusion 结果融合,指输出数据作为模型的最终目标通过图像辅助点云上的 3D 检测的方法;2017 年 清华大学提出 MV3D 模型[23] ,采用了复杂的网络 架构来融合图像与两个视角的点云投影,取得了 当时的最佳性能。除此外还有众多的数据融合方 法被提出,下文将从融合的层次、融合的计算方 法两个角度来划分不同的融合方法,后一节将对 现有模型中数据融合的冗余性进行分析。 2.2 数据融合的层次 由于激光雷达点云在融合模型中的表示方式 影响到融合方法的选择,因此表 3 中也列出了相 应的信息。根据 Feng 等的文献 [4],按数据融合 步骤出现在目标检测模型的不同阶段,融合方法 可以分为前融合 (early fusion)、中间融合 (middle fusion or deep fusion) 和后融合 (late fusion)3 种。 其中,前融合针对原始数据或仅经过预处理的数 据的融合,后融合将模型的多个分支的运算结果 融合得到最终结果,中间融合则结合了前融合和 后融合的特点,将多个模态的数据或其对应的特 征图进行融合,再继续运算。中间融合可以仅存 在于模型的中间步骤,也可以贯穿整个模型。在 部分论文中,3 种融合也称为数据级融合、特征级 融合和决策级融合[5]。然而,在多层次、多模型结 合的深度学习模型中,模型分支的结果也是整个 模型的中间特征[70] ,大部分融合方法被归为中间 融合,导致按阶段的划分方法缺乏区分度。为了 更加直观地区分模型融合的程度,本文从融合的 层次角度进一步对融合方法作了区分,分别是数 据融合、特征融合、结果融合和辅助估计。根据 本文提出的划分方法,融合方法划分的依据不再 是融合步骤在模型中的先后位置,而是融合结果 在模型中充当的作用,并且融合的划分不会受到 融合数据的形式的限制,从而更加直观地反映了 融合操作对于模型的作用。不同融合层次的定义 和分析如下,且在图 2 中给出了示例。 (a) 数据融合 (b) 特征融合 (c) 结果融合 输出层 另一模态 融合操作 特征 提取层 任意层 (d) 结果融合 (e) 辅助估计 输入层 图 2 不同融合层次示例 Fig. 2 Examples of different levels of fusion 2.2.1 数据融合 数据融合,指输出数据将作为后续模型输入 的融合操作。一方面,模型可以是完整的模型, 也可以是作为集成模型某一分支或某一部分的子 模型,;另一方面,输入的数据,也即被融合的数 据,既可以是来自传感器的原始数据或仅经过预 处理的数据[30, 63, 67] ,也可以是集成模型的子模型 输出的特征向量、特征图或计算结果[ 5 5 - 5 6 ]。文 献 [67] 对由深度相机提供的 RGB 图像和深度图 像分别进行处理后融合,文中提供了多个可能的 融合位置,当模型提取特征前就通过向量连接 时,融合结果作为后续完整模型的输入,属于数 据融合,也就是文献 [5] 中所提到的数据级的融 合,或文献 [4] 中提到的前融合。在 DOU 等 [55] 的 研究中,点云被投影到相机像素平面,与语义分 割后的图像和原始图像进行融合,所得融合图像 作为后续目标检测模型的输入,且后续模型为完 整的检测模型,因此是数据融合。在 Zhou 等 [53] 的论文中,激光雷达点云被投影到 RGB 图像的像 素平面,并被添加到图像作为扩展的第 4 通道,展 示了一种常用的与 RGB 图像融合的方法。 2.2.2 特征融合 特征融合,指输出数据将作为模型的特征向 量或特征图 (后续统称特征图) 的融合操作。具 体地,特征融合通常指模型输入在模型计算过程 中的特征图之间的融合操作,且融合的结果继续 作为当前模型的特征图参与计算[25-26] ,但在某些 模型中,原始数据经过预处理后也可能与特征图 进行特征融合[56-57]。DeepAI 在 2019 年的论文中 提及了一种鲁棒性的融合方法,其中点云和图像 分别由单独的 SSD 分支处理,其特征图进行交叉 融合,同样的方法在另一篇车道线检测的论文中 同样出现[71]。Liang 等 [56] 提出了一种复杂的融合 模型,其设计的 dense fusion 模块将 4 个分支的数 据进行融合,再作为点云和图像两个处理网络的 特征图继续处理,展现了特征层次的融合方法对 数据来源的兼容性。UC Berkley 的研究者展现了 一种新颖的特征融合方法[59] ,通过设计一个稀疏 矩阵来实现图像到图像的鸟瞰图、点云鸟瞰图到 点云前视图的转化,并通过向量的连接来融合两 种模态的特征。两种典型的融合方法在文献 [30] 中被展现:采用叠加点云到图像的扩展通道的方 法来实现数据融合,通过连接特征图的方法来实 现特征融合。 2.2.3 结果融合 结果融合,指输出数据作为模型的最终目标 第 4 期 张新钰,等:面向自动驾驶目标检测的深度多模态融合技术 ·763·