正在加载图片...

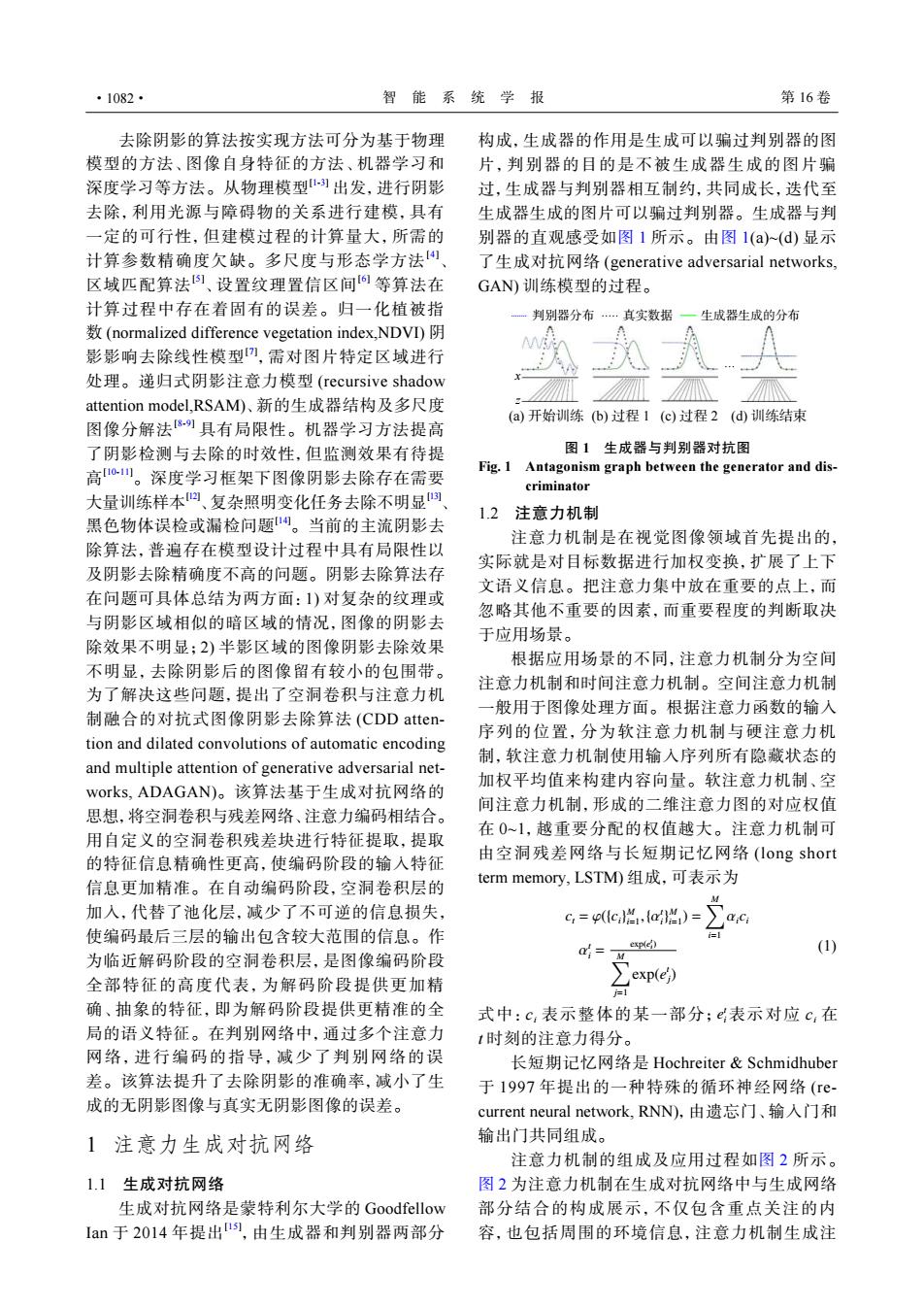

·1082· 智能系统学报 第16卷 去除阴影的算法按实现方法可分为基于物理 构成,生成器的作用是生成可以骗过判别器的图 模型的方法、图像自身特征的方法、机器学习和 片,判别器的目的是不被生成器生成的图片骗 深度学习等方法。从物理模型)出发,进行阴影 过,生成器与判别器相互制约,共同成长,迭代至 去除,利用光源与障碍物的关系进行建模,具有 生成器生成的图片可以骗过判别器。生成器与判 一定的可行性,但建模过程的计算量大,所需的 别器的直观感受如图1所示。由图l(a(d)显示 计算参数精确度欠缺。多尺度与形态学方法) 了生成对抗网络(generative adversarial networks, 区域匹配算法I、设置纹理置信区间6等算法在 GAN)训练模型的过程。 计算过程中存在着固有的误差。归一化植被指 判别器分布…真实数据 生成器生成的分布 (normalized difference vegetation index,NDVI) 影影响去除线性模型Ⅵ,需对图片特定区域进行 处理。递归式阴影注意力模型(recursive shadow attention model,.RSAM)、新的生成器结构及多尺度 (a)开始训练(b)过程1(c)过程2(d)训练结束 图像分解法⑧具有局限性。机器学习方法提高 了阴影检测与去除的时效性,但监测效果有待提 图1生成器与判别器对抗图 高0"”。深度学习框架下图像阴影去除存在需要 Fig.1 Antagonism graph between the generator and dis- criminator 大量训练样本凶、复杂照明变化任务去除不明显间 1.2注意力机制 黑色物体误检或漏检问题。当前的主流阴影去 注意力机制是在视觉图像领域首先提出的, 除算法,普遍存在模型设计过程中具有局限性以 实际就是对目标数据进行加权变换,扩展了上下 及阴影去除精确度不高的问题。阴影去除算法存 文语义信息。把注意力集中放在重要的点上,而 在问题可具体总结为两方面:1)对复杂的纹理或 忽略其他不重要的因素,而重要程度的判断取决 与阴影区域相似的暗区域的情况,图像的阴影去 于应用场景。 除效果不明显;2)半影区域的图像阴影去除效果 根据应用场景的不同,注意力机制分为空间 不明显,去除阴影后的图像留有较小的包围带。 注意力机制和时间注意力机制。空间注意力机制 为了解决这些问题,提出了空洞卷积与注意力机 一般用于图像处理方面。根据注意力函数的输入 制融合的对抗式图像阴影去除算法(CDD atten- 序列的位置,分为软注意力机制与硬注意力机 tion and dilated convolutions of automatic encoding 制,软注意力机制使用输人序列所有隐藏状态的 and multiple attention of generative adversarial net- 加权平均值来构建内容向量。软注意力机制、空 works,.ADAGAN)。该算法基于生成对抗网络的 间注意力机制,形成的二维注意力图的对应权值 思想,将空洞卷积与残差网络、注意力编码相结合。 在0~1,越重要分配的权值越大。注意力机制可 用自定义的空洞卷积残差块进行特征提取,提取 的特征信息精确性更高,使编码阶段的输入特征 由空洞残差网络与长短期记忆网络(long short 信息更加精准。在自动编码阶段,空洞卷积层的 term memory,.LSTM)组成,可表示为 加入,代替了池化层,减少了不可逆的信息损失, c,=(cl,{a1)=) 使编码最后三层的输出包含较大范围的信息。作 a, exp() (1) 为临近解码阶段的空洞卷积层,是图像编码阶段 全部特征的高度代表,为解码阶段提供更加精 exp(ej) =1 确、抽象的特征,即为解码阶段提供更精准的全 式中:c,表示整体的某一部分;E表示对应c,在 局的语义特征。在判别网络中,通过多个注意力 1时刻的注意力得分。 网络,进行编码的指导,减少了判别网络的误 长短期记忆网络是Hochreiter&Schmidhuber 差。该算法提升了去除阴影的准确率,减小了生 于1997年提出的一种特殊的循环神经网络(re- 成的无阴影图像与真实无阴影图像的误差。 current neural network.RNN.由遗忘门、输入门和 1注意力生成对抗网络 输出门共同组成。 注意力机制的组成及应用过程如图2所示。 1.1生成对抗网络 图2为注意力机制在生成对抗网络中与生成网络 生成对抗网络是蒙特利尔大学的Goodfellow 部分结合的构成展示,不仅包含重点关注的内 Ian于2014年提出,由生成器和判别器两部分 容,也包括周围的环境信息,注意力机制生成注去除阴影的算法按实现方法可分为基于物理 模型的方法、图像自身特征的方法、机器学习和 深度学习等方法。从物理模型[1-3] 出发,进行阴影 去除,利用光源与障碍物的关系进行建模,具有 一定的可行性,但建模过程的计算量大,所需的 计算参数精确度欠缺。多尺度与形态学方法[4] 、 区域匹配算法[5] 、设置纹理置信区间[6] 等算法在 计算过程中存在着固有的误差。归一化植被指 数 (normalized difference vegetation index,NDVI) 阴 影影响去除线性模型[7] ,需对图片特定区域进行 处理。递归式阴影注意力模型 (recursive shadow attention model,RSAM)、新的生成器结构及多尺度 图像分解法[8-9] 具有局限性。机器学习方法提高 了阴影检测与去除的时效性,但监测效果有待提 高 [10-11]。深度学习框架下图像阴影去除存在需要 大量训练样本[12] 、复杂照明变化任务去除不明显[13] 、 黑色物体误检或漏检问题[14]。当前的主流阴影去 除算法,普遍存在模型设计过程中具有局限性以 及阴影去除精确度不高的问题。阴影去除算法存 在问题可具体总结为两方面:1) 对复杂的纹理或 与阴影区域相似的暗区域的情况,图像的阴影去 除效果不明显;2) 半影区域的图像阴影去除效果 不明显,去除阴影后的图像留有较小的包围带。 为了解决这些问题,提出了空洞卷积与注意力机 制融合的对抗式图像阴影去除算法 (CDD attention and dilated convolutions of automatic encoding and multiple attention of generative adversarial networks, ADAGAN)。该算法基于生成对抗网络的 思想,将空洞卷积与残差网络、注意力编码相结合。 用自定义的空洞卷积残差块进行特征提取,提取 的特征信息精确性更高,使编码阶段的输入特征 信息更加精准。在自动编码阶段,空洞卷积层的 加入,代替了池化层,减少了不可逆的信息损失, 使编码最后三层的输出包含较大范围的信息。作 为临近解码阶段的空洞卷积层,是图像编码阶段 全部特征的高度代表,为解码阶段提供更加精 确、抽象的特征,即为解码阶段提供更精准的全 局的语义特征。在判别网络中,通过多个注意力 网络,进行编码的指导,减少了判别网络的误 差。该算法提升了去除阴影的准确率,减小了生 成的无阴影图像与真实无阴影图像的误差。 1 注意力生成对抗网络 1.1 生成对抗网络 生成对抗网络是蒙特利尔大学的 Goodfellow Ian 于 2014 年提出[15] ,由生成器和判别器两部分 构成,生成器的作用是生成可以骗过判别器的图 片,判别器的目的是不被生成器生成的图片骗 过,生成器与判别器相互制约,共同成长,迭代至 生成器生成的图片可以骗过判别器。生成器与判 别器的直观感受如图 1 所示。由图 1(a)~(d) 显示 了生成对抗网络 (generative adversarial networks, GAN) 训练模型的过程。 … x z (a) 开始训练 (b) 过程 1 (c) 过程 2 (d) 训练结束 判别器分布 真实数据 生成器生成的分布 图 1 生成器与判别器对抗图 Fig. 1 Antagonism graph between the generator and discriminator 1.2 注意力机制 注意力机制是在视觉图像领域首先提出的, 实际就是对目标数据进行加权变换,扩展了上下 文语义信息。把注意力集中放在重要的点上,而 忽略其他不重要的因素,而重要程度的判断取决 于应用场景。 根据应用场景的不同,注意力机制分为空间 注意力机制和时间注意力机制。空间注意力机制 一般用于图像处理方面。根据注意力函数的输入 序列的位置,分为软注意力机制与硬注意力机 制,软注意力机制使用输入序列所有隐藏状态的 加权平均值来构建内容向量。软注意力机制、空 间注意力机制,形成的二维注意力图的对应权值 在 0~1,越重要分配的权值越大。注意力机制可 由空洞残差网络与长短期记忆网络 (long short term memory, LSTM) 组成,可表示为 ct = φ({ci} M i=1 ,{α t i } M i=1 ) = ∑M i=1 αici α t i = exp(e t i ) ∑M j=1 exp(e t j ) (1) e t 式中:ci 表示整体的某一部分; i表示对应 ci 在 t 时刻的注意力得分。 长短期记忆网络是 Hochreiter & Schmidhuber 于 1997 年提出的一种特殊的循环神经网络 (recurrent neural network, RNN),由遗忘门、输入门和 输出门共同组成。 注意力机制的组成及应用过程如图 2 所示。 图 2 为注意力机制在生成对抗网络中与生成网络 部分结合的构成展示,不仅包含重点关注的内 容,也包括周围的环境信息,注意力机制生成注 ·1082· 智 能 系 统 学 报 第 16 卷