正在加载图片...

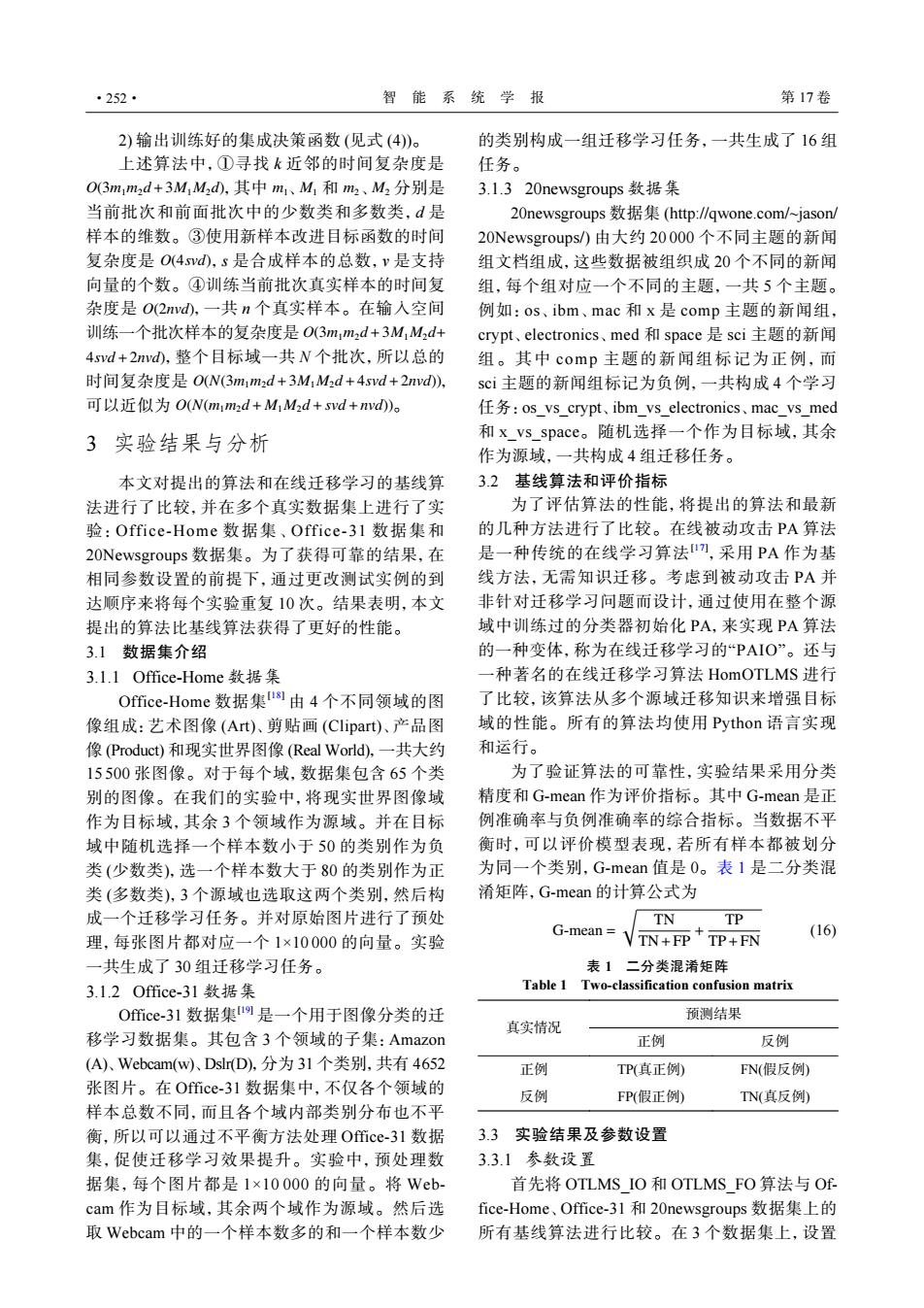

·252· 智能系统学报 第17卷 2)输出训练好的集成决策函数(见式(4))。 的类别构成一组迁移学习任务,一共生成了16组 上述算法中,①寻找k近邻的时间复杂度是 任务。 O(3m1m2d+3M1M2d,其中m1、M1和m2、M2分别是 3.1.320 newsgroups数据集 当前批次和前面批次中的少数类和多数类,d是 20 newsgroups数据集(http://qwone.com/~jason// 样本的维数。③使用新样本改进目标函数的时间 20 Newsgroups/)由大约20000个不同主题的新闻 复杂度是O(4svd),s是合成样本的总数,v是支持 组文档组成,这些数据被组织成20个不同的新闻 向量的个数。④训练当前批次真实样本的时间复 组,每个组对应一个不同的主题,一共5个主题。 杂度是O2vd,一共n个真实样本。在输入空间 例如:os、ibm、mac和x是comp主题的新闻组, 训练一个批次样本的复杂度是O(3m1m2d+3M1M2d+ cypt、electronics、med和space是sci主题的新闻 4svd+2vd),整个目标域一共N个批次,所以总的 组。其中comp主题的新闻组标记为正例,而 时间复杂度是ON(3m1m2d+3M1M2d+4svd+2nvd), sci主题的新闻组标记为负例,一共构成4个学习 可以近似为O(N(mm2d+M1M2d+svd+vd)g 任务:os_vs_crypt、.ibm_vs_electronics、mac_vs_med 3实验结果与分析 和x_vs_space。随机选择一个作为目标域,其余 作为源域,一共构成4组迁移任务。 本文对提出的算法和在线迁移学习的基线算 3.2基线算法和评价指标 法进行了比较,并在多个真实数据集上进行了实 为了评估算法的性能,将提出的算法和最新 验:Office-Home数据集、Office-31数据集和 的几种方法进行了比较。在线被动攻击PA算法 2 ONewsgroups数据集。为了获得可靠的结果,在 是一种传统的在线学习算法叨,采用PA作为基 相同参数设置的前提下,通过更改测试实例的到 线方法,无需知识迁移。考虑到被动攻击PA并 达顺序来将每个实验重复10次。结果表明,本文 非针对迁移学习问题而设计,通过使用在整个源 提出的算法比基线算法获得了更好的性能。 域中训练过的分类器初始化PA,来实现PA算法 3.1数据集介绍 的一种变体,称为在线迁移学习的“PAIO”。还与 3.1.1 Office-Home数据集 种著名的在线迁移学习算法HomOTLMS进行 Office-Home数据集81由4个不同领域的图 了比较,该算法从多个源域迁移知识来增强目标 像组成:艺术图像(Art)、剪贴画(Clipart)、产品图 域的性能。所有的算法均使用Python语言实现 像(Product)和现实世界图像(Real World),一共大约 和运行。 15500张图像。对于每个域,数据集包含65个类 为了验证算法的可靠性,实验结果采用分类 别的图像。在我们的实验中,将现实世界图像域 精度和G-mean作为评价指标。其中G-mean是正 作为目标域,其余3个领域作为源域。并在目标 例准确率与负例准确率的综合指标。当数据不平 域中随机选择一个样本数小于50的类别作为负 衡时,可以评价模型表现,若所有样本都被划分 类(少数类),选一个样本数大于80的类别作为正 为同一个类别,G-mean值是0。表1是二分类混 类(多数类),3个源域也选取这两个类别,然后构 淆矩阵,G-mean的计算公式为 成一个迁移学习任务。并对原始图片进行了预处 TN TP G-mean VTN+EP+TP+FN (16) 理,每张图片都对应一个1×10000的向量。实验 一共生成了30组迁移学习任务。 表1二分类混淆矩阵 3.1.2 Office-31数据集 Table 1 Two-classification confusion matrix Oice-31数据集u是一个用于图像分类的迁 预测结果 真实情况 移学习数据集。其包含3个领域的子集:Amazon 正例 反例 (A)、Webcam(w、Dslr(D),分为31个类别,共有4652 正例 TP(真正例) FN(假反例 张图片。在Office-31数据集中,不仅各个领域的 反例 FP(假正例) TN(真反例) 样本总数不同,而且各个域内部类别分布也不平 衡,所以可以通过不平衡方法处理Ofce-31数据 3.3 实验结果及参数设置 集,促使迁移学习效果提升。实验中,预处理数 3.3.1参数设置 据集,每个图片都是1×10000的向量。将Web- 首先将OTLMS IO和OTLMS FO算法与Of. cam作为目标域,其余两个域作为源域。然后选 fice-Home、Office-.31和20 newsgroups数据集上的 取Webcam中的一个样本数多的和一个样本数少 所有基线算法进行比较。在3个数据集上,设置2) 输出训练好的集成决策函数 (见式 (4))。 O(3m1m2d +3M1M2d) m1 M1 m2 M2 O(4svd) O(2nvd) O(3m1m2d +3M1M2d+ 4svd +2nvd) O(N(3m1m2d +3M1M2d +4svd +2nvd)) O(N(m1m2d + M1M2d + svd +nvd)) 上述算法中,①寻找 k 近邻的时间复杂度是 ,其中 、 和 、 分别是 当前批次和前面批次中的少数类和多数类,d 是 样本的维数。③使用新样本改进目标函数的时间 复杂度是 ,s 是合成样本的总数,v 是支持 向量的个数。④训练当前批次真实样本的时间复 杂度是 ,一共 n 个真实样本。在输入空间 训练一个批次样本的复杂度是 ,整个目标域一共 N 个批次,所以总的 时间复杂度是 , 可以近似为 。 3 实验结果与分析 本文对提出的算法和在线迁移学习的基线算 法进行了比较,并在多个真实数据集上进行了实 验 :Office-Home 数据集、Office-31 数据集和 20Newsgroups 数据集。为了获得可靠的结果,在 相同参数设置的前提下,通过更改测试实例的到 达顺序来将每个实验重复 10 次。结果表明,本文 提出的算法比基线算法获得了更好的性能。 3.1 数据集介绍 3.1.1 Office-Home 数据集 Office-Home 数据集[18] 由 4 个不同领域的图 像组成:艺术图像 (Art)、剪贴画 (Clipart)、产品图 像 (Product) 和现实世界图像 (Real World),一共大约 15 500 张图像。对于每个域,数据集包含 65 个类 别的图像。在我们的实验中,将现实世界图像域 作为目标域,其余 3 个领域作为源域。并在目标 域中随机选择一个样本数小于 50 的类别作为负 类 (少数类),选一个样本数大于 80 的类别作为正 类 (多数类),3 个源域也选取这两个类别,然后构 成一个迁移学习任务。并对原始图片进行了预处 理,每张图片都对应一个 1×10 000 的向量。实验 一共生成了 30 组迁移学习任务。 3.1.2 Office-31 数据集 Office-31 数据集[19] 是一个用于图像分类的迁 移学习数据集。其包含 3 个领域的子集:Amazon (A)、Webcam(w)、Dslr(D),分为 31 个类别,共有 4652 张图片。在 Office-31 数据集中,不仅各个领域的 样本总数不同,而且各个域内部类别分布也不平 衡,所以可以通过不平衡方法处理 Office-31 数据 集,促使迁移学习效果提升。实验中,预处理数 据集,每个图片都是 1×10 000 的向量。将 Webcam 作为目标域,其余两个域作为源域。然后选 取 Webcam 中的一个样本数多的和一个样本数少 的类别构成一组迁移学习任务,一共生成了 16 组 任务。 3.1.3 20newsgroups 数据集 20newsgroups 数据集 (http://qwone.com/~jason/ 20Newsgroups/) 由大约 20 000 个不同主题的新闻 组文档组成,这些数据被组织成 20 个不同的新闻 组,每个组对应一个不同的主题,一共 5 个主题。 例如:os、ibm、mac 和 x 是 comp 主题的新闻组, crypt、electronics、med 和 space 是 sci 主题的新闻 组。其中 comp 主题的新闻组标记为正例,而 sci 主题的新闻组标记为负例,一共构成 4 个学习 任务:os_vs_crypt、ibm_vs_electronics、mac_vs_med 和 x_vs_space。随机选择一个作为目标域,其余 作为源域,一共构成 4 组迁移任务。 3.2 基线算法和评价指标 为了评估算法的性能,将提出的算法和最新 的几种方法进行了比较。在线被动攻击 PA 算法 是一种传统的在线学习算法[17] ,采用 PA 作为基 线方法,无需知识迁移。考虑到被动攻击 PA 并 非针对迁移学习问题而设计,通过使用在整个源 域中训练过的分类器初始化 PA,来实现 PA 算法 的一种变体,称为在线迁移学习的“PAIO”。还与 一种著名的在线迁移学习算法 HomOTLMS 进行 了比较,该算法从多个源域迁移知识来增强目标 域的性能。所有的算法均使用 Python 语言实现 和运行。 为了验证算法的可靠性,实验结果采用分类 精度和 G-mean 作为评价指标。其中 G-mean 是正 例准确率与负例准确率的综合指标。当数据不平 衡时,可以评价模型表现,若所有样本都被划分 为同一个类别,G-mean 值是 0。表 1 是二分类混 淆矩阵,G-mean 的计算公式为 G-mean = √ TN TN+FP + TP TP+FN (16) 表 1 二分类混淆矩阵 Table 1 Two-classification confusion matrix 真实情况 预测结果 正例 反例 正例 TP(真正例) FN(假反例) 反例 FP(假正例) TN(真反例) 3.3 实验结果及参数设置 3.3.1 参数设置 首先将 OTLMS_IO 和 OTLMS_FO 算法与 Office-Home、Office-31 和 20newsgroups 数据集上的 所有基线算法进行比较。在 3 个数据集上,设置 ·252· 智 能 系 统 学 报 第 17 卷