正在加载图片...

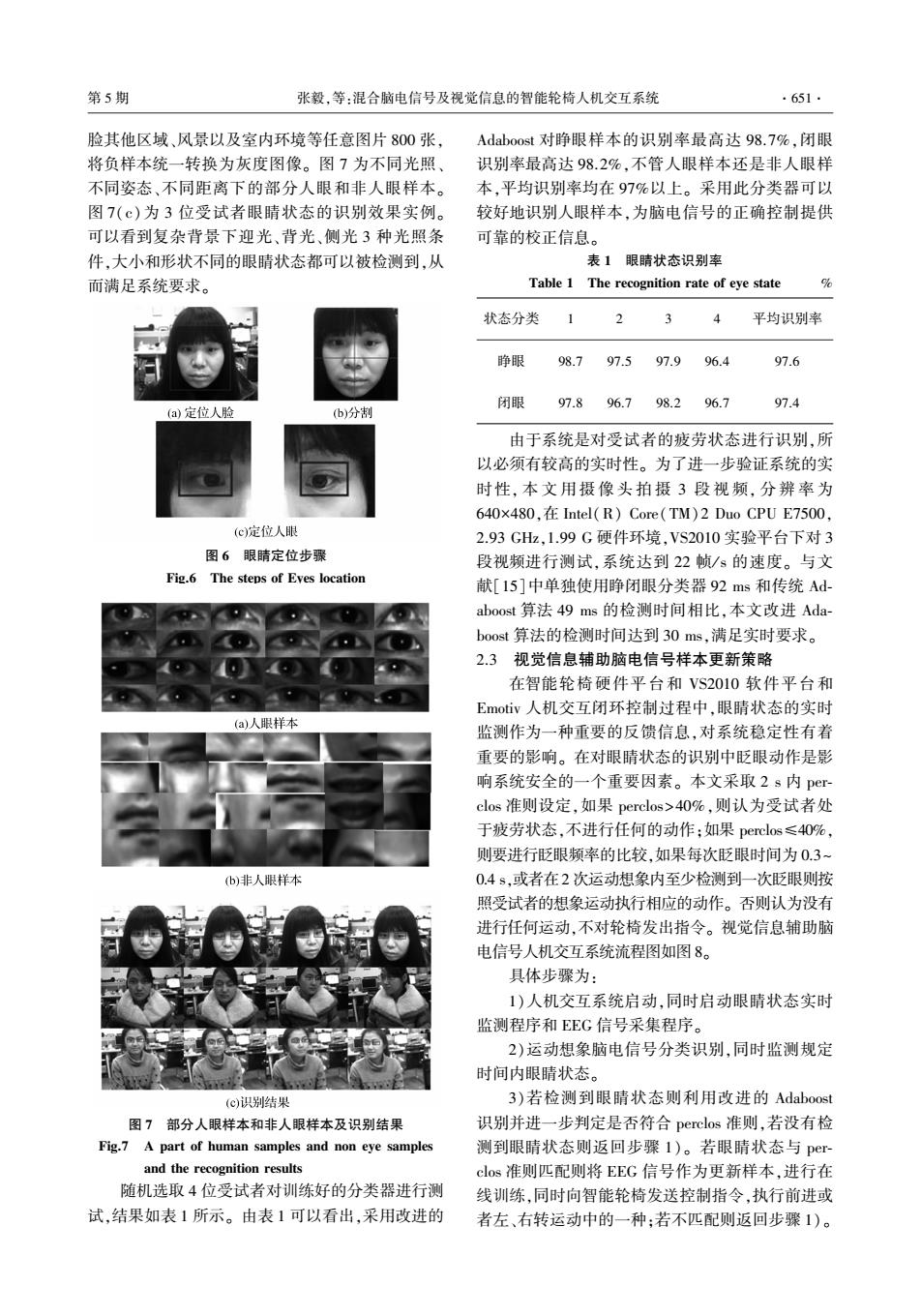

第5期 张毅,等:混合脑电信号及视觉信息的智能轮椅人机交互系统 .651· 脸其他区域、风景以及室内环境等任意图片800张, Adaboost对睁眼样本的识别率最高达98.7%,闭眼 将负样本统一转换为灰度图像。图7为不同光照、 识别率最高达98.2%,不管人眼样本还是非人眼样 不同姿态、不同距离下的部分人眼和非人眼样本。 本,平均识别率均在97%以上。采用此分类器可以 图7(©)为3位受试者眼晴状态的识别效果实例。 较好地识别人眼样本,为脑电信号的正确控制提供 可以看到复杂背景下迎光、背光、侧光3种光照条 可靠的校正信息。 件,大小和形状不同的眼晴状态都可以被检测到,从 表1眼睛状态识别率 而满足系统要求。 Table 1 The recognition rate of eye state % 状态分类 1 平均识别率 睁眼 98.7 97.5 97.9 96.4 97.6 闭眼 97.896.798.2 96.7 97.4 (a)定位人脸 b)分割 由于系统是对受试者的疲劳状态进行识别,所 以必须有较高的实时性。为了进一步验证系统的实 时性,本文用摄像头拍摄3段视频,分辨率为 640×480,在ntel(R)Core(TM)2 Duo CPU E7500, (c)定位人眼 2.93GHz,1.99G硬件环境,VS2010实验平台下对3 图6眼睛定位步骤 段视频进行测试,系统达到22帧/s的速度。与文 Fig.6 The steps of Eves location 献[15]中单独使用睁闭眼分类器92ms和传统Ad aboost算法49ms的检测时间相比,本文改进Ada- boost算法的检测时间达到30ms,满足实时要求。 23视觉信息辅助脑电信号样本更新策略 在智能轮椅硬件平台和VS2010软件平台和 Emotiv人机交互闭环控制过程中,眼睛状态的实时 (a)人眼样本 监测作为一种重要的反馈信息,对系统稳定性有着 重要的影响。在对眼睛状态的识别中眨眼动作是影 响系统安全的一个重要因素。本文采取2s内per clos准则设定,如果perclos:>40%,则认为受试者处 于疲劳状态,不进行任何的动作;如果perclos≤40% 则要进行眨眼频率的比较,如果每次眨眼时间为0.3~ b)非人眼样本 0.4s,或者在2次运动想象内至少检测到一次眨眼则按 照受试者的想象运动执行相应的动作。否则认为没有 进行任何运动,不对轮椅发出指令。视觉信息辅助脑 电信号人机交互系统流程图如图8。 具体步骤为: 1)人机交互系统启动,同时启动眼睛状态实时 监测程序和EEG信号采集程序。 2)运动想象脑电信号分类识别,同时监测规定 时间内眼睛状态。 (C)识别结果 3)若检测到眼睛状态则利用改进的Adaboost 图7部分人眼样本和非人眼样本及识别结果 识别并进一步判定是否符合perclos准则,若没有检 Fig.7 A part of human samples and non eye samples 测到眼晴状态则返回步骤1)。若眼晴状态与per and the recognition results clos准则匹配则将EEG信号作为更新样本,进行在 随机选取4位受试者对训练好的分类器进行测 线训练,同时向智能轮椅发送控制指令,执行前进或 试,结果如表1所示。由表1可以看出,采用改进的 者左、右转运动中的一种:若不匹配则返回步骤1)。脸其他区域、风景以及室内环境等任意图片 800 张, 将负样本统一转换为灰度图像。 图 7 为不同光照、 不同姿态、不同距离下的部分人眼和非人眼样本。 图 7(c)为 3 位受试者眼睛状态的识别效果实例。 可以看到复杂背景下迎光、背光、侧光 3 种光照条 件,大小和形状不同的眼睛状态都可以被检测到,从 而满足系统要求。 图 6 眼睛定位步骤 Fig.6 The steps of Eyes location 图 7 部分人眼样本和非人眼样本及识别结果 Fig.7 A part of human samples and non eye samples and the recognition results 随机选取 4 位受试者对训练好的分类器进行测 试,结果如表 1 所示。 由表 1 可以看出,采用改进的 Adaboost 对睁眼样本的识别率最高达 98.7%,闭眼 识别率最高达 98.2%,不管人眼样本还是非人眼样 本,平均识别率均在 97%以上。 采用此分类器可以 较好地识别人眼样本,为脑电信号的正确控制提供 可靠的校正信息。 表 1 眼睛状态识别率 Table 1 The recognition rate of eye state % 状态分类 1 2 3 4 平均识别率 睁眼 98.7 97.5 97.9 96.4 97.6 闭眼 97.8 96.7 98.2 96.7 97.4 由于系统是对受试者的疲劳状态进行识别,所 以必须有较高的实时性。 为了进一步验证系统的实 时性, 本 文 用 摄 像 头 拍 摄 3 段 视 频, 分 辨 率 为 640×480,在 Intel(R) Core(TM)2 Duo CPU E7500, 2.93 GHz,1.99 G 硬件环境,VS2010 实验平台下对 3 段视频进行测试,系统达到 22 帧/ s 的速度。 与文 献[15]中单独使用睁闭眼分类器 92 ms 和传统 Ad⁃ aboost 算法 49 ms 的检测时间相比,本文改进 Ada⁃ boost 算法的检测时间达到 30 ms,满足实时要求。 2.3 视觉信息辅助脑电信号样本更新策略 在智能轮椅硬件平台和 VS2010 软件平台和 Emotiv 人机交互闭环控制过程中,眼睛状态的实时 监测作为一种重要的反馈信息,对系统稳定性有着 重要的影响。 在对眼睛状态的识别中眨眼动作是影 响系统安全的一个重要因素。 本文采取 2 s 内 per⁃ clos 准则设定,如果 perclos>40%,则认为受试者处 于疲劳状态,不进行任何的动作;如果 perclos≤40%, 则要进行眨眼频率的比较,如果每次眨眼时间为 0.3~ 0.4 s,或者在2 次运动想象内至少检测到一次眨眼则按 照受试者的想象运动执行相应的动作。 否则认为没有 进行任何运动,不对轮椅发出指令。 视觉信息辅助脑 电信号人机交互系统流程图如图 8。 具体步骤为: 1)人机交互系统启动,同时启动眼睛状态实时 监测程序和 EEG 信号采集程序。 2)运动想象脑电信号分类识别,同时监测规定 时间内眼睛状态。 3)若检测到眼睛状态则利用改进的 Adaboost 识别并进一步判定是否符合 perclos 准则,若没有检 测到眼睛状态则返回步骤 1)。 若眼睛状态与 per⁃ clos 准则匹配则将 EEG 信号作为更新样本,进行在 线训练,同时向智能轮椅发送控制指令,执行前进或 者左、右转运动中的一种;若不匹配则返回步骤 1)。 第 5 期 张毅,等:混合脑电信号及视觉信息的智能轮椅人机交互系统 ·651·