正在加载图片...

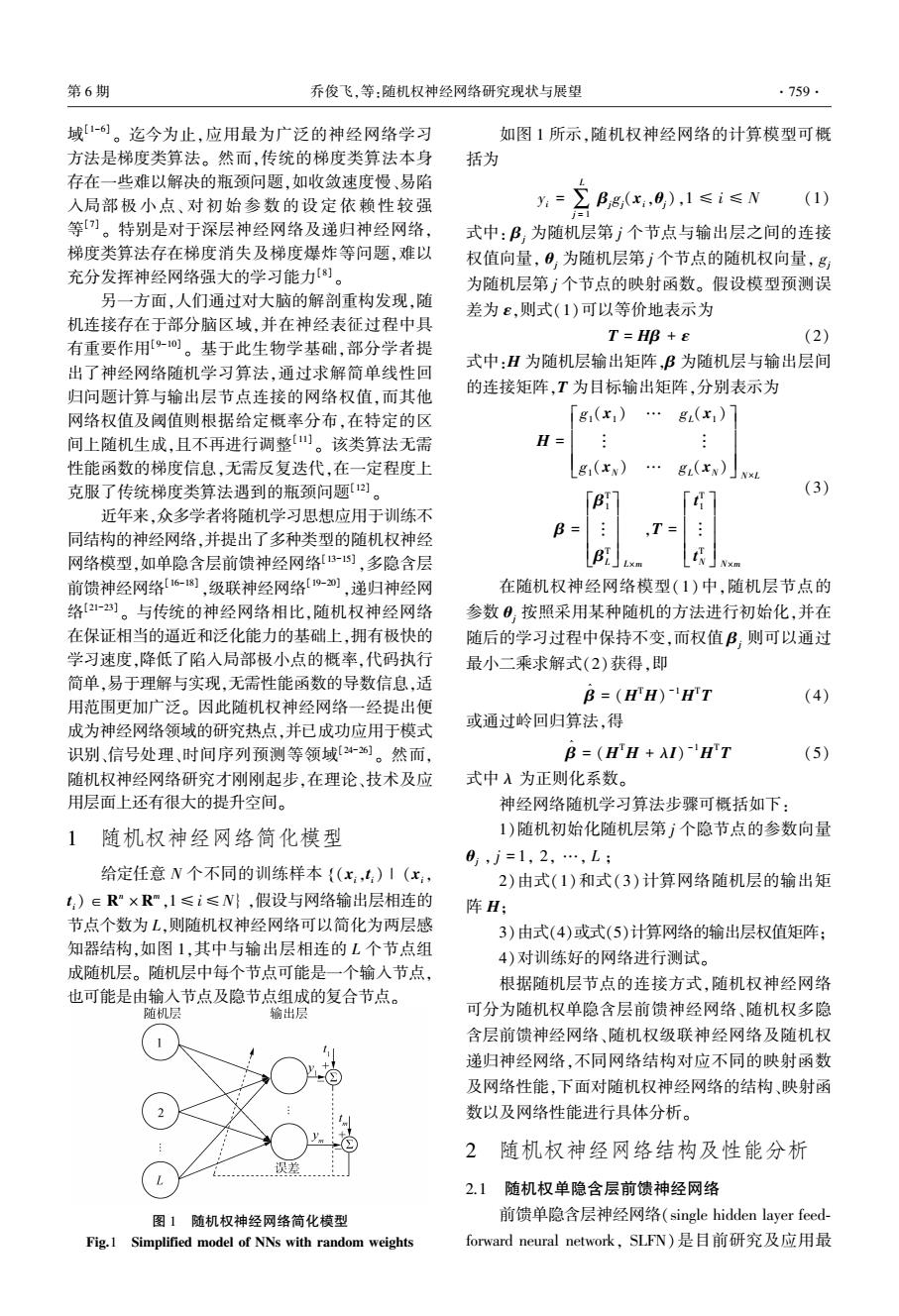

第6期 乔俊飞,等:随机权神经网络研究现状与展望 .759. 域1-。迄今为止,应用最为广泛的神经网络学习 如图1所示,随机权神经网络的计算模型可概 方法是梯度类算法。然而,传统的梯度类算法本身 括为 存在一些难以解决的瓶颈问题,如收敛速度慢、易陷 入局部极小点、对初始参数的设定依赖性较强 := ∑B,g(x,0,),1≤i≤N (1) 等[)。特别是对于深层神经网络及递归神经网络, 式中:B,为随机层第j个节点与输出层之间的连接 梯度类算法存在梯度消失及梯度爆炸等问题,难以 权值向量,0,为随机层第j个节点的随机权向量, 充分发挥神经网络强大的学习能力]。 为随机层第广个节点的映射函数。假设模型预测误 另一方面,人们通过对大脑的解剖重构发现,随 差为ε,则式(1)可以等价地表示为 机连接存在于部分脑区域,并在神经表征过程中具 有重要作用9-0]。基于此生物学基础,部分学者提 T=H邱+e (2) 式中:H为随机层输出矩阵,β为随机层与输出层间 出了神经网络随机学习算法,通过求解简单线性回 归问题计算与输出层节点连接的网络权值,而其他 的连接矩阵,T为目标输出矩阵,分别表示为 网络权值及阈值则根据给定概率分布,在特定的区 81(x1)…g(x1) 间上随机生成,且不再进行调整)。该类算法无需 H= 性能函数的梯度信息,无需反复迭代,在一定程度上 8(XN) g(xw)Jx 克服了传统梯度类算法遇到的瓶颈问题2]。 (3) 近年来,众多学者将随机学习思想应用于训练不 同结构的神经网络,并提出了多种类型的随机权神经 B 网络模型,如单隐含层前馈神经网络3-),多隐含层 B t Nxm 前馈神经网络16-1】,级联神经网络90),递归神经网 在随机权神经网络模型(1)中,随机层节点的 络[2-2)]。与传统的神经网络相比,随机权神经网络 参数0,按照采用某种随机的方法进行初始化,并在 在保证相当的逼近和泛化能力的基础上,拥有极快的 随后的学习过程中保持不变,而权值B:则可以通过 学习速度,降低了陷入局部极小点的概率,代码执行 最小二乘求解式(2)获得,即 简单,易于理解与实现,无需性能函数的导数信息,适 用范围更加广泛。因此随机权神经网络一经提出便 B=(HH)HT (4) 成为神经网络领域的研究热点,并已成功应用于模式 或通过岭回归算法,得 识别、信号处理、时间序列预测等领域24。然而, B=(HH+AIHT (5) 随机权神经网络研究才刚刚起步,在理论、技术及应 式中入为正则化系数。 用层面上还有很大的提升空间。 神经网络随机学习算法步骤可概括如下: 1 随机权神经网络简化模型 1)随机初始化随机层第广个隐节点的参数向量 0,j=1,2,…,L; 给定任意N个不同的训练样本{(x:,:)I(x, 2)由式(1)和式(3)计算网络随机层的输出矩 t:)∈R”×R,1≤i≤N},假设与网络输出层相连的 阵H; 节点个数为L,则随机权神经网络可以简化为两层感 3)由式(4)或式(5)计算网络的输出层权值矩阵: 知器结构,如图1,其中与输出层相连的L个节点组 4)对训练好的网络进行测试。 成随机层。随机层中每个节点可能是一个输入节点, 根据随机层节点的连接方式,随机权神经网络 也可能是由输入节点及隐节点组成的复合节点。 随机层 输出层 可分为随机权单隐含层前馈神经网络、随机权多隐 含层前馈神经网络、随机权级联神经网络及随机权 递归神经网络,不同网络结构对应不同的映射函数 及网络性能,下面对随机权神经网络的结构、映射函 数以及网络性能进行具体分析。 2随机权神经网络结构及性能分析 2.1随机权单隐含层前馈神经网络 图1随机权神经网络简化模型 前馈单隐含层神经网络(single hidden layer feed- Fig.1 Simplified model of NNs with random weights forward neural network,SLFN)是目前研究及应用最域[1-6] 。 迄今为止,应用最为广泛的神经网络学习 方法是梯度类算法。 然而,传统的梯度类算法本身 存在一些难以解决的瓶颈问题,如收敛速度慢、易陷 入局部 极 小 点、 对 初 始 参 数 的 设 定 依 赖 性 较 强 等[7] 。 特别是对于深层神经网络及递归神经网络, 梯度类算法存在梯度消失及梯度爆炸等问题,难以 充分发挥神经网络强大的学习能力[8] 。 另一方面,人们通过对大脑的解剖重构发现,随 机连接存在于部分脑区域,并在神经表征过程中具 有重要作用[9-10] 。 基于此生物学基础,部分学者提 出了神经网络随机学习算法,通过求解简单线性回 归问题计算与输出层节点连接的网络权值,而其他 网络权值及阈值则根据给定概率分布,在特定的区 间上随机生成,且不再进行调整[11] 。 该类算法无需 性能函数的梯度信息,无需反复迭代,在一定程度上 克服了传统梯度类算法遇到的瓶颈问题[12] 。 近年来,众多学者将随机学习思想应用于训练不 同结构的神经网络,并提出了多种类型的随机权神经 网络模型,如单隐含层前馈神经网络[13-15] ,多隐含层 前馈神经网络[16-18] ,级联神经网络[19-20] ,递归神经网 络[21-23] 。 与传统的神经网络相比,随机权神经网络 在保证相当的逼近和泛化能力的基础上,拥有极快的 学习速度,降低了陷入局部极小点的概率,代码执行 简单,易于理解与实现,无需性能函数的导数信息,适 用范围更加广泛。 因此随机权神经网络一经提出便 成为神经网络领域的研究热点,并已成功应用于模式 识别、信号处理、时间序列预测等领域[24-26] 。 然而, 随机权神经网络研究才刚刚起步,在理论、技术及应 用层面上还有很大的提升空间。 1 随机权神经网络简化模型 给定任意 N 个不同的训练样本 (xi { ,t i) | (xi, t i) ∈R n × R m ,1≤i≤N} ,假设与网络输出层相连的 节点个数为 L,则随机权神经网络可以简化为两层感 知器结构,如图 1,其中与输出层相连的 L 个节点组 成随机层。 随机层中每个节点可能是一个输入节点, 也可能是由输入节点及隐节点组成的复合节点。 图 1 随机权神经网络简化模型 Fig.1 Simplified model of NNs with random weights 如图 1 所示,随机权神经网络的计算模型可概 括为 yi = ∑ L j = 1 βjgj(xi,θj),1 ≤ i ≤ N (1) 式中: βj 为随机层第 j 个节点与输出层之间的连接 权值向量, θj 为随机层第 j 个节点的随机权向量, gj 为随机层第 j 个节点的映射函数。 假设模型预测误 差为 ε,则式(1)可以等价地表示为 T = Hβ + ε (2) 式中:H 为随机层输出矩阵,β 为随机层与输出层间 的连接矩阵,T 为目标输出矩阵,分别表示为 H = g1(x1 ) … gL(x1 ) ︙ ︙ g1(xN) … gL(xN) é ë ê ê ê ê ù û ú ú ú ú N×L β = β T 1 ︙ β T L é ë ê ê ê ê ù û ú ú ú ú L×m ,T = t T 1 ︙ t T N é ë ê ê ê ê ù û ú ú ú ú N×m (3) 在随机权神经网络模型(1)中,随机层节点的 参数 θj 按照采用某种随机的方法进行初始化,并在 随后的学习过程中保持不变,而权值 βj 则可以通过 最小二乘求解式(2)获得,即 β ^ = (H TH) -1H TT (4) 或通过岭回归算法,得 β ^ = (H TH + λI) -1H TT (5) 式中 λ 为正则化系数。 神经网络随机学习算法步骤可概括如下: 1)随机初始化随机层第 j 个隐节点的参数向量 θj , j = 1, 2, …, L ; 2)由式(1)和式(3)计算网络随机层的输出矩 阵 H; 3)由式(4)或式(5)计算网络的输出层权值矩阵; 4)对训练好的网络进行测试。 根据随机层节点的连接方式,随机权神经网络 可分为随机权单隐含层前馈神经网络、随机权多隐 含层前馈神经网络、随机权级联神经网络及随机权 递归神经网络,不同网络结构对应不同的映射函数 及网络性能,下面对随机权神经网络的结构、映射函 数以及网络性能进行具体分析。 2 随机权神经网络结构及性能分析 2.1 随机权单隐含层前馈神经网络 前馈单隐含层神经网络(single hidden layer feed⁃ forward neural network, SLFN)是目前研究及应用最 第 6 期 乔俊飞,等:随机权神经网络研究现状与展望 ·759·