正在加载图片...

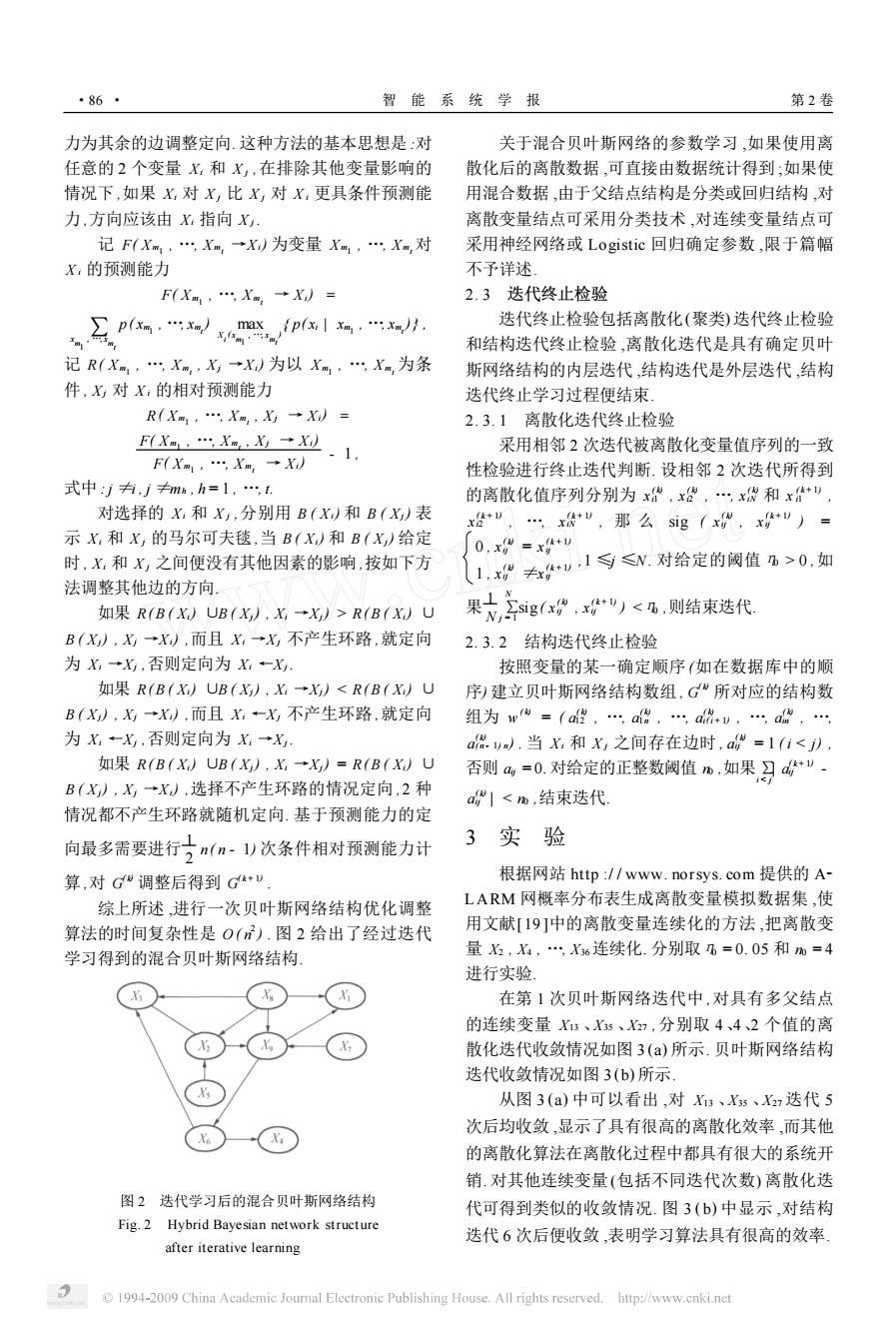

·86· 智能系统学报 第2卷 力为其余的边调整定向.这种方法的基本思想是:对 关于混合贝叶斯网络的参数学习,如果使用离 任意的2个变量X,和X,在排除其他变量影响的 散化后的离散数据,可直接由数据统计得到:如果使 情况下,如果X,对X,比X,对X,更具条件预测能 用混合数据,由于父结点结构是分类或回归结构,对 力,方向应该由X:指向X 离散变量结点可采用分类技术,对连续变量结点可 记F(Xm,Xm,→X)为变量Xm,…Xm,对 采用神经网络或Logistic回归确定参数,限于篇幅 X,的预测能力 不予详述 F(Xm1,Xm,→X)= 2.3迭代终止检验 p(mp 迭代终止检验包括离散化(聚类)迭代终止检验 和结构迭代终止检验,离散化迭代是具有确定贝叶 记R(Xm,,Xm,X→X)为以Xm,Xm,为条 斯网络结构的内层迭代,结构迭代是外层迭代,结构 件,X对X,的相对预测能力 迭代终止学习过程便结束」 R(Xm1,Xm,X→X= 2.3.1离散化迭代终止检验 FXm,,Xm,X→X 1 采用相邻2次迭代被离散化变量值序列的一致 F(Xm1,Xm,→X) 性检验进行终止迭代判断.设相邻2次迭代所得到 式中:j为,jmh,h=1,1 的离散化值序列分别为x,x,x很和x+” 对选择的X:和X,分别用B(X)和B(X)表 x",x*",那么sig(x,x")= 示X,和X的马尔可夫毯,当B(X)和B(X)给定 0,x=x号+v 时,X,和X,之间便没有其他因素的影响,按如下方 1”v1可≤N.对给定的阀值n>0,如 法调整其他边的方向. 如果R(B(X)UB(X),X→X)>R(B(X)U 果大,9g,)<则结束选代 B(X),X→X),而且X,→X不产生环路,就定向 2.3.2结构迭代终止检验 为X→X,否则定向为X,一X. 按照变量的某一确定顺序(如在数据库中的顺 如果R(B(X)UB(X),X:→X)<R(B(X)U 序)建立贝叶斯网络结构数组,G所对应的结构数 B(X),X→X),而且X,一X不产生环路,就定向 组为w=(a程,a州,aw,a,… 为X,一X,否则定向为X,→X a品y).当X和X)之间存在边时,a=1(i<), 如果R(B(X)UB(X),X,→X)=R(B(X)U 否则a叫=0.对给定的正整数阈值,如果习a+”- B(X),X→X),选择不产生环路的情况定向,2种 a1<m,结束迭代 情况都不产生环路就随机定向.基于预测能力的定 向最多需要进行】(m-)次条件相对预测能力计 3实验 算,对GW调整后得到G+v 根据网站http:/www.norsys.com提供的A- 综上所述,进行一次贝叶斯网络结构优化调整 LARM网概率分布表生成离散变量模拟数据集,使 算法的时间复杂性是O().图2给出了经过迭代 用文献[19]中的离散变量连续化的方法,把离散变 学习得到的混合贝叶斯网络结构 量X3,X4,X36连续化.分别取6=0.05和而=4 进行实验 在第1次贝叶斯网络迭代中,对具有多父结点 的连续变量X3、X5、X7,分别取4、4、2个值的离 散化迭代收敛情况如图3(a)所示.贝叶斯网络结构 迭代收敛情况如图3(b)所示。 从图3(a)中可以看出,对X、X5、X迭代5 次后均收敛,显示了具有很高的离散化效率,而其他 的离散化算法在离散化过程中都具有很大的系统开 销.对其他连续变量(包括不同迭代次数)离散化迭 图2迭代学习后的混合贝叶斯网络结构 代可得到类似的收敛情况.图3(b)中显示,对结构 Fig.2 Hybrid Bayesian network structure 迭代6次后便收敛,表明学习算法具有很高的效率」 after iterative learning 1994-2009 China Academic Journal Electronic Publishing House.All rights reserved.http://www.cnki.net力为其余的边调整定向. 这种方法的基本思想是 :对 任意的 2 个变量 Xi 和 X j ,在排除其他变量影响的 情况下 ,如果 Xi 对 X j 比 X j 对 X i 更具条件预测能 力 ,方向应该由 Xi 指向 X j . 记 F( X m1 , …, X mt →Xi) 为变量 X m1 , …, X mt 对 X i 的预测能力 F( X m1 , …, X mt → Xi) = xm ∑1 , …, xmt p ( xm1 , …, xmt ) max X i ( xm1 , …, xmt ) { p( xi | xm1 , …, xmt )} , 记 R ( X m1 , …, X mt , Xj →Xi) 为以 X m1 , …, X mt 为条 件 , Xj 对 X i 的相对预测能力 R ( X m1 , …, X mt , Xj → Xi) = F( X m1 , …, X mt , Xj → Xi) F( X m1 , …, X mt → Xi) - 1 , 式中 : j ≠i , j ≠mh , h = 1 , …, t. 对选择的 Xi 和 X j ,分别用 B ( Xi) 和 B ( Xj ) 表 示 Xi 和 X j 的马尔可夫毯 ,当 B ( Xi) 和 B ( Xj) 给定 时 , Xi 和 X j 之间便没有其他因素的影响 ,按如下方 法调整其他边的方向. 如果 R(B ( Xi) ∪B ( Xj) , Xi →Xj) > R(B ( Xi) ∪ B ( Xj) , Xj →Xi) ,而且 Xi →Xj 不产生环路 ,就定向 为 Xi →Xj ,否则定向为 Xi ←Xj . 如果 R(B ( Xi) ∪B ( Xj) , Xi →Xj) < R(B ( Xi) ∪ B ( Xj) , Xj →Xi) ,而且 Xi ←Xj 不产生环路 ,就定向 为 Xi ←Xj ,否则定向为 Xi →Xj . 如果 R(B ( Xi) ∪B ( Xj) , Xi →Xj) = R(B ( Xi) ∪ B ( Xj) , Xj →Xi) ,选择不产生环路的情况定向 , 2 种 情况都不产生环路就随机定向. 基于预测能力的定 向最多需要进行 1 2 n( n - 1) 次条件相对预测能力计 算 ,对 G ( k) 调整后得到 G ( k + 1) . 图 2 迭代学习后的混合贝叶斯网络结构 Fig. 2 Hybrid Bayesian network structure after iterative learning 综上所述 ,进行一次贝叶斯网络结构优化调整 算法的时间复杂性是 O ( n 2 ) . 图 2 给出了经过迭代 学习得到的混合贝叶斯网络结构. 关于混合贝叶斯网络的参数学习 ,如果使用离 散化后的离散数据 ,可直接由数据统计得到 ;如果使 用混合数据 ,由于父结点结构是分类或回归结构 ,对 离散变量结点可采用分类技术 ,对连续变量结点可 采用神经网络或 Logistic 回归确定参数 ,限于篇幅 不予详述. 2. 3 迭代终止检验 迭代终止检验包括离散化(聚类) 迭代终止检验 和结构迭代终止检验 ,离散化迭代是具有确定贝叶 斯网络结构的内层迭代 ,结构迭代是外层迭代 ,结构 迭代终止学习过程便结束. 2. 3. 1 离散化迭代终止检验 采用相邻 2 次迭代被离散化变量值序列的一致 性检验进行终止迭代判断. 设相邻 2 次迭代所得到 的离散化值序列分别为 x ( k) i1 , x ( k) i2 , …, x ( k) iN 和 x ( k + 1) i1 , x ( k + 1) i2 , …, x ( k + 1) iN , 那 么 sig ( x ( k) ij , x ( k + 1) ij ) = 0 , x ( k) ij = x ( k + 1) ij 1 , x ( k) ij ≠x ( k + 1) ij ,1 ≤j ≤N . 对给定的阈值η0 > 0 ,如 果 1 N ∑ N j = 1 sig ( x ( k) ij , x ( k + 1) ij ) <η0 ,则结束迭代. 2. 3. 2 结构迭代终止检验 按照变量的某一确定顺序 (如在数据库中的顺 序) 建立贝叶斯网络结构数组 , G ( k) 所对应的结构数 组为 w ( k) = ( a ( k) 12 , …, a ( k) 1 n , …, a ( k) i( i + 1) , …, a ( k) in , …, a ( k) ( n - 1) n ) . 当 Xi 和 X j 之间存在边时 , a ( k) ij = 1 ( i < j) , 否则 aij = 0. 对给定的正整数阈值 n0 ,如果 ∑i < j | a ( k + 1) ij - a ( k) ij | < n0 ,结束迭代. 3 实 验 根据网站 http :/ / www. norsys. com 提供的 A2 LARM 网概率分布表生成离散变量模拟数据集 ,使 用文献[ 19 ]中的离散变量连续化的方法 ,把离散变 量 X2 , X4 , …, X36连续化. 分别取η0 = 0. 05 和 n0 = 4 进行实验. 在第 1 次贝叶斯网络迭代中 ,对具有多父结点 的连续变量 X13 、X35 、X27 ,分别取 4、4、2 个值的离 散化迭代收敛情况如图 3 (a) 所示. 贝叶斯网络结构 迭代收敛情况如图 3 (b) 所示. 从图 3 (a) 中可以看出 ,对 X13 、X35 、X27 迭代 5 次后均收敛 ,显示了具有很高的离散化效率 ,而其他 的离散化算法在离散化过程中都具有很大的系统开 销. 对其他连续变量 (包括不同迭代次数) 离散化迭 代可得到类似的收敛情况. 图 3 ( b) 中显示 ,对结构 迭代 6 次后便收敛 ,表明学习算法具有很高的效率. ·86 · 智 能 系 统 学 报 第 2 卷