正在加载图片...

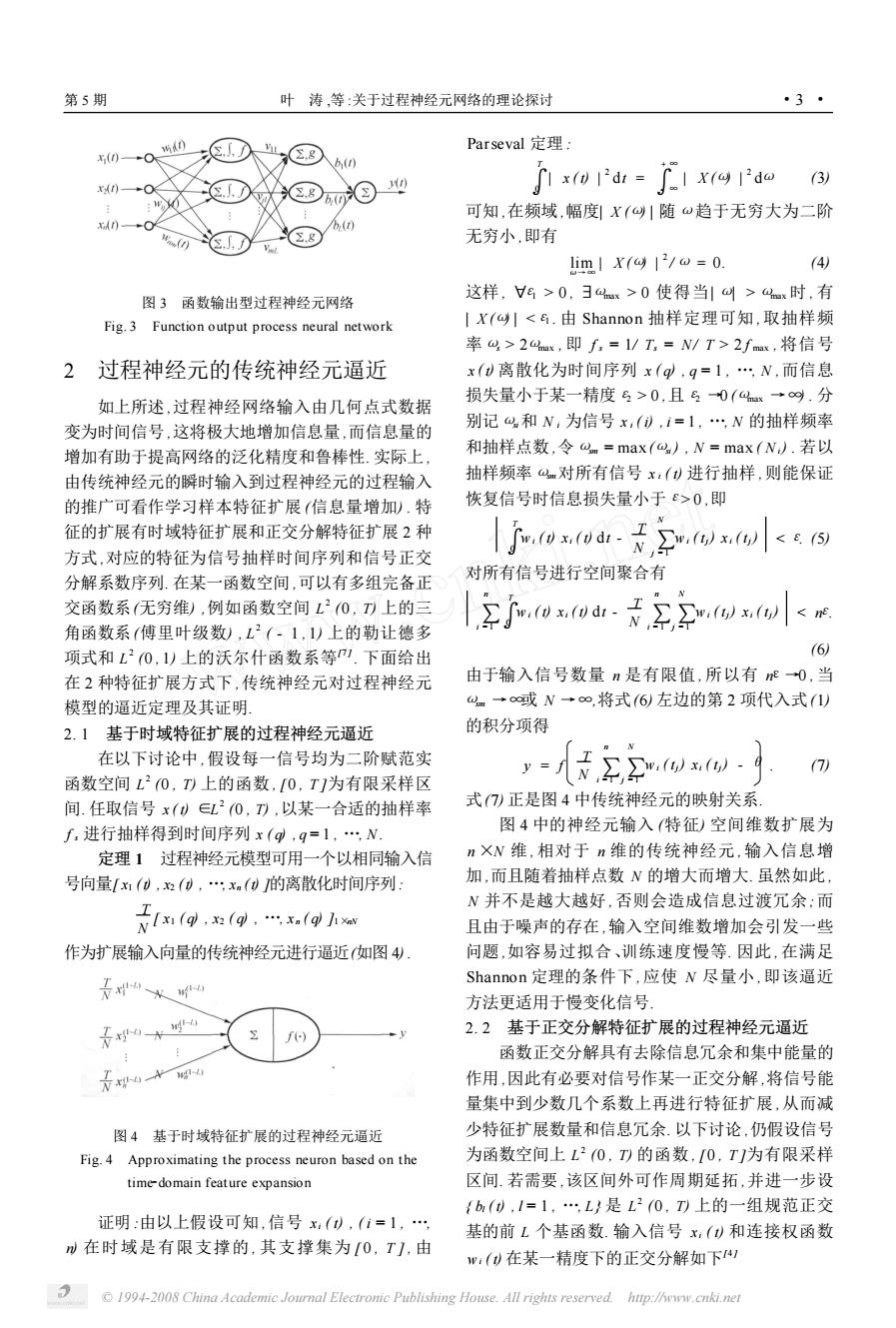

第5期 叶涛,等:关于过程神经元网络的理论探讨 3· Parseval定理: x() E.g b(n (3) xd)- ● Σ.g 可知,在频域,幅度!X(,川随ω趋于无穷大为二阶 b:(r) Σ.g 无穷小,即有 im|X(g12/w=0. (4) 图3函数输出型过程神经元网络 这样,9>0,34mx>0使得当|>4mx时,有 Fig.3 Function output process neural network |X(|<(.由Shannon抽样定理可知,取抽样频 率4>24x,即f,=1/T,=N/T>2fmx,将信号 2过程神经元的传统神经元逼近 x(离散化为时间序列x(,q=1,…N,而信息 如上所述,过程神经网络输入由几何点式数据 损失量小于某一精度6>0,且号0(4x一网.分 变为时间信号,这将极大地增加信息量,而信息量的 别记和N,为信号x,(),i=1,N的抽样频率 增加有助于提高网络的泛化精度和鲁棒性.实际上, 和抽样点数,令m=max(a),N=max(N).若以 由传统神经元的瞬时输入到过程神经元的过程输入 抽样频率m对所有信号x:()进行抽样,则能保证 的推广可看作学习样本特征扩展(信息量增加.特 恢复信号时信息损失量小于£>0,即 N 征的扩展有时域特征扩展和正交分解特征扩展2种 方式,对应的特征为信号抽样时间序列和信号正交 个0xwa支,2ww <£(5) 分解系数序列.在某一函数空间,可以有多组完备正 对所有信号进行空间聚合有 交函数系(无穷维),例如函数空间L20,)上的三 ∫,wxwd- 角函数系(傅里叶级数,L2(-1,1)上的勒让德多 项式和L20,1)上的沃尔什函数系等四.下面给出 (6) 在2种特征扩展方式下,传统神经元对过程神经元 由于输入信号数量n是有限值,所以有ne0,当 模型的逼近定理及其证明 m→或N∞,将式6)左边的第2项代入式(1) 2.1基于时域特征扩展的过程神经元逼近 的积分项得 在以下讨论中,假设每一信号均为二阶赋范实 函数空间L20,)上的函数,0,T1为有限采样区 =,,2wx 间.任取信号x()∈L20,),以某一合适的抽样率 式()正是图4中传统神经元的映射关系: f,进行抽样得到时间序列x(g,q=1,…N 图4中的神经元输入(特征)空间维数扩展为 定理1过程神经元模型可用一个以相同输入信 n×W维,相对于n维的传统神经元,输入信息增 号向量[x1(d,2(d,:xn(的离散化时间序列: 加,而且随着抽样点数N的增大而增大.虽然如此 N并不是越大越好,否则会造成信息过渡冗余:而 Ix(g.x(.x 且由于噪声的存在,输入空间维数增加会引发一些 作为扩展输入向量的传统神经元进行逼近(如图4) 问题,如容易过拟合、训练速度慢等.因此,在满足 Shannon定理的条件下,应使N尽量小,即该逼近 方法更适用于慢变化信号。 者水 2.2基于正交分解特征扩展的过程神经元逼近 e) 函数正交分解具有去除信息冗余和集中能量的 素@山 作用,因此有必要对信号作某一正交分解,将信号能 量集中到少数几个系数上再进行特征扩展,从而减 图4基于时域特征扩展的过程神经元逼近 少特征扩展数量和信息冗余.以下讨论,仍假设信号 Fig.4 Approximating the process neuron based on the 为函数空间上L20,T)的函数,[0,T]为有限采样 time-domain feature expansion 区间.若需要,该区间外可作周期延拓,并进一步设 {b(),I=1,…L}是L20,T)上的一组规范正交 证明:由以上假设可知,信号x),(i=1, 基的前L个基函数.输入信号x,()和连接权函数 m在时域是有限支撑的,其支撑集为[0,T],由 w:()在某一精度下的正交分解如下 1994-2008 China Academic Journal Electronic Publishing House.All rights reserved.htp://www.cnki.net图 3 函数输出型过程神经元网络 Fig. 3 Function output process neural network 2 过程神经元的传统神经元逼近 如上所述 ,过程神经网络输入由几何点式数据 变为时间信号 ,这将极大地增加信息量 ,而信息量的 增加有助于提高网络的泛化精度和鲁棒性. 实际上 , 由传统神经元的瞬时输入到过程神经元的过程输入 的推广可看作学习样本特征扩展 (信息量增加) . 特 征的扩展有时域特征扩展和正交分解特征扩展 2 种 方式 ,对应的特征为信号抽样时间序列和信号正交 分解系数序列. 在某一函数空间 ,可以有多组完备正 交函数系(无穷维) ,例如函数空间 L 2 (0 , T) 上的三 角函数系(傅里叶级数) , L 2 ( - 1 , 1) 上的勒让德多 项式和 L 2 (0 , 1) 上的沃尔什函数系等[7 ] . 下面给出 在 2 种特征扩展方式下 ,传统神经元对过程神经元 模型的逼近定理及其证明. 2. 1 基于时域特征扩展的过程神经元逼近 在以下讨论中 ,假设每一信号均为二阶赋范实 函数空间 L 2 (0 , T) 上的函数 , [0 , T ]为有限采样区 间. 任取信号 x ( t) ∈L 2 (0 , T) ,以某一合适的抽样率 f s 进行抽样得到时间序列 x ( q) , q = 1 , …, N . 定理 1 过程神经元模型可用一个以相同输入信 号向量[ x1 (t) , x2 (t) , …, xn (t) ]的离散化时间序列: T N [ x1 ( q) , x2 ( q) , …, x n ( q) ]1×nN 作为扩展输入向量的传统神经元进行逼近(如图 4) . 图 4 基于时域特征扩展的过程神经元逼近 Fig. 4 Approximating the process neuron based on the time2domain feature expansion 证明 :由以上假设可知 ,信号 xi ( t) , ( i = 1 , …, n) 在时域是有限支撑的 , 其支撑集为 [ 0 , T ] , 由 Parseval 定理 : ∫ T 0 | x ( t) | 2 dt =∫ + ∞ - ∞ | X (ω) | 2 dω (3) 可知 ,在频域 ,幅度| X (ω) | 随ω趋于无穷大为二阶 无穷小 ,即有 limω→∞ | X (ω) | 2 /ω = 0. (4) 这样 , Πε1 > 0 , ϖωmax > 0 使得当| ω| >ωmax 时 , 有 | X (ω) | <ε1 . 由 Shannon 抽样定理可知 ,取抽样频 率ωs > 2ωmax , 即 f s = 1/ Ts = N/ T > 2 f max , 将信号 x ( t) 离散化为时间序列 x ( q) , q = 1 , …, N ,而信息 损失量小于某一精度ε2 > 0 ,且ε2 →0 (ωmax →∞) . 分 别记ωsi和 N i 为信号 x i ( i) , i = 1 , …, N 的抽样频率 和抽样点数 ,令ωsm = max (ωsi ) , N = max ( Ni) . 若以 抽样频率ωsm对所有信号 x i ( t) 进行抽样 ,则能保证 恢复信号时信息损失量小于ε> 0 ,即 ∫ T 0 wi ( t) xi ( t) dt - T N ∑ N j = 1 wi ( tj) xi ( tj) <ε. (5) 对所有信号进行空间聚合有 ∑ n i = 1∫ T 0 wi ( t) xi ( t) dt - T N ∑ n i = 1 ∑ N j = 1 wi ( tj) xi ( tj) < nε. (6) 由于输入信号数量 n 是有限值 , 所以有 nε→0 , 当 ωsm →∞或 N →∞,将式(6) 左边的第 2 项代入式(1) 的积分项得 y = f T N ∑ n i = 1 ∑ N j = 1 wi ( tj) xi ( tj) - θ . (7) 式(7) 正是图 4 中传统神经元的映射关系. 图 4 中的神经元输入 (特征) 空间维数扩展为 n ×N 维 , 相对于 n 维的传统神经元 , 输入信息增 加 ,而且随着抽样点数 N 的增大而增大. 虽然如此 , N 并不是越大越好 ,否则会造成信息过渡冗余;而 且由于噪声的存在 ,输入空间维数增加会引发一些 问题 ,如容易过拟合、训练速度慢等. 因此 , 在满足 Shannon 定理的条件下 ,应使 N 尽量小 ,即该逼近 方法更适用于慢变化信号. 2. 2 基于正交分解特征扩展的过程神经元逼近 函数正交分解具有去除信息冗余和集中能量的 作用 ,因此有必要对信号作某一正交分解 ,将信号能 量集中到少数几个系数上再进行特征扩展 ,从而减 少特征扩展数量和信息冗余. 以下讨论 ,仍假设信号 为函数空间上 L 2 (0 , T) 的函数 , [ 0 , T ]为有限采样 区间. 若需要 ,该区间外可作周期延拓 ,并进一步设 { bl ( t) , l = 1 , …, L } 是 L 2 (0 , T) 上的一组规范正交 基的前 L 个基函数. 输入信号 xi ( t) 和连接权函数 wi ( t) 在某一精度下的正交分解如下[4 ] 第 5 期 叶 涛 ,等 :关于过程神经元网络的理论探讨 ·3 · © 1994-2008 China Academic Journal Electronic Publishing House. All rights reserved. http://www.cnki.net