正在加载图片...

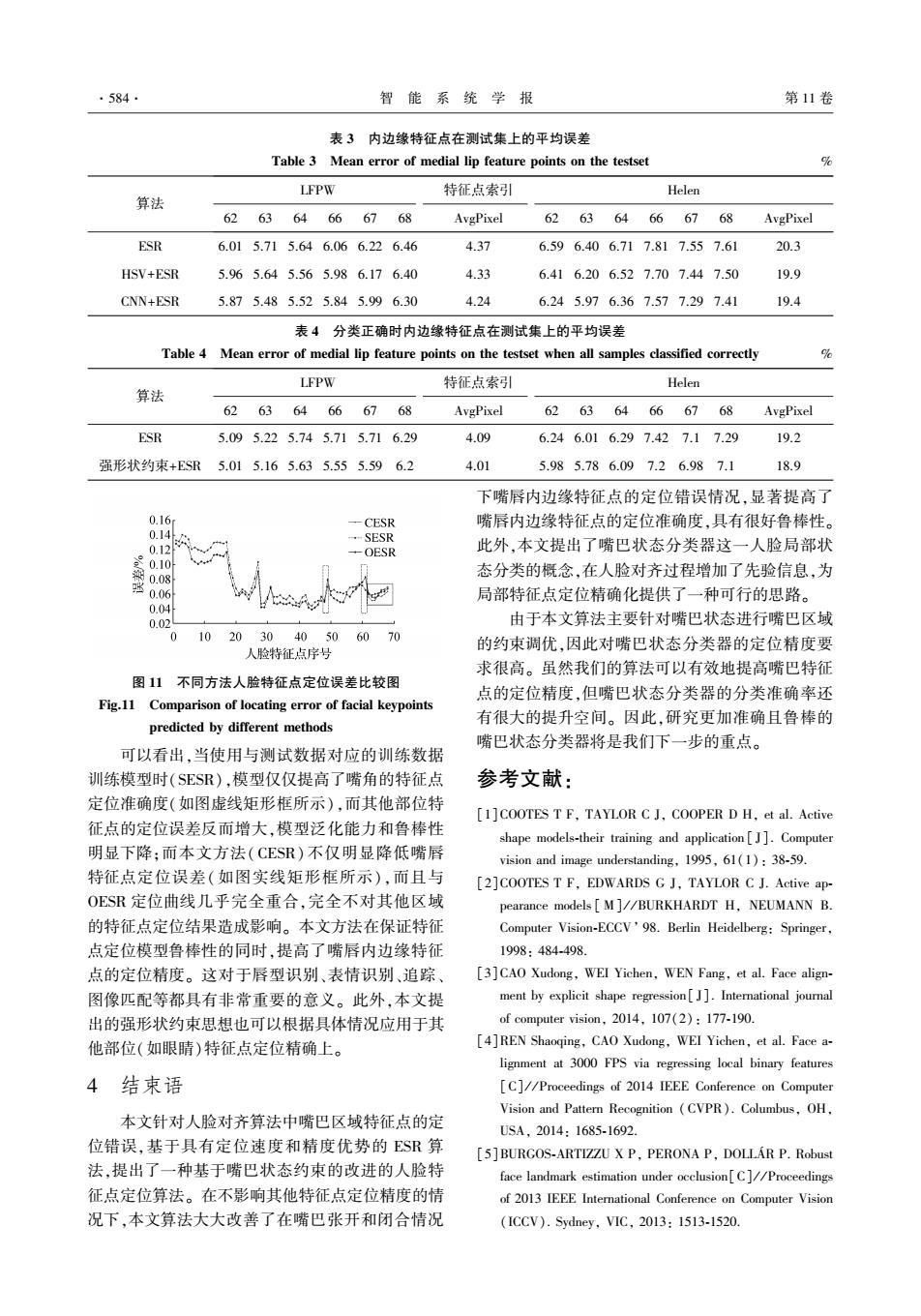

·584· 智能系统学报 第11卷 表3内边缘特征点在测试集上的平均误差 Table 3 Mean error of medial lip feature points on the testset % LFPW 特征点索引 Helen 算法 6263 64 66 67 68 AvgPixel 62 63 64 66 67 68 AvgPixel ESR 6.015.715.646.066.226.46 4.37 6.596.406.717.817.557.61 20.3 HSV+ESR 5.965.645.565.986.176.40 4.33 6.416.206.527.707.447.50 19.9 CNN+ESR 5.875.485.525.845.996.30 4.24 6.245.976.367.577.297.41 19.4 表4分类正确时内边缘特征点在测试集上的平均误差 Table 4 Mean error of medial lip feature points on the testset when all samples classified correctly % LFPW 特征点索引 Helen 算法 62636466 6768 AvgPixel 626364 666768 AvgPixel ESR 5.095.225.745.715.716.29 4.09 6.246.016.297.427.17.29 19.2 强形状约束+ESR5.015.165.635.555.596.2 4.01 5.985.786.097.26.987.1 18.9 下嘴唇内边缘特征点的定位错误情况,显著提高了 0.16r —CESR 嘴唇内边缘特征点的定位准确度,具有很好鲁棒性。 0.14 --SESR 0.12 --OESR 此外,本文提出了嘴巴状态分类器这一人脸局部状 0.10 0.08 态分类的概念,在人脸对齐过程增加了先验信息,为 0.06 局部特征点定位精确化提供了一种可行的思路。 0.04 0.02 由于本文算法主要针对嘴巴状态进行嘴巴区域 0 10 203040506070 的约束调优,因此对嘴巴状态分类器的定位精度要 人脸特征,点序号 求很高。虽然我们的算法可以有效地提高嘴巴特征 图11不同方法人脸特征点定位误差比较图 点的定位精度,但嘴巴状态分类器的分类准确率还 Fig.11 Comparison of locating error of facial keypoints predicted by different methods 有很大的提升空间。因此,研究更加准确且鲁棒的 嘴巴状态分类器将是我们下一步的重点。 可以看出,当使用与测试数据对应的训练数据 训练模型时(SE$R),模型仅仅提高了嘴角的特征点 参考文献: 定位准确度(如图虚线矩形框所示),而其他部位特 [1]COOTES T F,TAYLOR C J,COOPER D H,et al.Active 征点的定位误差反而增大,模型泛化能力和鲁棒性 shape models-their training and application[J].Computer 明显下降:而本文方法(CESR)不仅明显降低嘴唇 vision and image understanding,1995,61(1):38-59. 特征点定位误差(如图实线矩形框所示),而且与 [2]COOTES T F,EDWARDS G J,TAYLOR C J.Active ap- OESR定位曲线几乎完全重合,完全不对其他区域 pearance models M]//BURKHARDT H,NEUMANN B. 的特征点定位结果造成影响。本文方法在保证特征 Computer Vision-ECCV'98.Berlin Heidelberg:Springer, 点定位模型鲁棒性的同时,提高了嘴唇内边缘特征 1998:484-498 点的定位精度。这对于唇型识别、表情识别、追踪、 [3]CAO Xudong,WEI Yichen,WEN Fang,et al.Face align- 图像匹配等都具有非常重要的意义。此外,本文提 ment by explicit shape regression[].International journal 出的强形状约束思想也可以根据具体情况应用于其 of computer vision,2014,107(2):177-190. 他部位(如眼晴)特征点定位精确上。 [4]REN Shaoqing,CAO Xudong,WEI Yichen,et al.Face a- lignment at 3000 FPS via regressing local binary features 4结束语 [C]//Proceedings of 2014 IEEE Conference on Computer Vision and Pattern Recognition (CVPR).Columbus,OH. 本文针对人脸对齐算法中嘴巴区域特征点的定 USA,2014:1685-1692. 位错误,基于具有定位速度和精度优势的ESR算 [5]BURGOS-ARTIZZU X P,PERONA P,DOLLAR P.Robust 法,提出了一种基于嘴巴状态约束的改进的人脸特 face landmark estimation under occlusion[C]//Proceedings 征点定位算法。在不影响其他特征点定位精度的情 of 2013 IEEE International Conference on Computer Vision 况下,本文算法大大改善了在嘴巴张开和闭合情况 (ICCV).Sydney,VIC,2013:1513-1520.表 3 内边缘特征点在测试集上的平均误差 Table 3 Mean error of medial lip feature points on the testset % 算法 LFPW 特征点索引 Helen 62 63 64 66 67 68 AvgPixel 62 63 64 66 67 68 AvgPixel ESR 6.01 5.71 5.64 6.06 6.22 6.46 4.37 6.59 6.40 6.71 7.81 7.55 7.61 20.3 HSV+ESR 5.96 5.64 5.56 5.98 6.17 6.40 4.33 6.41 6.20 6.52 7.70 7.44 7.50 19.9 CNN+ESR 5.87 5.48 5.52 5.84 5.99 6.30 4.24 6.24 5.97 6.36 7.57 7.29 7.41 19.4 表 4 分类正确时内边缘特征点在测试集上的平均误差 Table 4 Mean error of medial lip feature points on the testset when all samples classified correctly % 算法 LFPW 特征点索引 Helen 62 63 64 66 67 68 AvgPixel 62 63 64 66 67 68 AvgPixel ESR 5.09 5.22 5.74 5.71 5.71 6.29 4.09 6.24 6.01 6.29 7.42 7.1 7.29 19.2 强形状约束+ESR 5.01 5.16 5.63 5.55 5.59 6.2 4.01 5.98 5.78 6.09 7.2 6.98 7.1 18.9 图 11 不同方法人脸特征点定位误差比较图 Fig.11 Comparison of locating error of facial keypoints predicted by different methods 可以看出,当使用与测试数据对应的训练数据 训练模型时(SESR),模型仅仅提高了嘴角的特征点 定位准确度(如图虚线矩形框所示),而其他部位特 征点的定位误差反而增大,模型泛化能力和鲁棒性 明显下降;而本文方法(CESR) 不仅明显降低嘴唇 特征点定位误差(如图实线矩形框所示),而且与 OESR 定位曲线几乎完全重合,完全不对其他区域 的特征点定位结果造成影响。 本文方法在保证特征 点定位模型鲁棒性的同时,提高了嘴唇内边缘特征 点的定位精度。 这对于唇型识别、表情识别、追踪、 图像匹配等都具有非常重要的意义。 此外,本文提 出的强形状约束思想也可以根据具体情况应用于其 他部位(如眼睛)特征点定位精确上。 4 结束语 本文针对人脸对齐算法中嘴巴区域特征点的定 位错误,基于具有定位速度和精度优势的 ESR 算 法,提出了一种基于嘴巴状态约束的改进的人脸特 征点定位算法。 在不影响其他特征点定位精度的情 况下,本文算法大大改善了在嘴巴张开和闭合情况 下嘴唇内边缘特征点的定位错误情况,显著提高了 嘴唇内边缘特征点的定位准确度,具有很好鲁棒性。 此外,本文提出了嘴巴状态分类器这一人脸局部状 态分类的概念,在人脸对齐过程增加了先验信息,为 局部特征点定位精确化提供了一种可行的思路。 由于本文算法主要针对嘴巴状态进行嘴巴区域 的约束调优,因此对嘴巴状态分类器的定位精度要 求很高。 虽然我们的算法可以有效地提高嘴巴特征 点的定位精度,但嘴巴状态分类器的分类准确率还 有很大的提升空间。 因此,研究更加准确且鲁棒的 嘴巴状态分类器将是我们下一步的重点。 参考文献: [1]COOTES T F, TAYLOR C J, COOPER D H, et al. Active shape models⁃their training and application [ J]. Computer vision and image understanding, 1995, 61(1): 38⁃59. [2]COOTES T F, EDWARDS G J, TAYLOR C J. Active ap⁃ pearance models [ M] / / BURKHARDT H, NEUMANN B. Computer Vision⁃ECCV’ 98. Berlin Heidelberg: Springer, 1998: 484⁃498. [3]CAO Xudong, WEI Yichen, WEN Fang, et al. Face align⁃ ment by explicit shape regression[ J]. International journal of computer vision, 2014, 107(2): 177⁃190. [4]REN Shaoqing, CAO Xudong, WEI Yichen, et al. Face a⁃ lignment at 3000 FPS via regressing local binary features [C] / / Proceedings of 2014 IEEE Conference on Computer Vision and Pattern Recognition (CVPR). Columbus, OH, USA, 2014: 1685⁃1692. [5]BURGOS⁃ARTIZZU X P, PERONA P, DOLLÁR P. Robust face landmark estimation under occlusion[C] / / Proceedings of 2013 IEEE International Conference on Computer Vision (ICCV). Sydney, VIC, 2013: 1513⁃1520. ·584· 智 能 系 统 学 报 第 11 卷