正在加载图片...

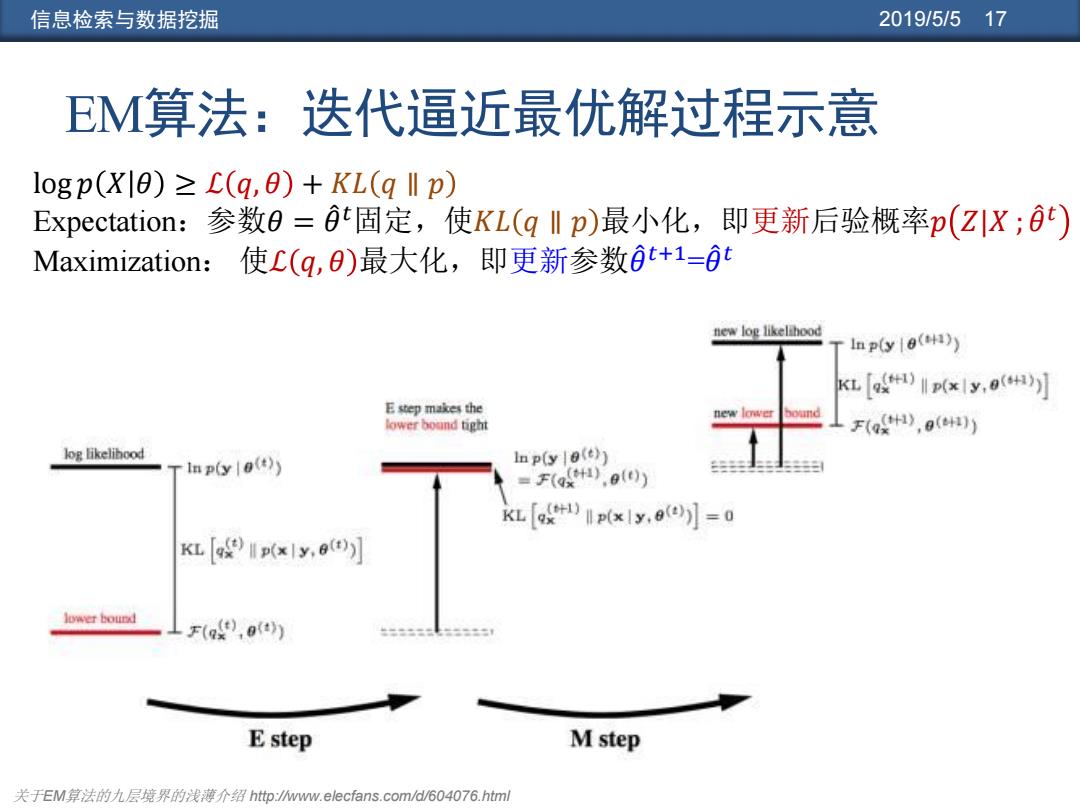

信息检索与数据挖掘 2019/5/517 EM算法:迭代逼近最优解过程示意 logp(Xl0)=L(q,0)+KL(q ll p) Expectation:参数0=t固定,使KL(q‖p)最小化,即更新后验概率p(ZIX;) Maximization:使C(g,0)最大化,即更新参数t+1=0t new log likelihood Inp(y8(1)) KL )(xy()) E step makes the new lower bound lower bound tight F(Q),0()) log likelihood In p(ye(t)) Inp(y (t)) (f).o(t)) KL [K)p(x1y.0())]=0 KL [)p(xy() ow台bound LF(),()) “=5三15 E step M step 关于EM算法的九层境界的浅薄介绍http://www.elecfans.com/d/604076.html信息检索与数据挖掘 2019/5/5 17 EM算法:迭代逼近最优解过程示意 log 𝑝 𝑋 𝜃 ≥ ℒ 𝑞, 𝜃 + 𝐾𝐿 𝑞 ∥ 𝑝 Expectation:参数𝜃 = 𝜃መ 𝑡固定,使𝐾𝐿 𝑞 ∥ 𝑝 最小化,即更新后验概率𝑝 𝑍|𝑋 ; 𝜃መ 𝑡 Maximization: 使ℒ 𝑞, 𝜃 最大化,即更新参数𝜃መ 𝑡+1=𝜃መ 𝑡 关于EM算法的九层境界的浅薄介绍 http://www.elecfans.com/d/604076.html