正在加载图片...

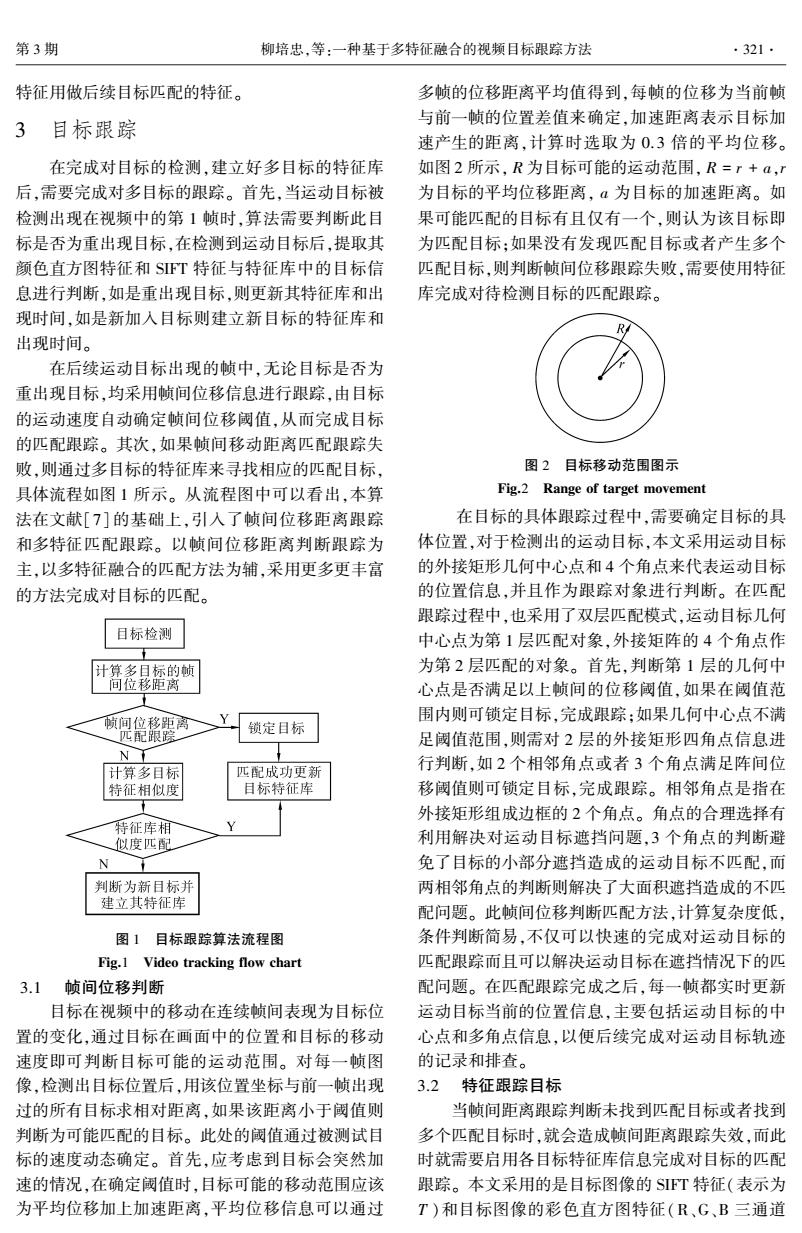

第3期 柳培忠,等:一种基于多特征融合的视频目标跟踪方法 ·321· 特征用做后续目标匹配的特征。 多帧的位移距离平均值得到,每帧的位移为当前帧 3目标跟踪 与前一帧的位置差值来确定,加速距离表示目标加 速产生的距离,计算时选取为0.3倍的平均位移。 在完成对目标的检测,建立好多目标的特征库 如图2所示,R为目标可能的运动范围,R=r+a,r 后,需要完成对多目标的跟踪。首先,当运动目标被 为目标的平均位移距离,α为目标的加速距离。如 检测出现在视频中的第1帧时,算法需要判断此目 果可能匹配的目标有且仅有一个,则认为该目标即 标是否为重出现目标,在检测到运动目标后,提取其 为匹配目标:如果没有发现匹配目标或者产生多个 颜色直方图特征和SFT特征与特征库中的目标信 匹配目标,则判断帧间位移跟踪失败,需要使用特征 息进行判断,如是重出现目标,则更新其特征库和出 库完成对待检测目标的匹配跟踪。 现时间,如是新加入目标则建立新目标的特征库和 出现时间。 在后续运动目标出现的帧中,无论目标是否为 重出现目标,均采用帧间位移信息进行跟踪,由目标 的运动速度自动确定帧间位移阈值,从而完成目标 的匹配跟踪。其次,如果帧间移动距离匹配跟踪失 败,则通过多目标的特征库来寻找相应的匹配目标, 图2目标移动范围图示 具体流程如图1所示。从流程图中可以看出,本算 Fig.2 Range of target movement 法在文献[7]的基础上,引入了帧间位移距离跟踪 在目标的具体跟踪过程中,需要确定目标的具 和多特征匹配跟踪。以帧间位移距离判断跟踪为 体位置,对于检测出的运动目标,本文采用运动目标 主,以多特征融合的匹配方法为辅,采用更多更丰富 的外接矩形几何中心点和4个角点来代表运动目标 的方法完成对目标的匹配。 的位置信息,并且作为跟踪对象进行判断。在匹配 跟踪过程中,也采用了双层匹配模式,运动目标几何 日标检测 中心点为第1层匹配对象,外接矩阵的4个角点作 计算多目标的帧 为第2层匹配的对象。首先,判断第1层的几何中 间位移距离 心点是否满足以上帧间的位移阈值,如果在阈值范 顾间位移距离 Y 围内则可锁定目标,完成跟踪:如果几何中心点不满 匹配跟踪 锁定目标 足阈值范围,则需对2层的外接矩形四角点信息进 NT 计算多目标 匹配成功更新 行判断,如2个相邻角点或者3个角点满足阵间位 特征相似度 目标特征库 移阈值则可锁定目标,完成跟踪。相邻角点是指在 外接矩形组成边框的2个角点。角点的合理选择有 特征库相 似度匹配 利用解决对运动目标遮挡问题,3个角点的判断避 N 免了目标的小部分遮挡造成的运动目标不匹配,而 判断为新目标并 两相邻角点的判断则解决了大面积遮挡造成的不匹 建立其特征库 配问题。此帧间位移判断匹配方法,计算复杂度低, 图1目标跟踪算法流程图 条件判断简易,不仅可以快速的完成对运动目标的 Fig.1 Video tracking flow chart 匹配跟踪而且可以解决运动目标在遮挡情况下的匹 3.1帧间位移判断 配问题。在匹配跟踪完成之后,每一帧都实时更新 目标在视频中的移动在连续帧间表现为目标位 运动目标当前的位置信息,主要包括运动目标的中 置的变化,通过目标在画面中的位置和目标的移动 心点和多角点信息,以便后续完成对运动目标轨迹 速度即可判断目标可能的运动范围。对每一帧图 的记录和排查。 像,检测出目标位置后,用该位置坐标与前一帧出现3.2特征跟踪目标 过的所有目标求相对距离,如果该距离小于阈值则 当帧间距离跟踪判断未找到匹配目标或者找到 判断为可能匹配的目标。此处的阈值通过被测试目 多个匹配目标时,就会造成帧间距离跟踪失效,而此 标的速度动态确定。首先,应考虑到目标会突然加 时就需要启用各目标特征库信息完成对目标的匹配 速的情况,在确定阈值时,目标可能的移动范围应该 跟踪。本文采用的是目标图像的SFT特征(表示为 为平均位移加上加速距离,平均位移信息可以通过 T)和目标图像的彩色直方图特征(R、G、B三通道特征用做后续目标匹配的特征。 3 目标跟踪 在完成对目标的检测,建立好多目标的特征库 后,需要完成对多目标的跟踪。 首先,当运动目标被 检测出现在视频中的第 1 帧时,算法需要判断此目 标是否为重出现目标,在检测到运动目标后,提取其 颜色直方图特征和 SIFT 特征与特征库中的目标信 息进行判断,如是重出现目标,则更新其特征库和出 现时间,如是新加入目标则建立新目标的特征库和 出现时间。 在后续运动目标出现的帧中,无论目标是否为 重出现目标,均采用帧间位移信息进行跟踪,由目标 的运动速度自动确定帧间位移阈值,从而完成目标 的匹配跟踪。 其次,如果帧间移动距离匹配跟踪失 败,则通过多目标的特征库来寻找相应的匹配目标, 具体流程如图 1 所示。 从流程图中可以看出,本算 法在文献[7]的基础上,引入了帧间位移距离跟踪 和多特征匹配跟踪。 以帧间位移距离判断跟踪为 主,以多特征融合的匹配方法为辅,采用更多更丰富 的方法完成对目标的匹配。 图 1 目标跟踪算法流程图 Fig.1 Video tracking flow chart 3.1 帧间位移判断 目标在视频中的移动在连续帧间表现为目标位 置的变化,通过目标在画面中的位置和目标的移动 速度即可判断目标可能的运动范围。 对每一帧图 像,检测出目标位置后,用该位置坐标与前一帧出现 过的所有目标求相对距离,如果该距离小于阈值则 判断为可能匹配的目标。 此处的阈值通过被测试目 标的速度动态确定。 首先,应考虑到目标会突然加 速的情况,在确定阈值时,目标可能的移动范围应该 为平均位移加上加速距离,平均位移信息可以通过 多帧的位移距离平均值得到,每帧的位移为当前帧 与前一帧的位置差值来确定,加速距离表示目标加 速产生的距离,计算时选取为 0. 3 倍的平均位移。 如图 2 所示, R 为目标可能的运动范围, R = r + a,r 为目标的平均位移距离, a 为目标的加速距离。 如 果可能匹配的目标有且仅有一个,则认为该目标即 为匹配目标;如果没有发现匹配目标或者产生多个 匹配目标,则判断帧间位移跟踪失败,需要使用特征 库完成对待检测目标的匹配跟踪。 图 2 目标移动范围图示 Fig.2 Range of target movement 在目标的具体跟踪过程中,需要确定目标的具 体位置,对于检测出的运动目标,本文采用运动目标 的外接矩形几何中心点和 4 个角点来代表运动目标 的位置信息,并且作为跟踪对象进行判断。 在匹配 跟踪过程中,也采用了双层匹配模式,运动目标几何 中心点为第 1 层匹配对象,外接矩阵的 4 个角点作 为第 2 层匹配的对象。 首先,判断第 1 层的几何中 心点是否满足以上帧间的位移阈值,如果在阈值范 围内则可锁定目标,完成跟踪;如果几何中心点不满 足阈值范围,则需对 2 层的外接矩形四角点信息进 行判断,如 2 个相邻角点或者 3 个角点满足阵间位 移阈值则可锁定目标,完成跟踪。 相邻角点是指在 外接矩形组成边框的 2 个角点。 角点的合理选择有 利用解决对运动目标遮挡问题,3 个角点的判断避 免了目标的小部分遮挡造成的运动目标不匹配,而 两相邻角点的判断则解决了大面积遮挡造成的不匹 配问题。 此帧间位移判断匹配方法,计算复杂度低, 条件判断简易,不仅可以快速的完成对运动目标的 匹配跟踪而且可以解决运动目标在遮挡情况下的匹 配问题。 在匹配跟踪完成之后,每一帧都实时更新 运动目标当前的位置信息,主要包括运动目标的中 心点和多角点信息,以便后续完成对运动目标轨迹 的记录和排查。 3.2 特征跟踪目标 当帧间距离跟踪判断未找到匹配目标或者找到 多个匹配目标时,就会造成帧间距离跟踪失效,而此 时就需要启用各目标特征库信息完成对目标的匹配 跟踪。 本文采用的是目标图像的 SIFT 特征(表示为 T )和目标图像的彩色直方图特征(R、G、B 三通道 第 3 期 柳培忠,等:一种基于多特征融合的视频目标跟踪方法 ·321·