正在加载图片...

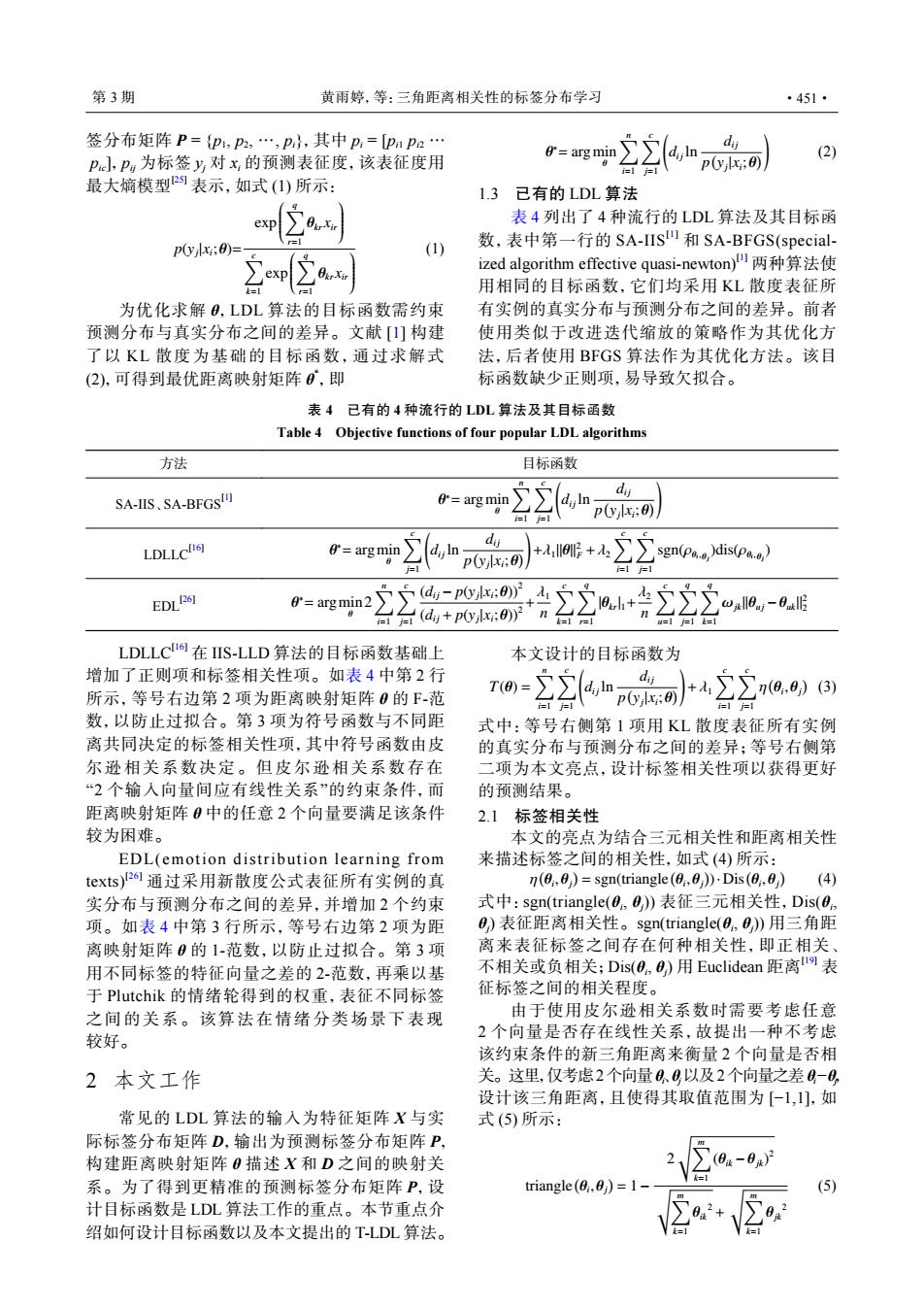

第3期 黄雨婷,等:三角距离相关性的标签分布学习 ·451· 签分布矩阵P={p,p2,…,p},其中p,=[papn d P,Pg为标签y对x,的预测表征度,该表征度用 0=arg min (2) p(vix:0) 最大嫡模型的表示,如式(1)所示: 1.3 已有的LDL算法 表4列出了4种流行的LDL算法及其目标函 pyx;)月 (1) 数,表中第一行的SA-IS和SA-BFGS(special- 2n②a ized algorithm effective quasi-newton)两种算法使 用相同的目标函数,它们均采用KL散度表征所 为优化求解0,LDL算法的目标函数需约束 有实例的真实分布与预测分布之间的差异。前者 预测分布与真实分布之间的差异。文献[]构建 使用类似于改进迭代缩放的策略作为其优化方 了以KL散度为基础的目标函数,通过求解式 法,后者使用BFGS算法作为其优化方法。该目 (2),可得到最优距离映射矩阵0,即 标函数缺少正则项,易导致欠拟合。 表4已有的4种流行的LDL算法及其目标函数 Table 4 Objective functions of four popular LDL algorithms 方法 目标函数 d SA-IS、SA-BFGSIM 0=argmin =1 p6y;) LDLLCI6 0=argmin d p: )+hIo啡+2∑sn(Pdis) =1=1 EDLP网 =argmin2(du-p) 台台a+p0: wxe,-0tl旧 n k=1=1 =1j1k= LDLLC1在IS-LLD算法的目标函数基础上 本文设计的目标函数为 增加了正则项和标签相关性项。如表4中第2行 所示,等号右边第2项为距离映射矩阵0的F-范 ro-(3) 数,以防止过拟合。第3项为符号函数与不同距 式中:等号右侧第1项用KL散度表征所有实例 离共同决定的标签相关性项,其中符号函数由皮 的真实分布与预测分布之间的差异;等号右侧第 尔逊相关系数决定。但皮尔逊相关系数存在 二项为本文亮点,设计标签相关性项以获得更好 “2个输入向量间应有线性关系”的约束条件,而 的预测结果。 距离映射矩阵0中的任意2个向量要满足该条件 2.1 标签相关性 较为困难。 本文的亮点为结合三元相关性和距离相关性 EDL(emotion distribution learning from 来描述标签之间的相关性,如式(4)所示: texts)2通过采用新散度公式表征所有实例的真 n(0.0)=sgn(triangle(0,0)-Dis(0,0)(4) 实分布与预测分布之间的差异,并增加2个约束 式中:sgn(triangle(0,0)表征三元相关性,Dis(0: 项。如表4中第3行所示,等号右边第2项为距 0)表征距离相关性。sgn(triangle(0,0)》用三角距 离映射矩阵0的1-范数,以防止过拟合。第3项 离来表征标签之间存在何种相关性,即正相关 用不同标签的特征向量之差的2-范数,再乘以基 不相关或负相关;Dis(0,O)用Euclidean距离9表 于Plutchik的情绪轮得到的权重,表征不同标签 征标签之间的相关程度。 之间的关系。该算法在情绪分类场景下表现 由于使用皮尔逊相关系数时需要考虑任意 较好。 2个向量是否存在线性关系,故提出一种不考虑 该约束条件的新三角距离来衡量2个向量是否相 2本文工作 关。这里,仅考虑2个向量0g以及2个向量之差0-0, 设计该三角距离,且使得其取值范围为[-1,1],如 常见的LDL算法的输入为特征矩阵X与实 式(⑤)所示: 际标签分布矩阵D,输出为预测标签分布矩阵P, 构建距离映射矩阵0描述X和D之间的映射关 0-0)2 系。为了得到更精准的预测标签分布矩阵P,设 triangle(,) 计目标函数是LDL算法工作的重点。本节重点介 绍如何设计目标函数以及本文提出的T-LDL算法。签分布矩阵 P = {p1 , p2 , …, pi},其中 pi = [pi1 pi2 … pic],pij 为标签 yj 对 xi 的预测表征度,该表征度用 最大熵模型[25] 表示,如式 (1) 所示: p(yj |xi ;θ)= exp ∑q r=1 θkr xir ∑c k=1 exp ∑q r=1 θkr xir (1) 为优化求解 θ,LDL 算法的目标函数需约束 预测分布与真实分布之间的差异。文献 [1] 构建 了以 KL 散度为基础的目标函数,通过求解式 (2),可得到最优距离映射矩阵 θ * ,即 θ ∗= argmin θ ∑n i=1 ∑c j=1 ( di j ln di j p ( yj |xi ;θ ) ) (2) 1.3 已有的 LDL 算法 表 4 列出了 4 种流行的 LDL 算法及其目标函 数,表中第一行的 SA-IIS[1] 和 SA-BFGS(specialized algorithm effective quasi-newton)[1] 两种算法使 用相同的目标函数,它们均采用 KL 散度表征所 有实例的真实分布与预测分布之间的差异。前者 使用类似于改进迭代缩放的策略作为其优化方 法,后者使用 BFGS 算法作为其优化方法。该目 标函数缺少正则项,易导致欠拟合。 表 4 已有的 4 种流行的 LDL 算法及其目标函数 Table 4 Objective functions of four popular LDL algorithms 方法 目标函数 SA-IIS、SA-BFGS[1] θ ∗= argmin θ ∑n i=1 ∑c j=1 ( di j ln di j p ( yj |xi ;θ ) ) LDLLC[16] θ ∗= argmin θ ∑c j=1 ( di j ln di j p ( yj |xi ;θ ) ) +λ1 ||θ||2 F +λ2 ∑c i=1 ∑c j=1 sgn(ρθi,θj )dis(ρθi,θj ) EDL[26] θ ∗= argmin θ 2 ∑n i=1 ∑c j=1 (di j − p(yj |xi ;θ))2 (di j + p(yj |xi ;θ))2 + λ1 n ∑c k=1 ∑q r=1 |θkr|1+ λ2 n ∑c u=1 ∑q j=1 ∑q k=1 ωjk||θu j −θuk||2 2 LDLLC[16] 在 IIS-LLD 算法的目标函数基础上 增加了正则项和标签相关性项。如表 4 中第 2 行 所示,等号右边第 2 项为距离映射矩阵 θ 的 F-范 数,以防止过拟合。第 3 项为符号函数与不同距 离共同决定的标签相关性项,其中符号函数由皮 尔逊相关系数决定。但皮尔逊相关系数存在 “2 个输入向量间应有线性关系”的约束条件,而 距离映射矩阵 θ 中的任意 2 个向量要满足该条件 较为困难。 EDL(emotion distribution learning from texts)[26] 通过采用新散度公式表征所有实例的真 实分布与预测分布之间的差异,并增加 2 个约束 项。如表 4 中第 3 行所示,等号右边第 2 项为距 离映射矩阵 θ 的 1-范数,以防止过拟合。第 3 项 用不同标签的特征向量之差的 2-范数,再乘以基 于 Plutchik 的情绪轮得到的权重,表征不同标签 之间的关系。该算法在情绪分类场景下表现 较好。 2 本文工作 常见的 LDL 算法的输入为特征矩阵 X 与实 际标签分布矩阵 D,输出为预测标签分布矩阵 P, 构建距离映射矩阵 θ 描述 X 和 D 之间的映射关 系。为了得到更精准的预测标签分布矩阵 P,设 计目标函数是 LDL 算法工作的重点。本节重点介 绍如何设计目标函数以及本文提出的 T-LDL 算法。 本文设计的目标函数为 T(θ) = ∑n i=1 ∑c j=1 ( di j ln di j p ( yj |xi ;θ ) ) +λ1 ∑c i=1 ∑c j=1 η ( θi ,θj ) (3) 式中:等号右侧第 1 项用 KL 散度表征所有实例 的真实分布与预测分布之间的差异;等号右侧第 二项为本文亮点,设计标签相关性项以获得更好 的预测结果。 2.1 标签相关性 本文的亮点为结合三元相关性和距离相关性 来描述标签之间的相关性,如式 (4) 所示: η ( θi ,θj ) = sgn(triangle ( θi ,θj ) )·Dis( θi ,θj ) (4) 式中:sgn(triangle(θi , θj )) 表征三元相关性,Dis(θi , θj ) 表征距离相关性。sgn(triangle(θi , θj )) 用三角距 离来表征标签之间存在何种相关性,即正相关、 不相关或负相关;Dis(θi , θj ) 用 Euclidean 距离[19] 表 征标签之间的相关程度。 由于使用皮尔逊相关系数时需要考虑任意 2 个向量是否存在线性关系,故提出一种不考虑 该约束条件的新三角距离来衡量 2 个向量是否相 关。这里,仅考虑2个向量θi、θj以及2个向量之差θi−θj, 设计该三角距离,且使得其取值范围为 [−1,1],如 式 (5) 所示: triangle ( θi ,θj ) = 1− 2 √∑m k=1 (θik −θjk) 2 √∑m k=1 θik 2 + √∑m k=1 θjk 2 (5) 第 3 期 黄雨婷,等:三角距离相关性的标签分布学习 ·451·