正在加载图片...

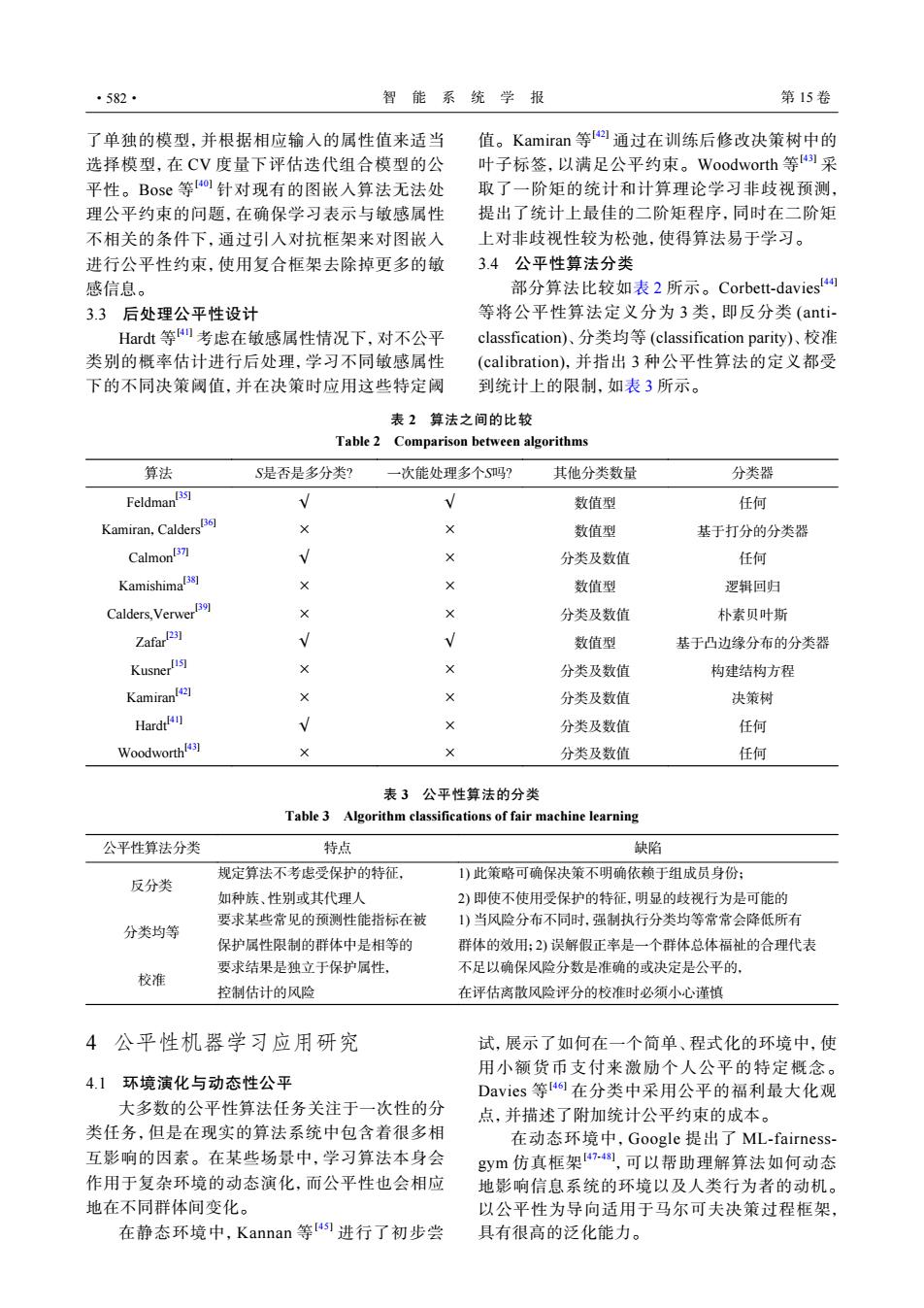

·582· 智能系统学报 第15卷 了单独的模型,并根据相应输入的属性值来适当 值。Kamiran等通过在训练后修改决策树中的 选择模型,在CV度量下评估迭代组合模型的公 叶子标签,以满足公平约束。Woodworth等)采 平性。Bose等o1针对现有的图嵌入算法无法处 取了一阶矩的统计和计算理论学习非歧视预测, 理公平约束的问题,在确保学习表示与敏感属性 提出了统计上最佳的二阶矩程序,同时在二阶矩 不相关的条件下,通过引入对抗框架来对图嵌入 上对非歧视性较为松弛,使得算法易于学习。 进行公平性约束,使用复合框架去除掉更多的敏 3.4公平性算法分类 感信息。 部分算法比较如表2所示。Corbett-.davies 3.3后处理公平性设计 等将公平性算法定义分为3类,即反分类(anti- Hardt等彻考虑在敏感属性情况下,对不公平 classfication)、分类均等(classification parity)、校准 类别的概率估计进行后处理,学习不同敏感属性 (calibration),并指出3种公平性算法的定义都受 下的不同决策阈值,并在决策时应用这些特定阈 到统计上的限制,如表3所示。 表2算法之间的比较 Table 2 Comparison between algorithms 算法 S是否是多分类? 一次能处理多个S吗? 其他分类数量 分类器 FeldmanB35] 数值型 任何 Kamiran,Calders X 数值型 基于打分的分类器 Calmont37 × 分类及数值 任何 Kamishima × 数值型 逻辑回归 Calders,Verwe × 分类及数值 朴素贝叶斯 ZafarP1 V 数值型 基于凸边缘分布的分类器 Kusnerlis] 分类及数值 构建结构方程 Kamiran42 分类及数值 决策树 Hardt4n 分类及数值 任何 Woodworth43 分类及数值 任何 表3公平性算法的分类 Table 3 Algorithm classifications of fair machine learning 公平性算法分类 特点 缺陷 规定算法不考虑受保护的特征, 1)此策略可确保决策不明确依赖于组成员身份: 反分类 如种族、性别或其代理人 2)即使不使用受保护的特征,明显的歧视行为是可能的 要求某些常见的预测性能指标在被 1)当风险分布不同时,强制执行分类均等常常会降低所有 分类均等 保护属性限制的群体中是相等的 群体的效用:2)误解假正率是一个群体总体福祉的合理代表 要求结果是独立于保护属性, 不足以确保风险分数是准确的或决定是公平的, 校准 控制估计的风险 在评估离散风险评分的校准时必须小心谨慎 4 公平性机器学习应用研究 试,展示了如何在一个简单、程式化的环境中,使 用小额货币支付来激励个人公平的特定概念。 4.1环境演化与动态性公平 Davies等46在分类中采用公平的福利最大化观 大多数的公平性算法任务关注于一次性的分 点,并描述了附加统计公平约束的成本。 类任务,但是在现实的算法系统中包含着很多相 在动态环境中,Google提出了ML-fairness-. 互影响的因素。在某些场景中,学习算法本身会 gym仿真框架.4,可以帮助理解算法如何动态 作用于复杂环境的动态演化,而公平性也会相应 地影响信息系统的环境以及人类行为者的动机。 地在不同群体间变化。 以公平性为导向适用于马尔可夫决策过程框架, 在静态环境中,Kannan等4进行了初步尝 具有很高的泛化能力。了单独的模型,并根据相应输入的属性值来适当 选择模型,在 CV 度量下评估迭代组合模型的公 平性。Bose 等 [40] 针对现有的图嵌入算法无法处 理公平约束的问题,在确保学习表示与敏感属性 不相关的条件下,通过引入对抗框架来对图嵌入 进行公平性约束,使用复合框架去除掉更多的敏 感信息。 3.3 后处理公平性设计 Hardt 等 [41] 考虑在敏感属性情况下,对不公平 类别的概率估计进行后处理,学习不同敏感属性 下的不同决策阈值,并在决策时应用这些特定阈 值。Kamiran 等 [42] 通过在训练后修改决策树中的 叶子标签,以满足公平约束。Woodworth 等 [43] 采 取了一阶矩的统计和计算理论学习非歧视预测, 提出了统计上最佳的二阶矩程序,同时在二阶矩 上对非歧视性较为松弛,使得算法易于学习。 3.4 公平性算法分类 部分算法比较如表 2 所示。Corbett-davies[44] 等将公平性算法定义分为 3 类,即反分类 (anticlassfication)、分类均等 (classification parity)、校准 (calibration),并指出 3 种公平性算法的定义都受 到统计上的限制,如表 3 所示。 表 2 算法之间的比较 Table 2 Comparison between algorithms 算法 S是否是多分类? 一次能处理多个S吗? 其他分类数量 分类器 Feldman[35] √ √ 数值型 任何 Kamiran,Calders[36] × × 数值型 基于打分的分类器 Calmon[37] √ × 分类及数值 任何 Kamishima[38] × × 数值型 逻辑回归 Calders,Verwer[39] × × 分类及数值 朴素贝叶斯 Zafar[23] √ √ 数值型 基于凸边缘分布的分类器 Kusner[15] × × 分类及数值 构建结构方程 Kamiran[42] × × 分类及数值 决策树 Hardt[41] √ × 分类及数值 任何 Woodworth[43] × × 分类及数值 任何 表 3 公平性算法的分类 Table 3 Algorithm classifications of fair machine learning 公平性算法分类 特点 缺陷 反分类 规定算法不考虑受保护的特征, 如种族、性别或其代理人 1) 此策略可确保决策不明确依赖于组成员身份; 2) 即使不使用受保护的特征,明显的歧视行为是可能的 分类均等 要求某些常见的预测性能指标在被 保护属性限制的群体中是相等的 1) 当风险分布不同时,强制执行分类均等常常会降低所有 群体的效用;2) 误解假正率是一个群体总体福祉的合理代表 校准 要求结果是独立于保护属性, 控制估计的风险 不足以确保风险分数是准确的或决定是公平的, 在评估离散风险评分的校准时必须小心谨慎 4 公平性机器学习应用研究 4.1 环境演化与动态性公平 大多数的公平性算法任务关注于一次性的分 类任务,但是在现实的算法系统中包含着很多相 互影响的因素。在某些场景中,学习算法本身会 作用于复杂环境的动态演化,而公平性也会相应 地在不同群体间变化。 在静态环境中,Kannan 等 [45] 进行了初步尝 试,展示了如何在一个简单、程式化的环境中,使 用小额货币支付来激励个人公平的特定概念。 Davies 等 [46] 在分类中采用公平的福利最大化观 点,并描述了附加统计公平约束的成本。 在动态环境中,Google 提出了 ML-fairnessgym 仿真框架[47-48] ,可以帮助理解算法如何动态 地影响信息系统的环境以及人类行为者的动机。 以公平性为导向适用于马尔可夫决策过程框架, 具有很高的泛化能力。 ·582· 智 能 系 统 学 报 第 15 卷