正在加载图片...

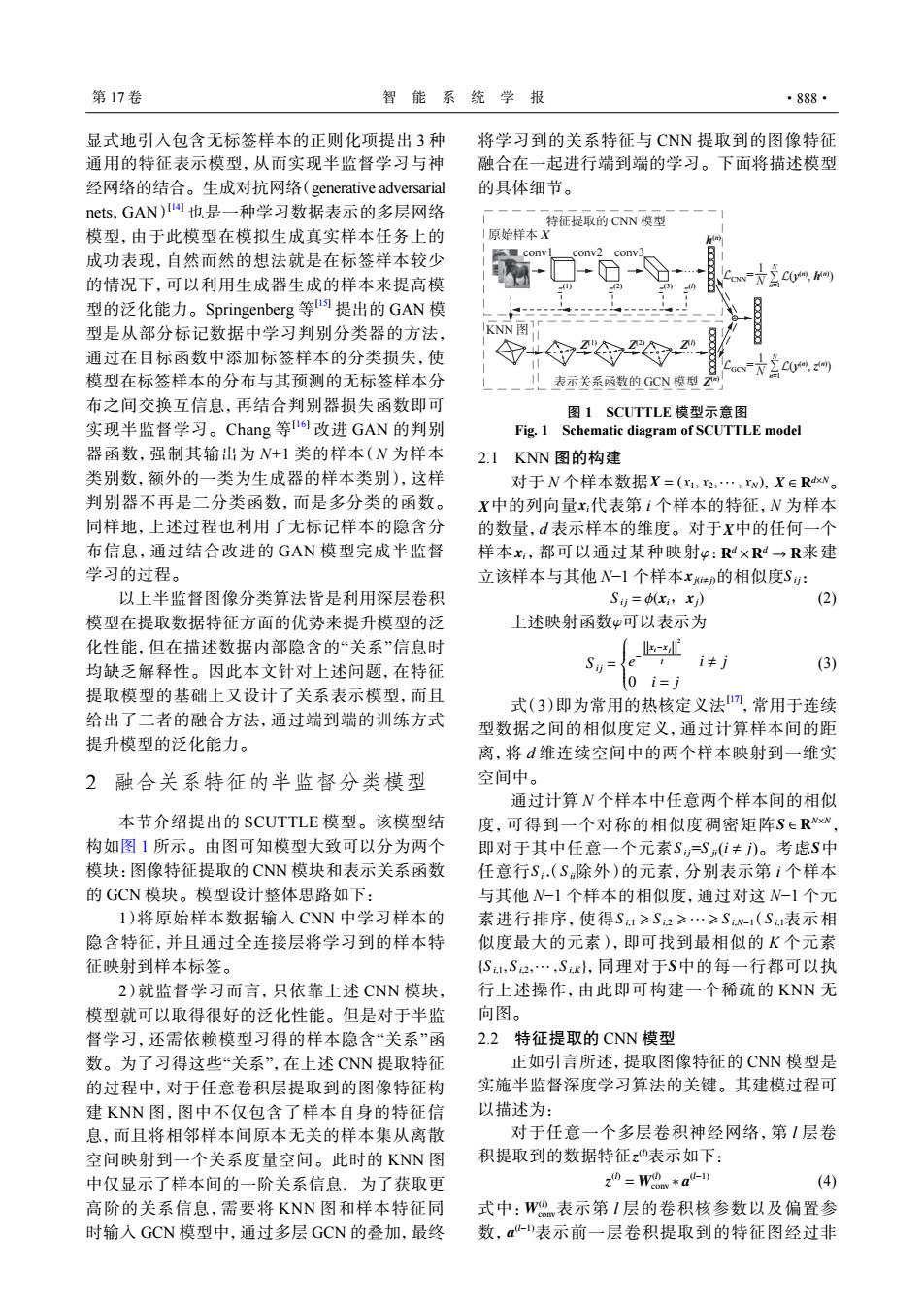

第17卷 智能系统学报 ·888· 显式地引入包含无标签样本的正则化项提出3种 将学习到的关系特征与CNN提取到的图像特征 通用的特征表示模型,从而实现半监督学习与神 融合在一起进行端到端的学习。下面将描述模型 经网络的结合。生成对抗网络(generative adversarial 的具体细节。 nets,GAN)也是一种学习数据表示的多层网络 特征提取的CNN模型 模型,由于此模型在模拟生成真实样本任务上的 原始样本X conv 成功表现,自然而然的想法就是在标签样本较少 的情况下,可以利用生成器生成的样本来提高模 型的泛化能力。Springenberg等l提出的GAN模 型是从部分标记数据中学习判别分类器的方法, KNN图 通过在目标函数中添加标签样本的分类损失,使 模型在标签样本的分布与其预测的无标签样本分 表示关系函数的GCN模型☑ 布之间交换互信息,再结合判别器损失函数即可 图1 SCUTTLE模型示意图 实现半监督学习。Chang等u改进GAN的判别 Fig.1 Schematic diagram of SCUTTLE model 器函数,强制其输出为N+1类的样本(N为样本 2.1KNN图的构建 类别数,额外的一类为生成器的样本类别),这样 对于N个样本数据X=(,x,…,xw),X∈Rw。 判别器不再是二分类函数,而是多分类的函数。 X中的列向量x代表第i个样本的特征,N为样本 同样地,上述过程也利用了无标记样本的隐含分 的数量,d表示样本的维度。对于X中的任何一个 布信息,通过结合改进的GAN模型完成半监督 样本x,都可以通过某种映射p:R4xR4→R来建 学习的过程。 立该样本与其他N-1个样本xn的相似度S: 以上半监督图像分类算法皆是利用深层卷积 Sii=(xi,xi) (2) 模型在提取数据特征方面的优势来提升模型的泛 上述映射函数如可以表示为 化性能,但在描述数据内部隐含的“关系”信息时 s-x 均缺乏解释性。因此本文针对上述问题,在特征 Sy= e i≠j (3) 0 i=i 提取模型的基础上又设计了关系表示模型,而且 式(3)即为常用的热核定义法叨,常用于连续 给出了二者的融合方法,通过端到端的训练方式 型数据之间的相似度定义,通过计算样本间的距 提升模型的泛化能力。 离,将d维连续空间中的两个样本映射到一维实 2融合关系特征的半监督分类模型 空间中。 通过计算N个样本中任意两个样本间的相似 本节介绍提出的SCUTTLE模型。该模型结 度,可得到一个对称的相似度稠密矩阵S∈Rw, 构如图1所示。由图可知模型大致可以分为两个 即对于其中任意一个元素S)=S(i≠)。考虑S中 模块:图像特征提取的CNN模块和表示关系函数 任意行S.(S除外)的元素,分别表示第i个样本 的GCN模块。模型设计整体思路如下: 与其他N-1个样本的相似度,通过对这N-1个元 1)将原始样本数据输入CNN中学习样本的 素进行排序,使得S1≥S2≥…≥Sw-(S表示相 隐含特征,并且通过全连接层将学习到的样本特 似度最大的元素),即可找到最相似的K个元素 征映射到样本标签。 {S,S2,…,Sx,同理对于S中的每一行都可以执 2)就监督学习而言,只依靠上述CNN模块, 行上述操作,由此即可构建一个稀疏的KNN无 模型就可以取得很好的泛化性能。但是对于半监 向图。 督学习,还需依赖模型习得的样本隐含“关系”函 2.2特征提取的CNN模型 数。为了习得这些“关系”,在上述CNN提取特征 正如引言所述,提取图像特征的CNN模型是 的过程中,对于任意卷积层提取到的图像特征构 实施半监督深度学习算法的关键。其建模过程可 建KNN图,图中不仅包含了样本自身的特征信 以描述为: 息,而且将相邻样本间原本无关的样本集从离散 对于任意一个多层卷积神经网络,第1层卷 空间映射到一个关系度量空间。此时的KNN图 积提取到的数据特征z表示如下: 中仅显示了样本间的一阶关系信息.为了获取更 2(0)=Woy *a-1) (4) 高阶的关系信息,需要将KNN图和样本特征同 式中:W心表示第I层的卷积核参数以及偏置参 时输入GCN模型中,通过多层GCN的叠加,最终 数,a)表示前一层卷积提取到的特征图经过非显式地引入包含无标签样本的正则化项提出 3 种 通用的特征表示模型,从而实现半监督学习与神 经网络的结合。生成对抗网络(generative adversarial nets,GAN) [14] 也是一种学习数据表示的多层网络 模型,由于此模型在模拟生成真实样本任务上的 成功表现,自然而然的想法就是在标签样本较少 的情况下,可以利用生成器生成的样本来提高模 型的泛化能力。Springenberg 等 [15] 提出的 GAN 模 型是从部分标记数据中学习判别分类器的方法, 通过在目标函数中添加标签样本的分类损失,使 模型在标签样本的分布与其预测的无标签样本分 布之间交换互信息,再结合判别器损失函数即可 实现半监督学习。Chang 等 [16] 改进 GAN 的判别 器函数,强制其输出为 N+1 类的样本(N 为样本 类别数,额外的一类为生成器的样本类别),这样 判别器不再是二分类函数,而是多分类的函数。 同样地,上述过程也利用了无标记样本的隐含分 布信息,通过结合改进的 GAN 模型完成半监督 学习的过程。 以上半监督图像分类算法皆是利用深层卷积 模型在提取数据特征方面的优势来提升模型的泛 化性能,但在描述数据内部隐含的“关系”信息时 均缺乏解释性。因此本文针对上述问题,在特征 提取模型的基础上又设计了关系表示模型,而且 给出了二者的融合方法,通过端到端的训练方式 提升模型的泛化能力。 2 融合关系特征的半监督分类模型 本节介绍提出的 SCUTTLE 模型。该模型结 构如图 1 所示。由图可知模型大致可以分为两个 模块:图像特征提取的 CNN 模块和表示关系函数 的 GCN 模块。模型设计整体思路如下: 1)将原始样本数据输入 CNN 中学习样本的 隐含特征,并且通过全连接层将学习到的样本特 征映射到样本标签。 2)就监督学习而言,只依靠上述 CNN 模块, 模型就可以取得很好的泛化性能。但是对于半监 督学习,还需依赖模型习得的样本隐含“关系”函 数。为了习得这些“关系”,在上述 CNN 提取特征 的过程中,对于任意卷积层提取到的图像特征构 建 KNN 图,图中不仅包含了样本自身的特征信 息,而且将相邻样本间原本无关的样本集从离散 空间映射到一个关系度量空间。此时的 KNN 图 中仅显示了样本间的一阶关系信息.为了获取更 高阶的关系信息,需要将 KNN 图和样本特征同 时输入 GCN 模型中,通过多层 GCN 的叠加,最终 将学习到的关系特征与 CNN 提取到的图像特征 融合在一起进行端到端的学习。下面将描述模型 的具体细节。 1 N N n=1 CNN= (y (n) , h (n) ∑ ) 1 N N n=1 GCN= (y (n) , z (n) ∑ ) … … conv1 conv2 conv3 特征提取的 CNN 模型 h (n) z (1) z (2) z (3) z (l) 表示关系函数的 GCN 模型 Z (1) Z (2) Z (l) Z (n) KNN 图 原始样本 X + 图 1 SCUTTLE 模型示意图 Fig. 1 Schematic diagram of SCUTTLE model 2.1 KNN 图的构建 X = (x1, x2,··· , xN) X ∈ R d×N X xi X xi φ R d ×R d → R xj(i,j) S i j 对于 N 个样本数据 , 。 中的列向量 代表第 i 个样本的特征,N 为样本 的数量,d 表示样本的维度。对于 中的任何一个 样本 ,都可以通过某种映射 : 来建 立该样本与其他 N−1 个样本 的相似度 : S i j = ϕ(xi,xj) (2) 上述映射函数 φ 可以表示为 S i j = e − ∥xi−xj∥ 2 t i , j 0 i = j (3) 式(3)即为常用的热核定义法[17] ,常用于连续 型数据之间的相似度定义,通过计算样本间的距 离,将 d 维连续空间中的两个样本映射到一维实 空间中。 S ∈ R N×N S i j S ji i , j S S i· S ii S i,1 ⩾ S i,2 ⩾ ··· ⩾ S i,N−1 S i,1 {S i,1,S i,2,··· ,S i,K} S 通过计算 N 个样本中任意两个样本间的相似 度,可得到一个对称的相似度稠密矩阵 , 即对于其中任意一个元素 = ( )。考虑 中 任意行 ( 除外)的元素,分别表示第 i 个样本 与其他 N−1 个样本的相似度,通过对这 N−1 个元 素进行排序,使得 ( 表示相 似度最大的元素),即可找到最相似的 K 个元素 ,同理对于 中的每一行都可以执 行上述操作,由此即可构建一个稀疏的 KNN 无 向图。 2.2 特征提取的 CNN 模型 正如引言所述,提取图像特征的 CNN 模型是 实施半监督深度学习算法的关键。其建模过程可 以描述为: z (l) 对于任意一个多层卷积神经网络,第 l 层卷 积提取到的数据特征 表示如下: z (l) = W(l) conv ∗ a (l−1) (4) W(l) conv a (l−1) 式中: 表示第 l 层的卷积核参数以及偏置参 数, 表示前一层卷积提取到的特征图经过非 第 17 卷 智 能 系 统 学 报 ·888·