正在加载图片...

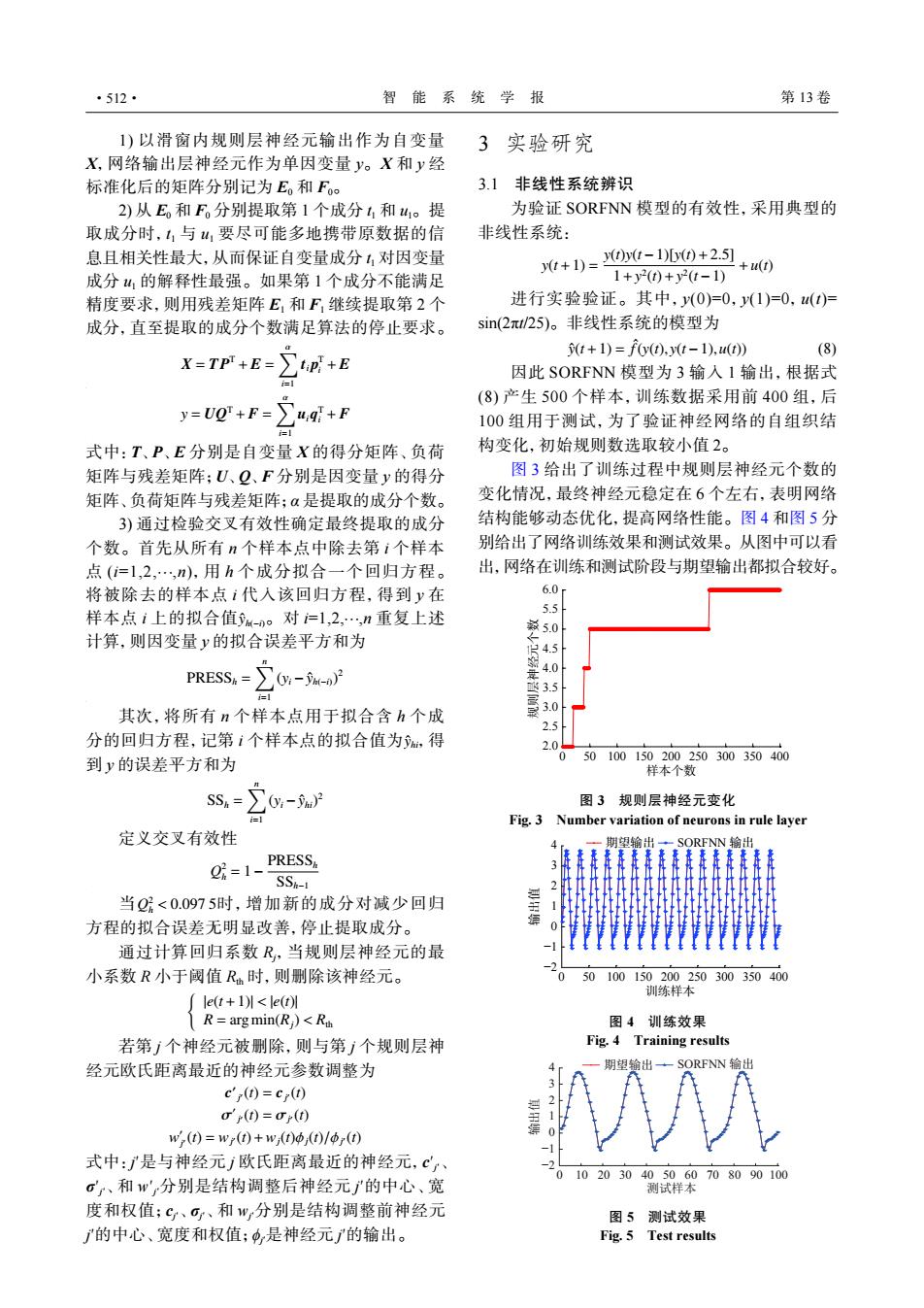

·512· 智能系统学报 第13卷 1)以滑窗内规则层神经元输出作为自变量 3实验研究 X,网络输出层神经元作为单因变量y。X和y经 标准化后的矩阵分别记为E。和Fo。 3.1非线性系统辨识 2)从E和F。分别提取第1个成分4和41。提 为验证SORFNN模型的有效性,采用典型的 取成分时,1与山要尽可能多地携带原数据的信 非线性系统: 息且相关性最大,从而保证自变量成分1对因变量 1+1)=0-100+2.5 +u(t) 成分“的解释性最强。如果第1个成分不能满足 1+y2(t)+y2(t-1) 精度要求,则用残差矩阵E和F继续提取第2个 进行实验验证。其中,y(0)=0,y(1)=0,(t)= 成分,直至提取的成分个数满足算法的停止要求。 sin(2πl25)。非线性系统的模型为 X-TP+E->+E t+1)=f0y(t0),y(t-1),(t) (8) 因此SORFNN模型为3输入1输出,根据式 (8)产生500个样本,训练数据采用前400组,后 y=UOT+F= 4,g+F 100组用于测试,为了验证神经网络的自组织结 =1 式中:T、P、E分别是自变量X的得分矩阵、负荷 构变化,初始规则数选取较小值2。 矩阵与残差矩阵;U、Q、F分别是因变量y的得分 图3给出了训练过程中规则层神经元个数的 矩阵、负荷矩阵与残差矩阵;α是提取的成分个数。 变化情况,最终神经元稳定在6个左右,表明网络 3)通过检验交叉有效性确定最终提取的成分 结构能够动态优化,提高网络性能。图4和图5分 个数。首先从所有n个样本点中除去第i个样本 别给出了网络训练效果和测试效果。从图中可以看 点(=1,2,…,n),用h个成分拟合一个回归方程。 出,网络在训练和测试阶段与期望输出都拟合较好。 将被除去的样本点i代入该回归方程,得到y在 6.0 样本点i上的拟合值M-n。对=1,2,,n重复上述 5.5 熟5.0 计算,则因变量y的拟合误差平方和为 R4.5 PRESS 4.0 3.5 其次,将所有n个样本点用于拟合含h个成 0 2.5 分的回归方程,记第i个样本点的拟合值为,得 2.0 到y的误差平方和为 50100150200250300350400 样本个数 SS= - 图3规则层神经元变化 Fig.3 Number variation of neurons in rule layer 定义交叉有效性 用目验中 =1-PRESS, SSh- 当Q<0.0975时,增加新的成分对减少回归 方程的拟合误差无明显改善,停止提取成分。 通过计算回归系数R,当规则层神经元的最 小系数R小于阈值R时,则删除该神经元。 0 50100150200250300350400 训练样本 le(t+1)<le(t) R=arg min(R)<Ri 图4训练效果 若第个神经元被删除,则与第j个规则层神 Fig.4 Training results 经元欧氏距离最近的神经元参数调整为 期望输出·SORFNN输出 c'()=cr(①) 0(t)=0r() 3210 w.(t)=wr(1)+wi)(t)/r(t) 式中:了是与神经元j欧氏距离最近的神经元,c、 0102030405060708090100 G、和w',分别是结构调整后神经元'的中心、宽 测试样本 度和权值;C、G、和w分别是结构调整前神经元 图5测试效果 的中心、宽度和权值;是神经元广的输出。 Fig.5 Test results1) 以滑窗内规则层神经元输出作为自变量 X,网络输出层神经元作为单因变量 y。X 和 y 经 标准化后的矩阵分别记为 E0 和 F0。 2) 从 E0 和 F0 分别提取第 1 个成分 t1 和 u1。提 取成分时,t1 与 u1 要尽可能多地携带原数据的信 息且相关性最大,从而保证自变量成分 t1 对因变量 成分 u1 的解释性最强。如果第 1 个成分不能满足 精度要求,则用残差矩阵 E1 和 F1 继续提取第 2 个 成分,直至提取的成分个数满足算法的停止要求。 X = TPT + E = ∑α i=1 ti p T i + E y = UQT + F = ∑α i=1 uiq T i + F 式中:T、P、E 分别是自变量 X 的得分矩阵、负荷 矩阵与残差矩阵;U、Q、F 分别是因变量 y 的得分 矩阵、负荷矩阵与残差矩阵;α 是提取的成分个数。 ··· yˆh(−i) ··· 3) 通过检验交叉有效性确定最终提取的成分 个数。首先从所有 n 个样本点中除去第 i 个样本 点 (i=1,2, ,n),用 h 个成分拟合一个回归方程。 将被除去的样本点 i 代入该回归方程,得到 y 在 样本点 i 上的拟合值 。对 i=1,2, ,n 重复上述 计算,则因变量 y 的拟合误差平方和为 PRESSh = ∑n i=1 (yi −yˆh(−i)) 2 yˆhi 其次,将所有 n 个样本点用于拟合含 h 个成 分的回归方程,记第 i 个样本点的拟合值为 ,得 到 y 的误差平方和为 SSh = ∑n i=1 (yi −yˆhi) 2 定义交叉有效性 Q 2 h = 1− PRESSh SSh−1 Q 2 当 h < 0.097 5 时,增加新的成分对减少回归 方程的拟合误差无明显改善,停止提取成分。 通过计算回归系数 Rj,当规则层神经元的最 小系数 R 小于阈值 Rth 时,则删除该神经元。 { |e(t+1)| < |e(t)| R = argmin(Rj) < Rth 若第 j 个神经元被删除,则与第 j 个规则层神 经元欧氏距离最近的神经元参数调整为 c ′ j ′ (t) = cj ′ (t) σ ′ j ′ (t) = σj ′ (t) w ′ j ′ (t) = wj ′ (t)+wj(t)ϕj(t)/ϕj ′ (t) 式中:j′是与神经元 j 欧氏距离最近的神经元,c′ j′、 σ′ j′、和 w′ j′分别是结构调整后神经元 j′的中心、宽 度和权值;cj′、σj′、和 wj′分别是结构调整前神经元 j′的中心、宽度和权值;ϕj′是神经元 j′的输出。 3 实验研究 3.1 非线性系统辨识 为验证 SORFNN 模型的有效性,采用典型的 非线性系统: y(t+1) = y(t)y(t−1)[y(t)+2.5] 1+y 2 (t)+y 2 (t−1) +u(t) 进行实验验证。其中,y(0)=0,y(1)=0,u(t)= sin(2πt/25)。非线性系统的模型为 yˆ(t+1) = ˆf(y(t), y(t−1),u(t)) (8) 因此 SORFNN 模型为 3 输入 1 输出,根据式 (8) 产生 500 个样本,训练数据采用前 400 组,后 100 组用于测试,为了验证神经网络的自组织结 构变化,初始规则数选取较小值 2。 图 3 给出了训练过程中规则层神经元个数的 变化情况,最终神经元稳定在 6 个左右,表明网络 结构能够动态优化,提高网络性能。图 4 和图 5 分 别给出了网络训练效果和测试效果。从图中可以看 出,网络在训练和测试阶段与期望输出都拟合较好。 0 50 100 150 200 250 300 350 400 2.0 2.5 3.0 3.5 4.0 4.5 5.0 5.5 6.0 样本个数 规则层神经元个数 图 3 规则层神经元变化 Fig. 3 Number variation of neurons in rule layer 0 50 100 150 200 250 300 350 400 −2 −1 0 1 2 3 4 训练样本 输出值 期望输出 SORFNN 输出 图 4 训练效果 Fig. 4 Training results 0 10 20 30 40 50 60 70 80 90 100 −2 −1 0 1 2 3 4 ⍻䈅ṧᵜ 䗃ࠪ٬ ᵏᵋ䗃ࠪ SORFNN 䗃ࠪ 图 5 测试效果 Fig. 5 Test results ·512· 智 能 系 统 学 报 第 13 卷