正在加载图片...

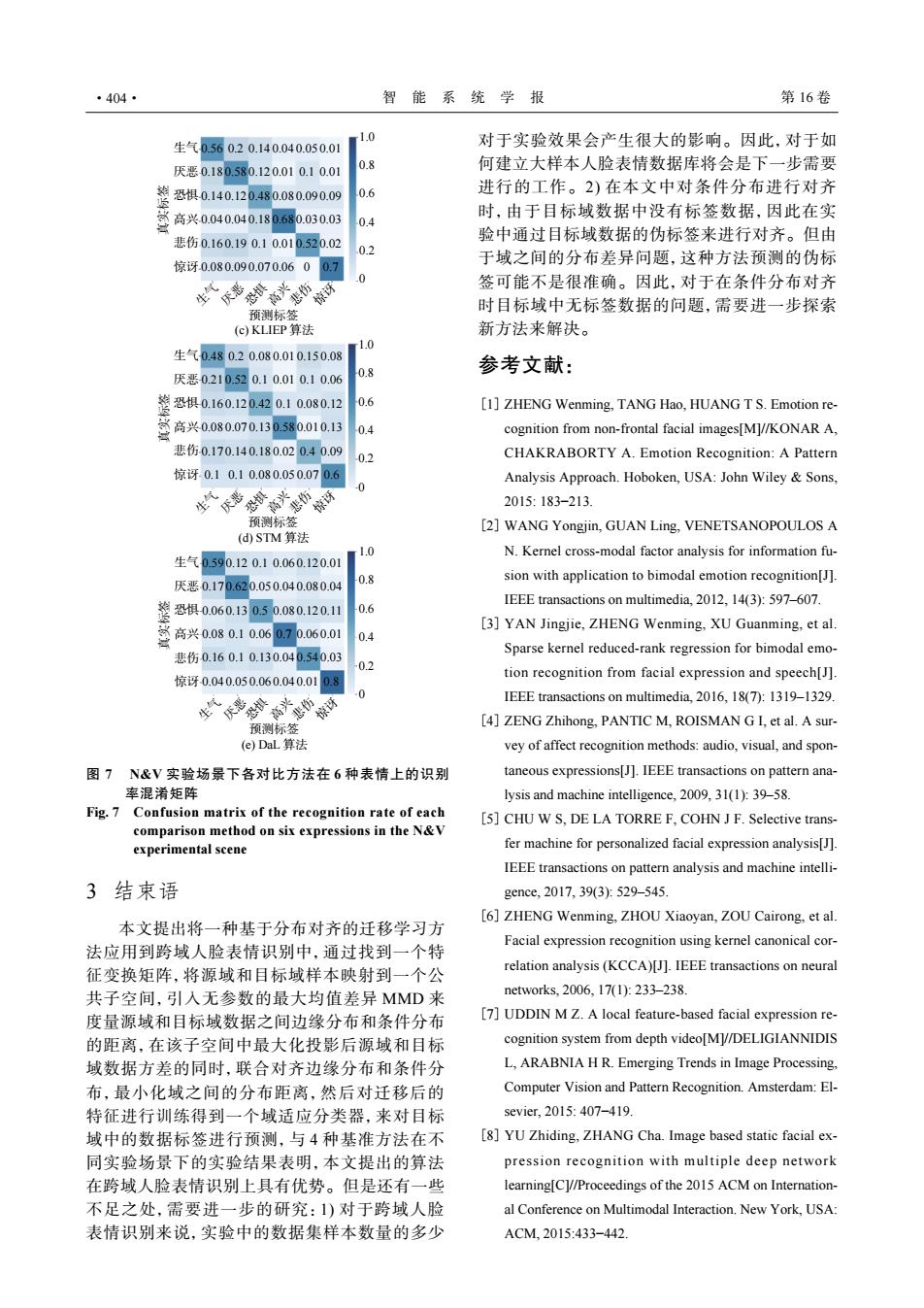

·404· 智能系统学报 第16卷 1.0 生气0.56020.140.040.050.01 对于实验效果会产生很大的影响。因此,对于如 厌恶0.180.580.120.010.10.01 0.8 何建立大样本人脸表情数据库将会是下一步需要 整恐惧0.140120480080.0909 0.6 进行的工作。2)在本文中对条件分布进行对齐 室高兴004040.18060303 时,由于目标域数据中没有标签数据,因此在实 0.4 悲伤0.160.190.10.010.520.02 验中通过目标域数据的伪标签来进行对齐。但由 .0.2 惊讶0.080.090.070.0600.7 于域之间的分布差异问题,这种方法预测的伪标 0 多产 签可能不是很准确。因此,对于在条件分布对齐 预测标签 时目标域中无标签数据的问题,需要进一步探索 (c)KLIEP算法 新方法来解决。 生气0.480.20.080.010.150.08 1.0 0.8 参考文献: 厌恶0.210520.10.010.10.06 恐惧0.160.120420.10.080.12 0.6 [1]ZHENG Wenming,TANG Hao,HUANG T S.Emotion re- 警商兴0080.070.1B058010.13 0.4 cognition from non-frontal facial images[M]//KONAR A, 悲伤0.170.140.180.020.40.09 0.2 CHAKRABORTY A.Emotion Recognition:A Pattern 惊讶0.10.10.080.050.070.6 0 Analysis Approach.Hoboken,USA:John Wiley Sons, ☆ 2015:183-213 预测标签 [2]WANG Yongjin,GUAN Ling,VENETSANOPOULOS A (d)STM算法 ▣10 N.Kernel cross-modal factor analysis for information fu- 生气0.590.120.10.060.120.01 厌恶0.170.620.050.040.080.04 08 sion with application to bimodal emotion recognition[J]. 整恐惧0.060.13050.080,120.1 IEEE transactions on multimedia,2012,14(3):597-607. 0.6 室高兴0801060☑00601 [3]YAN Jingjie,ZHENG Wenming,XU Guanming,et al. 0.4 悲伤0.160.10.130.040.540.03 Sparse kernel reduced-rank regression for bimodal emo- -02 惊讶0.040.050.060.040.010.8 tion recognition from facial expression and speech[J] .0 IEEE transactions on multimedia,2016,18(7):1319-1329 预测标签 [4]ZENG Zhihong,PANTIC M,ROISMAN G I,et al.A sur- (e)DaL算法 vey of affect recognition methods:audio,visual,and spon- 图7N&V实验场景下各对比方法在6种表情上的识别 taneous expressions[J].IEEE transactions on pattern ana- 率混淆矩阵 lysis and machine intelligence,2009,31(1):39-58. Fig.7 Confusion matrix of the recognition rate of each [5]CHU W S.DE LA TORRE F.COHN J F.Selective trans- comparison method on six expressions in the N&V experimental scene fer machine for personalized facial expression analysis[]. IEEE transactions on pattern analysis and machine intelli- 3结束语 gence,2017,39(3):529-545. [6]ZHENG Wenming,ZHOU Xiaoyan,ZOU Cairong,et al. 本文提出将一种基于分布对齐的迁移学习方 Facial expression recognition using kernel canonical cor- 法应用到跨域人脸表情识别中,通过找到一个特 征变换矩阵,将源域和目标域样本映射到一个公 relation analysis(KCCA)[J].IEEE transactions on neural 共子空间,引入无参数的最大均值差异MMD来 networks..2006,171):233-238 度量源域和目标域数据之间边缘分布和条件分布 [7]UDDIN M Z.A local feature-based facial expression re- 的距离,在该子空间中最大化投影后源域和目标 cognition system from depth video[MV//DELIGIANNIDIS 域数据方差的同时,联合对齐边缘分布和条件分 L,ARABNIA H R.Emerging Trends in Image Processing, 布,最小化域之间的分布距离,然后对迁移后的 Computer Vision and Pattern Recognition.Amsterdam:El- 特征进行训练得到一个域适应分类器,来对目标 sevier,.2015:407-419 域中的数据标签进行预测,与4种基准方法在不 [8]YU Zhiding,ZHANG Cha.Image based static facial ex- 同实验场景下的实验结果表明,本文提出的算法 pression recognition with multiple deep network 在跨域人脸表情识别上具有优势。但是还有一些 learning[C]//Proceedings of the 2015 ACM on Internation- 不足之处,需要进一步的研究:1)对于跨域人脸 al Conference on Multimodal Interaction.New York,USA: 表情识别来说,实验中的数据集样本数量的多少 ACM.2015:433-442(c) KLIEP 算法 0.56 0.2 0.14 0.04 0.05 0.01 0.18 0.58 0.12 0.01 0.1 0.01 0.14 0.12 0.48 0.08 0.09 0.09 0.04 0.04 0.18 0.68 0.03 0.03 0.16 0.19 0.1 0.01 0.52 0.02 0.08 0.09 0.07 0.06 0 0.7 1.0 0.8 0.6 0.4 0.2 0 预测标签 真实标签 生气 厌恶 恐惧 高兴 悲伤 惊讶 生气 厌恶 恐惧 高兴 悲伤 惊讶 0.48 0.2 0.08 0.01 0.15 0.08 0.21 0.52 0.1 0.01 0.1 0.06 0.16 0.12 0.42 0.1 0.08 0.12 0.08 0.07 0.13 0.58 0.01 0.13 0.17 0.14 0.18 0.02 0.4 0.09 0.1 0.1 0.08 0.05 0.07 0.6 1.0 0.8 0.6 0.4 0.2 0 预测标签 (d) STM 算法 真实标签 生气 厌恶 恐惧 高兴 悲伤 惊讶 生气 厌恶 恐惧 高兴 悲伤 惊讶 0.59 0.12 0.1 0.06 0.12 0.01 0.17 0.62 0.05 0.04 0.08 0.04 0.06 0.13 0.5 0.08 0.12 0.11 0.08 0.1 0.06 0.7 0.06 0.01 0.16 0.1 0.13 0.04 0.54 0.03 0.04 0.05 0.06 0.04 0.01 0.8 1.0 0.8 0.6 0.4 0.2 0 (e) DaL 算法 预测标签 真实标签 生气 厌恶 恐惧 高兴 悲伤 惊讶 生气 厌恶 恐惧 高兴 悲伤 惊讶 图 7 N&V 实验场景下各对比方法在 6 种表情上的识别 率混淆矩阵 Fig. 7 Confusion matrix of the recognition rate of each comparison method on six expressions in the N&V experimental scene 3 结束语 本文提出将一种基于分布对齐的迁移学习方 法应用到跨域人脸表情识别中,通过找到一个特 征变换矩阵,将源域和目标域样本映射到一个公 共子空间,引入无参数的最大均值差异 MMD 来 度量源域和目标域数据之间边缘分布和条件分布 的距离,在该子空间中最大化投影后源域和目标 域数据方差的同时,联合对齐边缘分布和条件分 布,最小化域之间的分布距离,然后对迁移后的 特征进行训练得到一个域适应分类器,来对目标 域中的数据标签进行预测,与 4 种基准方法在不 同实验场景下的实验结果表明,本文提出的算法 在跨域人脸表情识别上具有优势。但是还有一些 不足之处,需要进一步的研究:1) 对于跨域人脸 表情识别来说,实验中的数据集样本数量的多少 对于实验效果会产生很大的影响。因此,对于如 何建立大样本人脸表情数据库将会是下一步需要 进行的工作。2) 在本文中对条件分布进行对齐 时,由于目标域数据中没有标签数据,因此在实 验中通过目标域数据的伪标签来进行对齐。但由 于域之间的分布差异问题,这种方法预测的伪标 签可能不是很准确。因此,对于在条件分布对齐 时目标域中无标签数据的问题,需要进一步探索 新方法来解决。 参考文献: ZHENG Wenming, TANG Hao, HUANG T S. Emotion recognition from non-frontal facial images[M]//KONAR A, CHAKRABORTY A. Emotion Recognition: A Pattern Analysis Approach. Hoboken, USA: John Wiley & Sons, 2015: 183−213. [1] WANG Yongjin, GUAN Ling, VENETSANOPOULOS A N. Kernel cross-modal factor analysis for information fusion with application to bimodal emotion recognition[J]. IEEE transactions on multimedia, 2012, 14(3): 597–607. [2] YAN Jingjie, ZHENG Wenming, XU Guanming, et al. Sparse kernel reduced-rank regression for bimodal emotion recognition from facial expression and speech[J]. IEEE transactions on multimedia, 2016, 18(7): 1319–1329. [3] ZENG Zhihong, PANTIC M, ROISMAN G I, et al. A survey of affect recognition methods: audio, visual, and spontaneous expressions[J]. IEEE transactions on pattern analysis and machine intelligence, 2009, 31(1): 39–58. [4] CHU W S, DE LA TORRE F, COHN J F. Selective transfer machine for personalized facial expression analysis[J]. IEEE transactions on pattern analysis and machine intelligence, 2017, 39(3): 529–545. [5] ZHENG Wenming, ZHOU Xiaoyan, ZOU Cairong, et al. Facial expression recognition using kernel canonical correlation analysis (KCCA)[J]. IEEE transactions on neural networks, 2006, 17(1): 233–238. [6] UDDIN M Z. A local feature-based facial expression recognition system from depth video[M]//DELIGIANNIDIS L, ARABNIA H R. Emerging Trends in Image Processing, Computer Vision and Pattern Recognition. Amsterdam: Elsevier, 2015: 407−419. [7] YU Zhiding, ZHANG Cha. Image based static facial expression recognition with multiple deep network learning[C]//Proceedings of the 2015 ACM on International Conference on Multimodal Interaction. New York, USA: ACM, 2015:433−442. [8] ·404· 智 能 系 统 学 报 第 16 卷