正在加载图片...

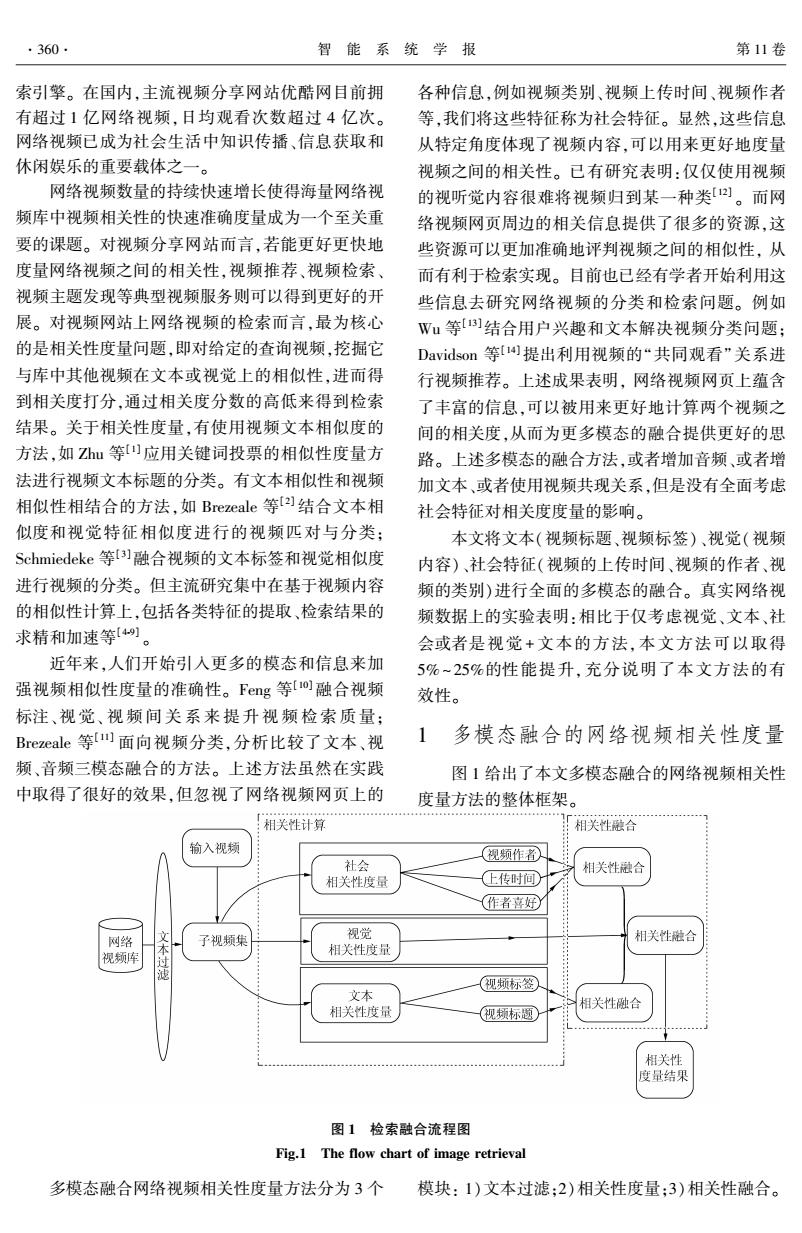

·360 智能系统学报 第11卷 索引擎。在国内,主流视频分享网站优酷网目前拥 各种信息,例如视频类别、视频上传时间、视频作者 有超过1亿网络视频,日均观看次数超过4亿次。 等,我们将这些特征称为社会特征。显然,这些信息 网络视频已成为社会生活中知识传播、信息获取和 从特定角度体现了视频内容,可以用来更好地度量 休闲娱乐的重要载体之一。 视频之间的相关性。已有研究表明:仅仅使用视频 网络视频数量的持续快速增长使得海量网络视 的视听觉内容很难将视频归到某一种类。而网 频库中视频相关性的快速准确度量成为一个至关重 络视频网页周边的相关信息提供了很多的资源,这 要的课题。对视频分享网站而言,若能更好更快地 些资源可以更加准确地评判视频之间的相似性,从 度量网络视频之间的相关性,视频推荐、视频检索、 而有利于检索实现。目前也已经有学者开始利用这 视频主题发现等典型视频服务则可以得到更好的开 些信息去研究网络视频的分类和检索问题。例如 展。对视频网站上网络视频的检索而言,最为核心 Wu等1]结合用户兴趣和文本解决视频分类问题; 的是相关性度量问题,即对给定的查询视频,挖掘它 Davidson等[4提出利用视频的“共同观看”关系进 与库中其他视频在文本或视觉上的相似性,进而得 行视频推荐。上述成果表明,网络视频网页上蕴含 到相关度打分,通过相关度分数的高低来得到检索 了丰富的信息,可以被用来更好地计算两个视频之 结果。关于相关性度量,有使用视频文本相似度的 间的相关度,从而为更多模态的融合提供更好的思 方法,如Zhu等)应用关键词投票的相似性度量方 路。上述多模态的融合方法,或者增加音频、或者增 法进行视频文本标题的分类。有文本相似性和视频 加文本、或者使用视频共现关系,但是没有全面考虑 相似性相结合的方法,如Brezeale等t2]结合文本相 社会特征对相关度度量的影响。 似度和视觉特征相似度进行的视频匹对与分类: 本文将文本(视频标题、视频标签)、视觉(视频 Schmiedeke等)融合视频的文本标签和视觉相似度 内容)、社会特征(视频的上传时间、视频的作者、视 进行视频的分类。但主流研究集中在基于视频内容 频的类别)进行全面的多模态的融合。真实网络视 的相似性计算上,包括各类特征的提取、检索结果的 频数据上的实验表明:相比于仅考虑视觉、文本、社 求精和加速等[4 会或者是视觉+文本的方法,本文方法可以取得 近年来,人们开始引入更多的模态和信息来加 5%~25%的性能提升,充分说明了本文方法的有 强视频相似性度量的准确性。Feng等o融合视频 效性。 标注、视觉、视频间关系来提升视频检索质量: Brezeale等山面向视频分类,分析比较了文本、视 1 多模态融合的网络视频相关性度量 频、音频三模态融合的方法。上述方法虽然在实践 图1给出了本文多模态融合的网络视频相关性 中取得了很好的效果,但忽视了网络视频网页上的 度量方法的整体框架。 相关性计算 相关性融合 输入视频 视频作者 社会 相关性融合 相关性度量 上传时间 (作者喜好 网络 子视频集 视觉 相关性融合 相关性度量 视频库 视频标签 文本 相关性度量 相关性融合 视频标题 相关性 度量结果 图1检索融合流程图 Fig.1 The flow chart of image retrieval 多模态融合网络视频相关性度量方法分为3个 模块:1)文本过滤:2)相关性度量;3)相关性融合。索引擎。 在国内,主流视频分享网站优酷网目前拥 有超过 1 亿网络视频,日均观看次数超过 4 亿次。 网络视频已成为社会生活中知识传播、信息获取和 休闲娱乐的重要载体之一。 网络视频数量的持续快速增长使得海量网络视 频库中视频相关性的快速准确度量成为一个至关重 要的课题。 对视频分享网站而言,若能更好更快地 度量网络视频之间的相关性,视频推荐、视频检索、 视频主题发现等典型视频服务则可以得到更好的开 展。 对视频网站上网络视频的检索而言,最为核心 的是相关性度量问题,即对给定的查询视频,挖掘它 与库中其他视频在文本或视觉上的相似性,进而得 到相关度打分,通过相关度分数的高低来得到检索 结果。 关于相关性度量,有使用视频文本相似度的 方法,如 Zhu 等[1]应用关键词投票的相似性度量方 法进行视频文本标题的分类。 有文本相似性和视频 相似性相结合的方法,如 Brezeale 等[2] 结合文本相 似度和视觉特征相似度进行的视频匹对与分类; Schmiedeke 等[3]融合视频的文本标签和视觉相似度 进行视频的分类。 但主流研究集中在基于视频内容 的相似性计算上,包括各类特征的提取、检索结果的 求精和加速等[4⁃9] 。 近年来,人们开始引入更多的模态和信息来加 强视频相似性度量的准确性。 Feng 等[10] 融合视频 标注、视 觉、 视 频 间 关 系 来 提 升 视 频 检 索 质 量; Brezeale 等[11] 面向视频分类,分析比较了文本、视 频、音频三模态融合的方法。 上述方法虽然在实践 中取得了很好的效果,但忽视了网络视频网页上的 各种信息,例如视频类别、视频上传时间、视频作者 等,我们将这些特征称为社会特征。 显然,这些信息 从特定角度体现了视频内容,可以用来更好地度量 视频之间的相关性。 已有研究表明:仅仅使用视频 的视听觉内容很难将视频归到某一种类[12] 。 而网 络视频网页周边的相关信息提供了很多的资源,这 些资源可以更加准确地评判视频之间的相似性, 从 而有利于检索实现。 目前也已经有学者开始利用这 些信息去研究网络视频的分类和检索问题。 例如 Wu 等[13]结合用户兴趣和文本解决视频分类问题; Davidson 等[14]提出利用视频的“共同观看”关系进 行视频推荐。 上述成果表明, 网络视频网页上蕴含 了丰富的信息,可以被用来更好地计算两个视频之 间的相关度,从而为更多模态的融合提供更好的思 路。 上述多模态的融合方法,或者增加音频、或者增 加文本、或者使用视频共现关系,但是没有全面考虑 社会特征对相关度度量的影响。 本文将文本(视频标题、视频标签)、视觉(视频 内容)、社会特征(视频的上传时间、视频的作者、视 频的类别)进行全面的多模态的融合。 真实网络视 频数据上的实验表明:相比于仅考虑视觉、文本、社 会或者是视觉 + 文本的方法,本文方法可以取得 5% ~25%的性能提升,充分说明了本文方法的有 效性。 1 多模态融合的网络视频相关性度量 图 1 给出了本文多模态融合的网络视频相关性 度量方法的整体框架。 图 1 检索融合流程图 Fig.1 The flow chart of image retrieval 多模态融合网络视频相关性度量方法分为 3 个 模块: 1)文本过滤;2)相关性度量;3)相关性融合。 ·360· 智 能 系 统 学 报 第 11 卷