正在加载图片...

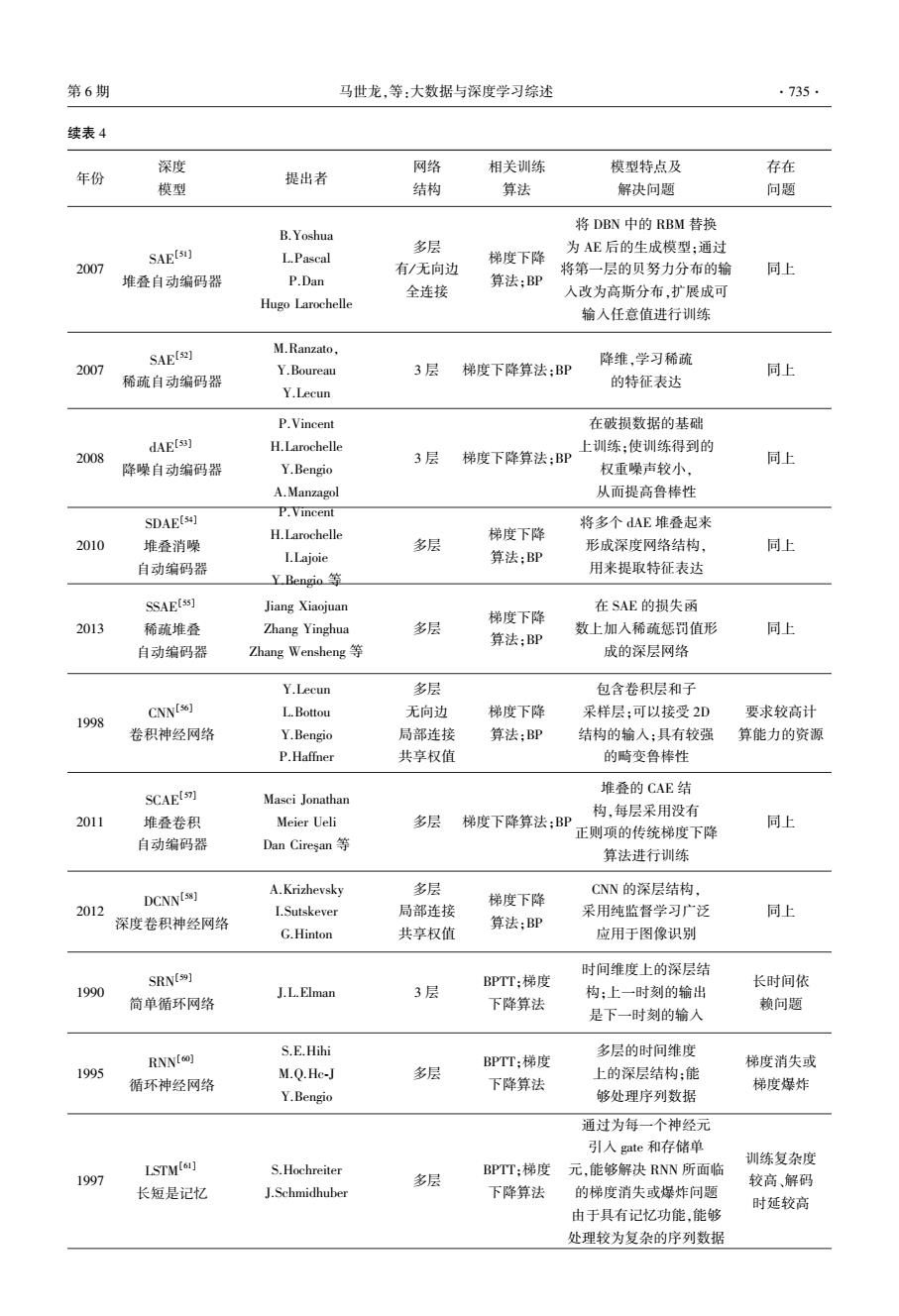

第6期 马世龙,等:大数据与深度学习综述 ·735· 续表4 深度 网络 相关训练 模型特点及 存在 年份 模型 提出者 结构 算法 解决问题 问题 将DBN中的RBM替换 B.Yoshua SAE[sI] 多层 为AE后的生成模型:通过 L.Pascal 梯度下降 2007 有/无向边 将第一层的贝努力分布的输 同上 堆叠自动编码器 P.Dan 算法:BP 全连接 入改为高斯分布,扩展成可 Hugo Larochelle 输入任意值进行训练 SAE[52] M.Ranzato, 降维,学习稀疏 2007 Y.Boureau 3层 梯度下降算法:BP 同上 稀疏自动编码器 的特征表达 Y.Lecun P.Vincent 在破损数据的基础 dAE[53) H.Larochelle 上训练:使训练得到的 2008 3层 梯度下降算法:BP 同上 降噪自动编码器 Y.Bengio 权重噪声较小, A.Manzagol 从而提高鲁棒性 SDAE(s4] P.Vincent H.Larochelle 堆叠消噪 梯度下降 将多个dAE堆叠起来 2010 多层 形成深度网络结构、 同上 L.Lajoie 算法:BP 自动编码器 用来提取特征表达 Y Bengio等 SSAE[s5] Jiang Xiaojuan 在SAE的损失函 梯度下降 2013 稀疏堆叠 Zhang Yinghua 多层 数上加入稀疏惩罚值形 同上 算法;BP 自动编码器 Zhang Wensheng等 成的深层网络 Y.Lecun 多层 包含卷积层和子 CNN[56] L.Bottou 无向边 梯度下降 采样层;可以接受2D 要求较高计 1998 卷积神经网络 Y.Bengio 局部连接 算法;BP 结构的输入:具有较强 算能力的资源 P.Haffner 共享权值 的畸变鲁棒性 SCAEts7) 堆叠的CAE结 Masci Jonathan 构,每层采用没有 2011 堆叠卷积 Meier Ueli 多层 梯度下降算法;BP 同上 正则项的传统梯度下降 自动编码器 Dan Ciresan等 算法进行训练 DCNNIs8] A.Krizhevsky 多层 CNN的深层结构, 梯度下降 2012 I.Sutskever 局部连接 采用纯监督学习广泛 同上 深度卷积神经网络 算法;BP G.Hinton 共享权值 应用于图像识别 SRN(59] 时间维度上的深层结 BPTT:梯度 长时间依 1990 J.L.Elman 3层 构:上一时刻的输出 简单循环网络 下降算法 赖问题 是下一时刻的输入 RNN[0] S.E.Hihi 多层的时间维度 BPTT:梯度 梯度消失或 1995 M.Q.He-J 多层 上的深层结构:能 循环神经网络 下降算法 梯度爆炸 Y.Bengio 够处理序列数据 通过为每一个神经元 引入gate和存储单 LSTMI61] 训练复杂度 S.Hochreiter BPTT:梯度 元,能够解决RNN所面临 1997 多层 较高、解码 长短是记忆 J.Schmidhuber 下降算法 的梯度消失或爆炸问题 时延较高 由于具有记忆功能,能够 处理较为复杂的序列数据续表 4 年份 深度 模型 提出者 网络 结构 相关训练 算法 模型特点及 解决问题 存在 问题 2007 SAE [51] 堆叠自动编码器 B.Yoshua L.Pascal P.Dan Hugo Larochelle 多层 有/ 无向边 全连接 梯度下降 算法;BP 将 DBN 中的 RBM 替换 为 AE 后的生成模型;通过 将第一层的贝努力分布的输 入改为高斯分布,扩展成可 输入任意值进行训练 同上 2007 SAE [52] 稀疏自动编码器 M.Ranzato, Y.Boureau Y.Lecun 3 层 梯度下降算法;BP 降维,学习稀疏 的特征表达 同上 2008 dAE [53] 降噪自动编码器 P.Vincent H.Larochelle Y.Bengio A.Manzagol 3 层 梯度下降算法;BP 在破损数据的基础 上训练;使训练得到的 权重噪声较小, 从而提高鲁棒性 同上 2010 SDAE [54] 堆叠消噪 自动编码器 P.Vincent H.Larochelle I.Lajoie Y.Bengio 等 多层 梯度下降 算法;BP 将多个 dAE 堆叠起来 形成深度网络结构, 用来提取特征表达 同上 2013 SSAE [55] 稀疏堆叠 自动编码器 Jiang Xiaojuan Zhang Yinghua Zhang Wensheng 等 多层 梯度下降 算法;BP 在 SAE 的损失函 数上加入稀疏惩罚值形 成的深层网络 同上 1998 CNN [56] 卷积神经网络 Y.Lecun L.Bottou Y.Bengio P.Haffner 多层 无向边 局部连接 共享权值 梯度下降 算法;BP 包含卷积层和子 采样层;可以接受 2D 结构的输入;具有较强 的畸变鲁棒性 要求较高计 算能力的资源 2011 SCAE [57] 堆叠卷积 自动编码器 Masci Jonathan Meier Ueli Dan Cireşan 等 多层 梯度下降算法;BP 堆叠的 CAE 结 构,每层采用没有 正则项的传统梯度下降 算法进行训练 同上 2012 DCNN [58] 深度卷积神经网络 A.Krizhevsky I.Sutskever G.Hinton 多层 局部连接 共享权值 梯度下降 算法;BP CNN 的深层结构, 采用纯监督学习广泛 应用于图像识别 同上 1990 SRN [59] 简单循环网络 J.L.Elman 3 层 BPTT;梯度 下降算法 时间维度上的深层结 构;上一时刻的输出 是下一时刻的输入 长时间依 赖问题 1995 RNN [60] 循环神经网络 S.E.Hihi M.Q.Hc⁃J Y.Bengio 多层 BPTT;梯度 下降算法 多层的时间维度 上的深层结构;能 够处理序列数据 梯度消失或 梯度爆炸 1997 LSTM [61] 长短是记忆 S.Hochreiter J.Schmidhuber 多层 BPTT;梯度 下降算法 通过为每一个神经元 引入 gate 和存储单 元,能够解决 RNN 所面临 的梯度消失或爆炸问题 由于具有记忆功能,能够 处理较为复杂的序列数据 训练复杂度 较高、解码 时延较高 第 6 期 马世龙,等:大数据与深度学习综述 ·735·