正在加载图片...

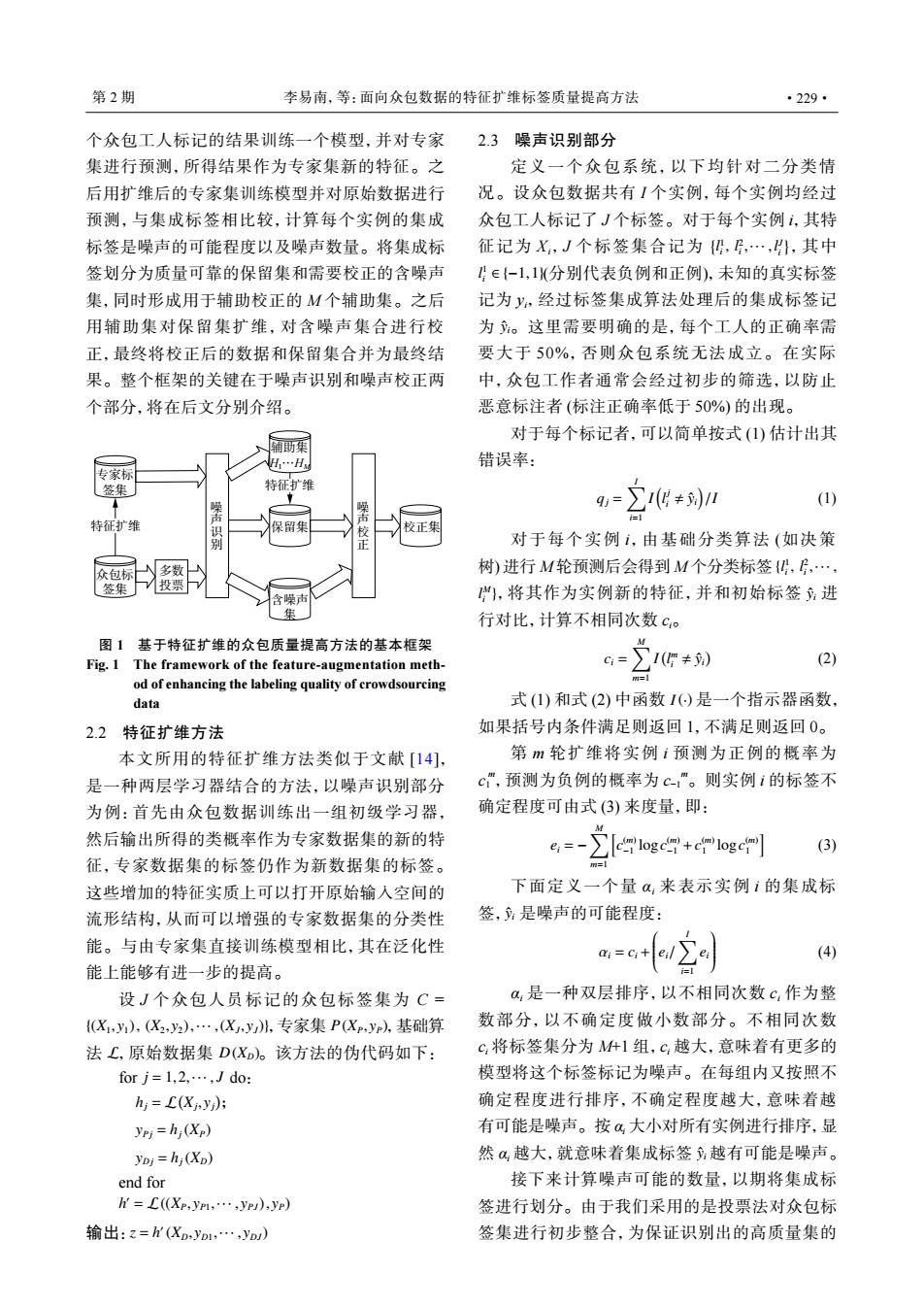

第2期 李易南,等:面向众包数据的特征扩维标签质量提高方法 ·229· 个众包工人标记的结果训练一个模型,并对专家 2.3噪声识别部分 集进行预测,所得结果作为专家集新的特征。之 定义一个众包系统,以下均针对二分类情 后用扩维后的专家集训练模型并对原始数据进行 况。设众包数据共有I个实例,每个实例均经过 预测,与集成标签相比较,计算每个实例的集成 众包工人标记了J个标签。对于每个实例i,其特 标签是噪声的可能程度以及噪声数量。将集成标 征记为X,J个标签集合记为{,,…,,其中 签划分为质量可靠的保留集和需要校正的含噪声 1∈{-1,1(分别代表负例和正例),未知的真实标签 集,同时形成用于辅助校正的M个辅助集。之后 记为y,经过标签集成算法处理后的集成标签记 用铺助集对保留集扩维,对含噪声集合进行校 为。这里需要明确的是,每个工人的正确率需 正,最终将校正后的数据和保留集合并为最终结 要大于50%,否则众包系统无法成立。在实际 果。整个框架的关键在于噪声识别和噪声校正两 中,众包工作者通常会经过初步的筛选,以防止 个部分,将在后文分别介绍。 恶意标注者(标注正确率低于50%)的出现。 对于每个标记者,可以简单按式(1)估计出其 助集 H…H 错误率: 特征扩维 (1) 特征扩维 留集 别 对于每个实例,由基础分类算法(如决策 众包标 人多数」 树)进行M轮预测后会得到M个分类标签{,,…, 签集 投票 ),将其作为实例新的特征,并和初始标签产进 行对比,计算不相同次数C。 图1基于特征扩维的众包质量提高方法的基本框架 Fig.1 The framework of the feature-augmentation meth- ci= (2) od of enhancing the labeling quality of crowdsourcing data 式(1)和式(2)中函数1()是一个指示器函数, 2.2特征扩维方法 如果括号内条件满足则返回1,不满足则返回0。 本文所用的特征扩维方法类似于文献[14], 第m轮扩维将实例i预测为正例的概率为 是一种两层学习器结合的方法,以噪声识别部分 c,预测为负例的概率为c-”。则实例i的标签不 为例:首先由众包数据训练出一组初级学习器, 确定程度可由式(3)来度量,即: 然后输出所得的类概率作为专家数据集的新的特 e=- cilogc+cm logcm (3) 征,专家数据集的标签仍作为新数据集的标签。 这些增加的特征实质上可以打开原始输入空间的 下面定义一个量a,来表示实例i的集成标 流形结构,从而可以增强的专家数据集的分类性 签,是噪声的可能程度: 能。与由专家集直接训练模型相比,其在泛化性 ai=ci+lei/ (4) 能上能够有进一步的提高。 设J个众包人员标记的众包标签集为C= a,是一种双层排序,以不相同次数c,作为整 {X,),(X22),…,(X,yh,专家集P(X,yp),基础算 数部分,以不确定度做小数部分。不相同次数 法C,原始数据集D(X)。该方法的伪代码如下: c,将标签集分为M什1组,C,越大,意味着有更多的 forj=1,2,…,Jdo: 模型将这个标签标记为噪声。在每组内又按照不 hj=L(Xj.y ) 确定程度进行排序,不确定程度越大,意味着越 yri=hj(Xp) 有可能是噪声。按4大小对所有实例进行排序,显 yDj=hj(Xp) 然α越大,就意味着集成标签越有可能是噪声。 end for 接下来计算噪声可能的数量,以期将集成标 H=(Xp,yPI,…,yp),yp) 签进行划分。由于我们采用的是投票法对众包标 输出:z=H(Xoyp1,…yD) 签集进行初步整合,为保证识别出的高质量集的个众包工人标记的结果训练一个模型,并对专家 集进行预测,所得结果作为专家集新的特征。之 后用扩维后的专家集训练模型并对原始数据进行 预测,与集成标签相比较,计算每个实例的集成 标签是噪声的可能程度以及噪声数量。将集成标 签划分为质量可靠的保留集和需要校正的含噪声 集,同时形成用于辅助校正的 M 个辅助集。之后 用辅助集对保留集扩维,对含噪声集合进行校 正,最终将校正后的数据和保留集合并为最终结 果。整个框架的关键在于噪声识别和噪声校正两 个部分,将在后文分别介绍。 保留集 校正集 专家标 签集 众包标 签集 特征扩维 多数 投票 含噪声 集 辅助集 H1…HM 特征扩维 噪声识别 噪声校正 图 1 基于特征扩维的众包质量提高方法的基本框架 Fig. 1 The framework of the feature-augmentation method of enhancing the labeling quality of crowdsourcing data 2.2 特征扩维方法 本文所用的特征扩维方法类似于文献 [14], 是一种两层学习器结合的方法,以噪声识别部分 为例:首先由众包数据训练出一组初级学习器, 然后输出所得的类概率作为专家数据集的新的特 征,专家数据集的标签仍作为新数据集的标签。 这些增加的特征实质上可以打开原始输入空间的 流形结构,从而可以增强的专家数据集的分类性 能。与由专家集直接训练模型相比,其在泛化性 能上能够有进一步的提高。 {(X1, y1), (X2, y2),··· ,(XJ , yJ )} P(XP, yP) L D(XD) 设 J 个众包人员标记的众包标签集为 C = ,专家集 ,基础算 法 ,原始数据集 。该方法的伪代码如下: for j = 1,2,··· , J do: hj = L ( Xj , yj ) ; yP j = hj(XP) yD j = hj(XD) end for h ′ = L((XP, yP1,··· , yPJ ), yP) z = h ′ 输出: (XD, yD1,··· , yDJ ) 2.3 噪声识别部分 { l 1 i , l 2 i ,··· ,l J i } l 1 i ∈ {−1,1} yˆi 定义一个众包系统,以下均针对二分类情 况。设众包数据共有 I 个实例,每个实例均经过 众包工人标记了 J 个标签。对于每个实例 i,其特 征记为 Xi,J 个标签集合记为 ,其中 (分别代表负例和正例),未知的真实标签 记为 yi,经过标签集成算法处理后的集成标签记 为 。这里需要明确的是,每个工人的正确率需 要大于 50%,否则众包系统无法成立。在实际 中,众包工作者通常会经过初步的筛选,以防止 恶意标注者 (标注正确率低于 50%) 的出现。 对于每个标记者,可以简单按式 (1) 估计出其 错误率: qj = ∑I i=1 I ( l j i , yˆi ) /I (1) {l 1 i , l 2 i ,··· , l M i } yˆi 对于每个实例 i,由基础分类算法 (如决策 树) 进行 M 轮预测后会得到 M 个分类标签 ,将其作为实例新的特征,并和初始标签 进 行对比,计算不相同次数 ci。 ci = ∑M m=1 I ( l m i , yˆi ) (2) 式 (1) 和式 (2) 中函数 I(·) 是一个指示器函数, 如果括号内条件满足则返回 1,不满足则返回 0。 第 m 轮扩维将实例 i 预测为正例的概率为 c1 m ,预测为负例的概率为 c−1 m。则实例 i 的标签不 确定程度可由式 (3) 来度量,即: ei = − ∑M m=1 [ c (m) −1 logc (m) −1 +c (m) 1 logc (m) 1 ] (3) yˆi 下面定义一个量 αi 来表示实例 i 的集成标 签, 是噪声的可能程度: αi = ci + ei/ ∑I i=1 ei (4) yˆi αi 是一种双层排序,以不相同次数 ci 作为整 数部分,以不确定度做小数部分。不相同次数 ci 将标签集分为 M+1 组,ci 越大,意味着有更多的 模型将这个标签标记为噪声。在每组内又按照不 确定程度进行排序,不确定程度越大,意味着越 有可能是噪声。按 αi 大小对所有实例进行排序,显 然 αi 越大,就意味着集成标签 越有可能是噪声。 接下来计算噪声可能的数量,以期将集成标 签进行划分。由于我们采用的是投票法对众包标 签集进行初步整合,为保证识别出的高质量集的 第 2 期 李易南,等:面向众包数据的特征扩维标签质量提高方法 ·229·