正在加载图片...

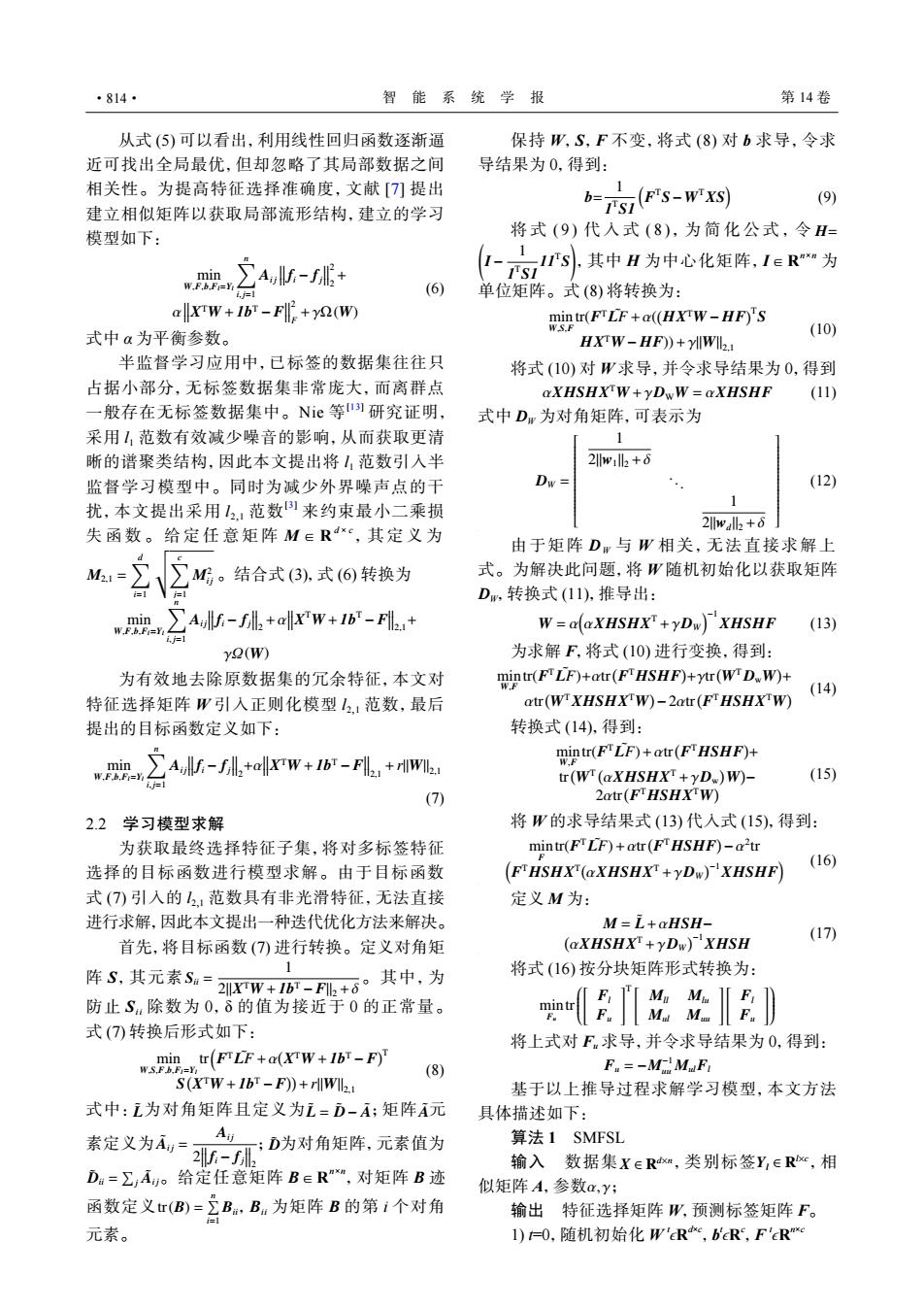

·814· 智能系统学报 第14卷 从式(⑤)可以看出,利用线性回归函数逐渐逼 保持W,S,F不变,将式(8)对b求导,令求 近可找出全局最优,但却忽略了其局部数据之间 导结果为0,得到: 相关性。为提高特征选择准确度,文献[7)]提出 1 (9) 建立相似矩阵以获取局部流形结构,建立的学习 b-Tsi(F'S-Wxs) 模型如下: 将式(9)代入式(8),为简化公式,令H= 盟之4-成+ 其中H为中心化矩陈.IeR为 I- i.l (6) 单位矩阵。式(8)将转换为: alXW+Ib-F+y2(W) (FLF+a((HXW-HF)'S 式中a为平衡参数。 (10) HXW-HF))+yllWll 半监督学习应用中,已标签的数据集往往只 将式(10)对W求导,并令求导结果为0,得到 占据小部分,无标签数据集非常庞大,而离群点 aXHSHXTW+yDwW=aXHSHF (11) 一般存在无标签数据集中。Nie等I)研究证明, 式中Dm为对角矩阵,可表示为 采用(,范数有效减少噪音的影响,从而获取更清 1 晰的谱聚类结构,因此本文提出将1范数引入半 2lw1l2+6 监督学习模型中。同时为减少外界噪声点的干 Dw= (12) 扰,本文提出采用12:范数来约束最小二乘损 2llwallk +6 失函数。给定任意矩阵M∈Raxc,其定义为 由于矩阵Dm与W相关,无法直接求解上 M=公区G,结合式队式回转换为 式。为解决此问题,将W随机初始化以获取矩阵 D,转换式(11),推导出: ∑A-fl+aKw+B-FLt W=a(aXHSHXT+yDw)XHSHF (13) y2(W) 为求解F,将式(10)进行变换,得到: 为有效地去除原数据集的冗余特征,本文对 ipu(FTLF)+ot(FHSHF)+yt(WD.W)+ (14) 特征选择矩阵W引入正则化模型12!范数,最后 atr(WTXHSHXW)-2atr(FTHSHXW) 提出的目标函数定义如下: 转换式(14),得到: iutallxw++wlk ipt(FLF)+at(FHSHF) tr(WT(aXHSHXT+yD.)W)- (15) (7) 2atr(FHSHXW) 2.2学习模型求解 将W的求导结果式(13)代入式(15),得到: 为获取最终选择特征子集,将对多标签特征 mintr(FTLF)+atr(FTHSHF)-a2tr 选择的目标函数进行模型求解。由于目标函数 (FHSHX(aXHSHXT+yDw)'XHSHF) (16) 式(7)引入的12,:范数具有非光滑特征,无法直接 定义M为: 进行求解,因此本文提出一种迭代优化方法来解决。 M=L+aHSH- (17) 首先,将目标函数(⑦)进行转换。定义对角矩 (aXHSHXT+yDw))XHSH 阵S,其元素S:=2xw+D-F业+6。其中,为 将式(16)按分块矩阵形式转换为: 防止S:除数为0,δ的值为接近于0的正常量。 mintr F TI MM F lF.MaM]F. 式(7)转换后形式如下: 将上式对F求导,并令求导结果为0,得到: wsy(FLF+a(XTW+1bT-F) (8) F=-M MF S(XTW+1bT-F))+rllWlk 基于以上推导过程求解学习模型,本文方法 式中:i为对角矩阵且定义为i=D-A;矩阵A元 具体描述如下: A 素定文为A,:D为对角矩阵,元素值为 算法1 SMFSL 输入数据集X∈Rm,类别标签Y,∈Rc,相 D:=∑,Aj。给定任意矩阵B∈R"”,对矩阵B迹 似矩阵A,参数a,y: 函数定义m(B)=宫B,B,为矩阵B的第1个对角 输出特征选择矩阵W,预测标签矩阵F。 元素。 I)=O,随机初始化WR,bR,F'Rmxc从式 (5) 可以看出,利用线性回归函数逐渐逼 近可找出全局最优,但却忽略了其局部数据之间 相关性。为提高特征选择准确度,文献 [7] 提出 建立相似矩阵以获取局部流形结构,建立的学习 模型如下: min W,F,b,Fl=Yl ∑n i, j=1 Ai j fi − fj 2 2 + α X TW +1b T − F 2 F +γΩ(W) (6) 式中 α 为平衡参数。 M2,1 = ∑d i=1 vt∑c j=1 M2 i j 半监督学习应用中,已标签的数据集往往只 占据小部分,无标签数据集非常庞大,而离群点 一般存在无标签数据集中。Nie 等 [13] 研究证明, 采用 l1 范数有效减少噪音的影响,从而获取更清 晰的谱聚类结构,因此本文提出将 l1 范数引入半 监督学习模型中。同时为减少外界噪声点的干 扰,本文提出采用 l2,1 范数[3] 来约束最小二乘损 失函数。给定任意矩 阵 M∈R d × c ,其定义为 。结合式 (3),式 (6) 转换为 min W,F,b,Fl=Yl ∑n i, j=1 Ai j fi − fj 2 +α X TW +1b T − F 2,1 + γΩ(W) 为有效地去除原数据集的冗余特征,本文对 特征选择矩阵 W 引入正则化模型 l2,1 范数,最后 提出的目标函数定义如下: min W,F,b,Fl=Yl ∑n i, j=1 Ai j fi − fj 2 +α X TW +1b T − F 2,1 +r∥W∥2,1 (7) 2.2 学习模型求解 为获取最终选择特征子集,将对多标签特征 选择的目标函数进行模型求解。由于目标函数 式 (7) 引入的 l2,1 范数具有非光滑特征,无法直接 进行求解,因此本文提出一种迭代优化方法来解决。 Sii = 1 2∥XTW +1b T − F∥2 +δ 首先,将目标函数 (7) 进行转换。定义对角矩 阵 S,其元素 。其中,为 防止 Sii 除数为 0,δ 的值为接近于 0 的正常量。 式 (7) 转换后形式如下: min W,S,F,b,Fl=Yl tr( F T L˜F +α ( X TW +1b T − F )T S ( X TW +1b T − F ))+r∥W∥2,1 (8) L˜ L˜ = D˜ − A˜ A˜ A˜ i j = Ai j 2 fi − fj 2 D˜ D˜ ii = ∑ j A˜ i j tr(B) = ∑n i=1 Bii 式中: 为对角矩阵且定义为 ;矩阵 元 素定义为 ; 为对角矩阵,元素值为 。给定任意矩阵 B∈R n×n ,对矩阵 B 迹 函数定义 ,Bii 为矩阵 B 的第 i 个对角 元素。 保持 W,S,F 不变,将式 (8) 对 b 求导,令求 导结果为 0,得到: b= 1 1 T S1 ( F TS−WTXS) (9) H= ( I− 1 1 T S1 11T S ) 将 式 ( 9 ) 代 入 式 (8) ,为简化公式,令 ,其中 H 为中心化矩阵,I∈R n×n 为 单位矩阵。式 (8) 将转换为: min W,S,F tr(F T L˜F +α( ( HXTW − HF)T S HXTW − HF))+γ∥W∥2,1 (10) 将式 (10) 对 W 求导,并令求导结果为 0,得到 αXHSHXTW +γDWW = αXHSHF (11) 式中 DW 为对角矩阵,可表示为 DW = 1 2∥w1∥2 +δ . . . 1 2∥wd∥2 +δ (12) 由于矩阵 D W 与 W 相关,无法直接求解上 式。为解决此问题,将 W 随机初始化以获取矩阵 DW,转换式 (11),推导出: W = α ( αXHSHXT +γDW )−1 XHSHF (13) 为求解 F,将式 (10) 进行变换,得到: min W,F tr(F T L˜F)+αtr( F THSHF) +γtr( WT DwW ) + αtr( WTXHSHXTW ) −2αtr( F THSHXTW ) (14) 转换式 (14),得到: min W,F tr(F T L˜F)+αtr( F THSHF) + tr( WT ( αXHSHXT +γDw ) W ) − 2αtr( F THSHXTW ) (15) 将 W 的求导结果式 (13) 代入式 (15),得到: min F tr(F T L˜F)+αtr( F THSHF) −α 2 tr ( F THSHXT ( αXHSHXT +γDW )−1 XHSHF) (16) 定义 M 为: M = L˜ +αHSH− ( αXHSHXT +γDW )−1 XHSH (17) 将式 (16) 按分块矩阵形式转换为: min Fu tr [ Fl Fu ]T [ Mll Mul Mlu Muu ] [ Fl Fu ] 将上式对 Fu 求导,并令求导结果为 0,得到: Fu = −M−1 uu MulFl 基于以上推导过程求解学习模型,本文方法 具体描述如下: 算法 1 SMFSL X ∈ R d×n Yl ∈ R l×c α, γ 输入 数据集 ,类别标签 ,相 似矩阵 A,参数 ; 输出 特征选择矩阵 W,预测标签矩阵 F。 1) t=0,随机初始化 W t ϵR d×c ,b t ϵR c ,F t ϵR n×c ·814· 智 能 系 统 学 报 第 14 卷