正在加载图片...

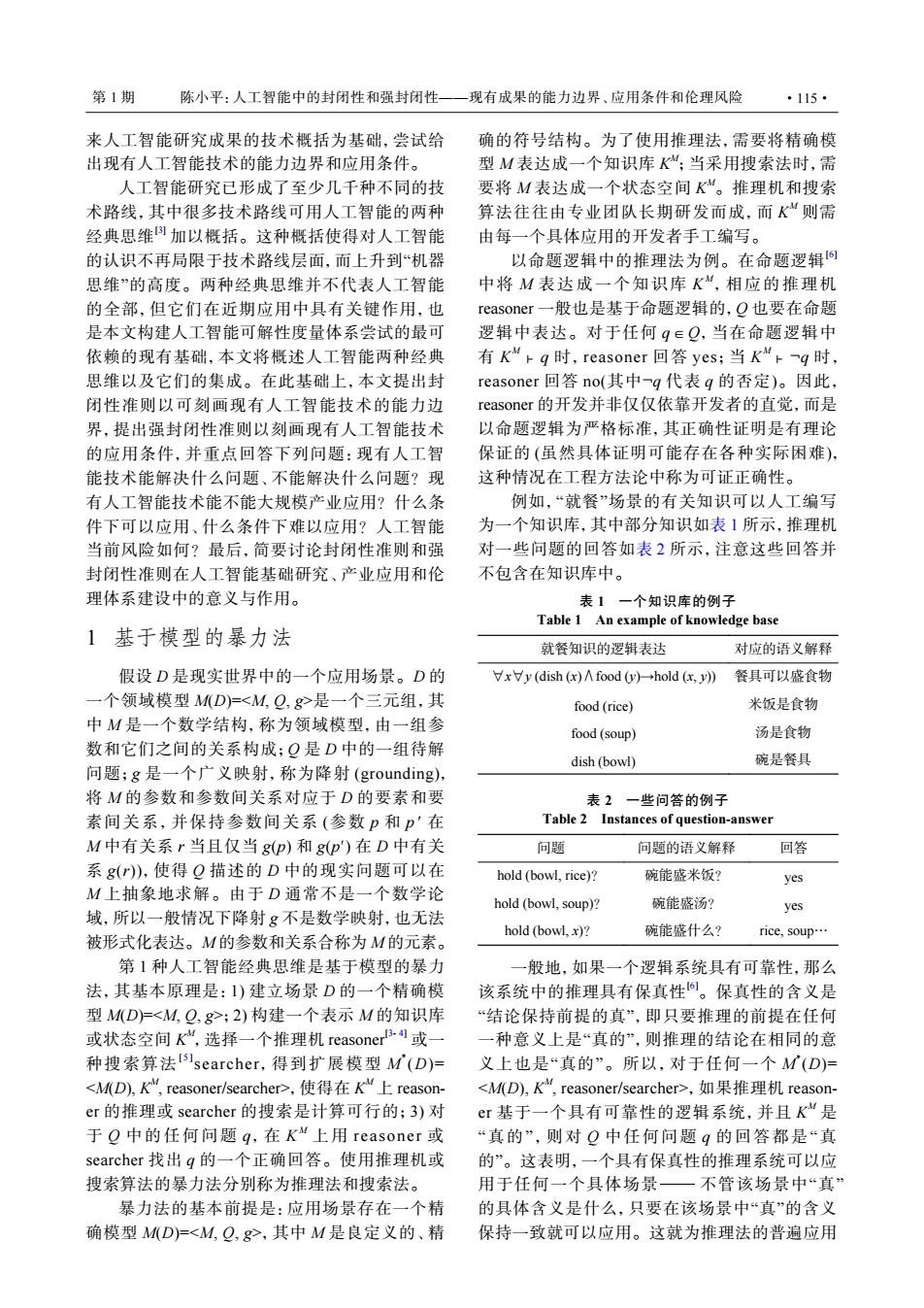

第1期 陈小平:人工智能中的封闭性和强封闭性一一现有成果的能力边界、应用条件和伦理风险 ·115· 来人工智能研究成果的技术概括为基础,尝试给 确的符号结构。为了使用推理法,需要将精确模 出现有人工智能技术的能力边界和应用条件。 型M表达成一个知识库K;当采用搜索法时,需 人工智能研究已形成了至少几千种不同的技 要将M表达成一个状态空间K“。推理机和搜索 术路线,其中很多技术路线可用人工智能的两种 算法往往由专业团队长期研发而成,而K“则需 经典思维1加以概括。这种概括使得对人工智能 由每一个具体应用的开发者手工编写。 的认识不再局限于技术路线层面,而上升到“机器 以命题逻辑中的推理法为例。在命题逻辑( 思维”的高度。两种经典思维并不代表人工智能 中将M表达成一个知识库K“,相应的推理机 的全部,但它们在近期应用中具有关键作用,也 reasoner一般也是基于命题逻辑的,Q也要在命题 是本文构建人工智能可解性度量体系尝试的最可 逻辑中表达。对于任何q∈Q,当在命题逻辑中 依赖的现有基础,本文将概述人工智能两种经典 有Kkg时,reasoner回答yes;当K“,一q时, 思维以及它们的集成。在此基础上,本文提出封 reasoner回答no(其中一g代表g的否定)。因此, 闭性准则以可刻画现有人工智能技术的能力边 reasoner的开发并非仅仅依靠开发者的直觉,而是 界,提出强封闭性准则以刻画现有人工智能技术 以命题逻辑为严格标准,其正确性证明是有理论 的应用条件,并重点回答下列问题:现有人工智 保证的(虽然具体证明可能存在各种实际困难), 能技术能解决什么问题、不能解决什么问题?现 这种情况在工程方法论中称为可证正确性。 有人工智能技术能不能大规模产业应用?什么条 例如,“就餐”场景的有关知识可以人工编写 件下可以应用、什么条件下难以应用?人工智能 为一个知识库,其中部分知识如表1所示,推理机 当前风险如何?最后,简要讨论封闭性准则和强 对一些问题的回答如表2所示,注意这些回答并 封闭性准则在人工智能基础研究、产业应用和伦 不包含在知识库中。 理体系建设中的意义与作用。 表1一个知识库的例子 Table 1 An example of knowledge base 基于模型的暴力法 就餐知识的逻辑表达 对应的语义解释 假设D是现实世界中的一个应用场景。D的 xvy (dish (x)A food (y)hold (x,y)) 餐具可以盛食物 一个领域模型M(D)=<M,Q,g>是一个三元组,其 food (rice) 米饭是食物 中M是一个数学结构,称为领域模型,由一组参 food(soup) 汤是食物 数和它们之间的关系构成;Q是D中的一组待解 dish (bowl) 碗是餐具 问题;g是一个广义映射,称为降射(grounding), 将M的参数和参数间关系对应于D的要素和要 表2一些问答的例子 素间关系,并保持参数间关系(参数p和p'在 Table 2 Instances of question-answer M中有关系r当且仅当g(p)和g(p)在D中有关 问题 问题的语义解释 回答 系g(r),使得Q描述的D中的现实问题可以在 hold (bowl,rice)? 碗能盛米饭? yes M上抽象地求解。由于D通常不是一个数学论 hold (bowl,soup)? 碗能盛汤? yes 域,所以一般情况下降射g不是数学映射,也无法 被形式化表达。M的参数和关系合称为M的元素。 hold (bowl,x)? 碗能盛什么? rice,soup“ 第1种人工智能经典思维是基于模型的暴力 般地,如果一个逻辑系统具有可靠性,那么 法,其基本原理是:1)建立场景D的一个精确模 该系统中的推理具有保真性向。保真性的含义是 型M(D)=<M,Q,g>;2)构建一个表示M的知识库 “结论保持前提的真”,即只要推理的前提在任何 或状态空间选择一个推理机reasoner或一 一种意义上是“真的”,则推理的结论在相同的意 种搜索算法Islsearcher,得到扩展模型M(D)= 义上也是“真的”。所以,对于任何一个M(D)= <MD),K,reasoner/.searcher>,使得在K上reason-- <M(D),K,reasoner/searcher>,如果推理机reason- er的推理或searcher的搜索是计算可行的;3)对 er基于一个具有可靠性的逻辑系统,并且K“是 于Q中的任何问题q,在K“上用reasoner或 “真的”,则对Q中任何问题q的回答都是“真 searcher找出g的一个正确回答。使用推理机或 的”。这表明,一个具有保真性的推理系统可以应 搜索算法的暴力法分别称为推理法和搜索法。 用于任何一个具体场景一不管该场景中“真” 暴力法的基本前提是:应用场景存在一个精 的具体含义是什么,只要在该场景中“真”的含义 确模型MD)=<M,Q,g>,其中M是良定义的、精 保持一致就可以应用。这就为推理法的普遍应用来人工智能研究成果的技术概括为基础,尝试给 出现有人工智能技术的能力边界和应用条件。 人工智能研究已形成了至少几千种不同的技 术路线,其中很多技术路线可用人工智能的两种 经典思维[3] 加以概括。这种概括使得对人工智能 的认识不再局限于技术路线层面,而上升到“机器 思维”的高度。两种经典思维并不代表人工智能 的全部,但它们在近期应用中具有关键作用,也 是本文构建人工智能可解性度量体系尝试的最可 依赖的现有基础,本文将概述人工智能两种经典 思维以及它们的集成。在此基础上,本文提出封 闭性准则以可刻画现有人工智能技术的能力边 界,提出强封闭性准则以刻画现有人工智能技术 的应用条件,并重点回答下列问题:现有人工智 能技术能解决什么问题、不能解决什么问题?现 有人工智能技术能不能大规模产业应用?什么条 件下可以应用、什么条件下难以应用?人工智能 当前风险如何?最后,简要讨论封闭性准则和强 封闭性准则在人工智能基础研究、产业应用和伦 理体系建设中的意义与作用。 1 基于模型的暴力法 假设 D 是现实世界中的一个应用场景。D 的 一个领域模型 M(D)=<M, Q, g>是一个三元组,其 中 M 是一个数学结构,称为领域模型,由一组参 数和它们之间的关系构成;Q 是 D 中的一组待解 问题;g 是一个广义映射,称为降射 (grounding), 将 M 的参数和参数间关系对应于 D 的要素和要 素间关系,并保持参数间关系 (参数 p 和 p ′ 在 M 中有关系 r 当且仅当 g(p) 和 g(p′) 在 D 中有关 系 g(r)),使得 Q 描述的 D 中的现实问题可以在 M 上抽象地求解。由于 D 通常不是一个数学论 域,所以一般情况下降射 g 不是数学映射,也无法 被形式化表达。M 的参数和关系合称为 M 的元素。 第 1 种人工智能经典思维是基于模型的暴力 法,其基本原理是:1) 建立场景 D 的一个精确模 型 M(D)=<M, Q, g>;2) 构建一个表示 M 的知识库 或状态空间 K M ,选择一个推理机 reasoner [3- 4] 或一 种搜索算法[ 5 ] searcher,得到扩展模型 M * (D)= <M(D), K M , reasoner/searcher>,使得在 K M 上 reasoner 的推理或 searcher 的搜索是计算可行的;3) 对 于 Q 中的任何问题 q,在 K M 上用 reasone r 或 searcher 找出 q 的一个正确回答。使用推理机或 搜索算法的暴力法分别称为推理法和搜索法。 暴力法的基本前提是:应用场景存在一个精 确模型 M(D)=<M, Q, g>,其中 M 是良定义的、精 确的符号结构。为了使用推理法,需要将精确模 型 M 表达成一个知识库 K M ;当采用搜索法时,需 要将 M 表达成一个状态空间 K M。推理机和搜索 算法往往由专业团队长期研发而成,而 K M 则需 由每一个具体应用的开发者手工编写。 ⊢ ⊢ 以命题逻辑中的推理法为例。在命题逻辑[6] 中将 M 表达成一个知识库 K M ,相应的推理机 reasoner 一般也是基于命题逻辑的,Q 也要在命题 逻辑中表达。对于任何 q∈Q,当在命题逻辑中 有 K M q 时 ,reasoner 回答 yes;当 K M ¬q 时 , reasoner 回答 no(其中¬q 代表 q 的否定)。因此, reasoner 的开发并非仅仅依靠开发者的直觉,而是 以命题逻辑为严格标准,其正确性证明是有理论 保证的 (虽然具体证明可能存在各种实际困难), 这种情况在工程方法论中称为可证正确性。 例如,“就餐”场景的有关知识可以人工编写 为一个知识库,其中部分知识如表 1 所示,推理机 对一些问题的回答如表 2 所示,注意这些回答并 不包含在知识库中。 表 1 一个知识库的例子 Table 1 An example of knowledge base 就餐知识的逻辑表达 对应的语义解释 ∀x∀y (dish (x)∧food (y)→hold (x, y)) 餐具可以盛食物 food (rice) 米饭是食物 food (soup) 汤是食物 dish (bowl) 碗是餐具 表 2 一些问答的例子 Table 2 Instances of question-answer 问题 问题的语义解释 回答 hold (bowl, rice)? 碗能盛米饭? yes hold (bowl, soup)? 碗能盛汤? yes hold (bowl, x)? 碗能盛什么? rice, soup… 一般地,如果一个逻辑系统具有可靠性,那么 该系统中的推理具有保真性[6]。保真性的含义是 “结论保持前提的真”,即只要推理的前提在任何 一种意义上是“真的”,则推理的结论在相同的意 义上也是“真的”。所以,对于任何一个 M * (D)= <M(D), K M , reasoner/searcher>,如果推理机 reasoner 基于一个具有可靠性的逻辑系统,并且 K M 是 “真的” ,则对 Q 中任何问题 q 的回答都是“真 的”。这表明,一个具有保真性的推理系统可以应 用于任何一个具体场景−不管该场景中“真” 的具体含义是什么,只要在该场景中“真”的含义 保持一致就可以应用。这就为推理法的普遍应用 第 1 期 陈小平:人工智能中的封闭性和强封闭性——现有成果的能力边界、应用条件和伦理风险 ·115·