正在加载图片...

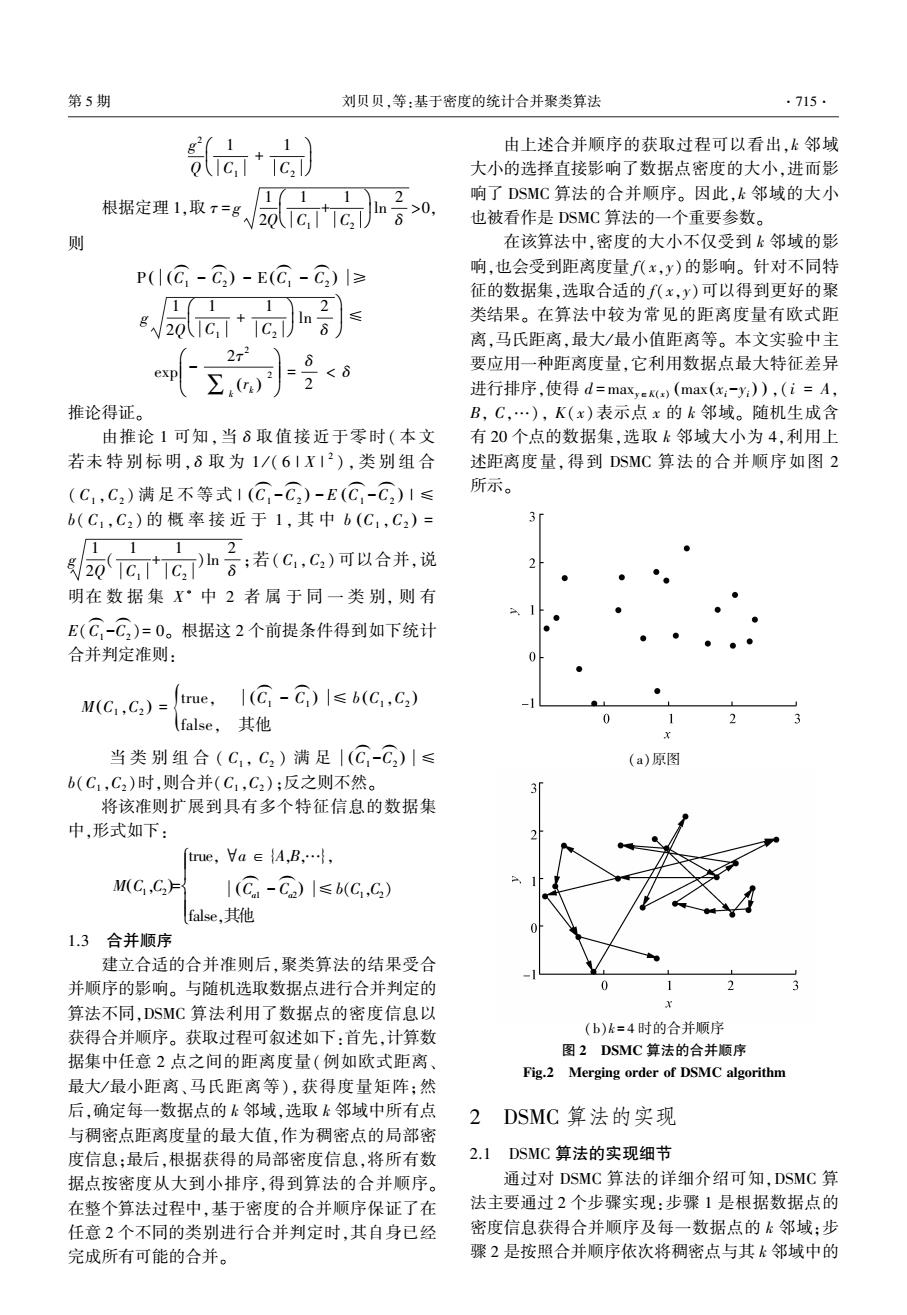

第5期 刘贝贝,等:基于密度的统计合并聚类算法 ·715· 由上述合并顺序的获取过程可以看出,k邻域 大小的选择直接影响了数据点密度的大小,进而影 1(11 2 响了DSMC算法的合并顺序。因此,k邻域的大小 根据定理1,取=gG十Gg血谷>0, 也被看作是DSMC算法的一个重要参数。 则 在该算法中,密度的大小不仅受到k邻域的影 P(I(C-C)-E(G-C)l≥ 响,也会受到距离度量(x,y)的影响。针对不同特 征的数据集,选取合适的f(x,y)可以得到更好的聚 171 类结果。在算法中较为常见的距离度量有欧式距 离,马氏距离,最大/最小值距离等。本文实验中主 2r2 < 要应用一种距离度量,它利用数据点最大特征差异 2 进行排序,使得d=max,eks(max(x:-y:),(i=A, 推论得证。 B,C,…),K(x)表示点x的k邻域。随机生成含 由推论1可知,当δ取值接近于零时(本文 有20个点的数据集,选取k邻域大小为4,利用上 若未特别标明,8取为1/(61X12),类别组合 述距离度量,得到DSMC算法的合并顺序如图2 (C,C2)满足不等式1(C-C3)-E(C,-C)1≤ 所示。 b(C1,C2)的概率接近于1,其中b(C1,C2)= 20TG,7G方:若(G,G)可以合并,说 1 明在数据集X·中2者属于同一类别,则有 E(C,-C,)=0。根据这2个前提条件得到如下统计 合并判定准则: ● M(C1,C2)= |ue,1(G-C)l≤b(C,c) false,其他 当类别组合(C,C,)满足|(C-C)|≤ (a)原图 b(C1,C2)时,则合并(C1,C2);反之则不然。 将该准则扩展到具有多个特征信息的数据集 中,形式如下: ftue,a∈{A,B,…f, M(C,C2上 I(G-Ca)|≤b(C,G) false,其他 1.3合并顺序 建立合适的合并准则后,聚类算法的结果受合 并顺序的影响。与随机选取数据点进行合并判定的 算法不同,DSMC算法利用了数据点的密度信息以 获得合并顺序。获取过程可叙述如下:首先,计算数 (b)k=4时的合并顺序 图2DSMC算法的合并顺序 据集中任意2点之间的距离度量(例如欧式距离、 Fig.2 Merging order of DSMC algorithm 最大/最小距离、马氏距离等),获得度量矩阵:然 后,确定每一数据点的k邻域,选取k邻域中所有点 2DSMC算法的实现 与稠密点距离度量的最大值,作为稠密点的局部密 度信息:最后,根据获得的局部密度信息,将所有数 2.1DSMC算法的实现细节 据点按密度从大到小排序,得到算法的合并顺序。 通过对DSMC算法的详细介绍可知,DSMC算 在整个算法过程中,基于密度的合并顺序保证了在 法主要通过2个步骤实现:步骤1是根据数据点的 任意2个不同的类别进行合并判定时,其自身已经 密度信息获得合并顺序及每一数据点的k邻域:步 完成所有可能的合并。 骤2是按照合并顺序依次将稠密点与其k邻域中的g 2 Q 1 C1 + 1 C2 æ è ç ö ø ÷ 根据定理 1,取 τ = g 1 2Q 1 C1 + 1 C2 æ è ç ö ø ÷ln 2 δ >0, 则 P C1 ( - C2 ( ( ) - E C1 ( - C2 ( ( ( ) ≥ g 1 2Q 1 C1 + 1 C2 æ è ç ö ø ÷ ln 2 δ ö ø ÷ ≤ exp - 2τ 2 ∑k rk ( ) 2 æ è çç ö ø ÷÷ = δ 2 < δ 推论得证。 由推论 1 可知,当 δ 取值接近于零时( 本文 若未 特 别 标 明, δ 取 为 1 / ( 6 | X | 2 ) , 类 别 组 合 ( C1 ,C2 ) 满 足 不 等 式 | C1 ( -C2 ( ( ) - E C1 ( -C2 ( ( ) | ≤ b( C1 ,C2 ) 的 概 率 接 近 于 1, 其 中 b C1 ,C2 ( ) = g 1 2Q ( 1 C1 + 1 C2 )ln 2 δ ;若(C1 ,C2 ) 可以合并,说 明在 数 据 集 X ∗ 中 2 者 属 于 同 一 类 别, 则 有 E(C1 ( -C2 ( )= 0。 根据这 2 个前提条件得到如下统计 合并判定准则: M C1 ,C2 ( ) = true, C1 ( - C1 ( ( ) ≤ b C1 ,C2 ( ) false, 其他 { 当 类 别 组 合 ( C1 , C2 ) 满 足 C1 ( -C2 ( ( ) ≤ b(C1 ,C2 )时,则合并(C1 ,C2 );反之则不然。 将该准则扩展到具有多个特征信息的数据集 中,形式如下: M C1,C2 ( )= true, ∀a ∈{A,B,…}, Ca1 ( - Ca2 ( ( ) ≤b(C1,C2) false,其他 ì î í ï ï ï ï 1.3 合并顺序 建立合适的合并准则后,聚类算法的结果受合 并顺序的影响。 与随机选取数据点进行合并判定的 算法不同,DSMC 算法利用了数据点的密度信息以 获得合并顺序。 获取过程可叙述如下:首先,计算数 据集中任意 2 点之间的距离度量(例如欧式距离、 最大/ 最小距离、马氏距离等),获得度量矩阵;然 后,确定每一数据点的 k 邻域,选取 k 邻域中所有点 与稠密点距离度量的最大值,作为稠密点的局部密 度信息;最后,根据获得的局部密度信息,将所有数 据点按密度从大到小排序,得到算法的合并顺序。 在整个算法过程中,基于密度的合并顺序保证了在 任意 2 个不同的类别进行合并判定时,其自身已经 完成所有可能的合并。 由上述合并顺序的获取过程可以看出,k 邻域 大小的选择直接影响了数据点密度的大小,进而影 响了 DSMC 算法的合并顺序。 因此,k 邻域的大小 也被看作是 DSMC 算法的一个重要参数。 在该算法中,密度的大小不仅受到 k 邻域的影 响,也会受到距离度量 f( x,y)的影响。 针对不同特 征的数据集,选取合适的 f(x,y)可以得到更好的聚 类结果。 在算法中较为常见的距离度量有欧式距 离,马氏距离,最大/ 最小值距离等。 本文实验中主 要应用一种距离度量,它利用数据点最大特征差异 进行排序,使得 d = maxy∈K(x) max xi -yi ( ( ) ) ,( i = A, B, C,…), K( x)表示点 x 的 k 邻域。 随机生成含 有 20 个点的数据集,选取 k 邻域大小为 4,利用上 述距离度量,得到 DSMC 算法的合并顺序如图 2 所示。 (a)原图 (b)k = 4 时的合并顺序 图 2 DSMC 算法的合并顺序 Fig.2 Merging order of DSMC algorithm 2 DSMC 算法的实现 2.1 DSMC 算法的实现细节 通过对 DSMC 算法的详细介绍可知,DSMC 算 法主要通过 2 个步骤实现:步骤 1 是根据数据点的 密度信息获得合并顺序及每一数据点的 k 邻域;步 骤 2 是按照合并顺序依次将稠密点与其 k 邻域中的 第 5 期 刘贝贝,等:基于密度的统计合并聚类算法 ·715·