正在加载图片...

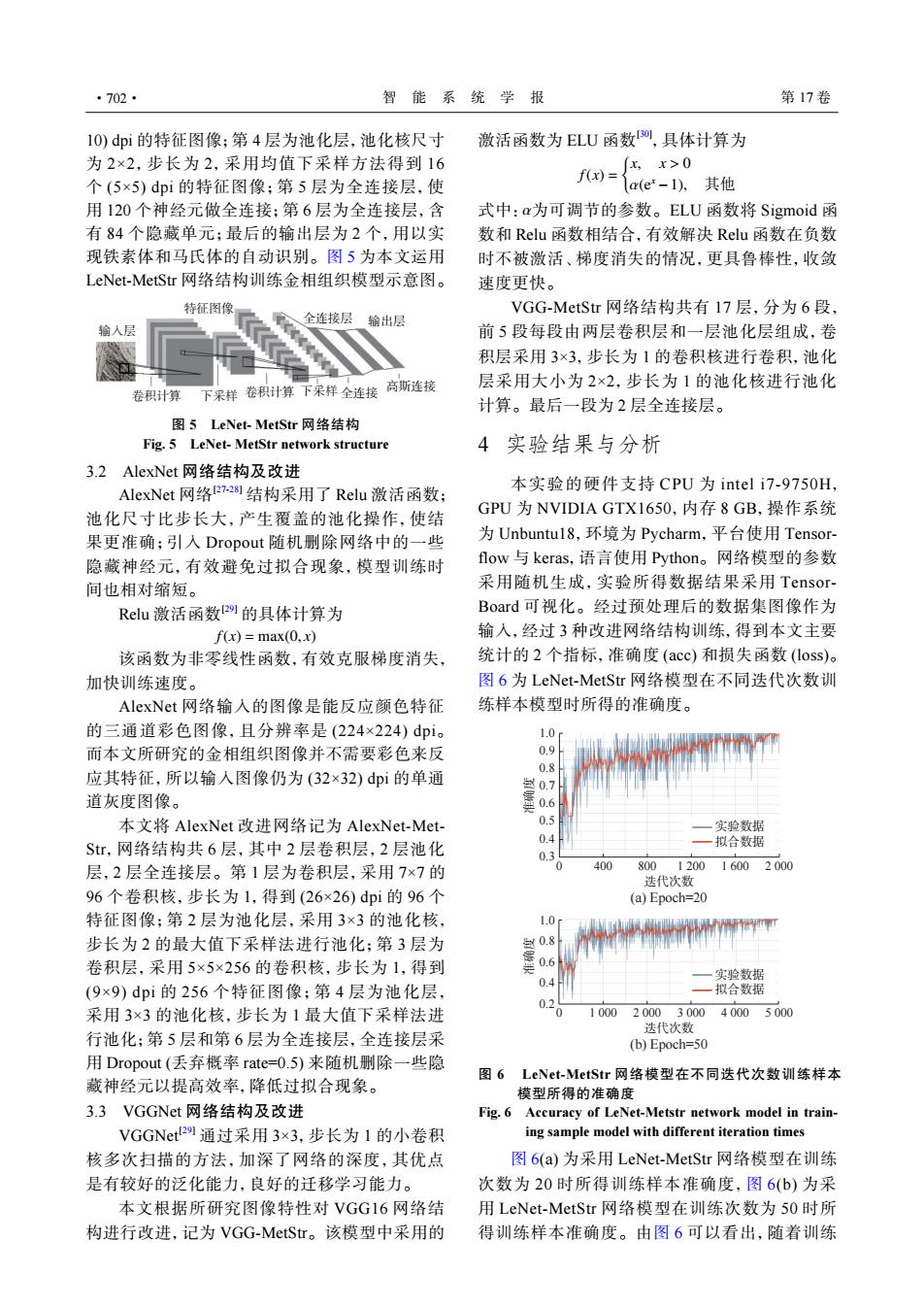

·702· 智能系统学报 第17卷 10)di的特征图像;第4层为池化层,池化核尺寸 激活函数为ELU函数),具体计算为 为2×2,步长为2,采用均值下采样方法得到16 x,x>0 个(5×5)dpi的特征图像;第5层为全连接层,使 f)=ae-1).其他 用120个神经元做全连接:第6层为全连接层,含 式中:a为可调节的参数。ELU函数将Sigmoid函 有84个隐藏单元;最后的输出层为2个,用以实 数和Relu函数相结合,有效解决Relu函数在负数 现铁素体和马氏体的自动识别。图5为本文运用 时不被激活、梯度消失的情况,更具鲁棒性,收敛 LeNet-MetStr网络结构训练金相组织模型示意图。 速度更快。 特征图像 全连接层输出层 VGG-MetStr网络结构共有17层,分为6段, 输人层 前5段每段由两层卷积层和一层池化层组成,卷 积层采用3×3,步长为1的卷积核进行卷积,池化 卷积计算 下采样卷积计算下采样全连接 高斯连接 层采用大小为2×2,步长为1的池化核进行池化 计算。最后一段为2层全连接层。 图5 LeNet-MetStr网络结构 Fig.5 LeNet-MetStr network structure 4实验结果与分析 3.2 AlexNet网络结构及改进 AlexNet网络2-2I结构采用了Relu激活函数; 本实验的硬件支持CPU为intel i7-9750H, 池化尺寸比步长大,产生覆盖的池化操作,使结 GPU为NVIDIA GTX1650,内存8GB,操作系统 果更准确;引入Dropout随机删除网络中的一些 为Unbuntul8,环境为Pycharm,平台使用Tensor- 隐藏神经元,有效避免过拟合现象,模型训练时 flow与keras,语言使用Python。网络模型的参数 间也相对缩短。 采用随机生成,实验所得数据结果采用Tensor- Relu激活函数2的具体计算为 Board可视化。经过预处理后的数据集图像作为 f(x)=max(0,x) 输入,经过3种改进网络结构训练,得到本文主要 该函数为非零线性函数,有效克服梯度消失, 统计的2个指标,准确度(acc)和损失函数(loss)。 加快训练速度。 图6为LeNet-MetStr网络模型在不同迭代次数训l AlexNet网络输入的图像是能反应颜色特征 练样本模型时所得的准确度。 的三通道彩色图像,且分辨率是(224×224)dpi。 1.0 而本文所研究的金相组织图像并不需要彩色来反 0.9 0.8 应其特征,所以输入图像仍为(32×32)dpi的单通 兰0.7 道灰度图像。 是06 本文将AlexNet改进网络记为AlexNet-Met- 0.5 实验数据 0.4 Sr,网络结构共6层,其中2层卷积层,2层池化 一拟合数据 0.3 层,2层全连接层。第1层为卷积层,采用7×7的 400 800120016002000 选代次数 96个卷积核,步长为1,得到(26×26)dpi的96个 (a)Epoch=20 特征图像:第2层为池化层,采用3×3的池化核, 1.0 步长为2的最大值下采样法进行池化;第3层为 0.8 卷积层,采用5×5×256的卷积核,步长为1,得到 是06 实验数据 0.4 (9×9)dpi的256个特征图像;第4层为池化层, 一拟合数据 0.2 采用3×3的池化核,步长为1最大值下采样法进 0 10002000.3000 40005000 迭代次数 行池化;第5层和第6层为全连接层,全连接层采 (b)Epoch=50 用Dropout(丢弃概率rate=O.5)来随机删除一些隐 图6 LeNet-MetStr网络模型在不同迭代次数训练样本 藏神经元以提高效率,降低过拟合现象。 模型所得的准确度 3.3 VGGNet网络结构及改进 Fig.6 Accuracy of LeNet-Metstr network model in train- VGGNet29通过采用3×3,步长为1的小卷积 ing sample model with different iteration times 核多次扫描的方法,加深了网络的深度,其优点 图6(a)为采用LeNet-MetStr网络模型在训练 是有较好的泛化能力,良好的迁移学习能力。 次数为20时所得训练样本准确度,图6(b)为采 本文根据所研究图像特性对VGG16网络结 用LeNet-MetStr网络模型在训练次数为50时所 构进行改进,记为VGG-MetStr。该模型中采用的 得训练样本准确度。由图6可以看出,随着训练10) dpi 的特征图像;第 4 层为池化层,池化核尺寸 为 2×2,步长为 2,采用均值下采样方法得到 16 个 (5×5) dpi 的特征图像;第 5 层为全连接层,使 用 120 个神经元做全连接;第 6 层为全连接层,含 有 84 个隐藏单元;最后的输出层为 2 个,用以实 现铁素体和马氏体的自动识别。图 5 为本文运用 LeNet-MetStr 网络结构训练金相组织模型示意图。 输入层 特征图像 全连接层 输出层 高斯连接 卷积计算 下采样 卷积计算 下采样 全连接 图 5 LeNet- MetStr 网络结构 Fig. 5 LeNet- MetStr network structure 3.2 AlexNet 网络结构及改进 AlexNet 网络[27-28] 结构采用了 Relu 激活函数; 池化尺寸比步长大,产生覆盖的池化操作,使结 果更准确;引入 Dropout 随机删除网络中的一些 隐藏神经元,有效避免过拟合现象,模型训练时 间也相对缩短。 Relu 激活函数[29] 的具体计算为 f(x) = max(0, x) 该函数为非零线性函数,有效克服梯度消失, 加快训练速度。 AlexNet 网络输入的图像是能反应颜色特征 的三通道彩色图像,且分辨率是 (224×224) dpi。 而本文所研究的金相组织图像并不需要彩色来反 应其特征,所以输入图像仍为 (32×32) dpi 的单通 道灰度图像。 本文将 AlexNet 改进网络记为 AlexNet-MetStr,网络结构共 6 层,其中 2 层卷积层,2 层池化 层,2 层全连接层。第 1 层为卷积层,采用 7×7 的 96 个卷积核,步长为 1,得到 (26×26) dpi 的 96 个 特征图像;第 2 层为池化层,采用 3×3 的池化核, 步长为 2 的最大值下采样法进行池化;第 3 层为 卷积层,采用 5×5×256 的卷积核,步长为 1,得到 (9×9) dpi 的 256 个特征图像;第 4 层为池化层, 采用 3×3 的池化核,步长为 1 最大值下采样法进 行池化;第 5 层和第 6 层为全连接层,全连接层采 用 Dropout (丢弃概率 rate=0.5) 来随机删除一些隐 藏神经元以提高效率,降低过拟合现象。 3.3 VGGNet 网络结构及改进 VGGNet[29] 通过采用 3×3,步长为 1 的小卷积 核多次扫描的方法,加深了网络的深度,其优点 是有较好的泛化能力,良好的迁移学习能力。 本文根据所研究图像特性对 VGG16 网络结 构进行改进,记为 VGG-MetStr。该模型中采用的 激活函数为 ELU 函数[30] ,具体计算为 f(x) = { x, x > 0 α(ex −1), 其他 式中:α为可调节的参数。ELU 函数将 Sigmoid 函 数和 Relu 函数相结合,有效解决 Relu 函数在负数 时不被激活、梯度消失的情况,更具鲁棒性,收敛 速度更快。 VGG-MetStr 网络结构共有 17 层,分为 6 段, 前 5 段每段由两层卷积层和一层池化层组成,卷 积层采用 3×3,步长为 1 的卷积核进行卷积,池化 层采用大小为 2×2,步长为 1 的池化核进行池化 计算。最后一段为 2 层全连接层。 4 实验结果与分析 本实验的硬件支持 CPU 为 intel i7-9750H, GPU 为 NVIDIA GTX1650,内存 8 GB,操作系统 为 Unbuntu18,环境为 Pycharm,平台使用 Tensorflow 与 keras,语言使用 Python。网络模型的参数 采用随机生成,实验所得数据结果采用 TensorBoard 可视化。经过预处理后的数据集图像作为 输入,经过 3 种改进网络结构训练,得到本文主要 统计的 2 个指标,准确度 (acc) 和损失函数 (loss)。 图 6 为 LeNet-MetStr 网络模型在不同迭代次数训 练样本模型时所得的准确度。 1.0 0.9 0.8 0.7 0.6 0.5 0.4 0.3 准确度 准确度 0 400 800 1 200 1 600 2 000 迭代次数 0 1 000 2 000 3 000 4 000 5 000 迭代次数 (a) Epoch=20 (b) Epoch=50 实验数据 拟合数据 实验数据 拟合数据 1.0 0.8 0.6 0.4 0.2 图 6 LeNet-MetStr 网络模型在不同迭代次数训练样本 模型所得的准确度 Fig. 6 Accuracy of LeNet-Metstr network model in training sample model with different iteration times 图 6(a) 为采用 LeNet-MetStr 网络模型在训练 次数为 20 时所得训练样本准确度,图 6(b) 为采 用 LeNet-MetStr 网络模型在训练次数为 50 时所 得训练样本准确度。由图 6 可以看出,随着训练 ·702· 智 能 系 统 学 报 第 17 卷