正在加载图片...

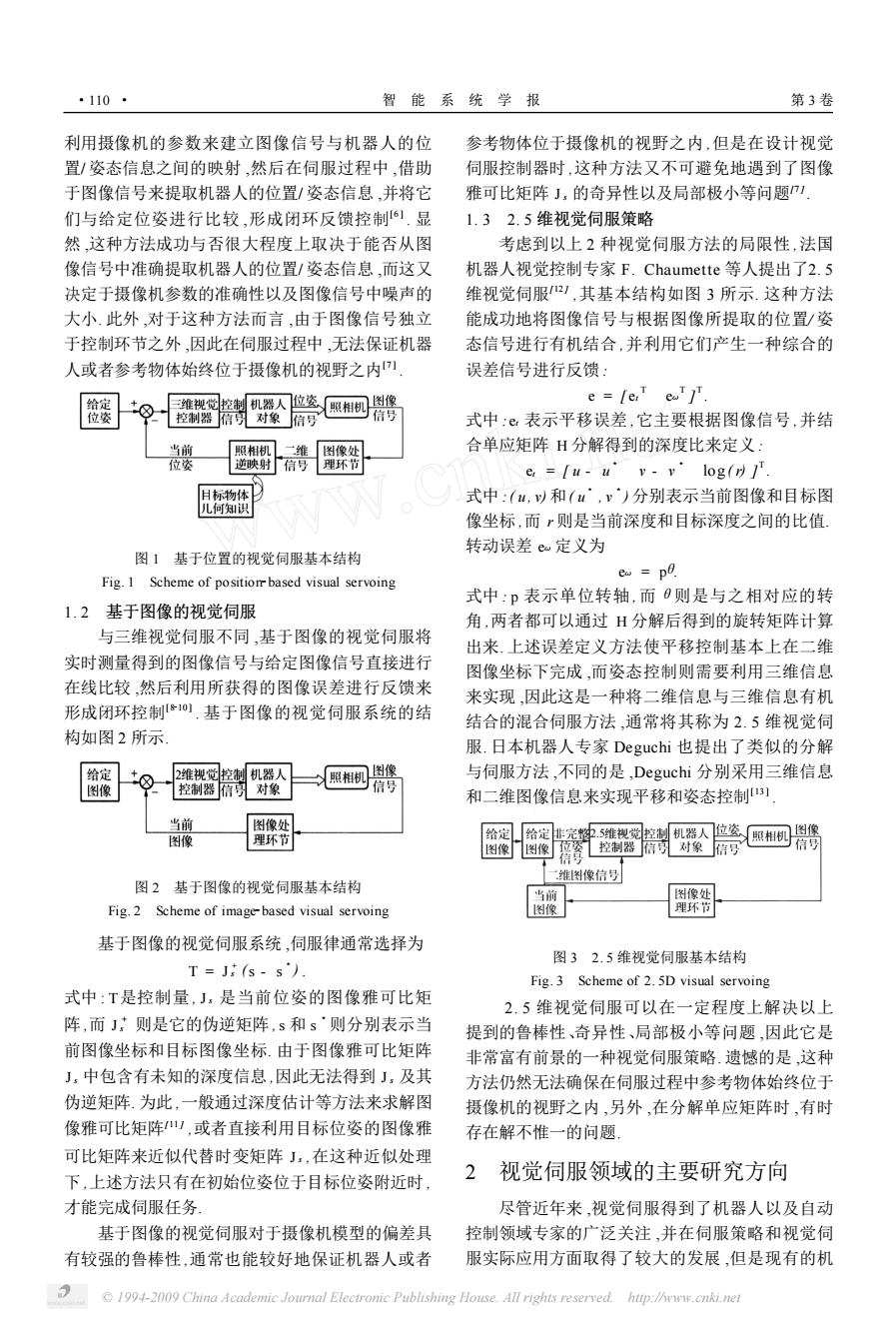

·110- 智能系统学报 第3卷 利用摄像机的参数来建立图像信号与机器人的位 参考物体位于摄像机的视野之内,但是在设计视觉 置/姿态信息之间的映射,然后在伺服过程中,借助 伺服控制器时,这种方法又不可避免地遇到了图像 于图像信号来提取机器人的位置/姿态信息,并将它 雅可比矩阵J,的奇异性以及局部极小等问题 们与给定位姿进行比较,形成闭环反馈控制.显 1.32.5维视觉伺服策略 然,这种方法成功与否很大程度上取决于能否从图 考虑到以上2种视觉伺服方法的局限性,法国 像信号中准确提取机器人的位置/姿态信息,而这又 机器人视觉控制专家F.Chaumette等人提出了2.5 决定于摄像机参数的准确性以及图像信号中噪声的 维视觉伺服),其基本结构如图3所示.这种方法 大小.此外,对于这种方法而言,由于图像信号独立 能成功地将图像信号与根据图像所提取的位置/姿 于控制环节之外,因此在伺服过程中,无法保证机器 态信号进行有机结合,并利用它们产生一种综合的 人或者参考物体始终位于摄像机的视野之内叮 误差信号进行反馈: 三维视觉控制机器人位姿 e=lerT eaTj 照相机 图像 位姿 控制器信可对象信号 信号 式中:©表示平移误差,它主要根据图像信号,并结 当前 照相机 刻像处 合单应矩阵H分解得到的深度比来定义: 位姿 如状身时 信号 理不打 e=Tu-u v-v'log(r) 日标物体 式中:(u,以和(u,v)分别表示当前图像和目标图 儿何知识 像坐标,而r则是当前深度和目标深度之间的比值 转动误差e定义为 图1基于位置的视觉伺服基本结构 eo po Fig.I Scheme of positionr based visual servoing 式中:p表示单位转轴,而0则是与之相对应的转 1.2基于图像的视觉伺服 角,两者都可以通过H分解后得到的旋转矩阵计算 与三维视觉伺服不同,基于图像的视觉伺服将 出来.上述误差定义方法使平移控制基本上在二维 实时测量得到的图像信号与给定图像信号直接进行 图像坐标下完成,而姿态控制则需要利用三维信息 在线比较,然后利用所获得的图像误差进行反馈来 来实现,因此这是一种将二维信息与三维信息有机 形成闭环控制*,基于图像的视觉伺服系统的结 结合的混合伺服方法,通常将其称为2.5维视觉伺 构如图2所示 服.日本机器人专家Deguchi也提出了类似的分解 给定 2维视觉控制机器人 照相机 图像 与伺服方法,不同的是,Deguchi分别采用三维信息 控制器信可对象 信号 和二维图像信息来实现平移和姿态控制] 当前 图像处 图像 理环节 图像门图像姿控制器信习对象信号 信号 维图像信号 图2基于图像的视觉伺服基本结构 当前 刻像处 Fig.2 Scheme of image-based visual servoing 图像 理环节 基于图像的视觉伺服系统,伺服律通常选择为 图32.5维视觉同服基本结构 T=J转(s-s Fig.3 Scheme of 2.5D visual servoing 式中:T是控制量,J,是当前位姿的图像雅可比矩 2.5维视觉伺服可以在一定程度上解决以上 阵,而J则是它的伪逆矩阵,s和s则分别表示当 提到的鲁棒性、奇异性、局部极小等问题,因此它是 前图像坐标和目标图像坐标.由于图像雅可比矩阵 非常富有前景的一种视觉伺服策略.遗憾的是,这种 J,中包含有未知的深度信息,因此无法得到J,及其 方法仍然无法确保在伺服过程中参考物体始终位于 伪逆矩阵.为此,一般通过深度估计等方法来求解图 摄像机的视野之内,另外,在分解单应矩阵时,有时 像雅可比矩阵),或者直接利用目标位姿的图像雅 存在解不惟一的问题 可比矩阵来近似代替时变矩阵J:,在这种近似处理 下,上述方法只有在初始位姿位于目标位姿附近时, 2视觉伺服领域的主要研究方向 才能完成伺服任务 尽管近年来,视觉伺服得到了机器人以及自动 基于图像的视觉伺服对于摄像机模型的偏差具 控制领域专家的广泛关注,并在伺服策略和视觉伺 有较强的鲁棒性,通常也能较好地保证机器人或者 服实际应用方面取得了较大的发展,但是现有的机 1994-2009 China Academic Journal Electronic Publishing House.All rights reserved.http://www.cnki.net利用摄像机的参数来建立图像信号与机器人的位 置/ 姿态信息之间的映射 ,然后在伺服过程中 ,借助 于图像信号来提取机器人的位置/ 姿态信息 ,并将它 们与给定位姿进行比较 ,形成闭环反馈控制[6 ] . 显 然 ,这种方法成功与否很大程度上取决于能否从图 像信号中准确提取机器人的位置/ 姿态信息 ,而这又 决定于摄像机参数的准确性以及图像信号中噪声的 大小. 此外 ,对于这种方法而言 ,由于图像信号独立 于控制环节之外 ,因此在伺服过程中 ,无法保证机器 人或者参考物体始终位于摄像机的视野之内[7 ] . 图 1 基于位置的视觉伺服基本结构 Fig. 1 Scheme of position2based visual servoing 1. 2 基于图像的视觉伺服 与三维视觉伺服不同 ,基于图像的视觉伺服将 实时测量得到的图像信号与给定图像信号直接进行 在线比较 ,然后利用所获得的图像误差进行反馈来 形成闭环控制[ 8210 ] . 基于图像的视觉伺服系统的结 构如图 2 所示. 图 2 基于图像的视觉伺服基本结构 Fig. 2 Scheme of image2based visual servoing 基于图像的视觉伺服系统 ,伺服律通常选择为 T = J + s (s - s 3 ) . 式中 : T是控制量 , Js 是当前位姿的图像雅可比矩 阵 ,而 J + s 则是它的伪逆矩阵 ,s 和 s 3 则分别表示当 前图像坐标和目标图像坐标. 由于图像雅可比矩阵 Js 中包含有未知的深度信息 ,因此无法得到 Js 及其 伪逆矩阵. 为此 ,一般通过深度估计等方法来求解图 像雅可比矩阵[11 ] ,或者直接利用目标位姿的图像雅 可比矩阵来近似代替时变矩阵 Js ,在这种近似处理 下 ,上述方法只有在初始位姿位于目标位姿附近时 , 才能完成伺服任务. 基于图像的视觉伺服对于摄像机模型的偏差具 有较强的鲁棒性 ,通常也能较好地保证机器人或者 参考物体位于摄像机的视野之内 ,但是在设计视觉 伺服控制器时 ,这种方法又不可避免地遇到了图像 雅可比矩阵 Js 的奇异性以及局部极小等问题[7 ] . 1. 3 2. 5 维视觉伺服策略 考虑到以上 2 种视觉伺服方法的局限性 ,法国 机器人视觉控制专家 F. Chaumette 等人提出了2. 5 维视觉伺服[12 ] ,其基本结构如图 3 所示. 这种方法 能成功地将图像信号与根据图像所提取的位置/ 姿 态信号进行有机结合 ,并利用它们产生一种综合的 误差信号进行反馈 : e = [ et T eω T ] T . 式中 : et 表示平移误差 ,它主要根据图像信号 ,并结 合单应矩阵 H 分解得到的深度比来定义 : et = [ u - u 3 v - v 3 log ( r) ] T . 式中 : ( u , v) 和( u 3 , v 3 ) 分别表示当前图像和目标图 像坐标 ,而 r 则是当前深度和目标深度之间的比值. 转动误差 eω 定义为 eω = pθ. 式中 : p 表示单位转轴 , 而θ则是与之相对应的转 角 ,两者都可以通过 H 分解后得到的旋转矩阵计算 出来. 上述误差定义方法使平移控制基本上在二维 图像坐标下完成 ,而姿态控制则需要利用三维信息 来实现 ,因此这是一种将二维信息与三维信息有机 结合的混合伺服方法 ,通常将其称为 2. 5 维视觉伺 服. 日本机器人专家 Deguchi 也提出了类似的分解 与伺服方法 ,不同的是 ,Deguchi 分别采用三维信息 和二维图像信息来实现平移和姿态控制[13 ] . 图 3 2. 5 维视觉伺服基本结构 Fig. 3 Scheme of 2. 5D visual servoing 2. 5 维视觉伺服可以在一定程度上解决以上 提到的鲁棒性、奇异性、局部极小等问题 ,因此它是 非常富有前景的一种视觉伺服策略. 遗憾的是 ,这种 方法仍然无法确保在伺服过程中参考物体始终位于 摄像机的视野之内 ,另外 ,在分解单应矩阵时 ,有时 存在解不惟一的问题. 2 视觉伺服领域的主要研究方向 尽管近年来 ,视觉伺服得到了机器人以及自动 控制领域专家的广泛关注 ,并在伺服策略和视觉伺 服实际应用方面取得了较大的发展 ,但是现有的机 ·110 · 智 能 系 统 学 报 第 3 卷 © 1994-2009 China Academic Journal Electronic Publishing House. All rights reserved. http://www.cnki.net