正在加载图片...

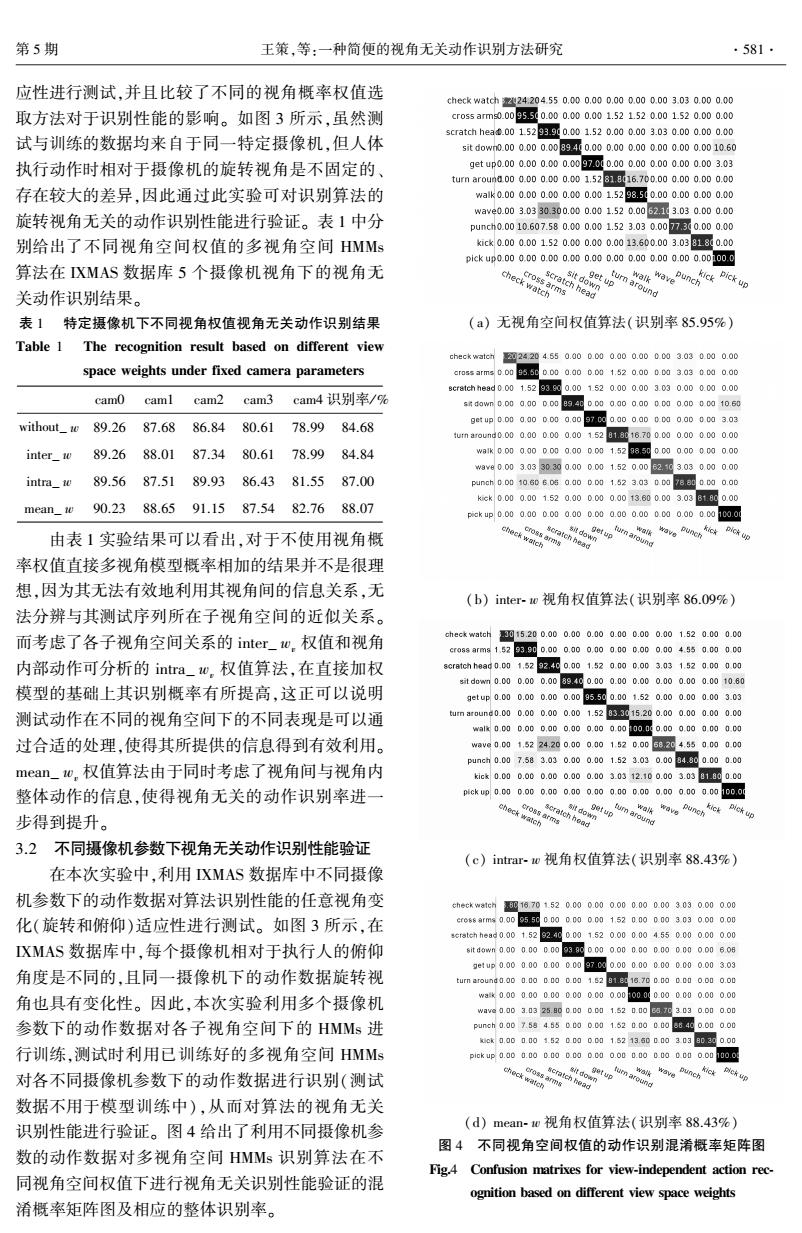

第5期 王策,等:一种简便的视角无关动作识别方法研究 ·581- 应性进行测试,并且比较了不同的视角概率权值选 check watch224204.550.000.000.000.000.003.030.000.00 取方法对于识别性能的影响。如图3所示,虽然测 cros5ams0.0095.500.000.000.001.521.520.001.520.000.00 scratch hea.0015293.90.001.520.000.003.030.000.000.00 试与训练的数据均来自于同一特定摄像机,但人体 sit down0.000.000.0089400.000.000.000.000.000.0010.60 执行动作时相对于摄像机的旋转视角是不固定的、 get up0.000.000.000.0097.0d0.000.000.000.000.003.03 turn around.000.000.000.001.5281.816.700.000.000.000.00 存在较大的差异,因此通过此实验可对识别算法的 walk0.000.000.000.000.001.5298.50.000.000.000.00 wave0.003.0330.300.000.001.520.0062,113.030.000.00 旋转视角无关的动作识别性能进行验证。表1中分 punch0.0010.607.580.000.001.523.030.0077.30.000.00 别给出了不同视角空间权值的多视角空间HMMs kick0.000.001.520.000.000.0013.600.003.0381800.00 p1ckup0.000.000.00,000.000.000.000.000.000.001o0.0 算法在XMAS数据库5个摄像机视角下的视角无 关动作识别结果。 round 表1特定摄像机下不同视角权值视角无关动作识别结果 (a)无视角空间权值算法(识别率85.95%) Table 1 The recognition result based on different view check watch224204.550.000.000.000.000.003.030.000.00 space weights under fixed camera parameters cross arm=0.0095.500.000.000.001.520.000.03.030.10.00 8cr8 tchhe8d0.001.52930.001520.000.003.030.000.00.00 cam0 caml cam2 cam3cam4识别率/9% s6dawn0,00a.a00.0089,4gDD00.a00.a00Da0.000010.60 without e89.2687.6886.8480.61 78.9984.68 get up0.00a.a0000a.a07da,a00,a0000,a00c03.03 turn around0.000.000.000.0015281.8516.700.00.000.00.00 inter_w 89.2688.0187.3480.61 78.9984.84 wak0.00a.00D000.000.001.5288,500a0.00000.00 w8vg0.003.0330.300.000001.520.0062,503.03000.00 intra w 89.5687.5189.93 86.4381.5587.00 punch0.0010.60606a.a0D.D01,523.030的78a00.的0.a0 mean_w90.2388.6591.1587.5482.7688.07 kck0.000.001.520.000.000.0013.600.003.03818m000 pick up0.000.000.000.000.000.000.000.C0.000.001c0.0 由表1实验结果可以看出,对于不使用视角概 率权值直接多视角模型概率相加的结果并不是很理 想,因为其无法有效地利用其视角间的信息关系,无 (b)inter-.o视角权值算法(识别率86.09%) 法分辨与其测试序列所在子视角空间的近似关系。 而考虑了各子视角空间关系的inter_t0,权值和视角 chec*watch015.200.000.000.000.000.000.001.520.000.C0 cr088armg15293900.000.,000,000.000.000,00450.00.0 内部动作可分析的intra_心,权值算法,在直接加权 8 cratch h88g0.001.5292,4g0.001.520000.003.031.520.000.0 std0wm0.000.000.0089.400.000.000.000.000.000.0010.60 模型的基础上其识别概率有所提高,这正可以说明 9etup0.000.000.000.0095500.001.520.000.000.003.03 测试动作在不同的视角空间下的不同表现是可以通 turn around0.000.000.000.001.5283.315.200.000.000.000.00 walW0000.000,000.000.00,000000.000.000000.00 过合适的处理,使得其所提供的信息得到有效利用。 wavg0.001.5224.200.000.001.520.0058204.550000.00 punch0.007.583.030.000.001.523.030.0084.800.000.00 mean0,权值算法由于同时考虑了视角间与视角内 kick0.000.000.000.000.003.0312.100.003.0381800.0 整体动作的信息,使得视角无关的动作识别率进一 pick up0.000.000,000.a00.000.000.000.000.000.0a100.0 步得到提升。 3.2不同摄像机参数下视角无关动作识别性能验证 (c)intrar-w视角权值算法(识别率88.43%) 在本次实验中,利用XMAS数据库中不同摄像 机参数下的动作数据对算法识别性能的任意视角变 checkw81ch016701520.000.000.000.000.003.03.0.000.00 化(旋转和俯仰)适应性进行测试。如图3所示,在 cr0s8arms0.009550000000001520.000003030.000.00 cratch head0.001.5292.400.001.520.000.004.550000.000.00 XMAS数据库中,每个摄像机相对于执行人的俯仰 sitd0wn0.a00.00000939g0000.000000000000.00606 gefup0.000.000000.0097.0.000.000.000.000.003.03 角度是不同的,且同一摄像机下的动作数据旋转视 turn around.000.00000.01.5281816.700.0a0.c10.000.00 角也具有变化性。因此,本次实验利用多个摄像机 wak0.000.000.000.000.000.00t00000000.000.000.00 wave0.003.0325.00.0011.520.0,7C3030.000.00 参数下的动作数据对各子视角空间下的HMMs进 punch.a07.584650.00.c01.520.000.0664g0.000.00 kek0.a000015200a01152135000303900.00 行训练,测试时利用已训练好的多视角空间HMMs p1ckup0.000.000.00.000.c00.000.000.000000.00100 对各不同摄像机参数下的动作数据进行识别(测试 数据不用于模型训练中),从而对算法的视角无关 识别性能进行验证。图4给出了利用不同摄像机参 (d)mean-1w视角权值算法(识别率88.43%) 图4不同视角空间权值的动作识别混淆概率矩阵图 数的动作数据对多视角空间HMMs识别算法在不 Fig4 Confusion matrixes for view-independent action rec- 同视角空间权值下进行视角无关识别性能验证的混 ognition based on different view space weights 淆概率矩阵图及相应的整体识别率。应性进行测试,并且比较了不同的视角概率权值选 取方法对于识别性能的影响。 如图 3 所示,虽然测 试与训练的数据均来自于同一特定摄像机,但人体 执行动作时相对于摄像机的旋转视角是不固定的、 存在较大的差异,因此通过此实验可对识别算法的 旋转视角无关的动作识别性能进行验证。 表 1 中分 别给出了不同视角空间权值的多视角空间 HMMs 算法在 IXMAS 数据库 5 个摄像机视角下的视角无 关动作识别结果。 表 1 特定摄像机下不同视角权值视角无关动作识别结果 Table 1 The recognition result based on different view space weights under fixed camera parameters cam0 cam1 cam2 cam3 cam4 识别率/ % without_ w 89.26 87.68 86.84 80.61 78.99 84.68 inter_ w 89.26 88.01 87.34 80.61 78.99 84.84 intra_ w 89.56 87.51 89.93 86.43 81.55 87.00 mean_ w 90.23 88.65 91.15 87.54 82.76 88.07 由表 1 实验结果可以看出,对于不使用视角概 率权值直接多视角模型概率相加的结果并不是很理 想,因为其无法有效地利用其视角间的信息关系,无 法分辨与其测试序列所在子视角空间的近似关系。 而考虑了各子视角空间关系的 inter_ wv 权值和视角 内部动作可分析的 intra_ wv 权值算法,在直接加权 模型的基础上其识别概率有所提高,这正可以说明 测试动作在不同的视角空间下的不同表现是可以通 过合适的处理,使得其所提供的信息得到有效利用。 mean_ wv 权值算法由于同时考虑了视角间与视角内 整体动作的信息,使得视角无关的动作识别率进一 步得到提升。 3.2 不同摄像机参数下视角无关动作识别性能验证 在本次实验中,利用 IXMAS 数据库中不同摄像 机参数下的动作数据对算法识别性能的任意视角变 化(旋转和俯仰)适应性进行测试。 如图 3 所示,在 IXMAS 数据库中,每个摄像机相对于执行人的俯仰 角度是不同的,且同一摄像机下的动作数据旋转视 角也具有变化性。 因此,本次实验利用多个摄像机 参数下的动作数据对各子视角空间下的 HMMs 进 行训练,测试时利用已训练好的多视角空间 HMMs 对各不同摄像机参数下的动作数据进行识别(测试 数据不用于模型训练中),从而对算法的视角无关 识别性能进行验证。 图 4 给出了利用不同摄像机参 数的动作数据对多视角空间 HMMs 识别算法在不 同视角空间权值下进行视角无关识别性能验证的混 淆概率矩阵图及相应的整体识别率。 (a) 无视角空间权值算法(识别率 85.95%) (b) inter⁃ w 视角权值算法(识别率 86.09%) (c) intrar⁃ w 视角权值算法(识别率 88.43%) (d) mean⁃ w 视角权值算法(识别率 88.43%) 图 4 不同视角空间权值的动作识别混淆概率矩阵图 Fig.4 Confusion matrixes for view⁃independent action rec⁃ ognition based on different view space weights 第 5 期 王策,等:一种简便的视角无关动作识别方法研究 ·581·