正在加载图片...

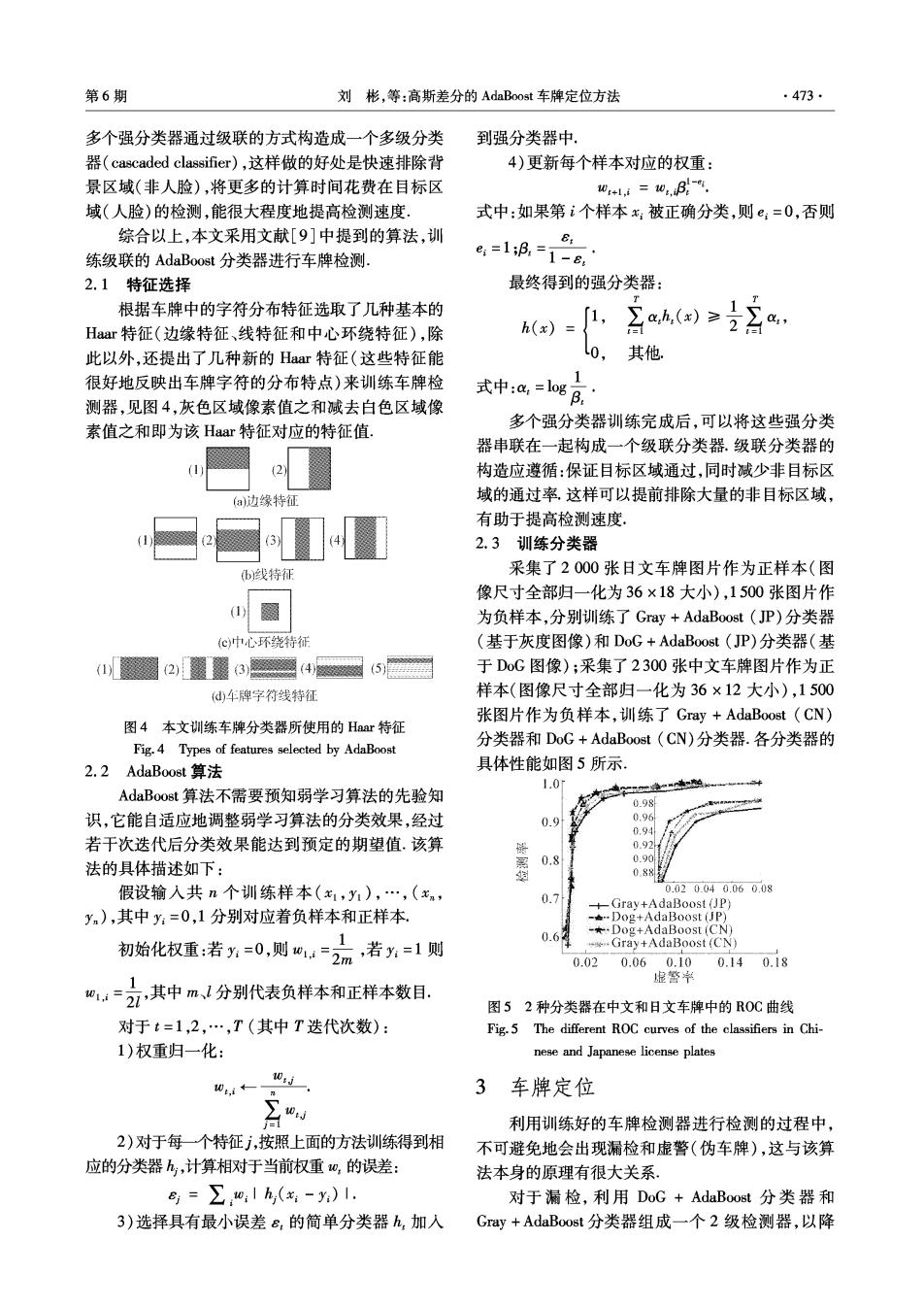

第6期 刘彬,等:高斯差分的AdaBoost车牌定位方法 ·473· 多个强分类器通过级联的方式构造成一个多级分类 到强分类器中, 器(cascaded classifier),这样做的好处是快速排除背 4)更新每个样本对应的权重: 景区域(非人脸),将更多的计算时间花费在目标区 0+1,=0,B- 域(人脸)的检测,能很大程度地提高检测速度, 式中:如果第i个样本x:被正确分类,则e:=0,否则 综合以上,本文采用文献[9]中提到的算法,训 练级联的AdaBoost分类器进行车牌检测. e,=16,=1-E 2.1特征选择 最终得到的强分类器: 根据车牌中的字符分布特征选取了几种基本的 1, Haar特征(边缘特征、线特征和中心环绕特征),除 h(x)= 此以外,还提出了几种新的Haar特征(这些特征能 0, 其他 很好地反映出车牌字符的分布特点)来训练车牌检 测器,见图4,灰色区域像素值之和减去白色区域像 式中:a,=log月 素值之和即为该Haar特征对应的特征值. 多个强分类器训练完成后,可以将这些强分类 器串联在一起构成一个级联分类器.级联分类器的 构造应遵循:保证目标区域通过,同时减少非目标区 a)边缘特征 域的通过率这样可以提前排除大量的非目标区域, 有助于提高检测速度, (3 2.3训练分类器 线特征 采集了2000张日文车牌图片作为正样本(图 像尺寸全部归一化为36×18大小),1500张图片作 (1) 为负样本,分别训练了Gray+AdaBoost(JP)分类器 c中心环绕特征 (基于灰度图像)和DoG+AdaBoost(JP)分类器(基 (儿2覆3运4(5 于DoG图像):采集了2300张中文车牌图片作为正 d)4字符线特征 样本(图像尺寸全部归一化为36×12大小),1500 张图片作为负样本,训练了Gray+AdaBoost(CN) 图4本文训练车牌分类器所使用的Haar特征 Fig.4 Types of features selected by AdaBoost 分类器和DoG+AdaBoost(CN)分类器.各分类器的 2.2 AdaBoost算法 具体性能如图5所示. 1.0 AdaBoost算法不需要预知弱学习算法的先验知 0.98 识,它能自适应地调整弱学习算法的分类效果,经过 0.9 0.96 0.94 若干次迭代后分类效果能达到预定的期望值.该算 0.92 法的具体描述如下: 0.8 0.90 08 假设输入共n个训练样本(x1,y1),…,(xn, 0.020.040.060.08 0.7 Gray+AdaBoost (JP) yn),其中y:=0,1分别对应着负样本和正样本. -Dog+AdaBoost (JP) -*·Dog+AdaBoost(CN 初始化权重若=0,则4=元者=1则 0.6 Gray+AdaBoost (CN) 0.02 0.060.100.140.18 =,其中m分别代表负样本和正样本数目。 虚警率 图52种分类器在中文和日文车牌中的R0C曲线 对于t=1,2,…,T(其中T迭代次数): Fig.5 The different ROC curves of the classifiers in Chi- 1)权重归一化: nese and Japanese license plates 0← 10 3车牌定位 30小 利用训练好的车牌检测器进行检测的过程中, 2)对于每一个特征j,按照上面的方法训练得到相 不可避免地会出现漏检和虚警(伪车牌),这与该算 应的分类器h,计算相对于当前权重0,的误差: 法本身的原理有很大关系. e=∑0:1h,(x:-y)1. 对于漏检,利用DoG+AdaBoost分类器和 3)选择具有最小误差E,的简单分类器h,加入 Gray+AdaBoost分类器组成一个2级检测器,以降