正在加载图片...

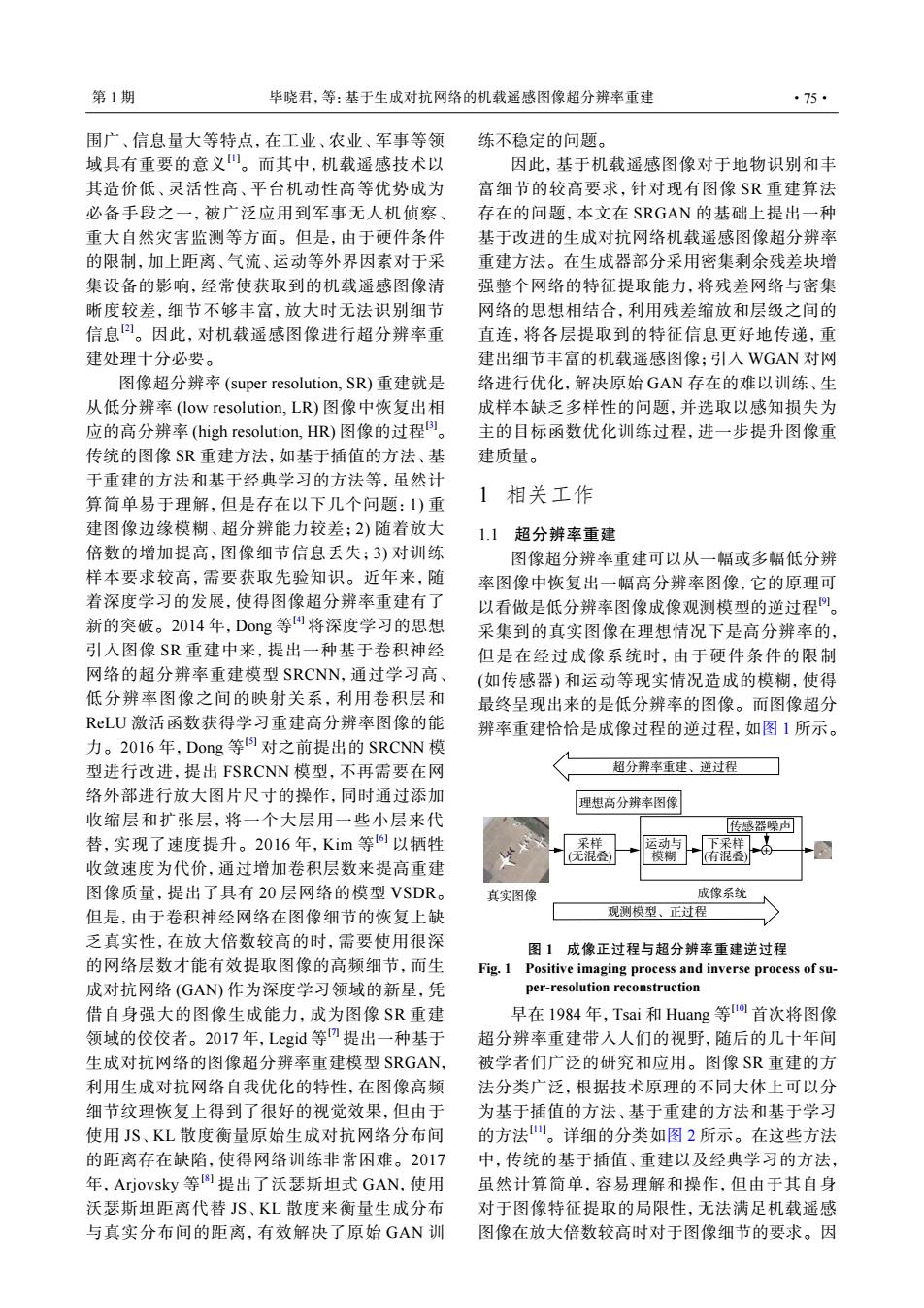

第1期 毕晓君,等:基于生成对抗网络的机载遥感图像超分辨率重建 ·75· 围广、信息量大等特点,在工业、农业、军事等领 练不稳定的问题。 域具有重要的意义山。而其中,机载遥感技术以 因此,基于机载遥感图像对于地物识别和丰 其造价低、灵活性高、平台机动性高等优势成为 富细节的较高要求,针对现有图像SR重建算法 必备手段之一,被广泛应用到军事无人机侦察、 存在的问题,本文在SRGAN的基础上提出一种 重大自然灾害监测等方面。但是,由于硬件条件 基于改进的生成对抗网络机载遥感图像超分辨率 的限制,加上距离、气流、运动等外界因素对于采 重建方法。在生成器部分采用密集剩余残差块增 集设备的影响,经常使获取到的机载遥感图像清 强整个网络的特征提取能力,将残差网络与密集 晰度较差,细节不够丰富,放大时无法识别细节 网络的思想相结合,利用残差缩放和层级之间的 信息。因此,对机载遥感图像进行超分辨率重 直连,将各层提取到的特征信息更好地传递,重 建处理十分必要。 建出细节丰富的机载遥感图像;引入WGAN对网 图像超分辨率(super resolution,SR)重建就是 络进行优化,解决原始GAN存在的难以训练、生 从低分辨率(low resolution,LR)图像中恢复出相 成样本缺乏多样性的问题,并选取以感知损失为 应的高分辨率(high resolution,HR)图像的过程。 主的目标函数优化训练过程,进一步提升图像重 传统的图像SR重建方法,如基于插值的方法、基 建质量。 于重建的方法和基于经典学习的方法等,虽然计 算简单易于理解,但是存在以下几个问题:1)重 1相关工作 建图像边缘模糊、超分辨能力较差;2)随着放大 1.1 超分辨率重建 倍数的增加提高,图像细节信息丢失;3)对训练 图像超分辨率重建可以从一幅或多幅低分辨 样本要求较高,需要获取先验知识。近年来,随 率图像中恢复出一幅高分辨率图像,它的原理可 着深度学习的发展,使得图像超分辨率重建有了 以看做是低分辨率图像成像观测模型的逆过程。 新的突破。2014年,Dong等将深度学习的思想 采集到的真实图像在理想情况下是高分辨率的, 引入图像SR重建中来,提出一种基于卷积神经 但是在经过成像系统时,由于硬件条件的限制 网络的超分辨率重建模型SRCNN,通过学习高、 (如传感器)和运动等现实情况造成的模糊,使得 低分辨率图像之间的映射关系,利用卷积层和 最终呈现出来的是低分辨率的图像。而图像超分 RεLU激活函数获得学习重建高分辨率图像的能 辨率重建恰恰是成像过程的逆过程,如图1所示。 力。2016年,Dong等对之前提出的SRCNN模 型进行改进,提出FSRCNN模型,不再需要在网 超分辨率重建、逆过程 络外部进行放大图片尺寸的操作,同时通过添加 理想高分辨率图像 收缩层和扩张层,将一个大层用一些小层来代 传感器噪声 替,实现了速度提升。2016年,Kim等向以牺牲 采样 下采样 无混叠) (有混叠) 收敛速度为代价,通过增加卷积层数来提高重建 图像质量,提出了具有20层网络的模型VSDR。 其实图像 成像系统 但是,由于卷积神经网络在图像细节的恢复上缺 观测模型、正过程 乏真实性,在放大倍数较高的时,需要使用很深 图1成像正过程与超分辨率重建逆过程 的网络层数才能有效提取图像的高频细节,而生 Fig.1 Positive imaging process and inverse process of su- 成对抗网络(GAN)作为深度学习领域的新星,凭 per-resolution reconstruction 借自身强大的图像生成能力,成为图像SR重建 早在1984年,Tsai和Huang等1o首次将图像 领域的佼佼者。2017年,Legid等提出一种基于 超分辨率重建带入人们的视野,随后的几十年间 生成对抗网络的图像超分辨率重建模型SRGAN, 被学者们广泛的研究和应用。图像SR重建的方 利用生成对抗网络自我优化的特性,在图像高频 法分类广泛,根据技术原理的不同大体上可以分 细节纹理恢复上得到了很好的视觉效果,但由于 为基于插值的方法、基于重建的方法和基于学习 使用JS、KL散度衡量原始生成对抗网络分布间 的方法"。详细的分类如图2所示。在这些方法 的距离存在缺陷,使得网络训练非常困难。2017 中,传统的基于插值、重建以及经典学习的方法, 年,Arjovsky等I8提出了沃瑟斯坦式GAN,使用 虽然计算简单,容易理解和操作,但由于其自身 沃瑟斯坦距离代替JS、KL散度来衡量生成分布 对于图像特征提取的局限性,无法满足机载遥感 与真实分布间的距离,有效解决了原始GAN训 图像在放大倍数较高时对于图像细节的要求。因围广、信息量大等特点,在工业、农业、军事等领 域具有重要的意义[1]。而其中,机载遥感技术以 其造价低、灵活性高、平台机动性高等优势成为 必备手段之一,被广泛应用到军事无人机侦察、 重大自然灾害监测等方面。但是,由于硬件条件 的限制,加上距离、气流、运动等外界因素对于采 集设备的影响,经常使获取到的机载遥感图像清 晰度较差,细节不够丰富,放大时无法识别细节 信息[2]。因此,对机载遥感图像进行超分辨率重 建处理十分必要。 图像超分辨率 (super resolution, SR) 重建就是 从低分辨率 (low resolution, LR) 图像中恢复出相 应的高分辨率 (high resolution, HR) 图像的过程[3]。 传统的图像 SR 重建方法,如基于插值的方法、基 于重建的方法和基于经典学习的方法等,虽然计 算简单易于理解,但是存在以下几个问题:1) 重 建图像边缘模糊、超分辨能力较差;2) 随着放大 倍数的增加提高,图像细节信息丢失;3) 对训练 样本要求较高,需要获取先验知识。近年来,随 着深度学习的发展,使得图像超分辨率重建有了 新的突破。2014 年,Dong 等 [4] 将深度学习的思想 引入图像 SR 重建中来,提出一种基于卷积神经 网络的超分辨率重建模型 SRCNN,通过学习高、 低分辨率图像之间的映射关系,利用卷积层和 ReLU 激活函数获得学习重建高分辨率图像的能 力。2016 年,Dong 等 [5] 对之前提出的 SRCNN 模 型进行改进,提出 FSRCNN 模型,不再需要在网 络外部进行放大图片尺寸的操作,同时通过添加 收缩层和扩张层,将一个大层用一些小层来代 替,实现了速度提升。2016 年,Kim 等 [6] 以牺牲 收敛速度为代价,通过增加卷积层数来提高重建 图像质量,提出了具有 20 层网络的模型 VSDR。 但是,由于卷积神经网络在图像细节的恢复上缺 乏真实性,在放大倍数较高的时,需要使用很深 的网络层数才能有效提取图像的高频细节,而生 成对抗网络 (GAN) 作为深度学习领域的新星,凭 借自身强大的图像生成能力,成为图像 SR 重建 领域的佼佼者。2017 年,Legid 等 [7] 提出一种基于 生成对抗网络的图像超分辨率重建模型 SRGAN, 利用生成对抗网络自我优化的特性,在图像高频 细节纹理恢复上得到了很好的视觉效果,但由于 使用 JS、KL 散度衡量原始生成对抗网络分布间 的距离存在缺陷,使得网络训练非常困难。2017 年,Arjovsky 等 [8] 提出了沃瑟斯坦式 GAN,使用 沃瑟斯坦距离代替 JS、KL 散度来衡量生成分布 与真实分布间的距离,有效解决了原始 GAN 训 练不稳定的问题。 因此,基于机载遥感图像对于地物识别和丰 富细节的较高要求,针对现有图像 SR 重建算法 存在的问题,本文在 SRGAN 的基础上提出一种 基于改进的生成对抗网络机载遥感图像超分辨率 重建方法。在生成器部分采用密集剩余残差块增 强整个网络的特征提取能力,将残差网络与密集 网络的思想相结合,利用残差缩放和层级之间的 直连,将各层提取到的特征信息更好地传递,重 建出细节丰富的机载遥感图像;引入 WGAN 对网 络进行优化,解决原始 GAN 存在的难以训练、生 成样本缺乏多样性的问题,并选取以感知损失为 主的目标函数优化训练过程,进一步提升图像重 建质量。 1 相关工作 1.1 超分辨率重建 图像超分辨率重建可以从一幅或多幅低分辨 率图像中恢复出一幅高分辨率图像,它的原理可 以看做是低分辨率图像成像观测模型的逆过程[9]。 采集到的真实图像在理想情况下是高分辨率的, 但是在经过成像系统时,由于硬件条件的限制 (如传感器) 和运动等现实情况造成的模糊,使得 最终呈现出来的是低分辨率的图像。而图像超分 辨率重建恰恰是成像过程的逆过程,如图 1 所示。 超分辨率重建、逆过程 理想高分辨率图像 观测模型、正过程 真实图像 成像系统 采样 (无混叠) 下采样 (有混叠) 传感器噪声 运动与 模糊 + 图 1 成像正过程与超分辨率重建逆过程 Fig. 1 Positive imaging process and inverse process of super-resolution reconstruction 早在 1984 年,Tsai 和 Huang 等 [10] 首次将图像 超分辨率重建带入人们的视野,随后的几十年间 被学者们广泛的研究和应用。图像 SR 重建的方 法分类广泛,根据技术原理的不同大体上可以分 为基于插值的方法、基于重建的方法和基于学习 的方法[11]。详细的分类如图 2 所示。在这些方法 中,传统的基于插值、重建以及经典学习的方法, 虽然计算简单,容易理解和操作,但由于其自身 对于图像特征提取的局限性,无法满足机载遥感 图像在放大倍数较高时对于图像细节的要求。因 第 1 期 毕晓君,等:基于生成对抗网络的机载遥感图像超分辨率重建 ·75·