正在加载图片...

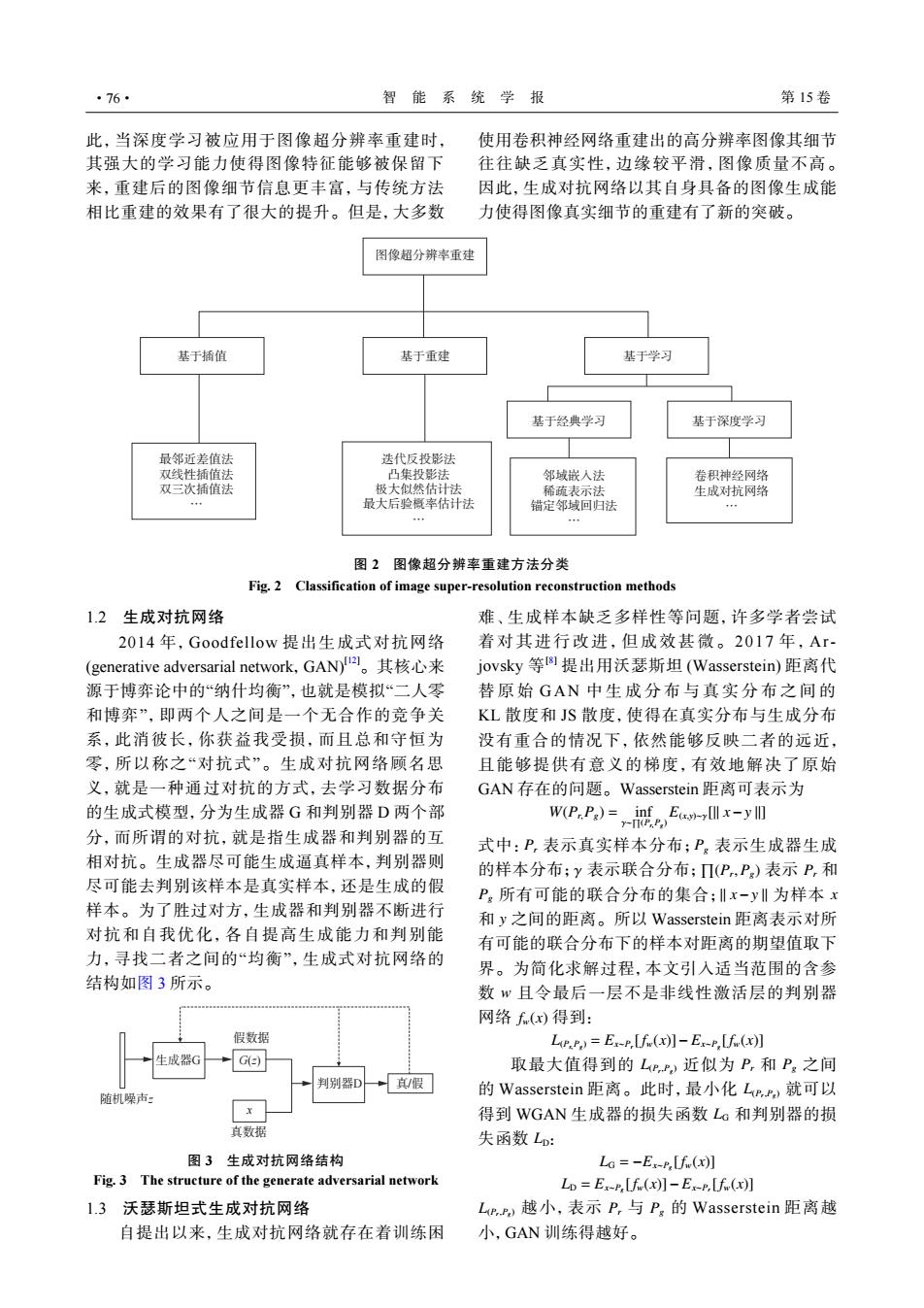

·76· 智能系统学报 第15卷 此,当深度学习被应用于图像超分辨率重建时, 使用卷积神经网络重建出的高分辨率图像其细节 其强大的学习能力使得图像特征能够被保留下 往往缺乏真实性,边缘较平滑,图像质量不高。 来,重建后的图像细节信息更丰富,与传统方法 因此,生成对抗网络以其自身具备的图像生成能 相比重建的效果有了很大的提升。但是,大多数 力使得图像真实细节的重建有了新的突破。 图像超分辨率重建 基于插值 基于重建 基于学习 基于经典学习 基于深度学习 最邻近差值法 迭代反投影法 双线性插值法 凸集投影法 邻域嵌人法 卷积神经网络 双三次插值法 极大似然估计法 稀疏表示法 生成对抗网络 最大后验概率估计法 错定邻域回归法 ” 图2图像超分辨率重建方法分类 Fig.2 Classification of image super-resolution reconstruction methods 1.2生成对抗网络 难、生成样本缺乏多样性等问题,许多学者尝试 2014年,Goodfellow提出生成式对抗网络 着对其进行改进,但成效甚微。2017年,Ar- (generative adversarial network,GAN)。其核心来 jovsky等⑧I提出用沃瑟斯坦(Wasserstein)距离代 源于博弈论中的“纳什均衡”,也就是模拟“二人零 替原始GAN中生成分布与真实分布之间的 和博弈”,即两个人之间是一个无合作的竞争关 KL散度和JS散度,使得在真实分布与生成分布 系,此消彼长,你获益我受损,而且总和守恒为 没有重合的情况下,依然能够反映二者的远近, 零,所以称之“对抗式”。生成对抗网络顾名思 且能够提供有意义的梯度,有效地解决了原始 义,就是一种通过对抗的方式,去学习数据分布 GAN存在的问题。Wasserstein距离可表示为 的生成式模型,分为生成器G和判别器D两个部 W(P,Pa)=inf Esllx-yl Y-(PP) 分,而所谓的对抗,就是指生成器和判别器的互 式中:P,表示真实样本分布;P。表示生成器生成 相对抗。生成器尽可能生成逼真样本,判别器则 的样本分布;y表示联合分布;(P,P)表示P,和 尽可能去判别该样本是真实样本,还是生成的假 Pg所有可能的联合分布的集合;Ix-y为样本x 样本。为了胜过对方,生成器和判别器不断进行 和y之间的距离。所以Wasserstein距离表示对所 对抗和自我优化,各自提高生成能力和判别能 有可能的联合分布下的样本对距离的期望值取下 力,寻找二者之间的“均衡”,生成式对抗网络的 界。为简化求解过程,本文引入适当范围的含参 结构如图3所示。 数w且令最后一层不是非线性激活层的判别器 网络f(x)得到: 假数据 LuP.P)=Ex-r.[fi(x)]-E-P,[f.(x)] 生成器( Ge) 取最大值得到的LP,P近似为P,和Pg之间 判别器D 其/假 随机噪声 的Wasserstein距离。此时,最小化Lr,就可以 得到WGAN生成器的损失函数LG和判别器的损 真数据 失函数Lo: 图3生成对抗网络结构 La=-Ex-P,[fi(x)] Fig.3 The structure of the generate adversarial network LD Ex-r,[f.(x)]-E-p.[f.(x)] 1.3沃瑟斯坦式生成对抗网络 LRP越小,表示P,与Pg的Wasserstein距离越 自提出以来,生成对抗网络就存在着训练困 小,GAN训练得越好。此,当深度学习被应用于图像超分辨率重建时, 其强大的学习能力使得图像特征能够被保留下 来,重建后的图像细节信息更丰富,与传统方法 相比重建的效果有了很大的提升。但是,大多数 使用卷积神经网络重建出的高分辨率图像其细节 往往缺乏真实性,边缘较平滑,图像质量不高。 因此,生成对抗网络以其自身具备的图像生成能 力使得图像真实细节的重建有了新的突破。 图像超分辨率重建 基于重建 基于学习 基于经典学习 基于深度学习 最邻近差值法 双线性插值法 双三次插值法 … 迭代反投影法 凸集投影法 极大似然估计法 最大后验概率估计法 … 邻域嵌入法 稀疏表示法 锚定邻域回归法 … 卷积神经网络 生成对抗网络 … 基于插值 图 2 图像超分辨率重建方法分类 Fig. 2 Classification of image super-resolution reconstruction methods 1.2 生成对抗网络 2014 年 ,Goodfellow 提出生成式对抗网络 (generative adversarial network,GAN)[12]。其核心来 源于博弈论中的“纳什均衡”,也就是模拟“二人零 和博弈”,即两个人之间是一个无合作的竞争关 系,此消彼长,你获益我受损,而且总和守恒为 零,所以称之“对抗式”。生成对抗网络顾名思 义,就是一种通过对抗的方式,去学习数据分布 的生成式模型,分为生成器 G 和判别器 D 两个部 分,而所谓的对抗,就是指生成器和判别器的互 相对抗。生成器尽可能生成逼真样本,判别器则 尽可能去判别该样本是真实样本,还是生成的假 样本。为了胜过对方,生成器和判别器不断进行 对抗和自我优化,各自提高生成能力和判别能 力,寻找二者之间的“均衡”,生成式对抗网络的 结构如图 3 所示。 生成器G x 判别器D 假数据 真数据 随机噪声z G(z) 真/假 图 3 生成对抗网络结构 Fig. 3 The structure of the generate adversarial network 1.3 沃瑟斯坦式生成对抗网络 自提出以来,生成对抗网络就存在着训练困 难、生成样本缺乏多样性等问题,许多学者尝试 着对其进行改进,但成效甚微。2017 年 , Arjovsky 等 [8] 提出用沃瑟斯坦 (Wasserstein) 距离代 替 原 始 G AN 中生成分布与真实分布之间 的 KL 散度和 JS 散度,使得在真实分布与生成分布 没有重合的情况下,依然能够反映二者的远近, 且能够提供有意义的梯度,有效地解决了原始 GAN 存在的问题。Wasserstein 距离可表示为 W(Pr,Pg) = inf γ∼ ∏(Pr,Pg ) E(x,y)∼γ[∥ x−y ∥] Pr Pg γ ∏(Pr ,Pg) Pr Pg ∥ x−y ∥ x y w fw(x) 式中: 表示真实样本分布; 表示生成器生成 的样本分布; 表示联合分布; 表示 和 所有可能的联合分布的集合; 为样本 和 之间的距离。所以 Wasserstein 距离表示对所 有可能的联合分布下的样本对距离的期望值取下 界。为简化求解过程,本文引入适当范围的含参 数 且令最后一层不是非线性激活层的判别器 网络 得到: L(Pr,Pg ) = Ex∼Pr [fw(x)]− Ex∼Pg [fw(x)] L(Pr,Pg) Pr Pg L(Pr,Pg) LG LD 取最大值得到的 近似为 和 之间 的 Wasserstein 距离。此时,最小化 就可以 得到 WGAN 生成器的损失函数 和判别器的损 失函数 : LG = −Ex∼Pg [fw(x)] LD = Ex∼Pg [fw(x)]− Ex∼Pr [fw(x)] L(Pr,Pg) 越小,表示 Pr 与 Pg 的 Wasserstein 距离越 小,GAN 训练得越好。 ·76· 智 能 系 统 学 报 第 15 卷