正在加载图片...

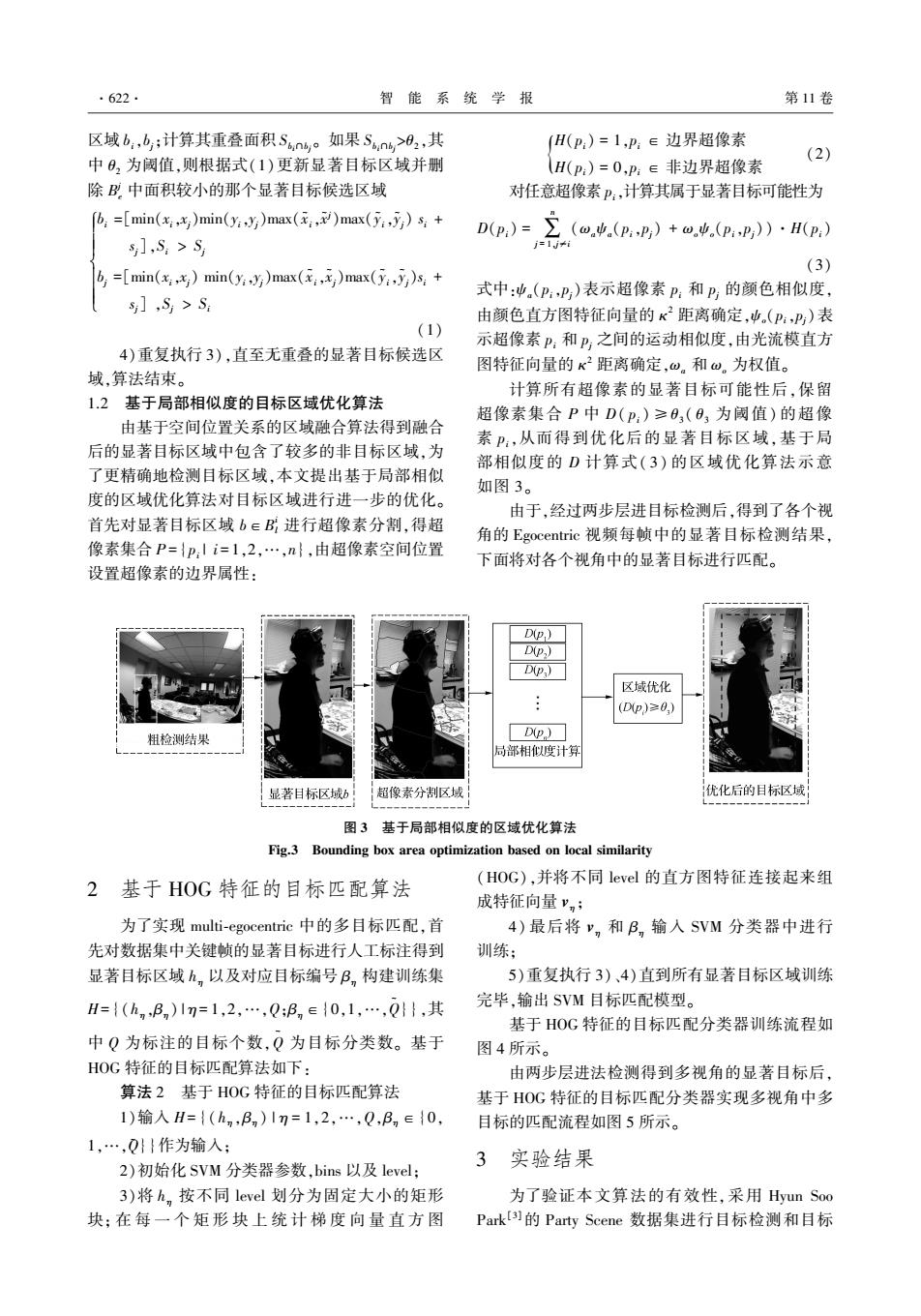

·622 智能系统学报 第11卷 区域b:,;计算其重叠面积Sn。如果Sn>82,其 H(p:)=1,P:∈边界超像素 (2) 中0,为阈值,则根据式(1)更新显著目标区域并删 H(P:)=0,P:∈非边界超像素 除队中面积较小的那个显著目标候选区域 对任意超像素p:,计算其属于显著目标可能性为 fb:=[min(x:,x)min(yy)max(元:,)max(:,)s+ D(p:)= (ω中.(P:P)+w.(p:,P))·H(P) s],S:>S i=1*i (3) b=[min(x:,x)min(y:y)max(元:,x)max(y:,y)s:+ 式中:山(P:P)表示超像素P:和p的颜色相似度, si],S;>S: 由颜色直方图特征向量的k2距离确定,中(P:,P)表 (1) 示超像素P:和P,之间的运动相似度,由光流模直方 4)重复执行3),直至无重叠的显著目标候选区 图特征向量的K2距离确定,ω。和ω。为权值。 域,算法结束。 计算所有超像素的显著目标可能性后,保留 1.2基于局部相似度的目标区域优化算法 超像素集合P中D(P:)≥0,(0,为阈值)的超像 由基于空间位置关系的区域融合算法得到融合 素P:,从而得到优化后的显著目标区域,基于局 后的显著目标区域中包含了较多的非目标区域,为 部相似度的D计算式(3)的区域优化算法示意 了更精确地检测目标区域,本文提出基于局部相似 如图3。 度的区域优化算法对目标区域进行进一步的优化。 由于,经过两步层进目标检测后,得到了各个视 首先对显著目标区域b∈B进行超像素分割,得超 角的Egocentric视频每帧中的显著目标检测结果, 像素集合P={p,|i=1,2,…,n},由超像素空间位置 下面将对各个视角中的显著目标进行匹配。 设置超像素的边界属性: D(p) D(p.) D(p,) 区域优化 (Dp)≥0) 粗检测结果 D(p) 局部相似度计算 显著目标区域b 超像素分割区域 优化后的目标区域 图3基于局部相似度的区域优化算法 Fig.3 Bounding box area optimization based on local similarity 2基于HOG特征的目标匹配算法 (HOG),并将不同level的直方图特征连接起来组 成特征向量,: 为了实现muli-egocentric中的多目标匹配,首 4)最后将',和B,输入SVM分类器中进行 先对数据集中关键帧的显著目标进行人工标注得到 训练 显著目标区域h,以及对应目标编号B,构建训练集 5)重复执行3)、4)直到所有显著目标区域训练 H={(hnBn)1m=1,2,…,Q:Bn∈{0,1,…,Q},其 完毕,输出SVM目标匹配模型。 基于HOG特征的目标匹配分类器训练流程如 中Q为标注的目标个数,Q为目标分类数。基于 图4所示。 HOG特征的目标匹配算法如下: 由两步层进法检测得到多视角的显著目标后, 算法2基于H0G特征的目标匹配算法 基于HOG特征的目标匹配分类器实现多视角中多 1)输入H={(hn,Bn)17=1,2,…,Q,B,∈{0, 目标的匹配流程如图5所示。 1,…,Q}作为输入: 3实验结果 2)初始化sVM分类器参数,bins以及level;: 3)将h,按不同level划分为固定大小的矩形 为了验证本文算法的有效性,采用Hyun Soo 块:在每一个矩形块上统计梯度向量直方图 Park[)的Party Scene数据集进行目标检测和目标区域 bi,bj;计算其重叠面积 Sbi∩bj 。 如果 Sbi∩bj >θ2 ,其 中 θ2 为阈值,则根据式(1)更新显著目标区域并删 除 B j e 中面积较小的那个显著目标候选区域 bi =[min(xi,xj)min(yi,yj)max(x ~ i,x ~ j)max(y ~ i,y ~ j) si + sj],Si > Sj bj =[min(xi,xj) min(yi,yj)max(x ~ i,x ~ j)max(y ~ i,y ~ j)si + sj] ,Sj > Si ì î í ï ï ï ï ïï (1) 4)重复执行 3),直至无重叠的显著目标候选区 域,算法结束。 1.2 基于局部相似度的目标区域优化算法 由基于空间位置关系的区域融合算法得到融合 后的显著目标区域中包含了较多的非目标区域,为 了更精确地检测目标区域,本文提出基于局部相似 度的区域优化算法对目标区域进行进一步的优化。 首先对显著目标区域 b∈B i l 进行超像素分割,得超 像素集合 P = {pi | i = 1,2,…,n},由超像素空间位置 设置超像素的边界属性: H(pi) = 1,pi ∈ 边界超像素 H(pi) = 0,p { i ∈ 非边界超像素 (2) 对任意超像素 pi,计算其属于显著目标可能性为 D(pi) = ∑ n j = 1,j≠i (ωaψa(pi,pj) + ωoψo(pi,pj))·H(pi) (3) 式中:ψa(pi,pj)表示超像素 pi 和 pj 的颜色相似度, 由颜色直方图特征向量的 κ 2 距离确定,ψo(pi,pj)表 示超像素 pi 和 pj 之间的运动相似度,由光流模直方 图特征向量的 κ 2 距离确定,ωa 和 ωo 为权值。 计算所有超像素的显著目标可能性后,保留 超像素集合 P 中 D( pi ) ≥θ3 ( θ3 为阈值) 的超像 素 pi,从而得到优化后的显著目标区域,基于局 部相似度的 D 计算式( 3) 的区域优化算法示意 如图 3。 由于,经过两步层进目标检测后,得到了各个视 角的 Egocentric 视频每帧中的显著目标检测结果, 下面将对各个视角中的显著目标进行匹配。 图 3 基于局部相似度的区域优化算法 Fig.3 Bounding box area optimization based on local similarity 2 基于 HOG 特征的目标匹配算法 为了实现 multi⁃egocentric 中的多目标匹配,首 先对数据集中关键帧的显著目标进行人工标注得到 显著目标区域 hη 以及对应目标编号 βη 构建训练集 H= {(hη ,βη ) | η = 1,2,…,Q;βη∈{0,1,…,Q ~ }},其 中 Q 为标注的目标个数,Q ~ 为目标分类数。 基于 HOG 特征的目标匹配算法如下: 算法 2 基于 HOG 特征的目标匹配算法 1)输入 H= {( hη ,βη ) | η = 1,2,…,Q,βη∈{0, 1,…,Q ~ }}作为输入; 2)初始化 SVM 分类器参数,bins 以及 level; 3)将 hη 按不同 level 划分为固定大小的矩形 块; 在 每 一 个 矩 形 块 上 统 计 梯 度 向 量 直 方 图 (HOG),并将不同 level 的直方图特征连接起来组 成特征向量 vη ; 4) 最后将 vη 和 βη 输入 SVM 分类器中进行 训练; 5)重复执行 3)、4)直到所有显著目标区域训练 完毕,输出 SVM 目标匹配模型。 基于 HOG 特征的目标匹配分类器训练流程如 图 4 所示。 由两步层进法检测得到多视角的显著目标后, 基于 HOG 特征的目标匹配分类器实现多视角中多 目标的匹配流程如图 5 所示。 3 实验结果 为了验证本文算法的有效性,采用 Hyun Soo Park [3]的 Party Scene 数据集进行目标检测和目标 ·622· 智 能 系 统 学 报 第 11 卷