正在加载图片...

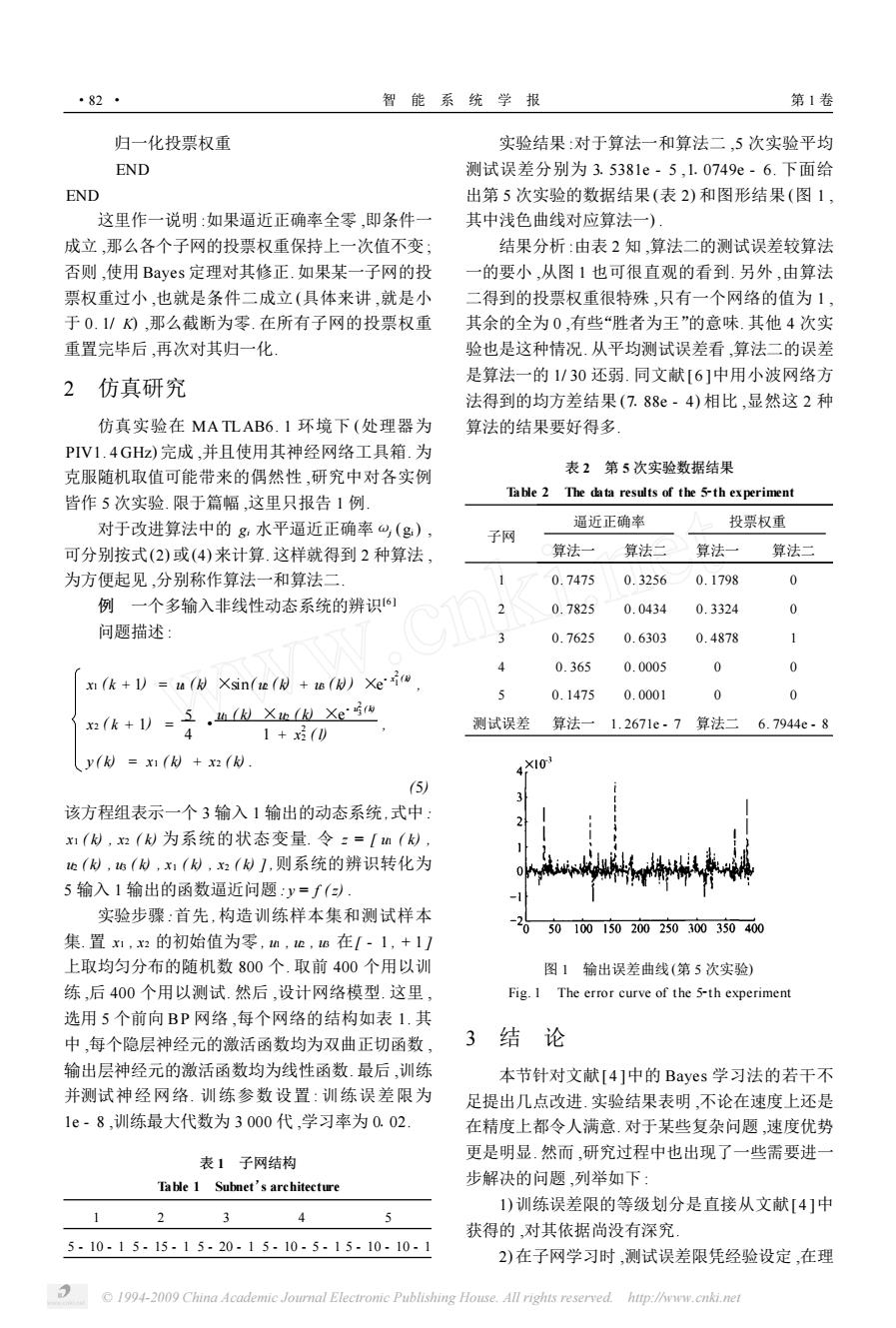

·82 智能系统学报 第1卷 归一化投票权重 实验结果:对于算法一和算法二,5次实验平均 END 测试误差分别为3.5381e-5,1.0749e-6.下面给 END 出第5次实验的数据结果(表2)和图形结果(图1, 这里作一说明:如果逼近正确率全零,即条件一 其中浅色曲线对应算法一). 成立,那么各个子网的投票权重保持上一次值不变; 结果分析:由表2知,算法二的测试误差较算法 否则,使用Bayes定理对其修正.如果某一子网的投 一的要小,从图1也可很直观的看到.另外,由算法 票权重过小,也就是条件二成立(具体来讲,就是小 二得到的投票权重很特殊,只有一个网络的值为1, 于0.1/),那么截断为零.在所有子网的投票权重 其余的全为0,有些“胜者为王”的意味.其他4次实 重置完毕后,再次对其归一化 验也是这种情况.从平均测试误差看,算法二的误差 是算法一的1/30还弱.同文献[6]中用小波网络方 2 仿真研究 法得到的均方差结果(7.88e-4)相比,显然这2种 仿真实验在MA TLAB6.1环境下(处理器为 算法的结果要好得多 PIV1.4GHz)完成,并且使用其神经网络工具箱.为 克服随机取值可能带来的偶然性,研究中对各实例 表2第5次实验数据结果 皆作5次实验.限于篇幅,这里只报告1例. Table 2 The data results of the 5-th experiment 对于改进算法中的g水平逼近正确率,(g), 逼近正确率 投票权重 子网 可分别按式(2)或(4)来计算.这样就得到2种算法, 算法一 算法二 算法一 算法二 为方便起见,分别称作算法一和算法二 0.7475 0.3256 0.1798 0 例一个多输入非线性动态系统的辨识6] 0.7825 0.0434 0.3324 0 问题描述: 0.7625 0.6303 0.4878 1 4 0.365 0.0005 0 0 x(k+1=u(k Xsin(ie (+(Xe 5 0.1475 0.0001 0 0 (k+=三.hXh的Xegw 测试误差 算法一1.2671e.7算法二6.7944e.8 1+x3(0 y(k)=x1()+x2(). 410 (5) 该方程组表示一个3输入1输出的动态系统,式中: x1(付,x2()为系统的状态变量.令:=[h(, W,6(,x1(,x2(J,则系统的辨识转化为 5输入1输出的函数逼近问题:y=∫() 实验步骤:首先,构造训练样本集和测试样本 50100150200250300350400 集.置x1,x2的初始值为零,h,b,B在[-1,+11 上取均匀分布的随机数800个.取前400个用以训 图1输出误差曲线(第5次实验) 练,后400个用以测试.然后,设计网络模型.这里, Fig.I The error curve of the 5-th experiment 选用5个前向BP网络,每个网络的结构如表1.其 中,每个隐层神经元的激活函数均为双曲正切函数, 3结论 输出层神经元的激活函数均为线性函数.最后,训练 本节针对文献[4]中的Bayes学习法的若干不 并测试神经网络.训练参数设置:训练误差限为 足提出几点改进.实验结果表明,不论在速度上还是 1e-8,训练最大代数为3000代,学习率为0.02 在精度上都令人满意.对于某些复杂问题,速度优势 更是明显.然而,研究过程中也出现了一些需要进一 表1子网结构 Table 1 Subnet's architecture 步解决的问题,列举如下: 1)训练误差限的等级划分是直接从文献[4]中 3 4 获得的,对其依据尚没有深究 5-10-15-15-15-20-15-10-5-15-10-10-1 2)在子网学习时,测试误差限凭经验设定,在理 1994-2009 China Academic Journal Electronic Publishing House.All rights reserved.http://www.cnki.net归一化投票权重 END END 这里作一说明 :如果逼近正确率全零 ,即条件一 成立 ,那么各个子网的投票权重保持上一次值不变 ; 否则 ,使用 Bayes 定理对其修正. 如果某一子网的投 票权重过小 ,也就是条件二成立 (具体来讲 ,就是小 于 0. 1/ K) ,那么截断为零. 在所有子网的投票权重 重置完毕后 ,再次对其归一化. 2 仿真研究 仿真实验在 MA TLAB6. 1 环境下 (处理器为 PIV1. 4 GHz) 完成 ,并且使用其神经网络工具箱. 为 克服随机取值可能带来的偶然性 ,研究中对各实例 皆作 5 次实验. 限于篇幅 ,这里只报告 1 例. 对于改进算法中的 gi 水平逼近正确率ωj (gi) , 可分别按式(2) 或(4) 来计算. 这样就得到 2 种算法 , 为方便起见 ,分别称作算法一和算法二. 例 一个多输入非线性动态系统的辨识[6 ] 问题描述 : x1 ( k + 1) = u1 ( k) ×sin( u2 ( k) + u3 ( k)) ×e - x 2 1 ( k) , x2 ( k + 1) = 5 4 · u1 ( k) ×u2 ( k) ×e - u 2 3 ( k) 1 + x 2 2 ( l) , y ( k) = x1 ( k) + x2 ( k) . (5) 该方程组表示一个 3 输入 1 输出的动态系统 ,式中 : x1 ( k) , x2 ( k) 为系统的状态变量. 令 z = [ u1 ( k) , u2 ( k) , u3 ( k) , x1 ( k) , x2 ( k) ] ,则系统的辨识转化为 5 输入 1 输出的函数逼近问题 : y = f ( z) . 实验步骤 :首先 ,构造训练样本集和测试样本 集. 置 x1 , x2 的初始值为零 , u1 , u2 , u3 在[ - 1 , + 1 ] 上取均匀分布的随机数 800 个. 取前 400 个用以训 练 ,后 400 个用以测试. 然后 ,设计网络模型. 这里 , 选用 5 个前向 BP 网络 ,每个网络的结构如表 1. 其 中 ,每个隐层神经元的激活函数均为双曲正切函数 , 输出层神经元的激活函数均为线性函数. 最后 ,训练 并测试神经网络. 训练参数设置 : 训练误差限为 1e - 8 ,训练最大代数为 3 000 代 ,学习率为 0102. 表 1 子网结构 Table 1 Subnet’s architecture 1 2 3 4 5 5 - 10 - 1 5 - 15 - 1 5 - 20 - 1 5 - 10 - 5 - 1 5 - 10 - 10 - 1 实验结果 :对于算法一和算法二 ,5 次实验平均 测试误差分别为 315381e - 5 ,110749e - 6. 下面给 出第 5 次实验的数据结果 (表 2) 和图形结果 (图 1 , 其中浅色曲线对应算法一) . 结果分析 :由表 2 知 ,算法二的测试误差较算法 一的要小 ,从图 1 也可很直观的看到. 另外 ,由算法 二得到的投票权重很特殊 ,只有一个网络的值为 1 , 其余的全为 0 ,有些“胜者为王”的意味. 其他 4 次实 验也是这种情况. 从平均测试误差看 ,算法二的误差 是算法一的 1/ 30 还弱. 同文献[ 6 ]中用小波网络方 法得到的均方差结果 (7188e - 4) 相比 ,显然这 2 种 算法的结果要好得多. 表 2 第 5 次实验数据结果 Table 2 The data results of the 52th experiment 子网 逼近正确率 投票权重 算法一 算法二 算法一 算法二 1 0. 7475 0. 3256 0. 1798 0 2 0. 7825 0. 0434 0. 3324 0 3 0. 7625 0. 6303 0. 4878 1 4 0. 365 0. 0005 0 0 5 0. 1475 0. 0001 0 0 测试误差 算法一 1. 2671e - 7 算法二 6. 7944e - 8 图 1 输出误差曲线(第 5 次实验) Fig. 1 The error curve of the 52th experiment 3 结 论 本节针对文献[ 4 ]中的 Bayes 学习法的若干不 足提出几点改进. 实验结果表明 ,不论在速度上还是 在精度上都令人满意. 对于某些复杂问题 ,速度优势 更是明显. 然而 ,研究过程中也出现了一些需要进一 步解决的问题 ,列举如下 : 1) 训练误差限的等级划分是直接从文献[ 4 ]中 获得的 ,对其依据尚没有深究. 2) 在子网学习时 ,测试误差限凭经验设定 ,在理 ·82 · 智 能 系 统 学 报 第 1 卷 © 1994-2009 China Academic Journal Electronic Publishing House. All rights reserved. http://www.cnki.net