正在加载图片...

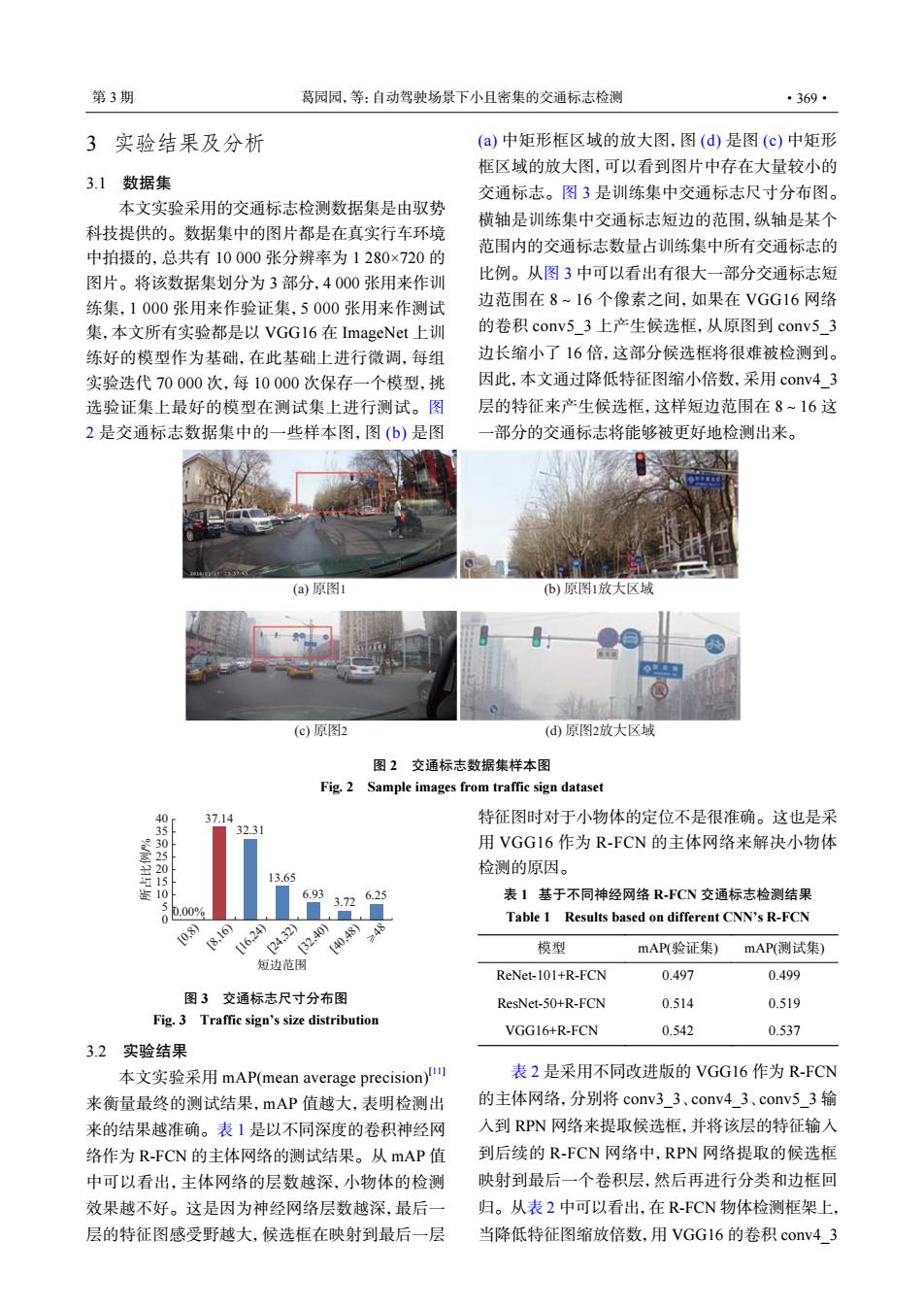

第3期 葛园园,等:自动驾驶场景下小且密集的交通标志检测 ·369· 3 实验结果及分析 (a)中矩形框区域的放大图,图(d)是图(c)中矩形 框区域的放大图,可以看到图片中存在大量较小的 3.1数据集 交通标志。图3是训练集中交通标志尺寸分布图。 本文实验采用的交通标志检测数据集是由驭势 横轴是训练集中交通标志短边的范围,纵轴是某个 科技提供的。数据集中的图片都是在真实行车环境 范围内的交通标志数量占训练集中所有交通标志的 中拍摄的,总共有10000张分辨率为1280×720的 图片。将该数据集划分为3部分,4000张用来作训 比例。从图3中可以看出有很大一部分交通标志短 练集,1000张用来作验证集,5000张用来作测试 边范围在8~16个像素之间,如果在VGG16网络 集,本文所有实验都是以VGGl6在ImageNet上训 的卷积conv53上产生候选框,从原图到conv53 练好的模型作为基础,在此基础上进行微调,每组 边长缩小了16倍,这部分候选框将很难被检测到。 实验迭代70000次,每10000次保存一个模型,挑 因此,本文通过降低特征图缩小倍数,采用conv4_3 选验证集上最好的模型在测试集上进行测试。图 层的特征来产生候选框,这样短边范围在8~16这 2是交通标志数据集中的一些样本图,图(b)是图 一部分的交通标志将能够被更好地检测出来。 色 (a)原图1 b)原图1放大区域 (c)原图2 (d原图2放大区域 图2交通标志数据集样本图 Fig.2 Sample images from traffic sign dataset 37.14 特征图时对于小物体的定位不是很准确。这也是采 050501510 32.31 用VGG16作为R-FCN的主体网络来解决小物体 检测的原因。 13.65 6.93 3.72 6.25 表1基于不同神经网络R-FCN交通标志检测结果 0 .00% Table 1 Results based on different CNN's R-FCN 0,8) [8,16 6,24 ge 模型 mAP(验证集) mAP(测试集) 短边范围 ReNet-101+R-FCN 0.497 0.499 图3交通标志尺寸分布图 ResNet-50+R-FCN 0.514 0.519 Fig.3 Traffic sign's size distribution VGG16+R-FCN 0.542 0.537 3.2实验结果 本文实验采用mAP(mean average precision)u 表2是采用不同改进版的VGG16作为R-FCN 来衡量最终的测试结果,mAP值越大,表明检测出 的主体网络,分别将conv3_3、conv4_3、conv5_3输 来的结果越准确。表1是以不同深度的卷积神经网 入到RPN网络来提取候选框,并将该层的特征输入 络作为R-FCN的主体网络的测试结果。从mAP值 到后续的R-FCN网络中,RPN网络提取的候选框 中可以看出,主体网络的层数越深,小物体的检测 映射到最后一个卷积层,然后再进行分类和边框回 效果越不好。这是因为神经网络层数越深,最后一 归。从表2中可以看出,在R-FCN物体检测框架上, 层的特征图感受野越大,候选框在映射到最后一层 当降低特征图缩放倍数,用VGG16的卷积conv433 实验结果及分析 3.1 数据集 本文实验采用的交通标志检测数据集是由驭势 科技提供的。数据集中的图片都是在真实行车环境 中拍摄的,总共有 10 000 张分辨率为 1 280×720 的 图片。将该数据集划分为 3 部分,4 000 张用来作训 练集,1 000 张用来作验证集,5 000 张用来作测试 集,本文所有实验都是以 VGG16 在 ImageNet 上训 练好的模型作为基础,在此基础上进行微调,每组 实验迭代 70 000 次,每 10 000 次保存一个模型,挑 选验证集上最好的模型在测试集上进行测试。图 2 是交通标志数据集中的一些样本图,图 (b) 是图 (a) 中矩形框区域的放大图,图 (d) 是图 (c) 中矩形 框区域的放大图,可以看到图片中存在大量较小的 交通标志。图 3 是训练集中交通标志尺寸分布图。 横轴是训练集中交通标志短边的范围,纵轴是某个 范围内的交通标志数量占训练集中所有交通标志的 比例。从图 3 中可以看出有很大一部分交通标志短 边范围在 8~16 个像素之间,如果在 VGG16 网络 的卷积 conv5_3 上产生候选框,从原图到 conv5_3 边长缩小了 16 倍,这部分候选框将很难被检测到。 因此,本文通过降低特征图缩小倍数,采用 conv4_3 层的特征来产生候选框,这样短边范围在 8~16 这 一部分的交通标志将能够被更好地检测出来。 3.2 实验结果 本文实验采用 mAP(mean average precision)[11] 来衡量最终的测试结果,mAP 值越大,表明检测出 来的结果越准确。表 1 是以不同深度的卷积神经网 络作为 R-FCN 的主体网络的测试结果。从 mAP 值 中可以看出,主体网络的层数越深,小物体的检测 效果越不好。这是因为神经网络层数越深,最后一 层的特征图感受野越大,候选框在映射到最后一层 特征图时对于小物体的定位不是很准确。这也是采 用 VGG16 作为 R-FCN 的主体网络来解决小物体 检测的原因。 表 2 是采用不同改进版的 VGG16 作为 R-FCN 的主体网络,分别将 conv3_3、conv4_3、conv5_3 输 入到 RPN 网络来提取候选框,并将该层的特征输入 到后续的 R-FCN 网络中,RPN 网络提取的候选框 映射到最后一个卷积层,然后再进行分类和边框回 归。从表 2 中可以看出,在 R-FCN 物体检测框架上, 当降低特征图缩放倍数,用 VGG16 的卷积 conv4_3 表 1 基于不同神经网络 R-FCN 交通标志检测结果 Table 1 Results based on different CNN’s R-FCN 模型 mAP(验证集) mAP(测试集) ReNet-101+R-FCN 0.497 0.499 ResNet-50+R-FCN 0.514 0.519 VGG16+R-FCN 0.542 0.537 (a) ࣋ప1 (c) ࣋ప2 (b) ࣋ప1ᩪ๓ࡦഋ (d) ࣋ప2ᩪ๓ࡦഋ 图 2 交通标志数据集样本图 Fig. 2 Sample images from traffic sign dataset 37.14 ᝬࢌa/cҷ/% 40 35 30 25 20 15 10 5 0 0.00% 32.31 13.65 6.93 3.72 6.25 ⴙ䓥㠯ఠ [0,8) [8,16) [16,24) [24,32) [32,40) [40,48) ı48 图 3 交通标志尺寸分布图 Fig. 3 Traffic sign’s size distribution 第 3 期 葛园园,等:自动驾驶场景下小且密集的交通标志检测 ·369·