正在加载图片...

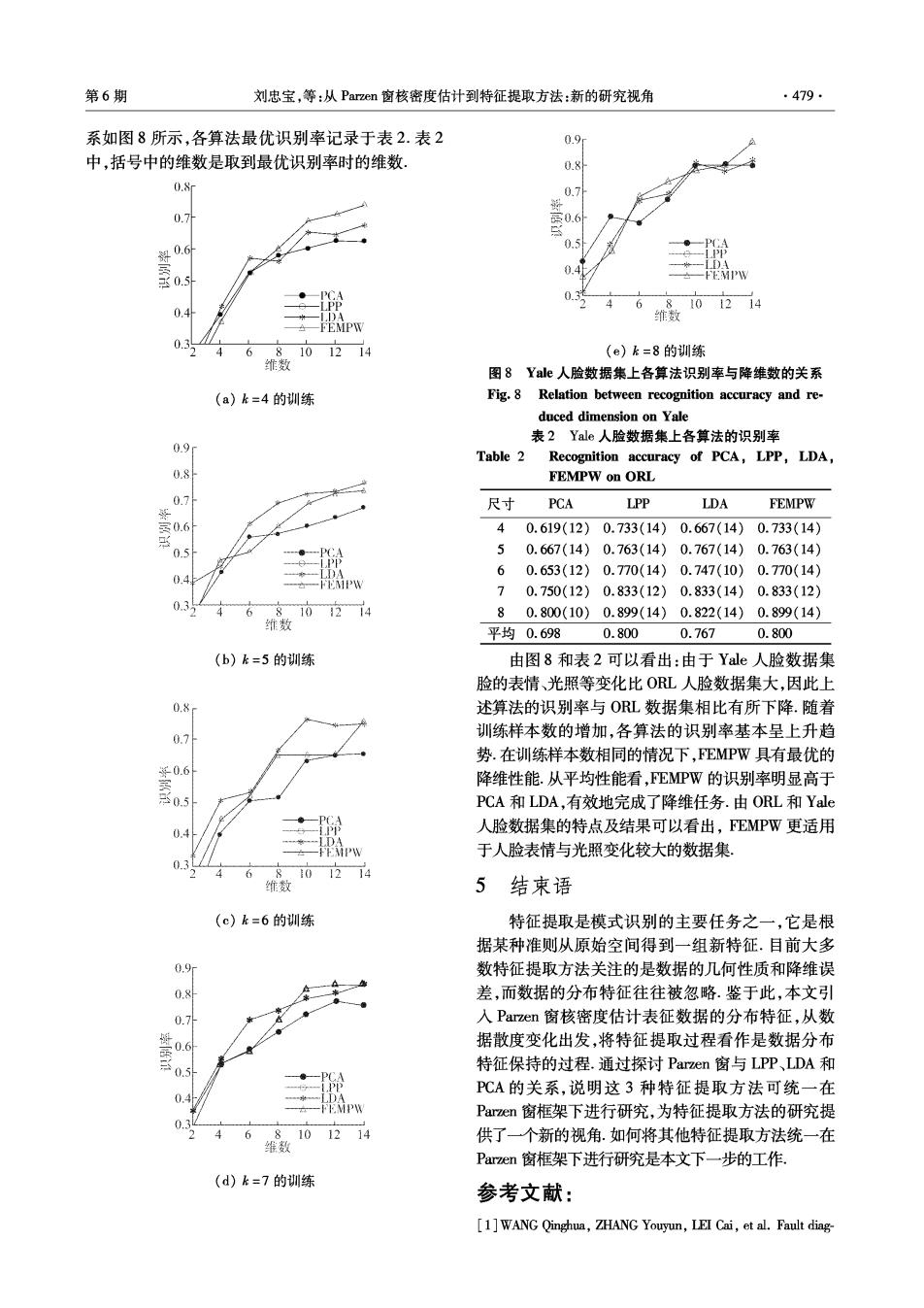

第6期 刘忠宝,等:从Parzen窗核密度估计到特征提取方法:新的研究视角 479 系如图8所示,各算法最优识别率记录于表2.表2 0.9 中,括号中的维数是取到最优识别率时的维数. 0.8 0.8 0.7 部06 宝a ●PCA -LPP 101214 0. *一LDA 维数 A—EMPW 6 ,810.1214 (e)k=8的训练 维数 图8Yle人脸数据集上各算法识别率与降维数的关系 (a)k=4的训练 Fig.8 Relation between recognition accuracy and re- duced dimension on Yale 表2Yale人脸数据集上各算法的识别率 0.9 Table 2 Recognition accuracy of PCA,LPP,LDA, 0.8 FEMPW on ORL 0.7 尺寸 PCA LPP LDA FEMPW 0.6 40.619(12)0.733(14)0.667(14)0.733(14) 8 0.5 50.667(14)0.763(14)0.767(14)0.763(14) 60.653(12)0.770(14) 0.747(10)0.770(14) 70.750(12)0.833(12)0.833(14)0.833(12) 6 802i4 80.800(10)0.899(14)0.822(14)0.899(14) 维数 平均0.698.0.800 0.7670.800 (b)k=5的训练 由图8和表2可以看出:由于Yale人脸数据集 脸的表情、光照等变化比OL人脸数据集大,因此上 0.8 述算法的识别率与OL数据集相比有所下降.随着 0.7 训练样本数的增加,各算法的识别率基本呈上升趋 势.在训练样本数相同的情况下,EMPW具有最优的 0.6 降维性能.从平均性能看,FEMPW的识别率明显高于 PCA和LDA,有效地完成了降维任务.由ORL和Yale 04 人脸数据集的特点及结果可以看出,FEMPW更适用 FEMPW 于人脸表情与光照变化较大的数据集。 8.0124 维数 5结束语 (c)k=6的训练 特征提取是模式识别的主要任务之一,它是根 据某种准则从原始空间得到一组新特征.目前大多 0.9 数特征提取方法关注的是数据的几何性质和降维误 0.8 差,而数据的分布特征往往被忽略.鉴于此,本文引 0.7 入Parzen窗核密度估计表征数据的分布特征,从数 0.6 据散度变化出发,将特征提取过程看作是数据分布 0.5 特征保持的过程.通过探讨Parzen窗与LPP、LDA和 P℃A的关系,说明这3种特征提取方法可统一在 0.4 Parzen窗框架下进行研究,为特征提取方法的研究提 0.3 6 8101214 供了一个新的视角.如何将其他特征提取方法统一在 维数 Parzen窗框架下进行研究是本文下一步的工作, (d)k=7的训练 参考文献: [1]WANG Qinghua,ZHANG Youyun,LEI Cai,et al.Fault diag-