正在加载图片...

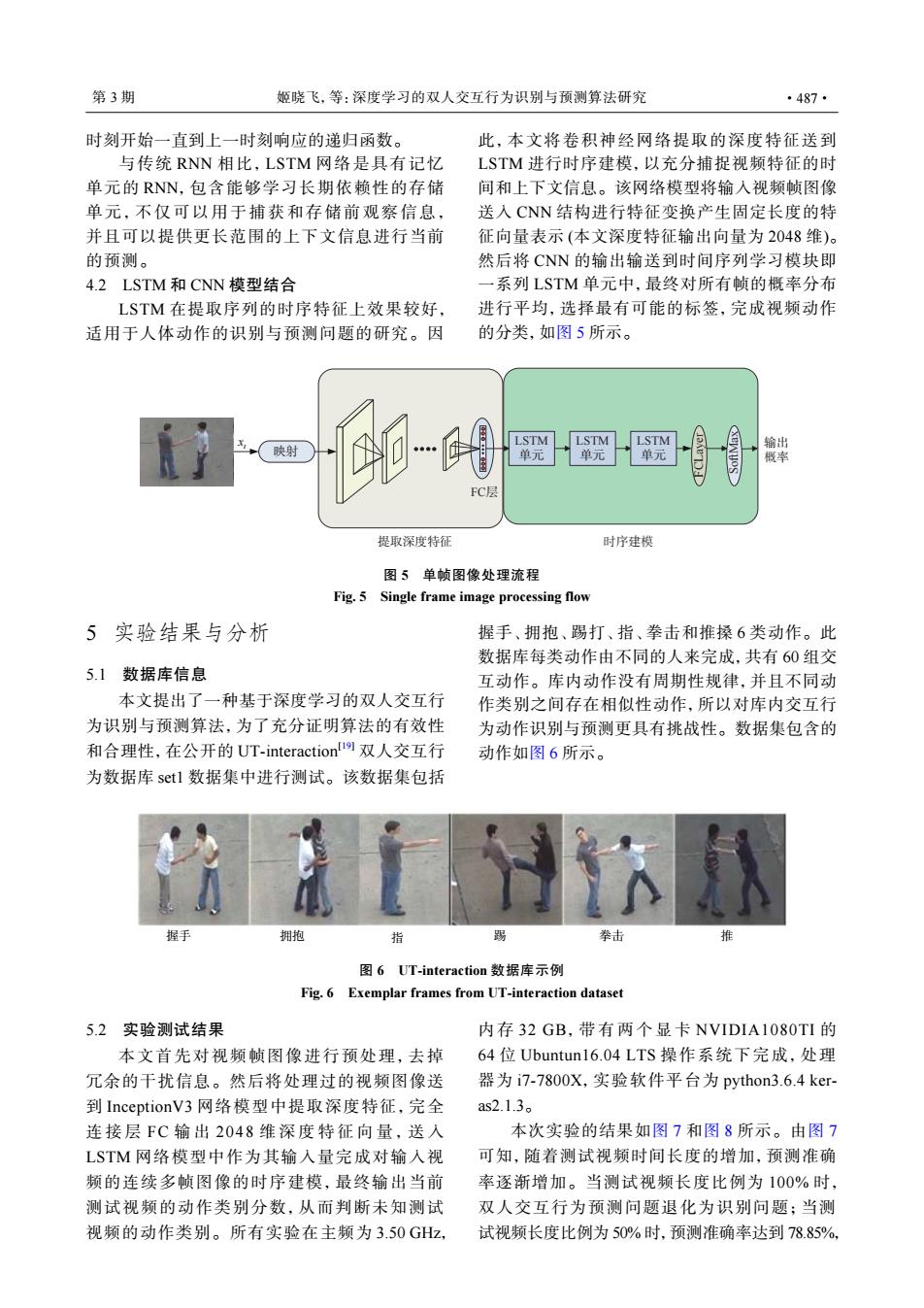

第3期 姬晓飞,等:深度学习的双人交互行为识别与预测算法研究 ·487· 时刻开始一直到上一时刻响应的递归函数。 此,本文将卷积神经网络提取的深度特征送到 与传统RNN相比,LSTM网络是具有记忆 LSTM进行时序建模,以充分捕捉视频特征的时 单元的RNN,包含能够学习长期依赖性的存储 间和上下文信息。该网络模型将输入视频帧图像 单元,不仅可以用于捕获和存储前观察信息, 送入CNN结构进行特征变换产生固定长度的特 并且可以提供更长范围的上下文信息进行当前 征向量表示(本文深度特征输出向量为2048维)。 的预测。 然后将CNN的输出输送到时间序列学习模块即 4.2LSTM和CNN模型结合 一系列LSTM单元中,最终对所有帧的概率分布 LSTM在提取序列的时序特征上效果较好, 进行平均,选择最有可能的标签,完成视频动作 适用于人体动作的识别与预测问题的研究。因 的分类,如图5所示。 S LSTM STM 单元 单元 单列 概率 FC层 提取深度特征 时序建模 图5单帧图像处理流程 Fig.5 Single frame image processing flow 5实验结果与分析 握手、拥抱、踢打、指、拳击和推搡6类动作。此 数据库每类动作由不同的人来完成,共有60组交 5.1数据库信息 互动作。库内动作没有周期性规律,并且不同动 本文提出了一种基于深度学习的双人交互行 作类别之间存在相似性动作,所以对库内交互行 为识别与预测算法,为了充分证明算法的有效性 为动作识别与预测更具有挑战性。数据集包含的 和合理性,在公开的UT-interaction双人交互行 动作如图6所示。 为数据库stl数据集中进行测试。该数据集包括 握手 拥抱 指 踢 拳击 推 图6UT-interaction数据库示例 Fig.6 Exemplar frames from UT-interaction dataset 5.2实验测试结果 内存32GB,带有两个显卡NVIDIA1080TI的 本文首先对视频帧图像进行预处理,去掉 64位Ubuntun16.04LTS操作系统下完成,处理 冗余的干扰信息。然后将处理过的视频图像送 器为i7-7800X,实验软件平台为python3..6.4ker 到InceptionV3网络模型中提取深度特征,完全 as2.1.3。 连接层FC输出2048维深度特征向量,送入 本次实验的结果如图7和图8所示。由图7 LSTM网络模型中作为其输入量完成对输入视 可知,随着测试视频时间长度的增加,预测准确 频的连续多帧图像的时序建模,最终输出当前 率逐渐增加。当测试视频长度比例为100%时, 测试视频的动作类别分数,从而判断未知测试 双人交互行为预测问题退化为识别问题;当测 视频的动作类别。所有实验在主频为3.50GHz, 试视频长度比例为50%时,预测准确率达到78.85%.时刻开始一直到上一时刻响应的递归函数。 与传统 RNN 相比,LSTM 网络是具有记忆 单元的 RNN,包含能够学习长期依赖性的存储 单元,不仅可以用于捕获和存储前观察信息, 并且可以提供更长范围的上下文信息进行当前 的预测。 4.2 LSTM 和 CNN 模型结合 LSTM 在提取序列的时序特征上效果较好, 适用于人体动作的识别与预测问题的研究。因 此,本文将卷积神经网络提取的深度特征送到 LSTM 进行时序建模,以充分捕捉视频特征的时 间和上下文信息。该网络模型将输入视频帧图像 送入 CNN 结构进行特征变换产生固定长度的特 征向量表示 (本文深度特征输出向量为 2048 维)。 然后将 CNN 的输出输送到时间序列学习模块即 一系列 LSTM 单元中,最终对所有帧的概率分布 进行平均,选择最有可能的标签,完成视频动作 的分类,如图 5 所示。 映射 LSTM 单元 FCLayer SoftMax 提取深度特征 FC层 时序建模 输出 概率 LSTM 单元 LSTM 单元 xt 图 5 单帧图像处理流程 Fig. 5 Single frame image processing flow 5 实验结果与分析 5.1 数据库信息 本文提出了一种基于深度学习的双人交互行 为识别与预测算法,为了充分证明算法的有效性 和合理性,在公开的 UT-interaction[19] 双人交互行 为数据库 set1 数据集中进行测试。该数据集包括 握手、拥抱、踢打、指、拳击和推搡 6 类动作。此 数据库每类动作由不同的人来完成,共有 60 组交 互动作。库内动作没有周期性规律,并且不同动 作类别之间存在相似性动作,所以对库内交互行 为动作识别与预测更具有挑战性。数据集包含的 动作如图 6 所示。 握手 拥抱 踢 拳击 推 指 图 6 UT-interaction 数据库示例 Fig. 6 Exemplar frames from UT-interaction dataset 5.2 实验测试结果 本文首先对视频帧图像进行预处理,去掉 冗余的干扰信息。然后将处理过的视频图像送 到 InceptionV3 网络模型中提取深度特征,完全 连 接 层 FC 输 出 2048 维深度特征向量,送 入 LSTM 网络模型中作为其输入量完成对输入视 频的连续多帧图像的时序建模,最终输出当前 测试视频的动作类别分数,从而判断未知测试 视频的动作类别。所有实验在主频为 3.50 GHz, 内 存 32 GB,带有两个显 卡 NVIDIA1080TI 的 64 位 Ubuntun16.04 LTS 操作系统下完成,处理 器为 i7-7800X,实验软件平台为 python3.6.4 keras2.1.3。 本次实验的结果如图 7 和图 8 所示。由图 7 可知,随着测试视频时间长度的增加,预测准确 率逐渐增加。当测试视频长度比例为 100% 时, 双人交互行为预测问题退化为识别问题;当测 试视频长度比例为 50% 时,预测准确率达到 78.85%, 第 3 期 姬晓飞,等:深度学习的双人交互行为识别与预测算法研究 ·487·