正在加载图片...

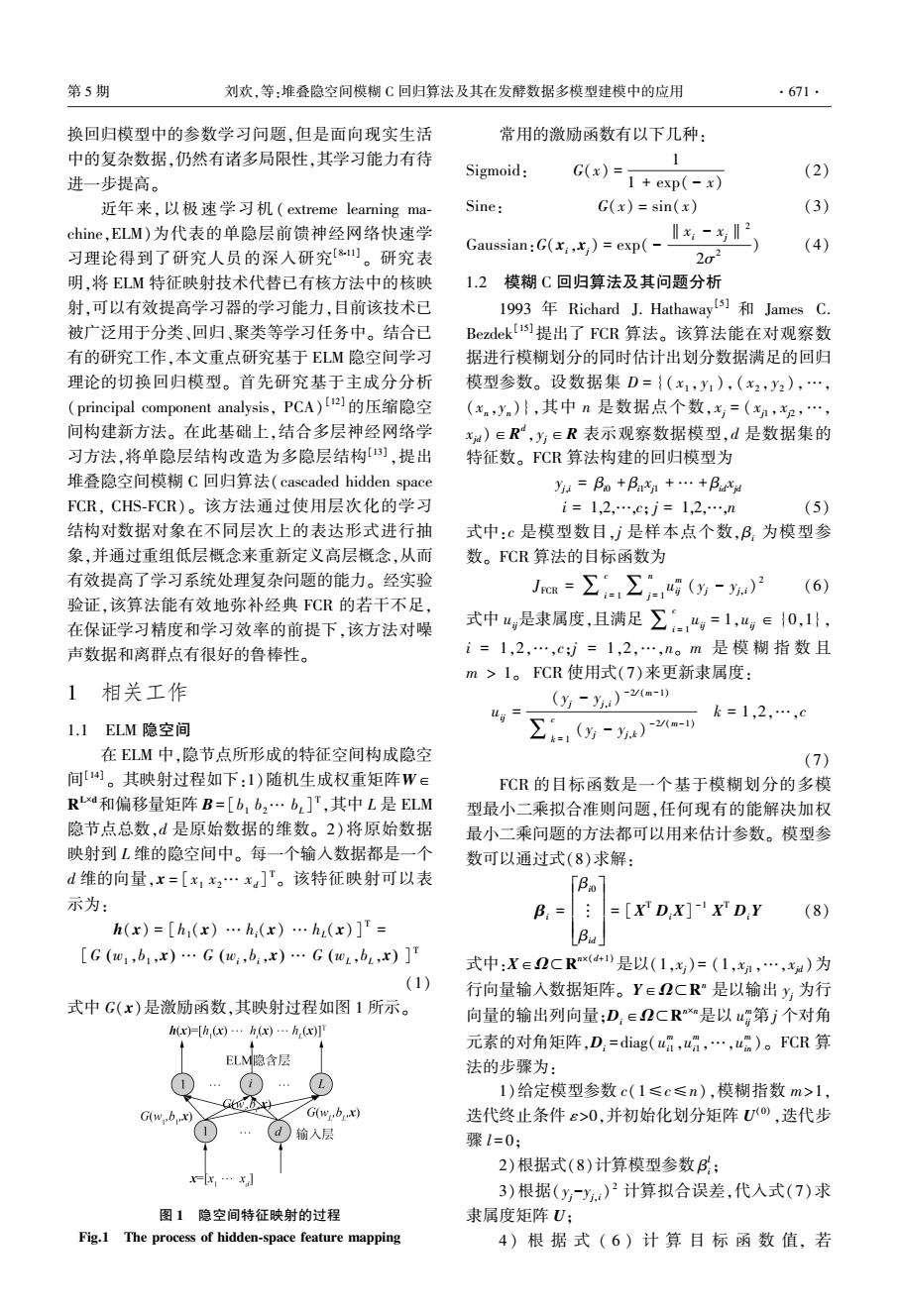

第5期 刘欢,等:堆叠隐空间模糊C回归算法及其在发酵数据多模型建模中的应用 .671. 换回归模型中的参数学习问题,但是面向现实生活 常用的激励函数有以下几种: 中的复杂数据,仍然有诸多局限性,其学习能力有待 1 Sigmoid: G(x)= (2 进一步提高。 1 exp(-x) 近年来,以极速学习机(extreme learning ma- Sine: G(x)=sin(x) (3 chine,ELM)为代表的单隐层前馈神经网络快速学 名-龙川2 (4) 习理论得到了研究人员的深入研究[81。研究表 Gaussian:G(x;,x)=exp(- 2c2 明,将ELM特征映射技术代替已有核方法中的核映 1.2模糊C回归算法及其问题分析 射,可以有效提高学习器的学习能力,目前该技术已 l993年Richard J.Hathaway)和James C. 被广泛用于分类、回归、聚类等学习任务中。结合已 Bezdek[i提出了FCR算法。该算法能在对观察数 有的研究工作,本文重点研究基于ELM隐空间学习 据进行模糊划分的同时估计出划分数据满足的回归 理论的切换回归模型。首先研究基于主成分分析 模型参数。设数据集D={(x1,少1),(x2,Y),, (principal component analysis,.PCA)[]的压缩隐空 (xnyn)},其中n是数据点个数,x=(x1,x2,, 间构建新方法。在此基础上,结合多层神经网络学 xa)∈R,为∈R表示观察数据模型,d是数据集的 习方法,将单隐层结构改造为多隐层结构)],提出 特征数。FCR算法构建的回归模型为 堆叠隐空间模糊C回归算法(cascaded hidden space y:=Bo0+B1+…+B FCR,CHS-FCR)。该方法通过使用层次化的学习 i=1,2,…,c;j=1,2,…,n (5) 结构对数据对象在不同层次上的表达形式进行抽 式中:c是模型数目,j是样本点个数,B为模型参 象,并通过重组低层概念来重新定义高层概念,从而 数。FCR算法的目标函数为 有效提高了学习系统处理复杂问题的能力。经实验 Jm=∑∑(y-)2 (6) 验证,该算法能有效地弥补经典FCR的若干不足, 在保证学习精度和学习效率的前提下,该方法对噪 式中“,是隶属度,且满足∑4,=1,山∈10,1, 声数据和离群点有很好的鲁棒性。 i=1,2,…,c)=1,2,…,n。m是模糊指数且 m>1。FCR使用式(7)来更新隶属度: 1相关工作 (y-a)-a-) k=1,2,…,C 1.1ELM隐空间 ∑,(6y-)-- 在ELM中,隐节点所形成的特征空间构成隐空 (7) 间)。其映射过程如下:I)随机生成权重矩阵W∈ FCR的目标函数是一个基于模糊划分的多模 Ra和偏移量矩阵B=[b,b2…b]T,其中L是ELM 型最小二乘拟合准则问题,任何现有的能解决加权 隐节点总数,d是原始数据的维数。2)将原始数据 最小二乘问题的方法都可以用来估计参数。模型参 映射到L维的隐空间中。每一个输入数据都是一个 数可以通过式(8)求解: d维的向量,x=[x,x2…x]T。该特征映射可以表 示为: B:= [X DXXDY (8) h(r)=[h(x)…h,(x)…h(x)]I= [G(01,b1,x)…G(0:,b:,x)…G(e,b,x)]T 式中:X∈2CR(是以(1,x)=(1,x,…,)为 (1) 行向量输入数据矩阵。Y∈2CR”是以输出y为行 式中G(x)是激励函数,其映射过程如图1所示。 向量的输出列向量:D:∈2CRx是以第j个对角 h(x=[h,(x)·h(x)…h,x] 元素的对角矩阵,D,=diag(a,a,…,%)。FCR算 ELM隐含层 法的步骤为: 1)给定模型参数c(1≤c≤n),模糊指数m>1, G(w.bx) G(wbx) 迭代终止条件ε>0,并初始化划分矩阵),迭代步 d)输入层 骤1=0; 2)根据式(8)计算模型参数B:; =x,…xJ 3)根据(y)2计算拟合误差,代入式(7)求 图1隐空间特征映射的过程 隶属度矩阵U; Fig.1 The process of hidden-space feature mapping 4)根据式(6)计算目标函数值,若换回归模型中的参数学习问题,但是面向现实生活 中的复杂数据,仍然有诸多局限性,其学习能力有待 进一步提高。 近年来, 以极速学习机 ( extreme learning ma⁃ chine,ELM)为代表的单隐层前馈神经网络快速学 习理论得到了研究人员的深入研究[8⁃11] 。 研究表 明,将 ELM 特征映射技术代替已有核方法中的核映 射,可以有效提高学习器的学习能力,目前该技术已 被广泛用于分类、回归、聚类等学习任务中。 结合已 有的研究工作,本文重点研究基于 ELM 隐空间学习 理论的切换回归模型。 首先研究基于主成分分析 (principal component analysis, PCA) [12] 的压缩隐空 间构建新方法。 在此基础上,结合多层神经网络学 习方法,将单隐层结构改造为多隐层结构[13] ,提出 堆叠隐空间模糊 C 回归算法(cascaded hidden space FCR, CHS⁃FCR)。 该方法通过使用层次化的学习 结构对数据对象在不同层次上的表达形式进行抽 象,并通过重组低层概念来重新定义高层概念,从而 有效提高了学习系统处理复杂问题的能力。 经实验 验证,该算法能有效地弥补经典 FCR 的若干不足, 在保证学习精度和学习效率的前提下,该方法对噪 声数据和离群点有很好的鲁棒性。 1 相关工作 1.1 ELM 隐空间 在 ELM 中,隐节点所形成的特征空间构成隐空 间[14] 。 其映射过程如下:1)随机生成权重矩阵W∈ R L×d和偏移量矩阵 B= [b1 b2… bL ] T ,其中 L 是 ELM 隐节点总数,d 是原始数据的维数。 2)将原始数据 映射到 L 维的隐空间中。 每一个输入数据都是一个 d 维的向量,x = [x1 x2… xd ] T 。 该特征映射可以表 示为: h(x) = [h1(x) … hi(x) … hL(x)] T = [G w1 ,b ( 1 ,x) … G wi,b ( i,x) … G wL ,b ( L ,x) ] T (1) 式中 G(x)是激励函数,其映射过程如图 1 所示。 图 1 隐空间特征映射的过程 Fig.1 The process of hidden⁃space feature mapping 常用的激励函数有以下几种: Sigmoid: G(x) = 1 1 + exp( - x) (2) Sine: G(x) = sin(x) (3) Gaussian:G(xi,xj) = exp( - ‖xi - xj‖2 2σ 2 ) (4) 1.2 模糊 C 回归算法及其问题分析 1993 年 Richard J. Hathaway [5] 和 James C. Bezdek [15]提出了 FCR 算法。 该算法能在对观察数 据进行模糊划分的同时估计出划分数据满足的回归 模型参数。 设数据集 D = {( x1 , y1 ), ( x2 , y2 ),…, (xn ,yn )},其中 n 是数据点个数,xj = ( xj1 ,xj2 ,…, xjd )∈R d ,yj∈R 表示观察数据模型,d 是数据集的 特征数。 FCR 算法构建的回归模型为 yj,i = βi0 + βi1 xj1 + … + βid xjd i = 1,2,…,c; j = 1,2,…,n (5) 式中:c 是模型数目,j 是样本点个数,βi 为模型参 数。 FCR 算法的目标函数为 JFCR = ∑ c i = 1∑ n j = 1 u m ij (yj - yj,i) 2 (6) 式中 uij是隶属度,且满足 ∑ c i = 1 uij = 1,uij ∈ {0,1}, i = 1,2,…,c;j = 1,2,…,n。 m 是 模 糊 指 数 且 m > 1。 FCR 使用式(7)来更新隶属度: uij = (yj - yj,i) -2/ (m-1) ∑ c k = 1 (yj - yj,k) -2/ (m-1) k = 1,2,…,c (7) FCR 的目标函数是一个基于模糊划分的多模 型最小二乘拟合准则问题,任何现有的能解决加权 最小二乘问题的方法都可以用来估计参数。 模型参 数可以通过式(8)求解: βi = βi0 ︙ βid é ë ê ê ê ê ù û ú ú ú ú = [X T DiX] -1 X T DiY (8) 式中:X∈Ω⊂R n×(d+1)是以(1,xj)= (1,xj1 ,…,xjd )为 行向量输入数据矩阵。 Y∈Ω⊂R n 是以输出 yj 为行 向量的输出列向量;Di∈Ω⊂R n×n是以 u m ij 第 j 个对角 元素的对角矩阵,Di = diag(u m i1 ,u m i1 ,…,u m in )。 FCR 算 法的步骤为: 1)给定模型参数 c(1≤c≤n),模糊指数 m>1, 迭代终止条件 ε>0,并初始化划分矩阵 U (0) ,迭代步 骤 l = 0; 2)根据式(8)计算模型参数 β l i; 3)根据(yj -yj,i) 2 计算拟合误差,代入式(7)求 隶属度矩阵 U; 4 ) 根 据 式 ( 6 ) 计 算 目 标 函 数 值, 若 第 5 期 刘欢,等:堆叠隐空间模糊 C 回归算法及其在发酵数据多模型建模中的应用 ·671·