正在加载图片...

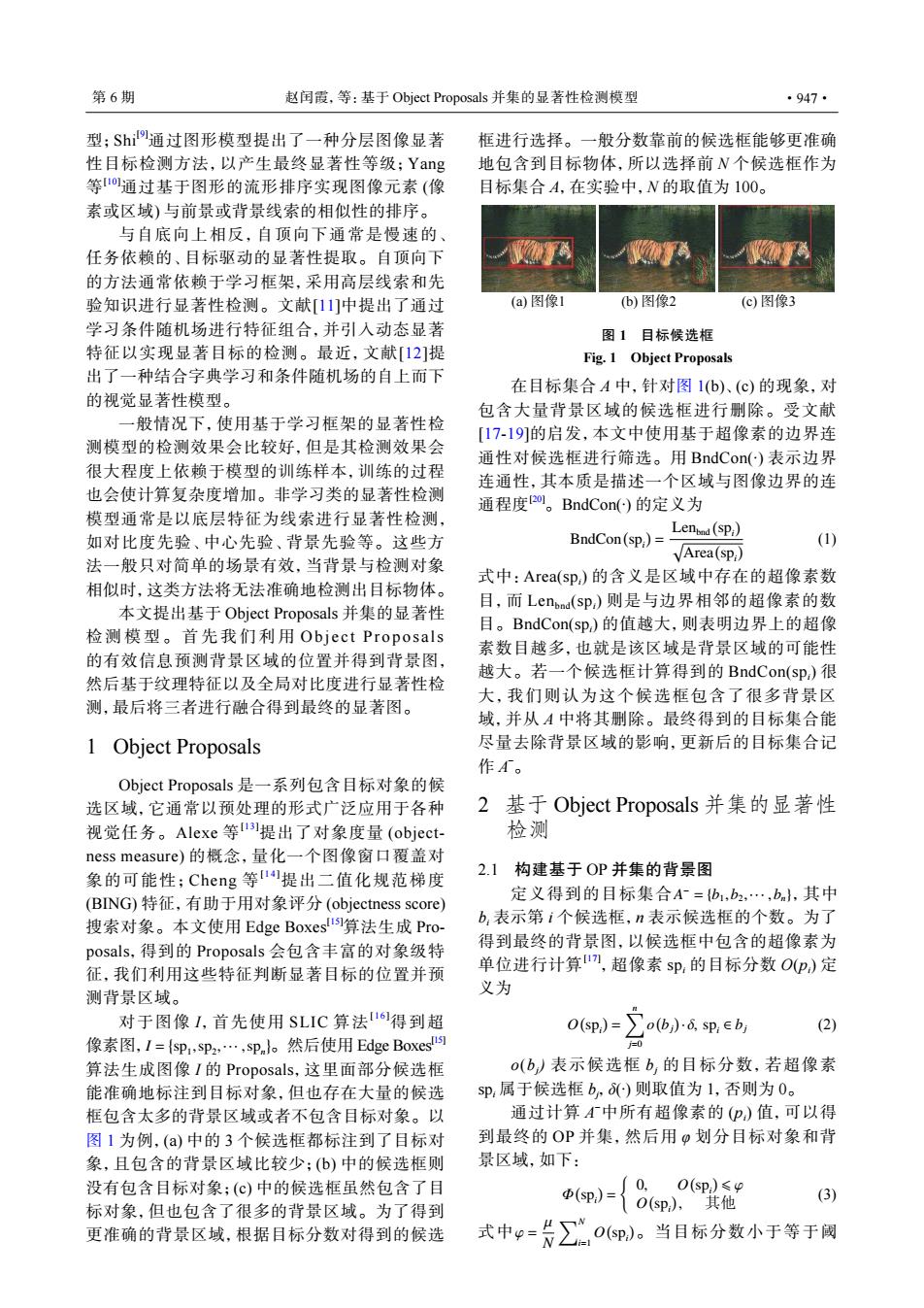

第6期 赵闰霞,等:基于Object Proposals并集的显著性检测模型 ·947· 型;Shi通过图形模型提出了一种分层图像显著 框进行选择。一般分数靠前的候选框能够更准确 性目标检测方法,以产生最终显著性等级;Yang 地包含到目标物体,所以选择前N个候选框作为 等通过基于图形的流形排序实现图像元素(像 目标集合A,在实验中,N的取值为100。 素或区域)与前景或背景线索的相似性的排序。 与自底向上相反,自顶向下通常是慢速的 任务依赖的、目标驱动的显著性提取。自顶向下 的方法通常依赖于学习框架,采用高层线索和先 验知识进行显著性检测。文献[11]中提出了通过 (a)图像1 (b)图像2 (c)图像3 学习条件随机场进行特征组合,并引人动态显著 图1目标候选框 特征以实现显著目标的检测。最近,文献[12]提 Fig.1 Object Proposals 出了一种结合字典学习和条件随机场的自上而下 在目标集合A中,针对图1(b)、(c)的现象,对 的视觉显著性模型。 包含大量背景区域的候选框进行删除。受文献 一般情况下,使用基于学习框架的显著性检 [17-19]的启发,本文中使用基于超像素的边界连 测模型的检测效果会比较好,但是其检测效果会 通性对候选框进行筛选。用BndCon()表示边界 很大程度上依赖于模型的训练样本,训练的过程 连通性,其本质是描述一个区域与图像边界的连 也会使计算复杂度增加。非学习类的显著性检测 通程度2o。BndCon()的定义为 模型通常是以底层特征为线索进行显著性检测, Lentnd (sp:) 如对比度先验、中心先验、背景先验等。这些方 BndCon(sp)=- (1) VArea(sp:) 法一般只对简单的场景有效,当背景与检测对象 式中:Area(sp,)的含义是区域中存在的超像素数 相似时,这类方法将无法准确地检测出目标物体。 本文提出基于Object Proposals并集的显著性 目,而Lenpna((sp,)则是与边界相邻的超像素的数 检测模型。首先我们利用Object Proposals 目。BndCon(sp,)的值越大,则表明边界上的超像 素数目越多,也就是该区域是背景区域的可能性 的有效信息预测背景区域的位置并得到背景图, 越大。若一个候选框计算得到的BndCon(sp,)很 然后基于纹理特征以及全局对比度进行显著性检 大,我们则认为这个候选框包含了很多背景区 测,最后将三者进行融合得到最终的显著图。 域,并从A中将其删除。最终得到的目标集合能 Object Proposals 尽量去除背景区域的影响,更新后的目标集合记 作厂。 Object Proposals是一系列包含目标对象的候 选区域,它通常以预处理的形式广泛应用于各种 2基于Object Proposals并集的显著性 视觉任务。Alexe等I31提出了对象度量(object- 检测 ness measure)的概念,量化一个图像窗口覆盖对 象的可能性;Cheng等提出二值化规范梯度 2.1构建基于OP并集的背景图 (BING)特征,有助于用对象评分(objectness score) 定义得到的目标集合A=b,b2,…,bn,其中 搜索对象。本文使用Edge Boxes!算法生成Pro- b,表示第i个候选框,n表示候选框的个数。为了 posals,得到的Proposals会包含丰富的对象级特 得到最终的背景图,以候选框中包含的超像素为 征,我们利用这些特征判断显著目标的位置并预 单位进行计算1”,超像素sp,的目标分数O(P,)定 测背景区域。 义为 对于图像I,首先使用SLIC算法11得到超 0(sp,)=∑ob)dsp,eb (2) 像素图,I={sp1,sp2,…,spml。然后使用Edge Boxes 0 算法生成图像I的Proposals,这里面部分候选框 o(b)表示候选框b,的目标分数,若超像素 能准确地标注到目标对象,但也存在大量的候选 sp:属于候选框b,)则取值为1,否则为0。 框包含太多的背景区域或者不包含目标对象。以 通过计算A厂中所有超像素的(P,)值,可以得 图1为例,(a)中的3个候选框都标注到了目标对 到最终的OP并集,然后用φ划分目标对象和背 象,且包含的背景区域比较少:(b)中的候选框则 景区域,如下: 没有包含目标对象;(©)中的候选框虽然包含了目 Φ(sp)= 0 O(sp)≤9 标对象,但也包含了很多的背景区域。为了得到 O(sp),其他 (3) 更准确的背景区域,根据目标分数对得到的候选 式中p= ∑0仰)。当目标分数小于等于阙型;Shi[9]通过图形模型提出了一种分层图像显著 性目标检测方法,以产生最终显著性等级;Yang 等 [10]通过基于图形的流形排序实现图像元素 (像 素或区域) 与前景或背景线索的相似性的排序。 与自底向上相反,自顶向下通常是慢速的、 任务依赖的、目标驱动的显著性提取。自顶向下 的方法通常依赖于学习框架,采用高层线索和先 验知识进行显著性检测。文献[11]中提出了通过 学习条件随机场进行特征组合,并引入动态显著 特征以实现显著目标的检测。最近,文献[12]提 出了一种结合字典学习和条件随机场的自上而下 的视觉显著性模型。 一般情况下,使用基于学习框架的显著性检 测模型的检测效果会比较好,但是其检测效果会 很大程度上依赖于模型的训练样本,训练的过程 也会使计算复杂度增加。非学习类的显著性检测 模型通常是以底层特征为线索进行显著性检测, 如对比度先验、中心先验、背景先验等。这些方 法一般只对简单的场景有效,当背景与检测对象 相似时,这类方法将无法准确地检测出目标物体。 本文提出基于 Object Proposals 并集的显著性 检测模型。首先我们利 用 Object Proposals 的有效信息预测背景区域的位置并得到背景图, 然后基于纹理特征以及全局对比度进行显著性检 测,最后将三者进行融合得到最终的显著图。 1 Object Proposals Object Proposals 是一系列包含目标对象的候 选区域,它通常以预处理的形式广泛应用于各种 视觉任务。Alexe 等 [13]提出了对象度量 (objectness measure) 的概念,量化一个图像窗口覆盖对 象的可能性;Cheng 等 [ 1 4 ]提出二值化规范梯度 (BING) 特征,有助于用对象评分 (objectness score) 搜索对象。本文使用 Edge Boxes[15]算法生成 Proposals,得到的 Proposals 会包含丰富的对象级特 征,我们利用这些特征判断显著目标的位置并预 测背景区域。 I = { sp1 ,sp2 ,··· ,spn } 对于图像 I,首先使用 SLIC 算法[ 1 6 ]得到超 像素图, 。然后使用 Edge Boxes[15] 算法生成图像 I 的 Proposals,这里面部分候选框 能准确地标注到目标对象,但也存在大量的候选 框包含太多的背景区域或者不包含目标对象。以 图 1 为例,(a) 中的 3 个候选框都标注到了目标对 象,且包含的背景区域比较少;(b) 中的候选框则 没有包含目标对象;(c) 中的候选框虽然包含了目 标对象,但也包含了很多的背景区域。为了得到 更准确的背景区域,根据目标分数对得到的候选 框进行选择。一般分数靠前的候选框能够更准确 地包含到目标物体,所以选择前 N 个候选框作为 目标集合 A,在实验中,N 的取值为 100。 在目标集合 A 中,针对图 1(b)、(c) 的现象,对 包含大量背景区域的候选框进行删除。受文献 [17-19]的启发,本文中使用基于超像素的边界连 通性对候选框进行筛选。用 BndCon(∙) 表示边界 连通性,其本质是描述一个区域与图像边界的连 通程度[20]。BndCon(∙) 的定义为 BndCon( spi ) = Lenbnd ( spi ) √ Area ( spi ) (1) 式中:Area(spi ) 的含义是区域中存在的超像素数 目,而 Lenbnd(spi ) 则是与边界相邻的超像素的数 目。BndCon(spi ) 的值越大,则表明边界上的超像 素数目越多,也就是该区域是背景区域的可能性 越大。若一个候选框计算得到的 BndCon(spi ) 很 大,我们则认为这个候选框包含了很多背景区 域,并从 A 中将其删除。最终得到的目标集合能 尽量去除背景区域的影响,更新后的目标集合记 作 A –。 2 基于 Object Proposals 并集的显著性 检测 2.1 构建基于 OP 并集的背景图 A − 定义得到的目标集合 = {b1,b2,··· ,bn} ,其中 bi 表示第 i 个候选框,n 表示候选框的个数。为了 得到最终的背景图,以候选框中包含的超像素为 单位进行计算[17] ,超像素 spi 的目标分数 O(pi ) 定 义为 O ( spi ) = ∑n j=0 o ( bj ) · δ, spi ∈ bj (2) o(bj ) 表示候选框 bj 的目标分数,若超像素 spi 属于候选框 bj,δ(∙) 则取值为 1,否则为 0。 通过计算 A –中所有超像素的 (pi ) 值,可以得 到最终的 OP 并集,然后用 φ 划分目标对象和背 景区域,如下: Φ ( spi ) = { 0, O ( spi ) , O ( spi ) ⩽ φ 其他 (3) φ = µ N ∑N i=1 O ( spi ) 式中 。当目标分数小于等于阈 (a) 图像1 (b) 图像2 (c) 图像3 图 1 目标候选框 Fig. 1 Object Proposals 第 6 期 赵闰霞,等:基于 Object Proposals 并集的显著性检测模型 ·947·