正在加载图片...

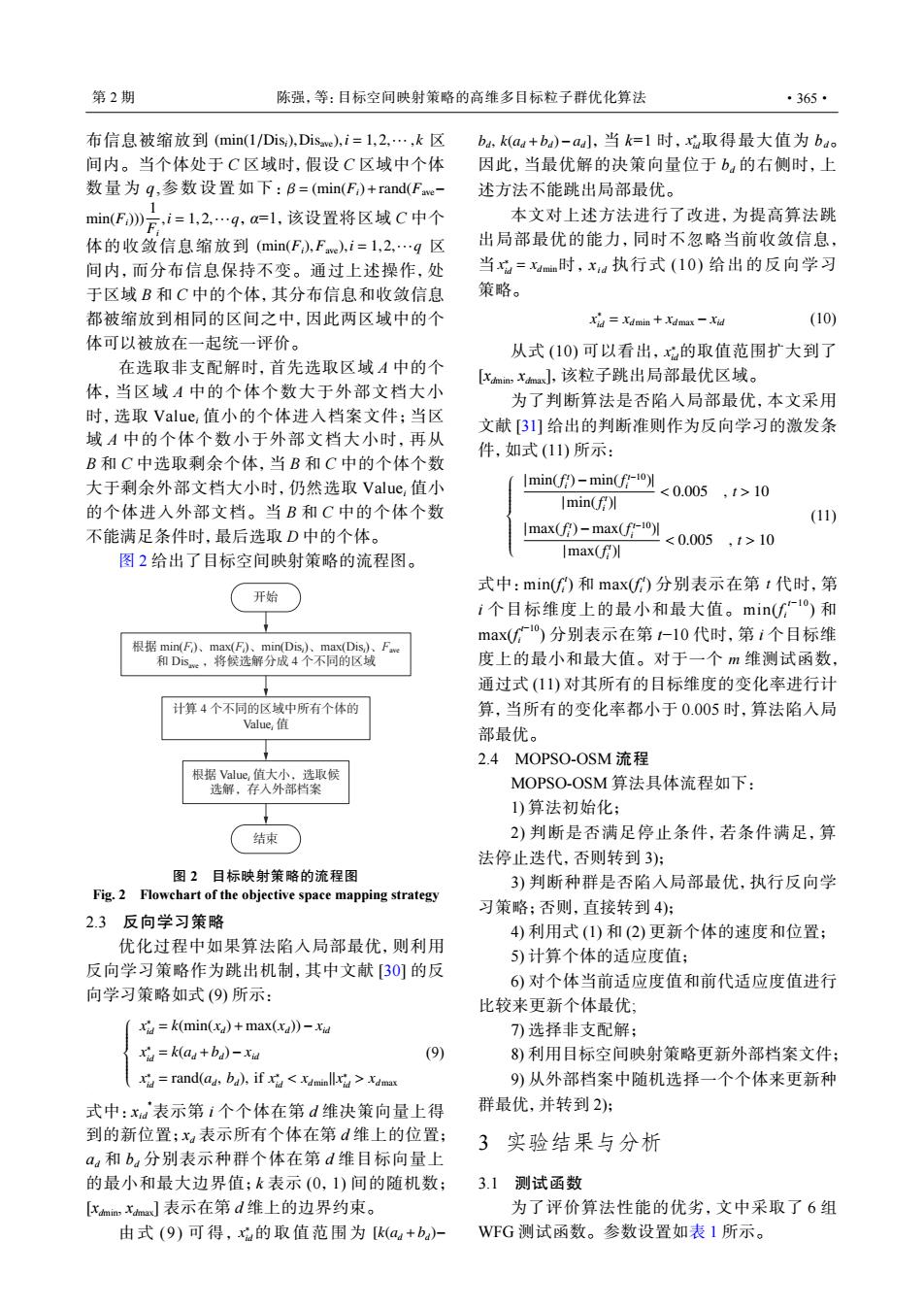

第2期 陈强,等:目标空间映射策略的高维多目标粒子群优化算法 ·365· 布信息被缩放到(min(1/Dis),Dise),i=1,2,…,k区 bu,k(au+ba)-a,当k=l时,xa取得最大值为bao 间内。当个体处于C区域时,假设C区域中个体 因此,当最优解的决策向量位于b的右侧时,上 数量为q,参数设置如下:B=(min(F)+rand(Fe 述方法不能跳出局部最优。 min(F》万,i=l,2,9,a=l,该设置将区域C中个 本文对上述方法进行了改进,为提高算法跳 体的收敛信息缩放到(min(F),Fwe),i=l,2,…q区 出局部最优的能力,同时不忽略当前收敛信息, 间内,而分布信息保持不变。通过上述操作,处 当x=x4m时,xa执行式(10)给出的反向学习 于区域B和C中的个体,其分布信息和收敛信息 策略。 都被缩放到相同的区间之中,因此两区域中的个 Xid=Xdmin+dmax -Xid (10) 体可以被放在一起统一评价。 从式(10)可以看出,x的取值范围扩大到了 在选取非支配解时,首先选取区域A中的个 [min,nax小,该粒子跳出局部最优区域。 体,当区域A中的个体个数大于外部文档大小 为了判断算法是否陷入局部最优,本文采用 时,选取Value,值小的个体进入档案文件;当区 文献[3]给出的判断准则作为反向学习的激发条 域A中的个体个数小于外部文档大小时,再从 件,如式(11)所示: B和C中选取剩余个体,当B和C中的个体个数 大于剩余外部文档大小时,仍然选取Value,值小 Imin(f)-min(f10) <0.005,t>10 的个体进人外部文档。当B和C中的个体个数 Imin(f (11) 不能满足条件时,最后选取D中的个体。 Imax(f)-max(f10 <0.005,1>10 图2给出了目标空间映射策略的流程图。 Imax( 式中:min(f)和max(f)分别表示在第t代时,第 开始 i个目标维度上的最小和最大值。min(f-1)和 max(广0)分别表示在第1-l0代时,第i个目标维 根据min(F)、max(F)、min(Dis、max(Dis) F 和Dise,将候选解分成4个不同的区域 度上的最小和最大值。对于一个m维测试函数, 通过式(11)对其所有的目标维度的变化率进行计 计算4个不同的区域中所有个体的 算,当所有的变化率都小于0.005时,算法陷入局 Value,值 部最优。 2.4 MOPSO-OSM流程 根据Value,值大小,选取候 选解,存入外部档案 MOPSO-OSM算法具体流程如下: 1)算法初始化: 结束 2)判断是否满足停止条件,若条件满足,算 法停止迭代,否则转到3): 图2目标映射策略的流程图 3)判断种群是否陷入局部最优,执行反向学 Fig.2 Flowchart of the objective space mapping strategy 习策略;否则,直接转到4): 2.3反向学习策略 4)利用式(1)和(2)更新个体的速度和位置: 优化过程中如果算法陷入局部最优,则利用 5)计算个体的适应度值: 反向学习策略作为跳出机制,其中文献30]的反 6)对个体当前适应度值和前代适应度值进行 向学习策略如式(9)所示: 比较来更新个体最优, x=k(min(x)+max(xd))-xid 7)选择非支配解; xid k(aa+ba)-xid (9) 8)利用目标空间映射策略更新外部档案文件; x rand(ad,ba),if xi<xaminllxi>xdmas 9)从外部档案中随机选择一个个体来更新种 式中:xa表示第i个个体在第d维决策向量上得 群最优,并转到2); 到的新位置;xa表示所有个体在第d维上的位置; 3实验结果与分析 aa和b.分别表示种群个体在第d维目标向量上 的最小和最大边界值;k表示(0,1)间的随机数; 31测试函数 [xim,xhaJ表示在第d维上的边界约束。 为了评价算法性能的优劣,文中采取了6组 由式(9)可得,xa的取值范围为[k(au+b)- WFG测试函数。参数设置如表1所示。(min(1/Disi),Disave),i = 1,2,··· , k β = (min(Fi)+rand(Fave− min(Fi))) 1 Fi ,i = 1,2,···q (min(Fi),Fave),i = 1,2,···q 布信息被缩放到 区 间内。当个体处于 C 区域时,假设 C 区域中个体 数量为 q,参数设置如下: ,α=1,该设置将区域 C 中个 体的收敛信息缩放到 区 间内,而分布信息保持不变。通过上述操作,处 于区域 B 和 C 中的个体,其分布信息和收敛信息 都被缩放到相同的区间之中,因此两区域中的个 体可以被放在一起统一评价。 在选取非支配解时,首先选取区域 A 中的个 体,当区域 A 中的个体个数大于外部文档大小 时,选取 Valuei 值小的个体进入档案文件;当区 域 A 中的个体个数小于外部文档大小时,再从 B 和 C 中选取剩余个体,当 B 和 C 中的个体个数 大于剩余外部文档大小时,仍然选取 Valuei 值小 的个体进入外部文档。当 B 和 C 中的个体个数 不能满足条件时,最后选取 D 中的个体。 图 2 给出了目标空间映射策略的流程图。 开始 根据 min(Fi )、max(Fi )、min(Disi )、max(Disi )、Fave 和 Disave ,将候选解分成 4 个不同的区域 计算 4 个不同的区域中所有个体的 Valuei 值 根据 Valuei 值大小,选取候 选解,存入外部档案 结束 图 2 目标映射策略的流程图 Fig. 2 Flowchart of the objective space mapping strategy 2.3 反向学习策略 优化过程中如果算法陷入局部最优,则利用 反向学习策略作为跳出机制,其中文献 [30] 的反 向学习策略如式 (9) 所示: x ∗ id = k(min(xd)+max(xd))− xid x ∗ id = k(ad +bd)− xid x ∗ id = rand(ad, bd), if x ∗ id < xdmin||x ∗ id > xdmax (9) 式中:xid *表示第 i 个个体在第 d 维决策向量上得 到的新位置;xd 表示所有个体在第 d 维上的位置; ad 和 bd 分别表示种群个体在第 d 维目标向量上 的最小和最大边界值;k 表示 (0,1) 间的随机数; [xdmin, xdmax] 表示在第 d 维上的边界约束。 x ∗ id 由式 (9) 可得, 的取值范围为 [k(ad +bd)− bd, k(ad +bd)−ad] x ∗ ,当 k=1 时 , id取得最大值为 bd。 因此,当最优解的决策向量位于 bd 的右侧时,上 述方法不能跳出局部最优。 x ∗ id = xdmin 本文对上述方法进行了改进,为提高算法跳 出局部最优的能力,同时不忽略当前收敛信息, 当 时 , xi d 执行式 (10) 给出的反向学习 策略。 x ∗ id = xdmin + xdmax − xid (10) x ∗ 从式 id (10) 可以看出, 的取值范围扩大到了 [xdmin, xdmax],该粒子跳出局部最优区域。 为了判断算法是否陷入局部最优,本文采用 文献 [31] 给出的判断准则作为反向学习的激发条 件,如式 (11) 所示: |min(f t i )−min(f t−10 i )| |min(f t i )| < 0.005 , t > 10 |max(f t i )−max(f t−10 i )| |max(f t i )| < 0.005 , t > 10 (11) t m 式中:min(fi t ) 和 max(fi t ) 分别表示在第 代时,第 i 个目标维度上的最小和最大值。min(fi t−10) 和 max(fi t−10) 分别表示在第 t−10 代时,第 i 个目标维 度上的最小和最大值。对于一个 维测试函数, 通过式 (11) 对其所有的目标维度的变化率进行计 算,当所有的变化率都小于 0.005 时,算法陷入局 部最优。 2.4 MOPSO-OSM 流程 MOPSO-OSM 算法具体流程如下: 1) 算法初始化; 2) 判断是否满足停止条件,若条件满足,算 法停止迭代,否则转到 3); 3) 判断种群是否陷入局部最优,执行反向学 习策略;否则,直接转到 4); 4) 利用式 (1) 和 (2) 更新个体的速度和位置; 5) 计算个体的适应度值; 6) 对个体当前适应度值和前代适应度值进行 比较来更新个体最优; 7) 选择非支配解; 8) 利用目标空间映射策略更新外部档案文件; 9) 从外部档案中随机选择一个个体来更新种 群最优,并转到 2); 3 实验结果与分析 3.1 测试函数 为了评价算法性能的优劣,文中采取了 6 组 WFG 测试函数。参数设置如表 1 所示。 第 2 期 陈强,等:目标空间映射策略的高维多目标粒子群优化算法 ·365·