正在加载图片...

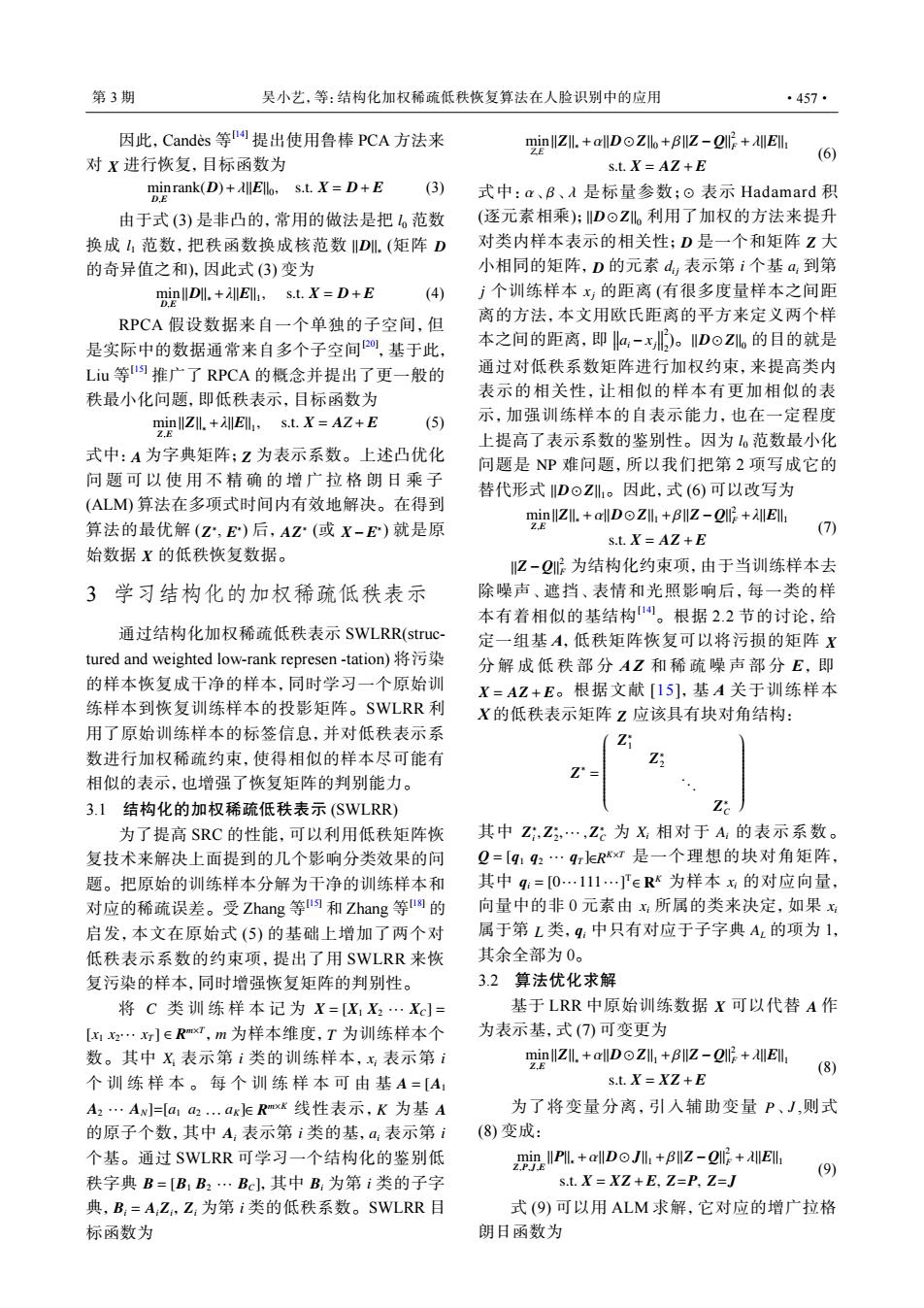

第3期 吴小艺,等:结构化加权稀疏低秩恢复算法在人脸识别中的应用 ·457· 因此,Candes等提出使用鲁棒PCA方法来 ZI.+DZIlo+β1Z-QI+E, 对X进行恢复,目标函数为 (6) s.t.X=AZ+E iprank(D)+.s.t.=D+E (3) 式中:a、B、A是标量参数;o表示Hadamard积 由于式(3)是非凸的,常用的做法是把。范数 (逐元素相乘):D⊙Z。利用了加权的方法来提升 换成1,范数,把秩函数换成核范数ID(矩阵D 对类内样本表示的相关性;D是一个和矩阵Z大 的奇异值之和),因此式(3)变为 小相同的矩阵,D的元素d表示第i个基a,到第 mpinllDll.+l,s.t.X=D+E (4) 广个训练样本x的距离(有很多度量样本之间距 RPCA假设数据来自一个单独的子空间,但 离的方法,本文用欧氏距离的平方来定义两个样 是实际中的数据通常来自多个子空间,基于此, 本之间的距离,即a,-x)。IDoZ孔lo的目的就是 Liu等I推广了RPCA的概念并提出了更一般的 通过对低秩系数矩阵进行加权约束,来提高类内 秩最小化问题,即低秩表示,目标函数为 表示的相关性,让相似的样本有更加相似的表 m中Z.+E,s.t.X=AZ+E (5) 示,加强训练样本的自表示能力,也在一定程度 上提高了表示系数的鉴别性。因为6范数最小化 式中:A为字典矩阵;Z为表示系数。上述凸优化 问题是NP难问题,所以我们把第2项写成它的 问题可以使用不精确的增广拉格朗日乘子 替代形式D⊙Z。因此,式(6)可以改写为 (ALM)算法在多项式时间内有效地解决。在得到 minllZl.+alDl+Zl+Ell 算法的最优解(Z,E)后,AZ(或X-E)就是原 (7) s.t.X=AZ+E 始数据X的低秩恢复数据。 Z-Q为结构化约束项,由于当训练样本去 3学习结构化的加权稀疏低秩表示 除噪声、遮挡、表情和光照影响后,每一类的样 本有着相似的基结构。根据2.2节的讨论,给 通过结构化加权稀疏低秩表示SWLRR(struc 定一组基A,低秩矩阵恢复可以将污损的矩阵X tured and weighted low-rank represen-tation)将污染 分解成低秩部分AZ和稀疏噪声部分E,即 的样本恢复成干净的样本,同时学习一个原始训 X=AZ+E。根据文献[15],基A关于训练样本 练样本到恢复训练样本的投影矩阵。SWLRR利 X的低秩表示矩阵Z应该具有块对角结构: 用了原始训练样本的标签信息,并对低秩表示系 数进行加权稀疏约束,使得相似的样本尽可能有 相似的表示,也增强了恢复矩阵的判别能力。 3.1结构化的加权稀疏低秩表示(SWLRR) 为了提高SRC的性能,可以利用低秩矩阵恢 其中Z,Z…,Z:为X相对于A:的表示系数。 复技术来解决上面提到的几个影响分类效果的问 Q=[q12…qr]eRx是一个理想的块对角矩阵, 题。把原始的训练样本分解为干净的训练样本和 其中g:=[0…111…eR为样本的对应向量, 对应的稀疏误差。受Zhang等l1和Zhang等l的 向量中的非0元素由x所属的类来决定,如果x 启发,本文在原始式(⑤)的基础上增加了两个对 属于第L类,9:中只有对应于子字典A的项为1, 低秩表示系数的约束项,提出了用SWLRR来恢 其余全部为0。 复污染的样本,同时增强恢复矩阵的判别性。 3.2算法优化求解 将C类训练样本记为X=[X1X2…Xc]= 基于LRR中原始训练数据X可以代替A作 [m…x]∈Rm,m为样本维度,T为训练样本个 为表示基,式(可变更为 数。其中X表示第i类的训练样本,x表示第i mipllZ.+qllDZ,+B, (8) 个训练样本。每个训练样本可由基A=[A, s.t.X=XZ+E A2…Aw=[a12.akle RmxK线性表示,K为基A 为了将变量分离,引入辅助变量P、J,则式 的原子个数,其中A,表示第i类的基,a:表示第i (8)变成: 个基。通过SWLRR可学习一个结构化的鉴别低 mine llPll.+alD+BZ-l+Ell (9) 秩字典B=[B1B2…BJ,其中B:为第i类的子字 s.t.X=XZ+E,Z=P,Z=J 典,B:=A,Z,Z:为第i类的低秩系数。SWLRR目 式(9)可以用ALM求解,它对应的增广拉格 标函数为 朗日函数为X 因此,Candès 等 [14] 提出使用鲁棒 PCA 方法来 对 进行恢复,目标函数为 min D,E rank(D)+λ∥E∥0 , s.t. X = D+ E (3) l0 l1 ∥D∥∗ D 由于式 (3) 是非凸的,常用的做法是把 范数 换成 范数,把秩函数换成核范数 (矩阵 的奇异值之和),因此式 (3) 变为 min D,E ∥D∥∗ +λ∥E∥1 , s.t. X = D+ E (4) RPCA 假设数据来自一个单独的子空间,但 是实际中的数据通常来自多个子空间[20] ,基于此, Liu 等 [15] 推广了 RPCA 的概念并提出了更一般的 秩最小化问题,即低秩表示,目标函数为 min Z,E ∥Z∥∗ +λ∥E∥1 , s.t. X = AZ + E (5) A Z Z ∗ E ∗ AZ∗ X− E ∗ X 式中: 为字典矩阵; 为表示系数。上述凸优化 问题可以使用不精确的增广拉格朗日乘 子 (ALM) 算法在多项式时间内有效地解决。在得到 算法的最优解 ( , ) 后, (或 ) 就是原 始数据 的低秩恢复数据。 3 学习结构化的加权稀疏低秩表示 通过结构化加权稀疏低秩表示 SWLRR(structured and weighted low-rank represen -tation) 将污染 的样本恢复成干净的样本,同时学习一个原始训 练样本到恢复训练样本的投影矩阵。SWLRR 利 用了原始训练样本的标签信息,并对低秩表示系 数进行加权稀疏约束,使得相似的样本尽可能有 相似的表示,也增强了恢复矩阵的判别能力。 3.1 结构化的加权稀疏低秩表示 (SWLRR) 为了提高 SRC 的性能,可以利用低秩矩阵恢 复技术来解决上面提到的几个影响分类效果的问 题。把原始的训练样本分解为干净的训练样本和 对应的稀疏误差。受 Zhang 等 [15] 和 Zhang 等 [18] 的 启发,本文在原始式 (5) 的基础上增加了两个对 低秩表示系数的约束项,提出了用 SWLRR 来恢 复污染的样本,同时增强恢复矩阵的判别性。 C X = [X1 X2 ··· XC] = [x1 x2··· xT ] ∈ R m×T m T Xi i xi i A = [A1 A2 ··· AN]=[a1 a2 ··· aK]∈ R m×K K A Ai i ai i B = [B1 B2 ··· BC] Bi i Bi = AiZi Zi i 将 类训练样本记为 , 为样本维度, 为训练样本个 数。其中 表示第 类的训练样本, 表示第 个训练样本。每个训练样本可由基 线性表示, 为基 的原子个数,其中 表示第 类的基, 表示第 个基。通过 SWLRR 可学习一个结构化的鉴别低 秩字典 ,其中 为第 类的子字 典, , 为第 类的低秩系数。SWLRR 目 标函数为 min Z,E ∥Z∥∗ +α∥D⊙ Z∥0 +β∥Z −Q∥ 2 F +λ∥E∥1 s.t. X = AZ + E (6) α β λ ⊙ ∥D⊙ Z∥0 D Z D di j i ai j xj ai − xj 2 2 ∥D⊙ Z∥0 l0 NP∥D⊙ Z∥1 式中: 、 、 是标量参数; 表示 Hadamard 积 (逐元素相乘); 利用了加权的方法来提升 对类内样本表示的相关性; 是一个和矩阵 大 小相同的矩阵, 的元素 表示第 个基 到第 个训练样本 的距离 (有很多度量样本之间距 离的方法,本文用欧氏距离的平方来定义两个样 本之间的距离,即 )。 的目的就是 通过对低秩系数矩阵进行加权约束,来提高类内 表示的相关性,让相似的样本有更加相似的表 示,加强训练样本的自表示能力,也在一定程度 上提高了表示系数的鉴别性。因为 范数最小化 问题是 难问题,所以我们把第 2 项写成它的 替代形式 。因此,式 (6) 可以改写为 min Z,E ∥Z∥∗ +α∥D⊙ Z∥1 +β∥Z −Q∥ 2 F +λ∥E∥1 s.t. X = AZ + E (7) ∥Z −Q∥ 2 F X X = AZ + E Z 为结构化约束项,由于当训练样本去 除噪声、遮挡、表情和光照影响后,每一类的样 本有着相似的基结构[14]。根据 2.2 节的讨论,给 定一组基 A,低秩矩阵恢复可以将污损的矩阵 分解成低秩部 分 AZ 和稀疏噪声部 分 E, 即 。根据文献 [15],基 A 关于训练样本 X 的低秩表示矩阵 应该具有块对角结构: Z ∗ = Z ∗ 1 Z ∗ 2 . . . Z ∗ C Z ∗ i , Z ∗ 2 ,··· , Z ∗ C Xi Ai Q = [q1 q2 ··· qT ]∈R K×T qi = [0···111···] T ∈ R K xi xi xi L qi AL 其中 为 相对于 的表示系数。 是一个理想的块对角矩阵, 其中 为样本 的对应向量, 向量中的非 0 元素由 所属的类来决定,如果 属于第 类, 中只有对应于子字典 的项为 1, 其余全部为 0。 3.2 算法优化求解 基于 LRR 中原始训练数据 X 可以代替 A 作 为表示基,式 (7) 可变更为 min Z,E ∥Z∥∗ +α∥D⊙ Z∥1 +β∥Z −Q∥ 2 F +λ∥E∥1 s.t. X = XZ + E (8) 为了将变量分离,引入辅助变量 P、J ,则式 (8) 变成: min Z,P,J,E ∥P∥∗ +α∥D⊙ J∥1 +β∥Z −Q∥ 2 F +λ∥E∥1 s.t. X = XZ + E, Z=P, Z=J (9) 式 (9) 可以用 ALM 求解,它对应的增广拉格 朗日函数为 第 3 期 吴小艺,等:结构化加权稀疏低秩恢复算法在人脸识别中的应用 ·457·