正在加载图片...

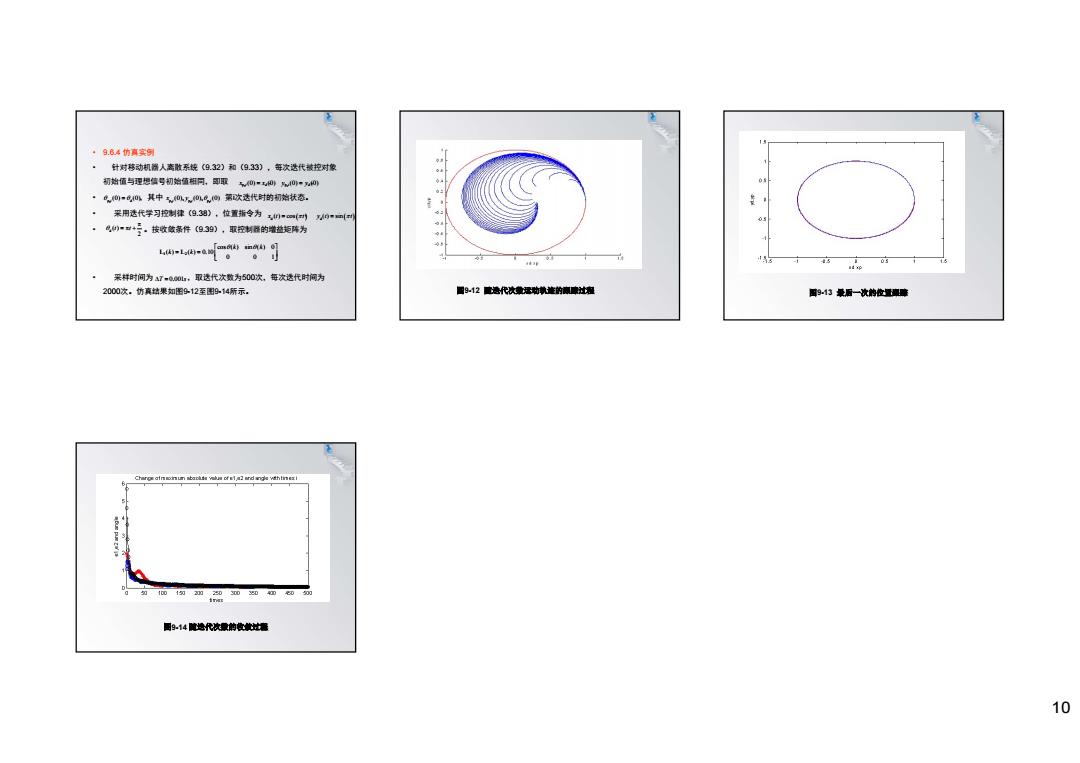

·9.84伪真实例 。 针对移动机器人离散系统(9.32)和(9.33),年次选代被控对象 初始值与理想结号初始值相可,即取网-心0一0 6间一0其中w@m心向第欢达代时的切始状态, 。采用选代学习控制律(9.3翅》,位直指令为)9e 化)世+三。按收做条件(939),取控制器的嫩益矩阵为 a 05 采样时间为a7,®001,取选代次数为500次,每次选代时间为 2000次.仿真结果知图912至图914所示. 国912直造代次单运功铁连的海家过定 国93最后一次的位毫 厨914院选代次量的收教过据 1010 • 9.6.4 仿真实例 • 针对移动机器人离散系统(9.32)和(9.33),每次迭代被控对象 初始值与理想信号初始值相同,即取 , , • ,其中 第i次迭代时的初始状态。 • 采用迭代学习控制律(9.38),位置指令为 , • 。按收敛条件(9.39),取控制器的增益矩阵为 • 采样时间为 ,取迭代次数为500次,每次迭代时间为 2000次。仿真结果如图9-12至图9-14所示。 p, d (0) (0) i x x p, d (0) (0) i y y p, d (0) (0) i p, p, p, (0), (0), (0) i i i x y x t t d ( ) cos y t t d ( ) sin d π ( ) π 2 t t 1 2 cos ( ) sin ( ) 0 ( ) ( ) 0.10 0 0 1 k k k k L L T s 0.001 图9-12 随迭代次数运动轨迹的跟踪过程 图9-13 最后一次的位置跟踪 图9-14 随迭代次数的收敛过程